计算机视觉方向简介 | 用深度学习进行表格提取

点“计算机视觉life”关注,置顶更快接收消息!

这一篇是2017年文档分析与识别国际会议(ICDAR)论文。来自巴基斯坦国立大学的Azka Gilani, Shah Rukh Qasim等人提出来的基于Faster-RCNN表格检测的方法。该方法在对不同排版的文档时,具有更强的鲁棒性和泛化。

背景介绍&已有方法

文档分析是一种定量分析,对文档进行检查和解释,以便引出意义,获得理解并归纳出经验知识。

表格用于以结构化方式向读者呈现基本信息,是许多文档分析应用程序中的关键步骤。但由于表格的布局和设计不同,这导致表格识别是一个难题。研究人员已经提出了许多基于文档布局分析的表格检测技术:

Costa e Silva提出使用隐式马尔科夫模型,将文本从PDF取出,并计算文段之间的距离作为特征向量。这个方法的缺点是:只适用于非光栅化PDF文档。

Anh提出一个混合方法,系统将先对文档图片话进行分类文字与非文字区域的划分。基于上一步的划分,寻找表格的候选区域。但这种方法无法识别跨页表格并且无法用于扫描的文档。

...

大多数这些技术未能概括,因为它们依赖于手工设计的特征,这些特征对于布局变化不具有鲁棒性。

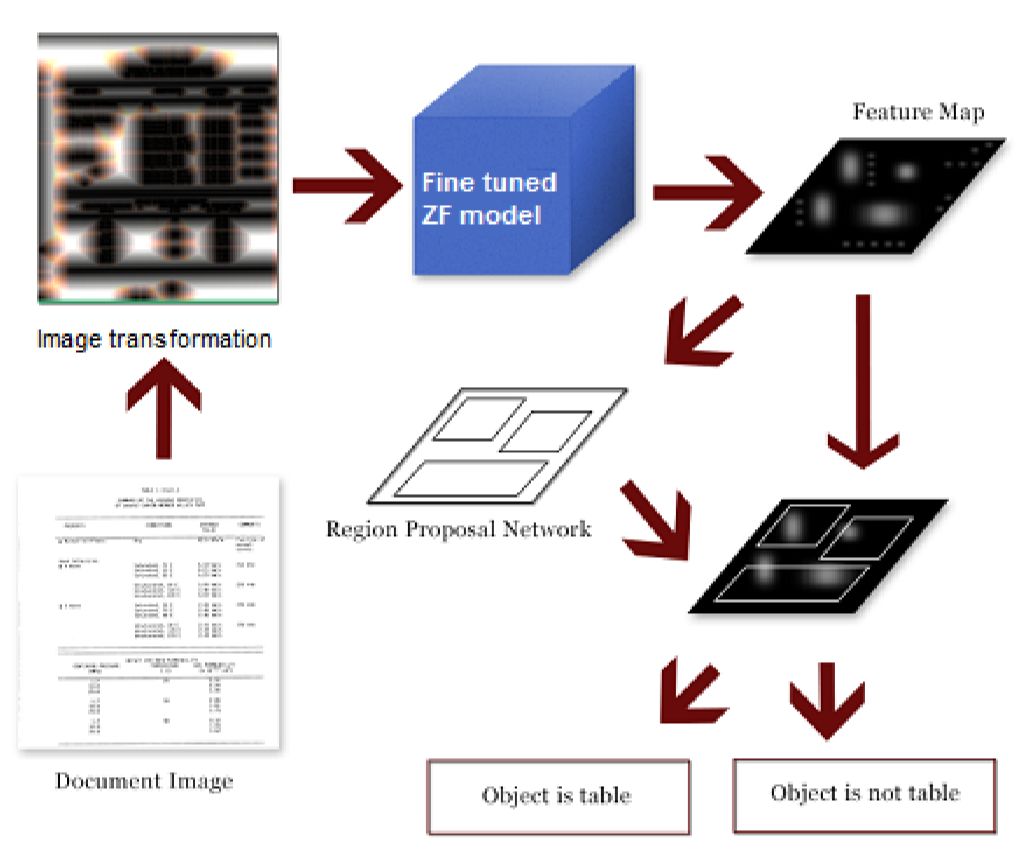

1.网络架构

Image Transformation

Faster R-CNN

1.1 图像变换(Image Transforamtion)

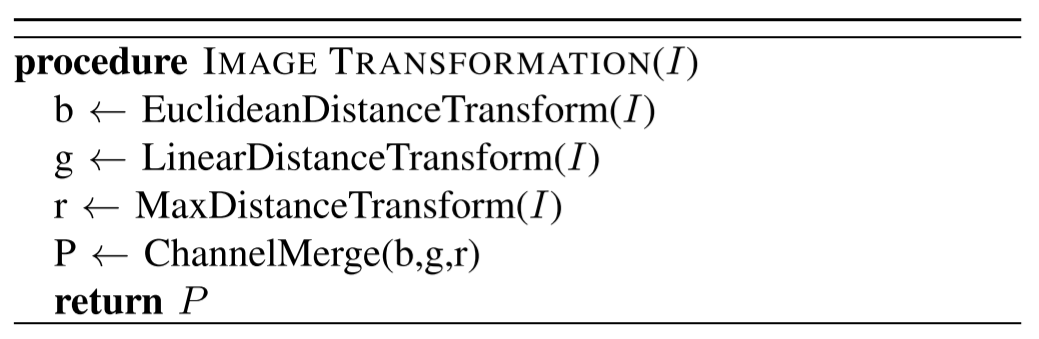

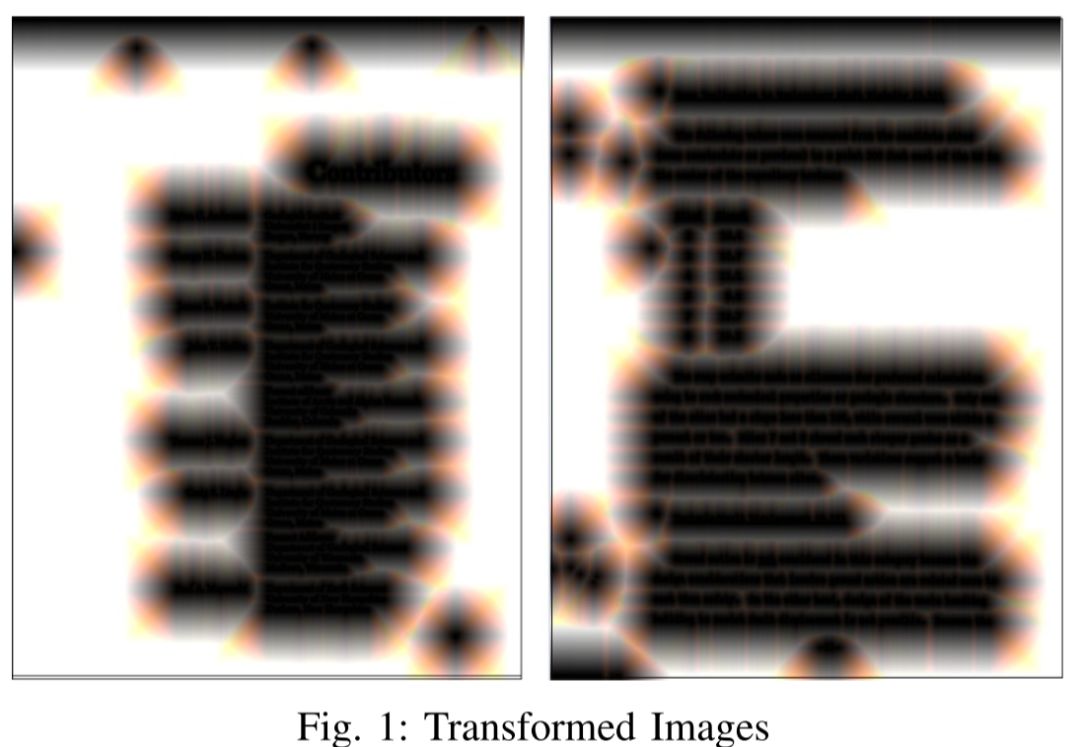

相比于直接用图像,他们认为对图像采用 distance transform可以精确地计算出文字区域与空白区域之间的距离,以便之后可以准确地推测出表格所在的区域,也能在已有的Faster R-CNN模型更好地训练。

先分别对图片的三个通道进行不同的 distance transform,再把三个通道的处理结果相加,得到模型的输入。

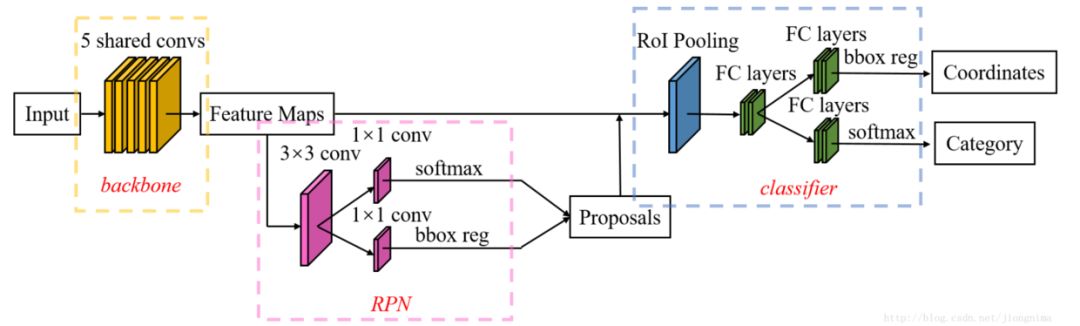

1.2 Faster-RCNN

1.共享的卷积层(shareable convolutional layers)

这篇paper用了5层的Zeiler and Fergus model(简称为ZF model)

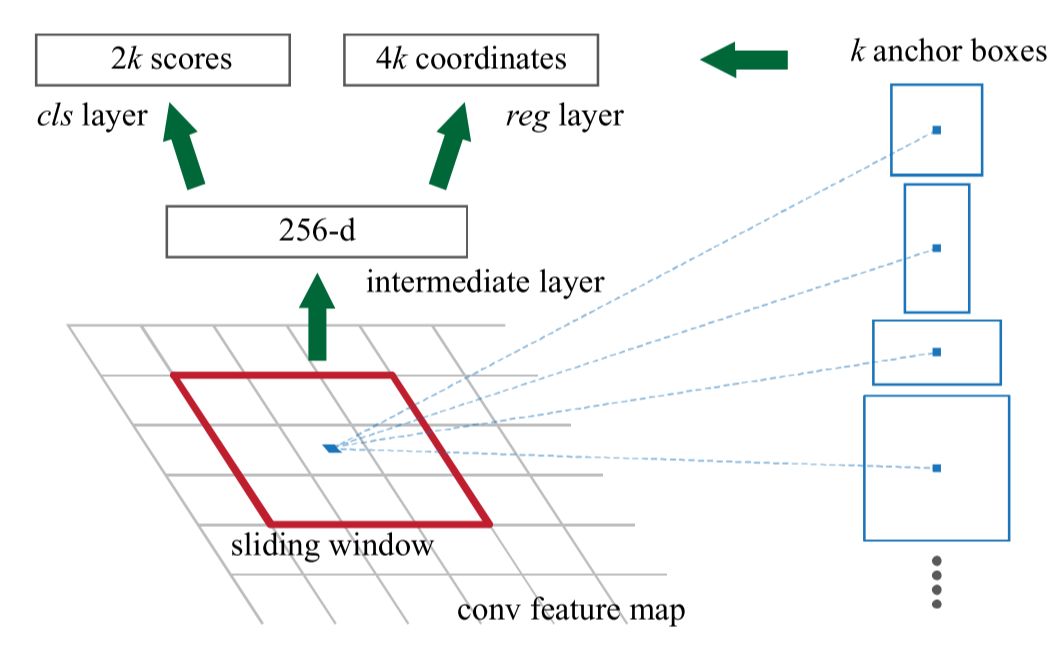

2.候选区域生成网络(Region Proposal Network)

这就是Faster R-CNN的最大优势,可以更快生成检测框。RPN从共享卷积层得到feature map后再做3*3的卷积,相当于每个点融合了周围8个点的空间信息,并且每一个滑动窗生成最多 k=9个的anchors作为初始的检测框。 之后,分为2条线:

a) cls line:用 Softmax判定foreground(含有检测目标)和background,在训练的时候排除掉了超越图像边界的anchor。

b) reg line:采用 SmoothL1Loss进行训练,计算对于anchors的bounding box regression偏移量,以获得精确的proposal。

最后的 ProposalsLayer则综合两条线的信息,筛选掉太小和超边界的候选框,将合格的proposals输出到下一个分类器中。

3.对候选区域进行分类的网络(Classifier)

这里接受了两个输入:Feature Maps和Proposals ROIPooling的作用: a) 每个ROI从共享卷积层上摘取对应的特征

b) Proposals提供的检测框大小尺寸不同,需要做对齐,转换为固定大小的供下一步全连接层使用。

最后经过全连接层,获得两个输出: 检测框的四个坐标和分类结果

2. 模型训练

分类器训练样本:

正样本(positive example): 含有table的区域(table region)

负样本(negative example): background

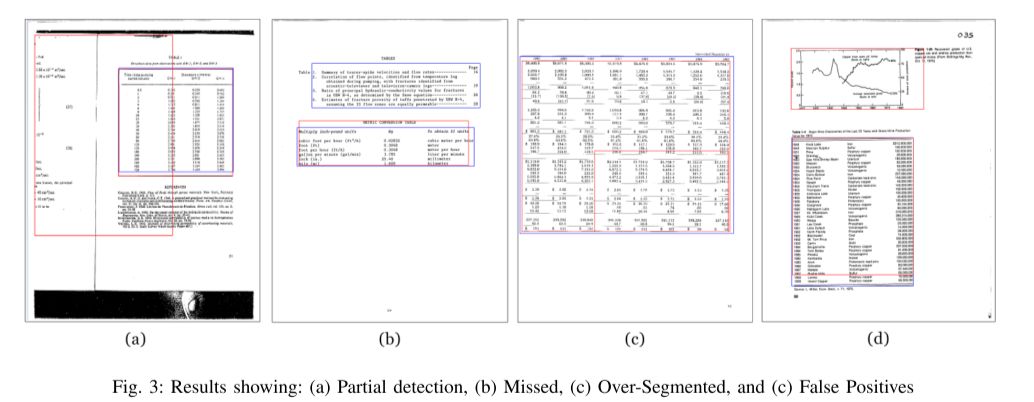

因此,这个网络并不会在负样本上过多地进行表格搜索,下面是一些失败案例。

模型用了 MomentumOptimizer, 具体参数设置:

Learning rate: 0.001

Momentum: 0.9

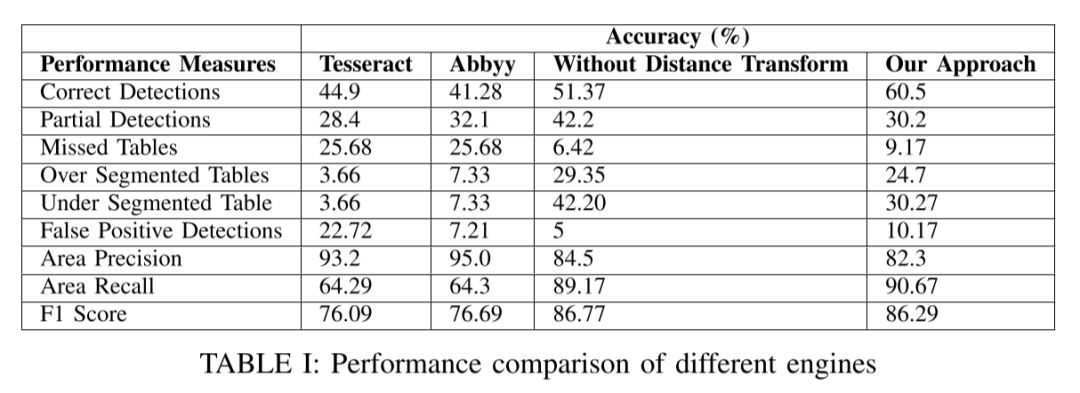

3. 实验结果

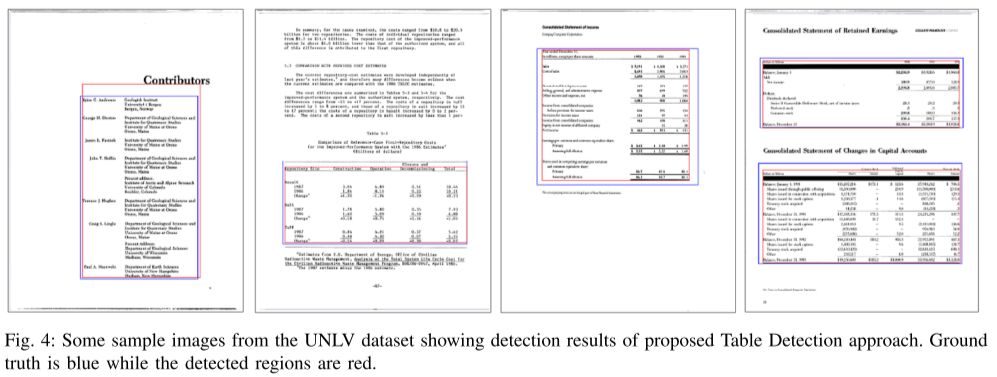

下面是一些UNLV数据的检测结果,蓝色为ground truth,红色为模型检测区域。

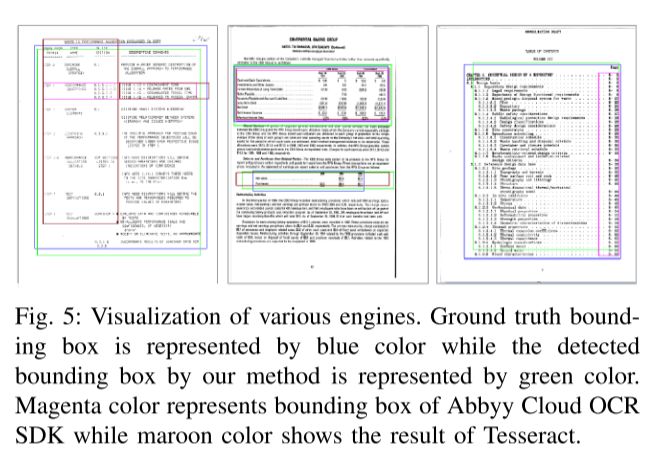

蓝色框为ground truth

绿色框为模型检测区域

红色框为Abbyy Cloud OCR SDK检测结果

紫色框为Tesseract检测结果

4. 总结

结果表明,基于深度学习的系统对于表格检测的布局分析更稳定的,因为它不依赖于手工设计的特征。与由Google开发的Tesseract最先进的表格检测的相比,它可以提供更好的结果系统。未来,将会针对表格结构和表格内容提取进行深入研究。

Reference

论文链接:Table Detection using Deep Learning

数据集: UNLV dataset

部分图片及文字来源: 实例分割模型Mask R-CNN详解:从R-CNN,Fast R-CNN,Faster R-CNN再到Mask R-CNN

推荐阅读