【泡泡图灵智库】VITAMIN-E:极密集特征点的视觉跟踪和建图(CVPR)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:VITAMIN-E: Visual Tracking And Mapping with Extremely Dense Feature Points

作者:Masashi Yokozuka, Shuji Oishi, Thompson Simon, Atsuhiko Banno

来源:CVPR 2019

编译:万应才

审核:李雨昊

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——VITAMIN-E: Visual Tracking And Mapping with Extremely Dense Feature Points, 该文章发表于CVPR 2019。

在本文中,我们提出了一种新的间接单目SLAM算法“VITAMIN-E”,它由于跟踪非常密集的特征点而具有很高的精度和鲁棒性。典型的间接方法由于其仔细的特征点选择以实现精确匹配而难以重建密集几何体。与传统方法不同,该方法通过跟踪由主导流估计所获得的的局部曲率极值来处理大量特征点。由于这可能导致束调整过程中的计算成本较高,我们提出了一种新的优化技术“subspace Gauss–Newton method ”,通过部分更新变量,显著提高束调整的计算效率。我们同时从重建点生成网格,并将它们合并为整个三维模型。在SLAM基准数据集EuroC上的实验结果表明,该方法在轨迹估计的准确性和鲁棒性方面优于DSO、ORB-SLAM和LSDSLAM等大SLAM方法。该方法只需一个CPU,就可以从密集的特征点实时生成非常详细的三维几何图形。

主要贡献

1.本文提出了一种基于主流估计和曲率极值跟踪的稠密特征点跟踪算法。

这使得VITAMIN-E能够处理大量的特征点;然而,同时维护这些特征点的需要可能会导致很高的计算成本。

2.我们还引入了一种新的优化方法,即子空间高斯-牛顿法,用于束调整。优化技术通过部分更新变量,显著提高了束调整的效率。

3.Vitamin-E从重建的特征点生成网格,并使用截断有符号距离函数(TSDF)对其进行整合。与传统的间接方法和最先进的直接方法相比,Vitamin-E仅使用一个CPU就可以实时提供非常详细的三维几何图形。

算法流程

1、整体结构描述

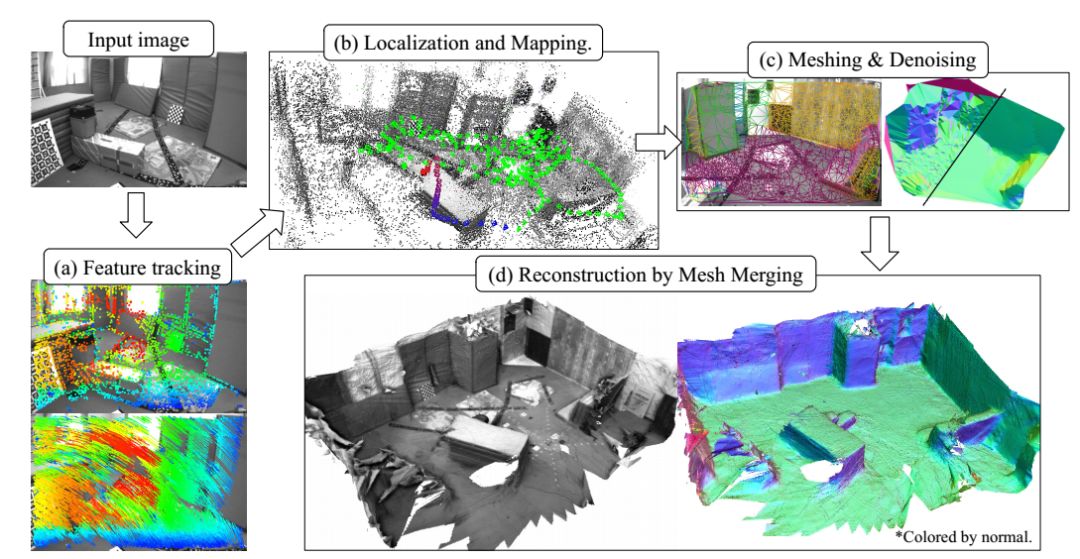

图1 系统整体模型

1.稠密特征点跟踪

1.1特征点跟踪

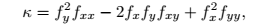

传统方法有直接匹配法和间接匹配法,本文提出的Vitamin-E不是基于描述符关联特征点,而是跟踪传入图像中曲率的局部极值。传统的间接方法只依赖大曲率特征点来获得稳定的对应关系,而该方法跟踪所有检测到的极值来重建详细的几何图形。在该方法中,特征点表示图像强度上曲率的极值。

1.2 Dominant Flow Estimation

在检测到曲率的极值后,所提出的方法估计了一个占主导地位的流,它代表了图像上光流的平均值,这为极值跟踪提供了一个良好的初始值,并使其显著稳定,使用BRIEF特征确定当前图像和以前图像之间的对应特征对。

1.3曲率极值跟踪

Vitamin-E通过利用主导流跟踪图像曲率的极值来跟踪特征点。由于Vitamin-E只依赖于极值而不是传统间接方法中使用的特征描述符,因此它不受图像噪声或光照变化引起的特征描述符变化的影响,这使得维生素E具有很强的鲁棒性。

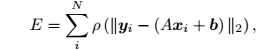

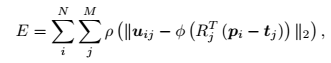

2.Bundle Adjustment for Dense Tracking

Bundle Adjustment 通过最小化重投影误差迭代地调整重构地图。

然而,在每帧中保持数千个特征点的情况下,就像Vitamin-E中的密集极值跟踪一样,矩阵H的大小基本上不能足够小,因为变量消除仅适用于与当前帧无关的旧变量,以实现稳定性。此外,Schur 补码矩阵的大小与特征点的数量成正比,因此,在H大小为100000×100000或更大的数万个点上进行束调整的计算成本太高,无法实时进行束调整。

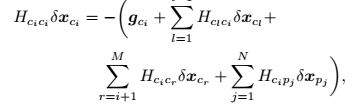

为了解决H尺寸的爆炸问题,我们提出了一种新的优化技术,称为“子空间高斯-牛顿法”。

3.稠密重建

由于前面章节描述的密集极值跟踪和子空间高斯-牛顿方法,Vitamin-E实时生成大量精确的三维点。这不仅生成点云,而且进一步的密集几何重建,这是传统的间接方法无法实现的。

主要结果

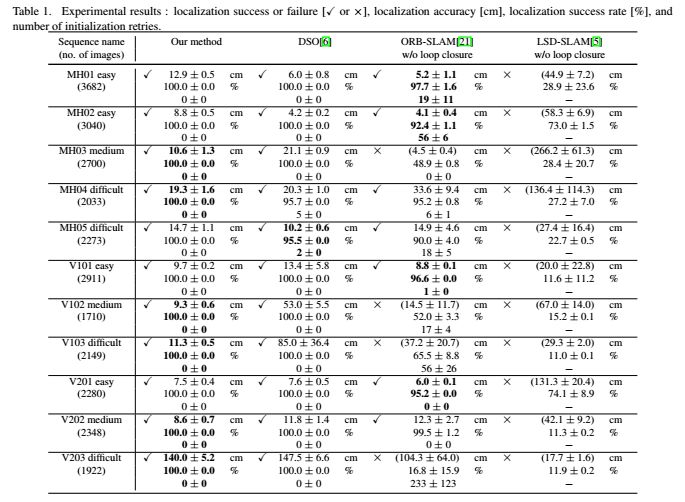

1.与其他算法在挑战环境下定位对比

表1 实验结果 点位成功或失败,定位精度,定位成功率和初始化重试次数

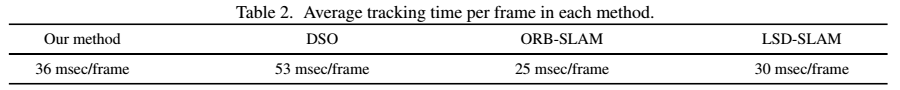

2.系统处理速度

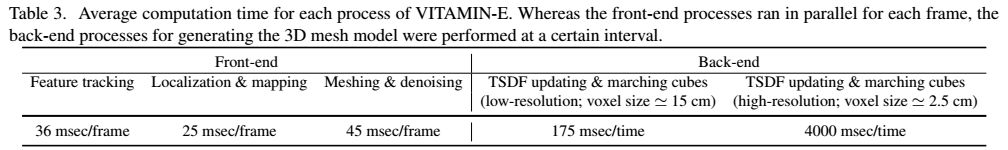

虽然前端过程在每个帧中并行运行,但生成3D网格模型的后端过程在一定间隔内执行。

表2 每帧平均跟踪时间

表3 Vitamin-E的每个过程的平均计算时间

3.重建结果与精度

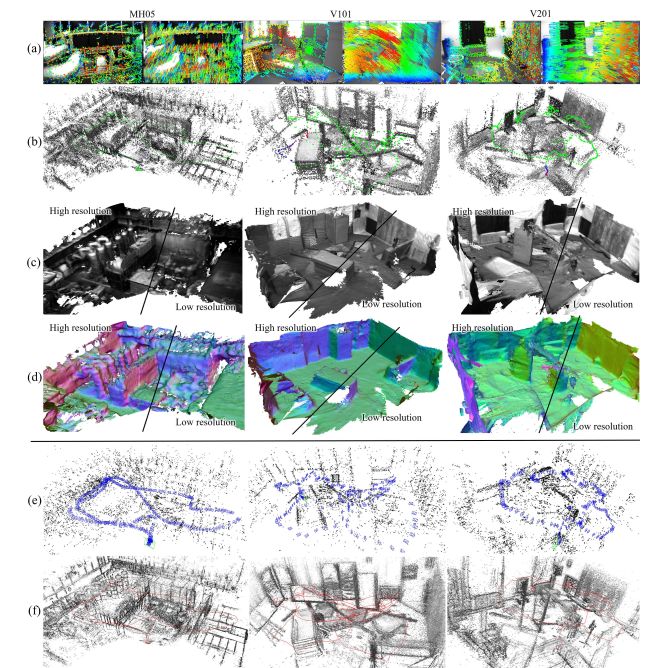

图1 重建结果 (a)实时稠密极值跟踪;(b)重建的三维点;(c)网格模型;(d)在不同尺寸的tsdf体素中通过所提议的稠密几何重建生成的正态映射;(e)orb-slam和(f)dso在同一场景中重建三维点。

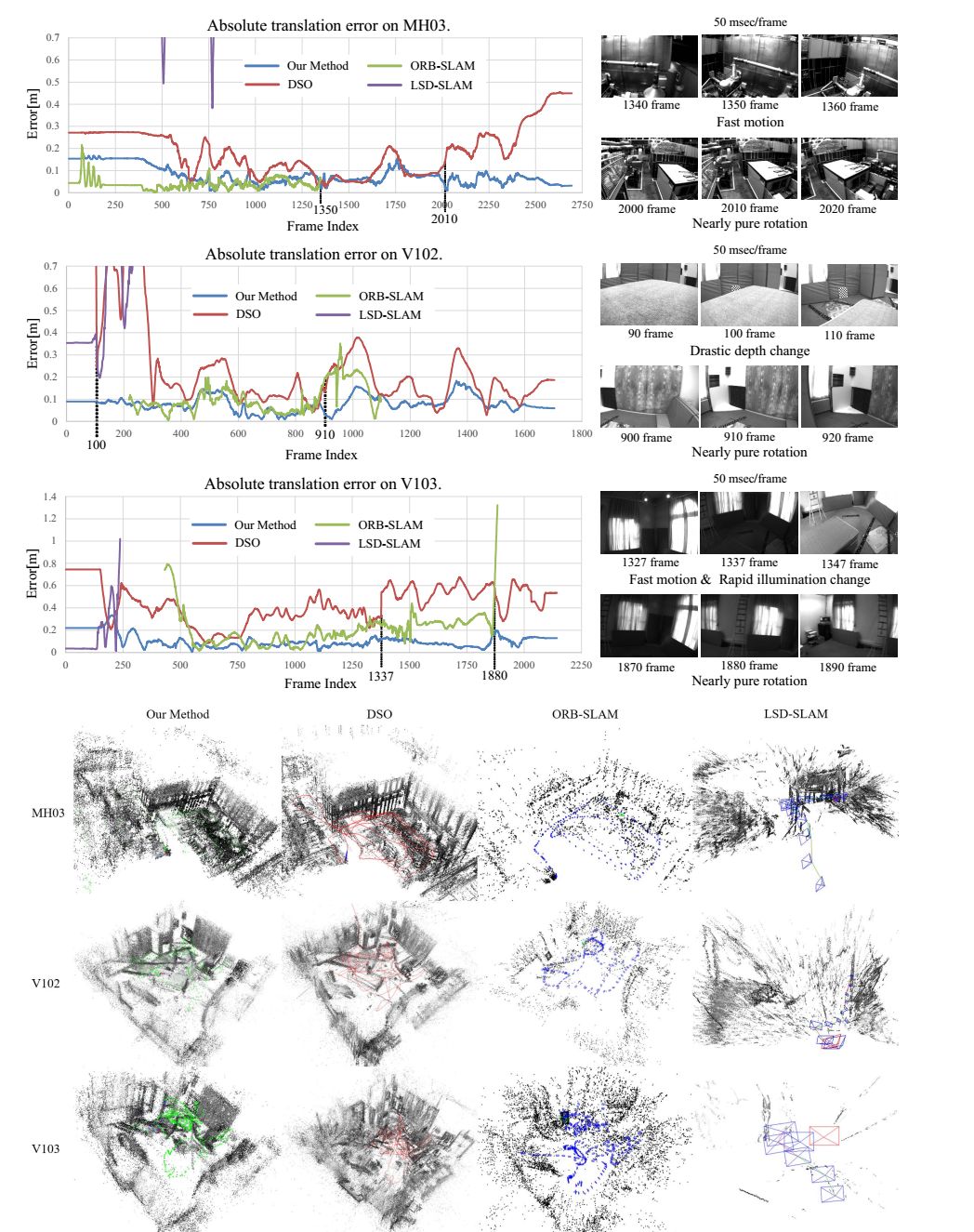

图3 在EuRoC V102, V103, and MH03数据集上跟踪估计

在每个场景中重建的点云:Vitamin-E成功地估计了摄像机的轨迹,尽管深度变化剧烈,几乎纯相机旋转,快速的摄像机运动和严重的照明条件,对比算法也在同样环境下测试,出现了较大的轨迹误差或完全丢失。

Abstract

In this paper, we propose a novel indirect monocular SLAM algorithm called “VITAMIN-E,” which is highly accurate and robust as a result of tracking extremely dense feature points. Typical indirect methods have difficulty in reconstructing dense geometry because of their careful feature point selection for accurate matching. Unlike conventional methods, the proposed method processes an enormous number of feature points by tracking the local extrema of curvature informed by dominant flow estimation. Because this may lead to high computational cost during bundle adjustment, we propose a novel optimization technique, the ”subspace Gauss–Newton method”, that significantly improves the computational efficiency of bundle adjustment by partially updating the variables. We concurrently generate meshes from the reconstructed points and merge them for an entire 3D model. The experimental results on the SLAM benchmark dataset EuRoC demonstrated that the proposed method outperformed state-of-theart SLAM methods, such as DSO, ORB-SLAM, and LSDSLAM, both in terms of accuracy and robustness in trajectory estimation. The proposed method simultaneously generated significantly detailed 3D geometry from the dense feature points in real time using only a CPU.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。提取码:83wb

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com