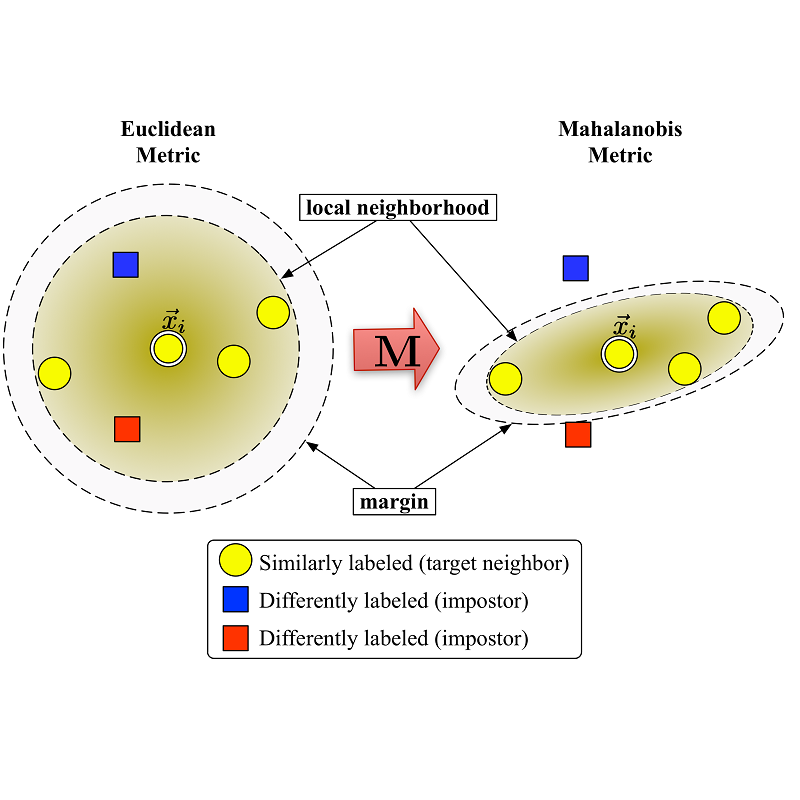

This paper addresses the problem of cross-view image based localization, where the geographic location of a ground-level street-view query image is estimated by matching it against a large scale aerial map (e.g., a high-resolution satellite image). State-of-the-art deep-learning based methods tackle this problem as deep metric learning which aims to learn global feature representations of the scene seen by the two different views. Despite promising results are obtained by such deep metric learning methods, they, however, fail to exploit a crucial cue relevant for localization, namely, the spatial layout of local features. Moreover, little attention is paid to the obvious domain gap (between aerial view and ground view) in the context of cross-view localization. This paper proposes a novel Cross-View Feature Transport (CVFT) technique to explicitly establish cross-view domain transfer that facilitates feature alignment between ground and aerial images. Specifically, we implement the CVFT as a network layer, which transports features from one domain to the other, leading to more meaningful feature similarity comparison. Our model is differentiable and can be learned end-to-end. Experiments on large-scale datasets have demonstrated that our method has remarkably boosted the state-of-the-art cross-view localization performance, e.g., on the CVUSA dataset, with significant improvements for top-1 recall from 40.79% to 61.43%, and for top-10 from 76.36% to 90.49%, compared with the previous state of the art [14]. We expect the key insight of the paper (i.e., explicitly handling domain difference via domain transport) will prove to be useful for other similar problems in computer vision as well.

翻译:本文探讨了基于本地化的跨视图图像问题, 地平面街道视图查询图像的地理位置通过与大型航空地图( 如高分辨率卫星图像)的匹配来估计。 以深层次学习为基础的最先进的方法将这一问题作为深层次的衡量学习, 目的是学习两种不同观点所看到的场景的全球特征展示。 尽管通过这种深层次的衡量学习方法取得了可喜的结果, 但是它们未能利用与本地化相关的关键线索, 即当地特征的空间布局。 此外, 在交叉视图本地化的背景下, 很少注意明显的域间差距( 空中视图和地面视图之间) 。 本文提出了一种新的跨视图功能化的深层学习方法, 以明确建立跨视图的域间传输, 以便利地平面图像和航空图像之间的定位。 我们用CVFT作为网络层层, 将地平面特征从一个域到另一个区域, 导致更有意义的地平面特征比较。 我们的模型是不同的, 可以学习最终到通过图像端端端端端的。 与高层次的C- 对比数据显示我们高层次的高级数据转换方法, 将显示我们从高层次的高级直径直观到高层次的图像, 。