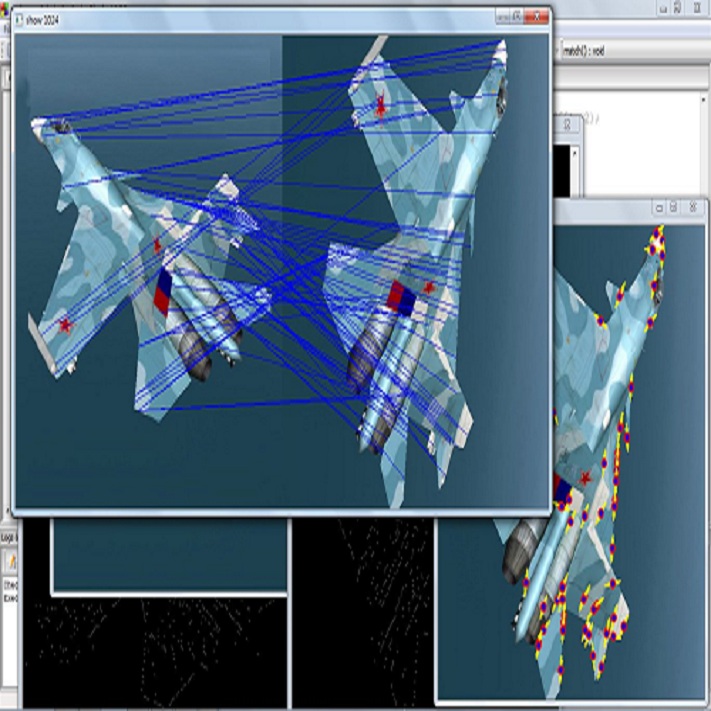

Spectral methods such as the improved Fourier Mellin Invariant (iFMI) transform have proved faster, more robust and accurate than feature based methods on image registration. However, iFMI is restricted to work only when the camera moves in 2D space and has not been applied on omni-cameras images so far. In this work, we extend the iFMI method and apply a motion model to estimate an omni-camera's pose when it moves in 3D space. This is particularly useful in field robotics applications to get a rapid and comprehensive view of unstructured environments, and to estimate robustly the robot pose. In the experiment section, we compared the extended iFMI method against ORB and AKAZE feature based approaches on three datasets showing different type of environments: office, lawn and urban scenery (MPI-omni dataset). The results show that our method boosts the accuracy of the robot pose estimation two to four times with respect to the feature registration techniques, while offering lower processing times. Furthermore, the iFMI approach presents the best performance against motion blur typically present in mobile robotics.

翻译:改进的 Fourier Mellin Invariant (iFMI) 变形等光谱方法证明比图像注册的特征方法更快、更健全、更准确。 然而, iFMI 只在摄像头在 2D 空间移动时才仅限于工作,而且迄今为止尚未应用于全摄像图像。 在这项工作中, 我们推广 iFMI 方法, 并应用一个运动模型来估计在 3D 空间移动时全摄像头的外观。 这在野外机器人应用中特别有用, 以便快速、 全面地观察非结构化的环境, 并强有力地估计机器人的外观。 此外, iFMI 方法在实验部分中, 我们比较了基于三种类型显示不同环境的方法的扩展的 : 办公室、 草坪和城市景色( MPI- omni 数据集) 。 结果显示, 我们的方法提高了机器人对地貌登记技术的精确度, 两至四倍, 同时提供了较低的处理时间。 此外, iFMI 方法展示了相对于移动机器人通常存在的运动模糊性的最佳表现。