IEEE TIP | VIPL实验室提出遥测式人脸心率估计新方法

近日,中国科学院计算技术研究所视觉信息处理与学习研究组(VIPL实验室)关于遥测式人脸心率估计的工作“RhythmNet: End-to-end Heart Rate Estimation from Face via Spatial-temporal Representation” 入选国际核心学术刊物IEEE TIP。

IEEE TIP,全称是IEEE Transactions on Image Processing,是Q1区期刊,属于中国计算机学会认可的计算机图形学与多媒体领域A类期刊,2019年SCI影响因子为6.79。IEEE TIP侧重图像处理的前沿理论与方法,入选论文都必须具有非常强的创新性。

遥测式人脸心率估计,远距离无感式测量,不需要直接与人体接触,通过人脸识别即可得出心率数,可用于医疗、公共安全、健康管理等领域。

前期,VIPL实验室基于人脸的遥测式心率估计工作“Robust Remote Heart Rate Estimation from Face Utilizing Spatial-temporal Attention”( 作者:Xuesong Niu+, Xingyuan Zhao+, Hu Han, Abhijit Das, Antitza Dantcheva, Shiguang Shan, and Xilin Chen)在5月便已初露头角,荣获人脸与手势识别方向最有影响力的IEEE FG 2019最佳海报论文奖。

以下是入选论文详解:

RhythmNet: End-to-end Heart Rate Estimation from Face via Spatial-temporal Representation

(作者:Xuesong Niu, Shiguang Shan*, Hu Han, and Xilin Chen)

心率是人体最基础的一种生理信号之一,能反映人的身体健康状况甚至情绪状态。传统的心率测量通常依赖于接触式的传感器,比如较为精准的心电图以及便携式的指夹式心率仪等,这些方法心率估计的精度通常较好,但同时因为需要接触人体皮肤,限制了其使用的便利性。

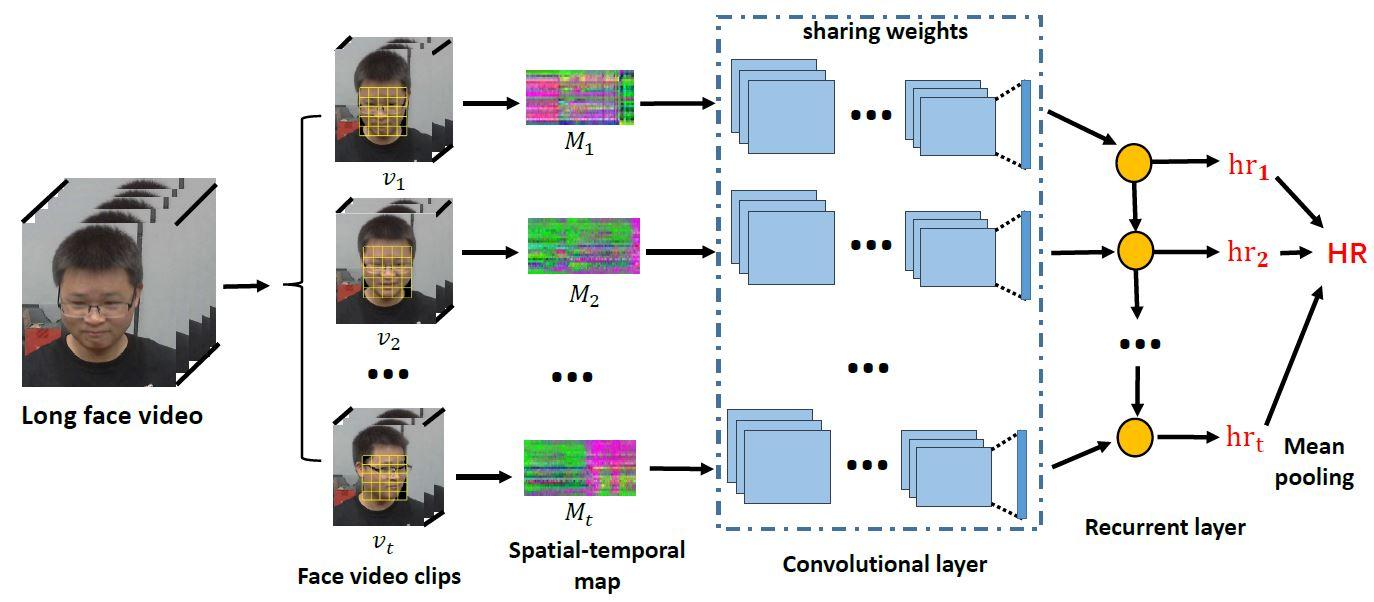

本文研究了基于rPPG原理的遥测式人脸视频心率估计方法RhythmNet。人脸视频中心率的视觉信号极其微弱,现有的端到端深度学习模型如CNN很难直接从原始人脸视频中学到真正与心率相关的特征表示,为此,我们提出了利用人脸视频时空上下文信息,先构建底层时空图(spatial-temporal map)将心率的视觉特征信号与大量背景信号有效地分离开来,进而通过CNN-RNN时空联合建模的方法,从时空图中进一步学习心率相关的高层特征表示,最终实现鲁棒的遥测式人脸视频心率估计。我们提出的RhythmNet方法,在业界多个公开数据库上都取得了最好的结果,并系统性地测试了方法在不同颜色空间、不同视频压缩率、不同光照环境以及不同模态(RGB vs. NIR)等条件下的稳定性。

此外,考虑到遥测式人脸视频心率估计领域公开的数据库较少,规模不大,采集场景单一等局限性,我们构建了包含头部运动、光照变化和不同传感器等多种变化的较大规模多模态人脸视频心率估计数据库VIPL-HR,并向业界公开供学术研究使用。

(申请下载链接:http://vipl.ict.ac.cn/view_database.php?id=15)

—END—