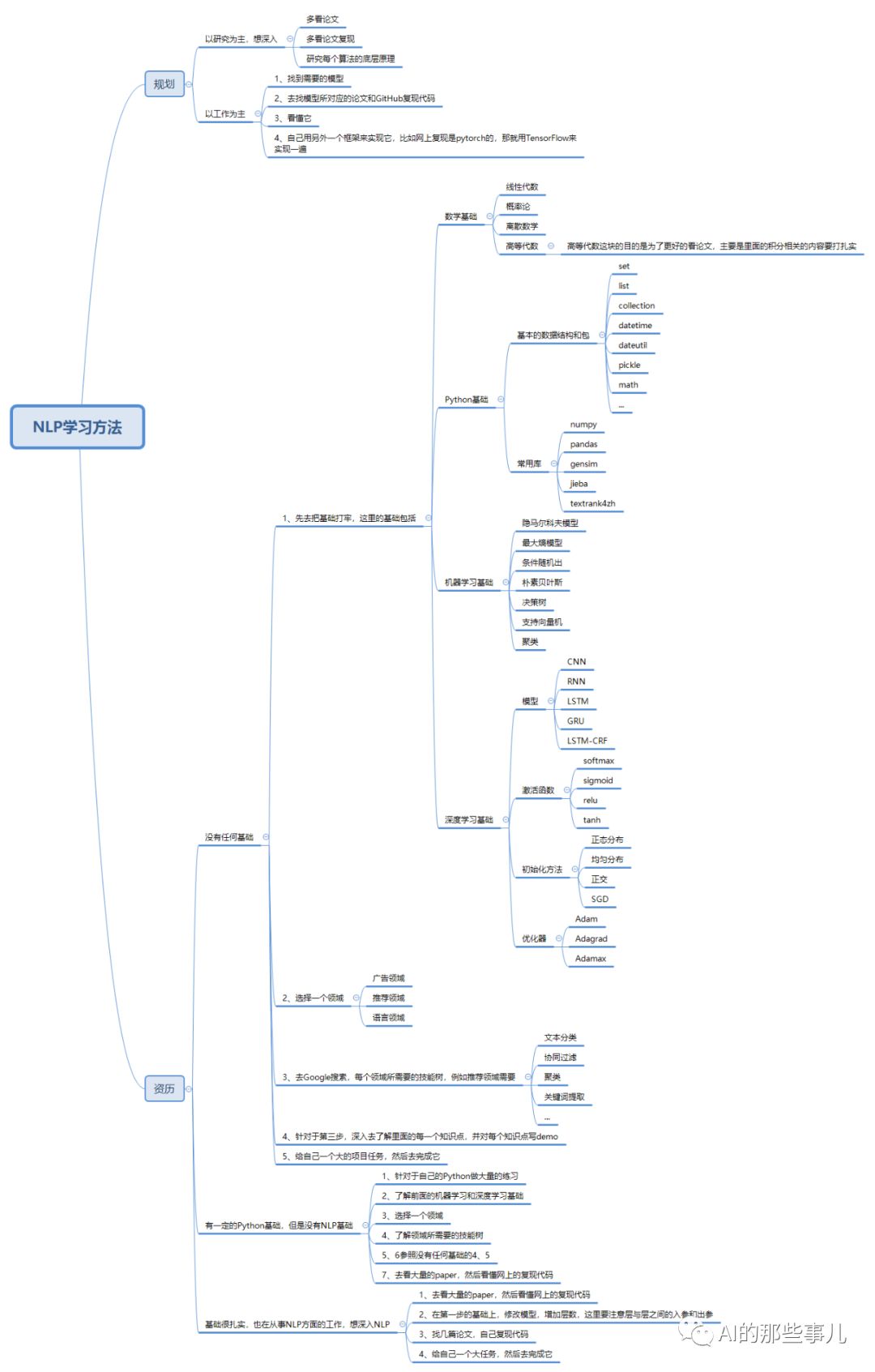

前辈总结 | NLP应该怎么学

最近几个月,有很多同学都私信我,问我NLP到底应该怎么学,这两天我就根据自己的经验,做了一个简单的总结,导图在手机上看着可能比较小,大家可以在电脑上看,或者保存到手机再放大。如果第一次刷进来没有图,后退重进就好了,可能是因为图太大了。

没有任何基础的同学

有一定Python基础,但是没有NLP基础

基础很扎实,也在从事NLP工作,想深入NLP

以研究为主,想深入

以工作为主

登录查看更多

相关内容

Arxiv

18+阅读 · 2020年3月10日