扩散模型数学太难?经典扩散模型DDPM手把手Pytorch代码实现,对照数学公式详解

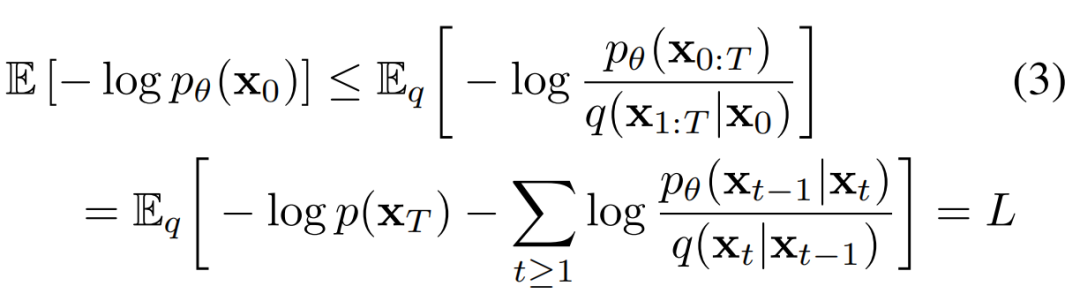

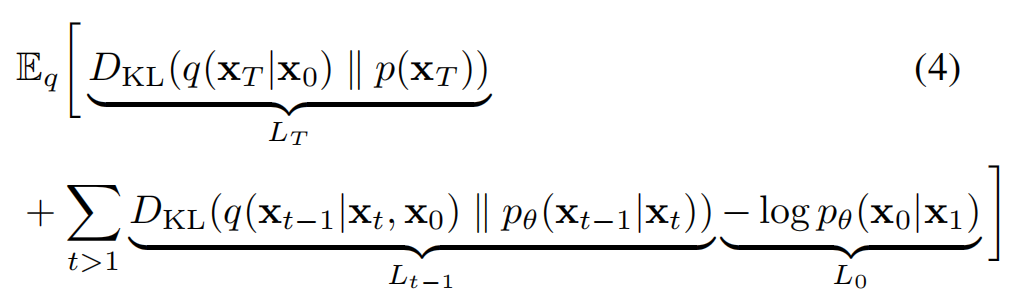

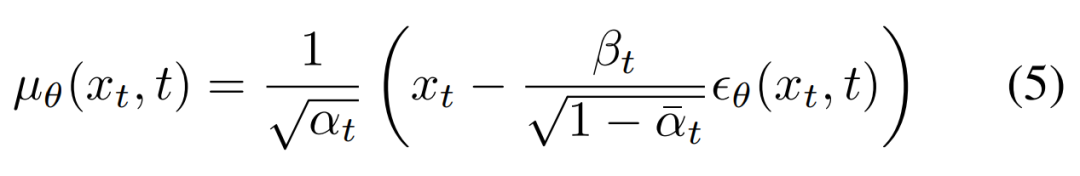

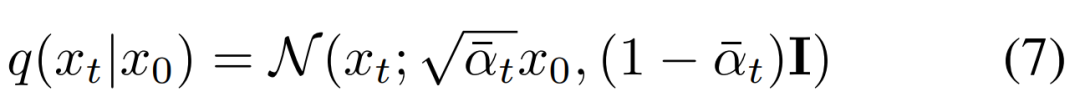

扩散模型是近年来快速发展并得到广泛关注的生成模型。它通过一系列的加噪和去噪过程,在复杂的图像分布和高斯分布之间建立联系,使得模型最终能将随机采样的高斯噪声逐步去噪得到一张图像。在生成效果上,扩散模型可以媲美广受欢迎的GAN的方法,并且相比GAN,扩散模型是基于最大似然的生成模型,在训练时不会遇到模式崩塌和不稳定的情况。此外GAN的discriminator的判别能力限制了GAN的生成多样性,而扩散模型的多样性更为丰富,并且在有条件生成任务中,由于扩散模型是从随机的噪声开始采样,即使对于同一张参考,扩散模型也可以给出理论上无限多的采样结果。这一特征在实际应用中颇为重要,目前已有不少工作将有条件生成的扩散模型运用在文字/分割图/简笔画到图像生成、图像编辑、超分辨率等任务中,取得不少成果。

https://nn.labml.ai/diffusion/ddpm/index.html

参照链接:

https://mp.weixin.qq.com/s/dFasa-A07AiV3cwvFW7OWA

附:CVPR 2022教程

英伟达&Google最新《基于扩散的去噪生成建模:基础与应用》教程,182页ppt带你学习高保真图像生成

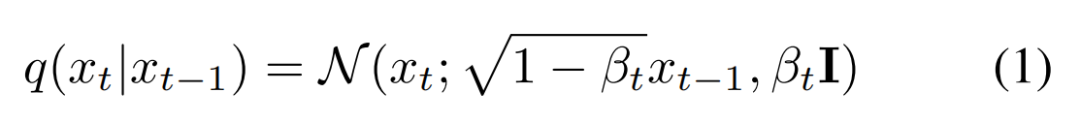

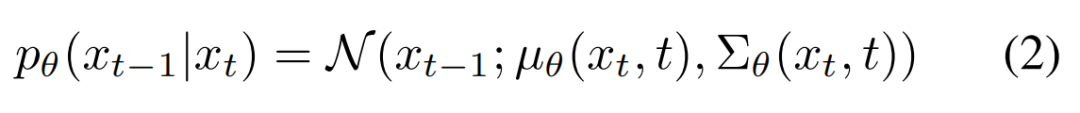

去噪扩散模型,也被称为基于分数的生成模型,是最近出现的一个强大的生成模型类别。它们在高保真图像生成方面表现出惊人的结果,甚至常常超过生成对抗网络。重要的是,它们还提供了较强的样本多样性和对已学习数据分布的保真模式覆盖。这意味着去噪扩散模型非常适合学习复杂多样的数据模型。去噪扩散模型定义了一个正向扩散过程,通过逐渐扰动输入数据将数据映射到噪声。数据生成是通过一个学习的、参数化的反向过程实现的,该过程执行迭代去噪,从纯随机噪声开始(见上图)。虽然扩散模型相对较新,但它们已经发现了许多成功的应用。例如,它们已经在计算机视觉中用于图像编辑、可控、语义和文本驱动的图像合成、图像到图像的翻译、超分辨率、图像分割以及三维形状生成和完成。

在本教程中,我们介绍了去噪扩散模型的基础,包括他们的离散步骤的公式以及他们的基于微分方程的描述。我们还讨论了与实践者相关的实际实施细节,并强调了与其他现有生成模型的联系,从而将去噪扩散模型置于更广泛的背景中。此外,我们回顾了近年来加速采样、条件生成等方面的技术扩展和先进方法。采样速度慢一直是扩散模型去噪的主要缺点。然而,已经出现了许多有希望克服这一挑战的技术。最近去噪扩散模型在高分辨率条件生成任务中也取得了惊人的进展,例如文本到图像的生成,我们讨论了实现这一目标的几个关键的先进技术。为了展示去噪扩散模型如何适合视觉用例,我们也回顾了在计算机视觉中的成功应用。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“DDPM” 就可以获取《扩散模型数学太难?经典扩散模型DDPM手把手Pytorch代码实现,对照数学公式详解》专知下载链接