CSIG云上微表情第十三期研讨会成功举办--实时微表情识别的低成本CNN网络

微表情是一种短暂的、微弱的、无意识的面部微表情,持续时间往往在0.5s内,能够揭示人类试图隐藏的真实情绪。微表情识别的研究旨在让机器有足够的智能,能够从人脸视频序列中识别人类的真实情绪。然而由于微表情持续时间短、面部肌肉运动强度低,对其进行准确的表征与识别是一项极具挑战性的任务。为了促进心理学领域和计算机视觉领域针对微表情的进一步研究,由中国图象图形学学会(CSIG)主办、CSIG机器视觉专业委员会承办,中国科学院心理研究所的王甦菁博士组织了一系列云上微表情的学术活动。

第十三期云上微表情于2021年3月1日晚上8点进行,由中国科学院心理研究所王甦菁老师团队的李婧婷博士主持。此次讲座邀请到来自法国勃艮第大学ImViA实验室的由杨帆教授指导的博士生Reda BELAICHE来做主题为实时微表情识别的低成本 CNN网络的相关报告,报告得到了微表情研究领域的广泛关注,期间有五十多位听众参加了此次讲座。

在简要展示了法国勃艮第大学和其所在城市第戎之后,Reda主要介绍了他构建用于实时微表情识别的低成本CNN的探索过程。

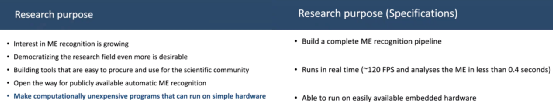

基于微表情和微表情识别的研究现状,Reda介绍了他们的研究目的,即设计一个计算性能良好和低成本的、并可以在简单硬件上运行的微表情识别系统。

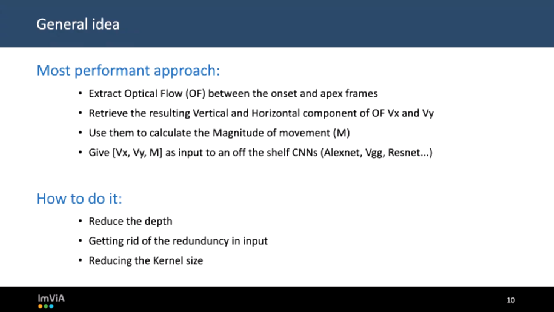

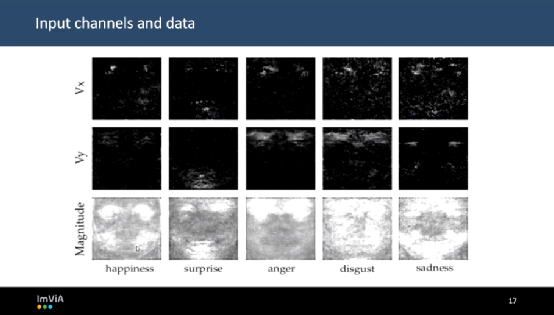

Reda使用了由中国科学院心理研究所发布的CASME II和由英国曼彻斯特城市大学发布的SAMM数据库,一方面是因为这两个数据库包含有较多的被标注的起始/峰值帧的微表情样本;另一方面,微表情挑战赛MEGC2018和MEGC2019都使用了这两个数据设置微表情识别的挑战任务,因此可以更好地比较方法性能。同时,由于微表情是一个低强度面部动作,Reda选择光流作为高级特征输入到网络中。

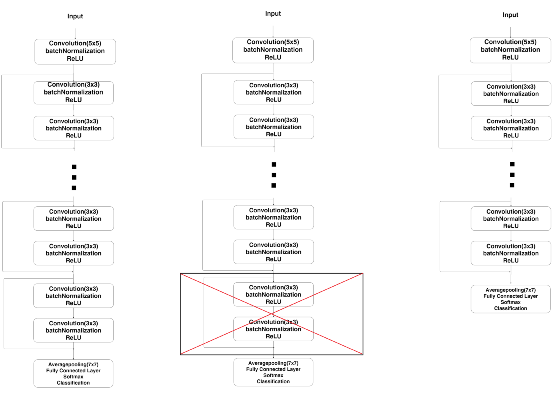

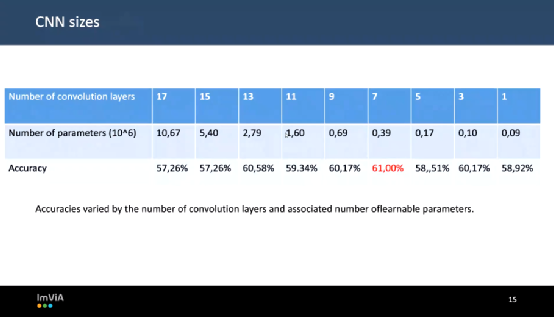

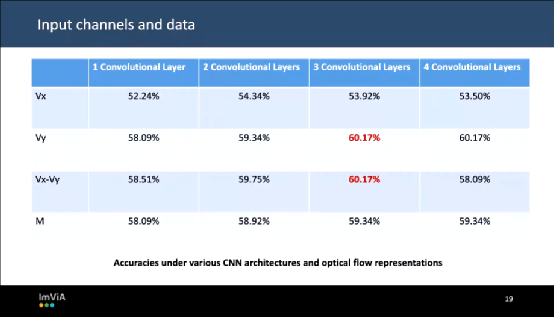

Reda通过提取光流特征(ux,uy)和其幅值M,并将其输入到现成的CNN网络结构中实现微表情识别的功能。为了实现高计算性能和低成本的设计目的,Reda主要进行了降低网络深度、减少输入特征冗余度和减少卷积核尺寸的尝试。

此外,Reda还进行了大量的实验,验证了他们所提方法在五种情绪分类上都得到了较为平均的识别性能,并与目前主流的识别方法进行了比较。

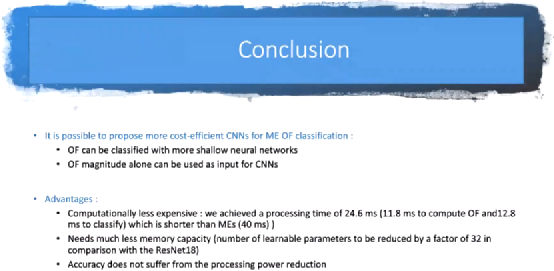

最后,Reda总结了他们所提方法的优点,即对一个微表情视频片段进行识别分类只需要24.6毫秒(小于最短微表情的发生时间)。同时,他们的CNN设计适用于内存和计算资源有限的实时嵌入式应用。此外,Reda将在未来尝试集成微表情检测技术,并在硬件上实现自动化微表情分析的功能。

此次讲座的回放已经发布在B站:https://www.bilibili.com/video/BV1GK4y1D7Bg,欢迎观看!