角逐最强图神经网络!第二届OGB-LSC@NeurIPS 2022开赛!

OGB-LSC 2022

2021 年,由斯坦福、清华等组成的 OGB 团队在 KDD Cup 2021 开展了一个大规模图机器学习的开放比赛,即 OGB 大规模图机器学习挑战赛(OGB-LSC),以鼓励开发适用于大规模图数据集的最新图机器学习和深度学习模型。经过全球 500 多个顶尖高校、企业和研究实验室的激烈竞争,百度凭借飞桨图学习框架 PGL 一路过关斩将,最终在全部三个赛道包揽了两冠一亚,微软亚洲研究院获得一项冠军,DeepMind 获得一亚一季。

在今年的 NeurIPS 2022,OGB 团队围绕 OGB-LSC 数据集组织了第二届 OGB-LSC 大规模图机器学习挑战赛。重要的是,组织方根据从 KDD Cup 2021 中吸取的经验,更新了部分数据集,从而使该年大赛的图数据集更具挑战性和现实性。

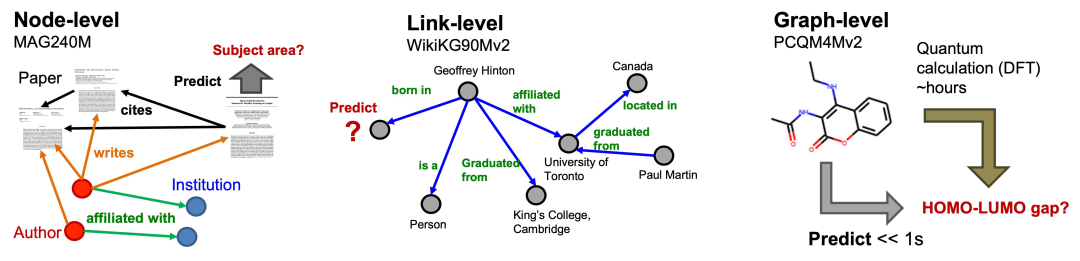

OGB-LSC 2022 提供了三个规模空前的图数据集,分别涵盖了节点、链接和整图级别的预测任务。下面提供了三个 OGB-LSC 图数据集的说明性概述。

· MAG240M is a heterogeneous academic graph, and the task is to predict the subject areas of papers situated in the heterogeneous graph (node classification).

· WikiKG90Mv2 is a knowledge graph, and the task is to impute missing triplets (link prediction).

· PCQM4Mv2 is a quantum chemistry dataset, and the task is to predict an important molecular property, the HOMO-LUMO gap, of a given molecule (graph regression).

其中数据集包含两种测试集:test-dev 和 test-challenge。此次 NeurIPS 挑战赛将使用 test-challenge 来进行结果评测。test-dev 则用于全年的公开排行榜的评测

(https://ogb.stanford.edu/docs/lsc/leaderboards/)

具体的 OGB-LSC 大赛资料请见:

https://ogb.stanford.edu/neurips2022/。

SUMMER COMING

· 所有截止日期均为太平洋夏令时间晚上 11:59。

· 所有数据集共享相同的截止日期。

2022 年 5 月 24 日:OGB-LSC 2022 开始

比赛开始、开放团队注册。欢迎参加比赛!

2022 年 9 月 2 日:团队报名截止

每个团队都必须注册才能有资格参加后续的测试提交。

2022 年 11 月 1 日:Test-challenge提交截止

每个团队提交其最终测试预测,将根据 test-challenge 数据进行评估。

2022 年 11 月 4 日:获奖者通知

组织方会单独通知 NeurIPS 2022 OGB-LSC 大规模图机器学习挑战赛的获胜者,包括每个数据集的前 3 名获奖者(共 9 名获奖者)。

2022 年 11 月 25 日:获奖者提交代码和报告

获奖者在提供公开的 GitHub 代码和技术报告后确定。

2022 年 11 月 30 日:获奖者公告

获奖者连同他们的代码和技术报告一起公开宣布。

OGB-LSC 团队和联系方式

团队邮箱:ogb-lsc@cs.stanford.edu。

有关数据集的讨论或一般问题,请使用OGB的Github Discussions(https://github.com/snap-stanford/ogb/discussions)。

有关代码的问题,请使用OGB的 Github issues:

https://github.com/snap-stanford/ogb/issues。

订阅OGB的Google group:

https://groups.google.com/g/open-graph-benchmark

让您随时了解 OGB 的任何更改和更新。

更多详情信息,可访问(或点击文末【阅读原文】)以下链接查看:

https://ogb.stanford.edu/neurips2022/