【CVPR2021】基于时序上下文聚合的动作提名修正网络

时序动作提名生成旨在从一段未修剪的长视频当中生成包含可能存在人类动作的视频片段,其结合具体的动作类别标签即构成时序动作检测任务。目前的方法大多致力于生成灵活准确的时序边界与可靠的提名置信度,但是仍然受限于匮乏的视频时序依赖和动作边界建模,导致了充满噪声的候选提名边界和质量欠佳的置信度分数。

目前主流的时序动作提名生成方法主要分为两步,首先对输入的视频特征序列进行简单的时序信息融合,然后使用基于边界预测的方法或者是基于预定义锚点框回归的方法生成可能包含人体动作的大量候选时序提名。

https://www.zhuanzhi.ai/paper/e551d60b61b78e5324762d4cff4bff29

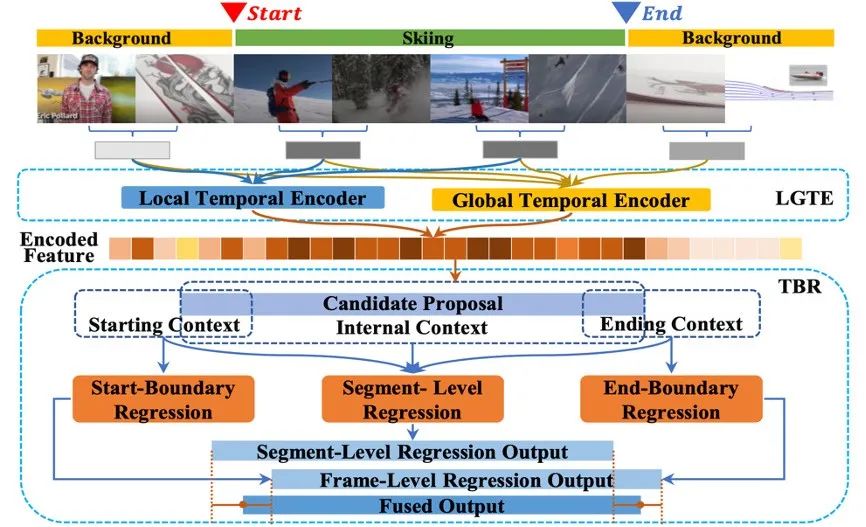

本文提出了一个用于时序动作提名修正的端到端框架。该方法主要针对现有主流时序动作提名生成方法中的两步骤分别进行改进:

1. 在第一步中,现有方法大多使用堆叠的1D时序卷积进行简单的时序信息融合,然而,1D卷积在计算不同时序点之间的位置关系时,受限于卷积核的形状和尺寸,虽然可以较好地建模短期的时序依赖,但是对于灵活多变的上下文关系则望尘莫及。部分办法选择了全局融合的方式实现了对全局特征的捕获,但是直接使用全局池化之后的特征拼接到整个视频特征序列上的每一个时刻位置,导致每一个时刻获得的全局信息都是相同的,由此捕获的时序依赖关系相对固定,缺乏多样性和区分度,无法充分建模多样的长时序依赖关系。

2. 在第二步中,基于预定义锚点框回归的方法可以提供基于提名全局特征的可靠置信度分数,然而直接使用提名的全局特征对于其局部边界的准确位置不够敏感,况且预定义尺度和比例的提名时序长度往往非常受限,不够灵活,无法生成任意长度的候选提名。基于边界预测的方法利用边界的局部特征判断一个时间点是否属于动作边界,对动作的起止边缘比较敏感,并且使用边界匹配机制来生成大量灵活的动作提名,获得较高的召回率。由于缺乏客观的提名特征,其置信度不够可靠,导致其准确率较低。

参考链接:

https://mp.weixin.qq.com/s/2ztaALqJKeuViAmk6Ll6jA

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“TAPR” 就可以获取《【CVPR2021】基于时序上下文聚合的动作提名修正网络》专知下载链接