【重磅】牛津大学发布111页《人工智能: 美国人的态度和趋势》报告,了解最新AI在公众的舆论情绪(附下载)

【导读】最近牛津大学人类未来研究所人工智能管理中心的学者Baobao Zhang和Allan Dafoe发布了一份111页的报告,名为《人工智能:美国人的态度和趋势》,详细阐述美国公众对人工智能和人工智能治理的看法,是对于研究人工智能在社会公众影响的重要资料。

https://governanceai.github.io/US-Public-Opinion-Report-Jan-2019/

《人工智能: 美国人的态度和趋势》报告下载

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知)

后台回复“AIAT” 就可以获取《人工智能:美国人的态度和趋势》的下载链接~

专知2019年1月开设《深度学习:算法到实战》课程,正在开讲,欢迎关注报名!

人工智能: 美国人的态度和趋势

执行摘要

人工智能(AI)的进步几乎可以影响社会的方方面面:劳动力市场,交通,医疗保健,教育和国家安全。人工智能的影响可以是非常积极的,但这项技术带来的风险和阻断值得关注。尽管技术专家和政策制定者开始更频繁地讨论人工智能和机器学习的应用,但公众舆论并未对这些对话产生多大影响。在美国,公众的情绪会形成对许多政策的辩论探讨,包括移民,自由贸易,国际冲突和减缓气候变化的辩论。正如在其他政策领域一样,我们预计随着时间的推移,公众的影响力会越来越大。因此,更好地了解公众对人工智能和人工智能治理的看法至关重要。这种理解对于管理者制定明智的政策和确定机会向公众宣传人工智能的特征,利益和风险是至关重要的。

在这份报告中,我们展示了美国公众对人工智能和人工智能治理态度的广泛调查结果。由于对人工智能的公众舆论的研究相对较新,我们的目标是广度而非深度,我们的问题涉及:工作场所自动化;对国际合作的态度; 公众对发展和规管人工智能的不同角色的信任;关于不同人工智能治理挑战的重要性和可能影响的观点;以及关于人工智能的历史和跨国舆论趋势。我们的研究结果为了解美国公众对人工智能的看法提供了初步的见解。然而,我们的结果提出的问题比他们回答的要多并且是更具启发性的。因此,我们建议在解释结果时要谨慎; 我们只报道结果。要深入了解公众对人工智能的看法,还需要做更多的工作。

在AI伦理与治理基金的资助下,我们计划在未来几年进行更广泛和深入的调查,包括欧洲、中国和其他国家的居民。我们欢迎合作者,特别是在特定政策领域的专家,参与未来的调查。调查查询可以通过电子邮件发送至survey@governance.ai。

这份报告基于一项具有全国代表性的调查结果,该调查是由牛津大学人类未来研究所人工智能管理中心(Center for the Governance of AI)利用调查公司YouGov进行的。该调查于2018年6月6日至14日进行,共有2,000名美国成年人(18岁以上)完成了调查。该调查的分析已在开放科学框架(Open Science Framework)中预先登记。附录A提供了有关数据收集和分析过程的更多详细信息。

选择结果

下面我们重点介绍一些调查结果:

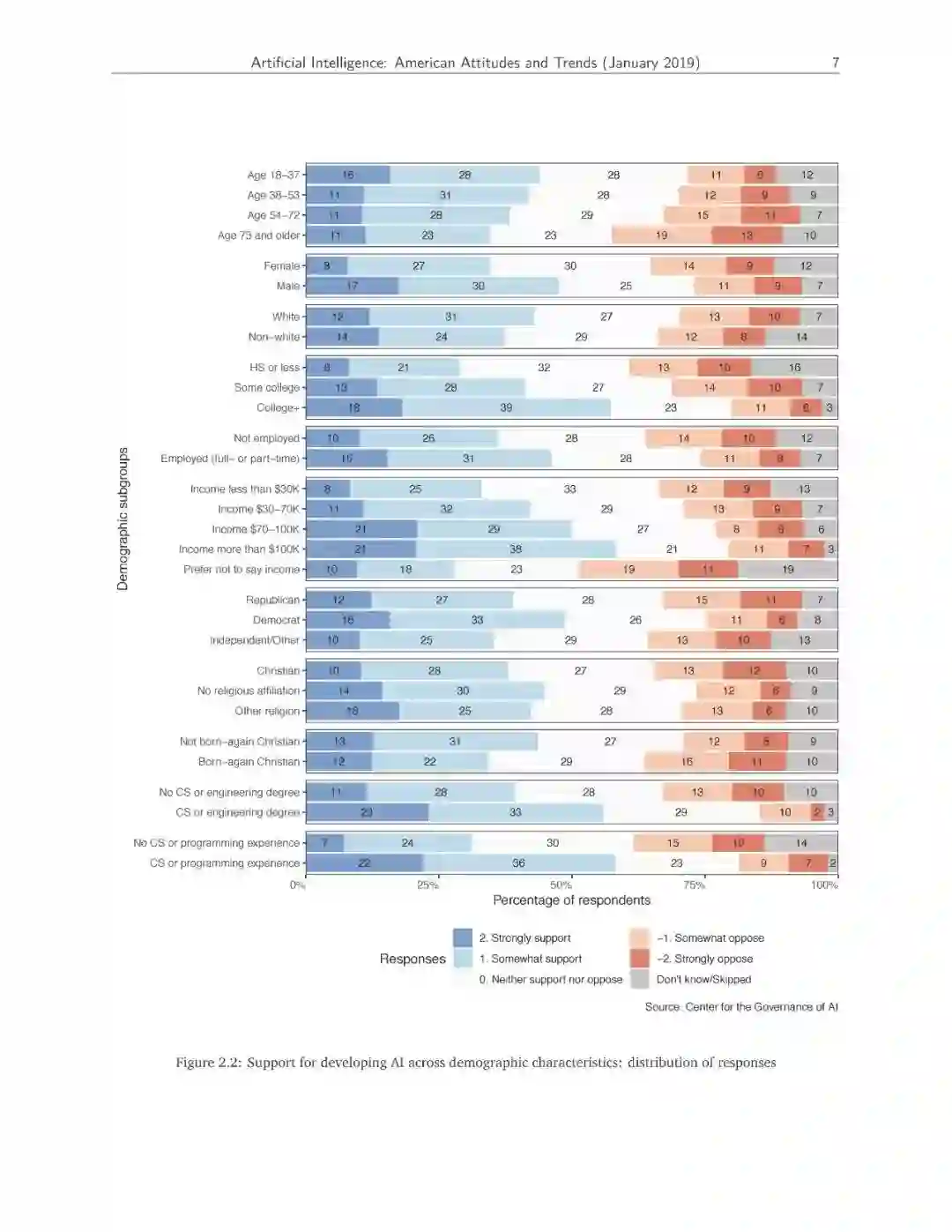

- 美国人对人工智能的发展表示了不同的支持。在阅读简短的解释之后,相当一部分人(41%)在某种程度上支持或强烈支持AI的发展,而较小的少数群体(22%)在某种程度上或强烈地反对人工智能的发展。

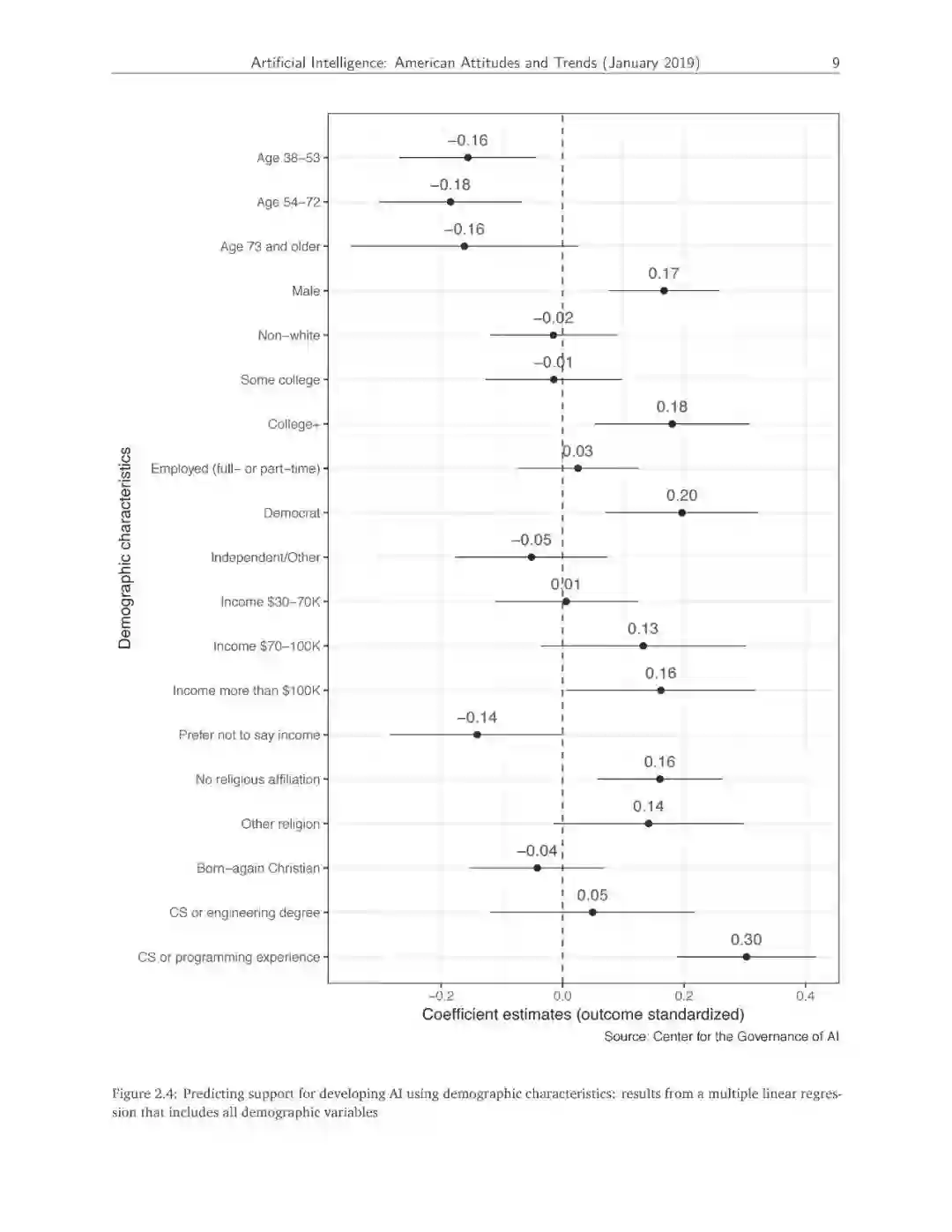

- 人口特征在支持发展人工智能方面有很大差异。大学毕业生(57%)比高中或受教育程度低的人(29%)表达了对发展人工智能的更多支持; 报告中家庭收入较多的人,例如每年收入超过10万美元(59%)的人,比收入低于30,000美元(33%)更支持;具有计算机科学或编程经验的人(58%)比那些没有这方面经验(31%)的人更支持;男性(47%)比女性(35%)更支持。这些差异不容易用其他特征来解释(它们对我们的多元回归是健壮的)。

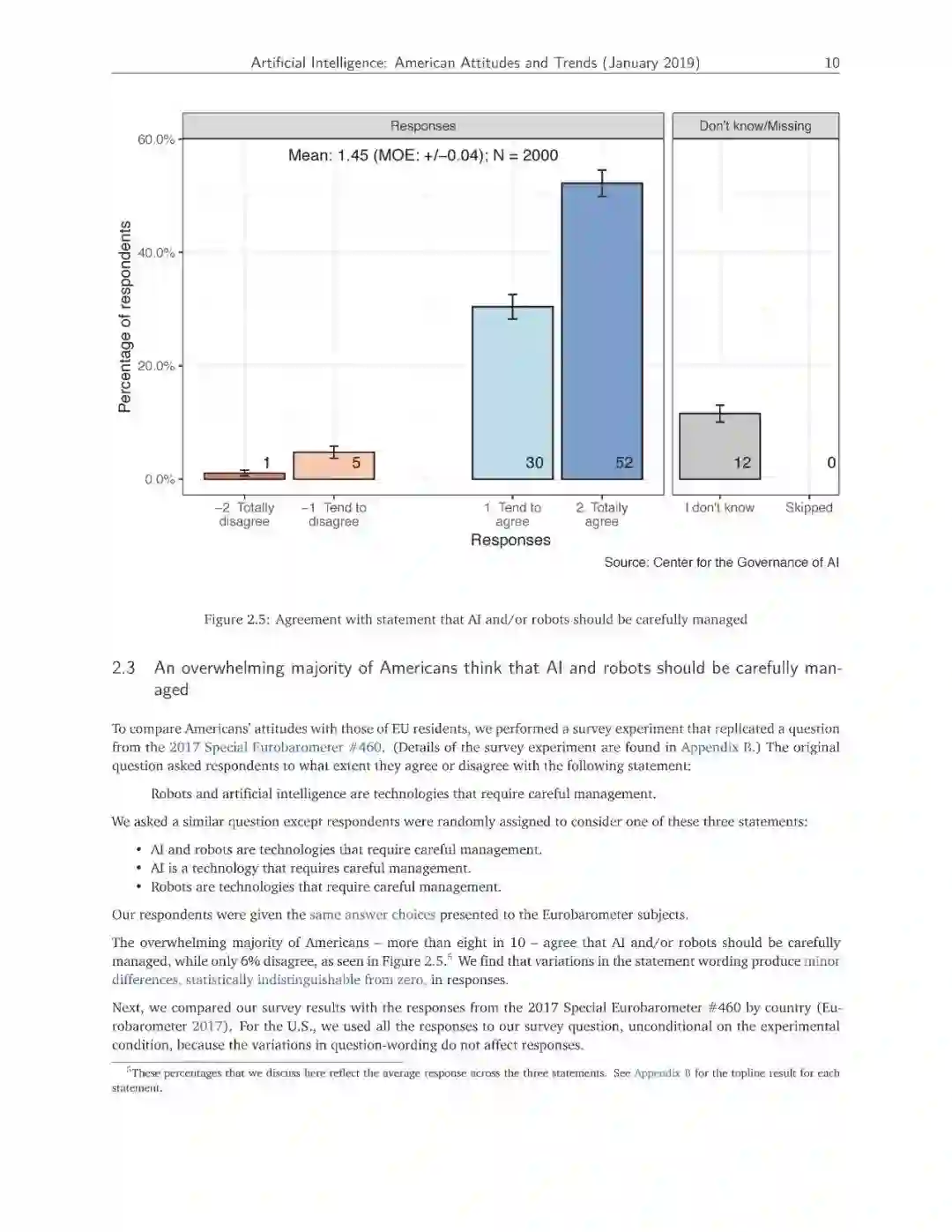

- 绝大多数美国人(82%)认为应该谨慎管理机器人和/或人工智能。这一数字与欧盟受访者的调查结果相当。

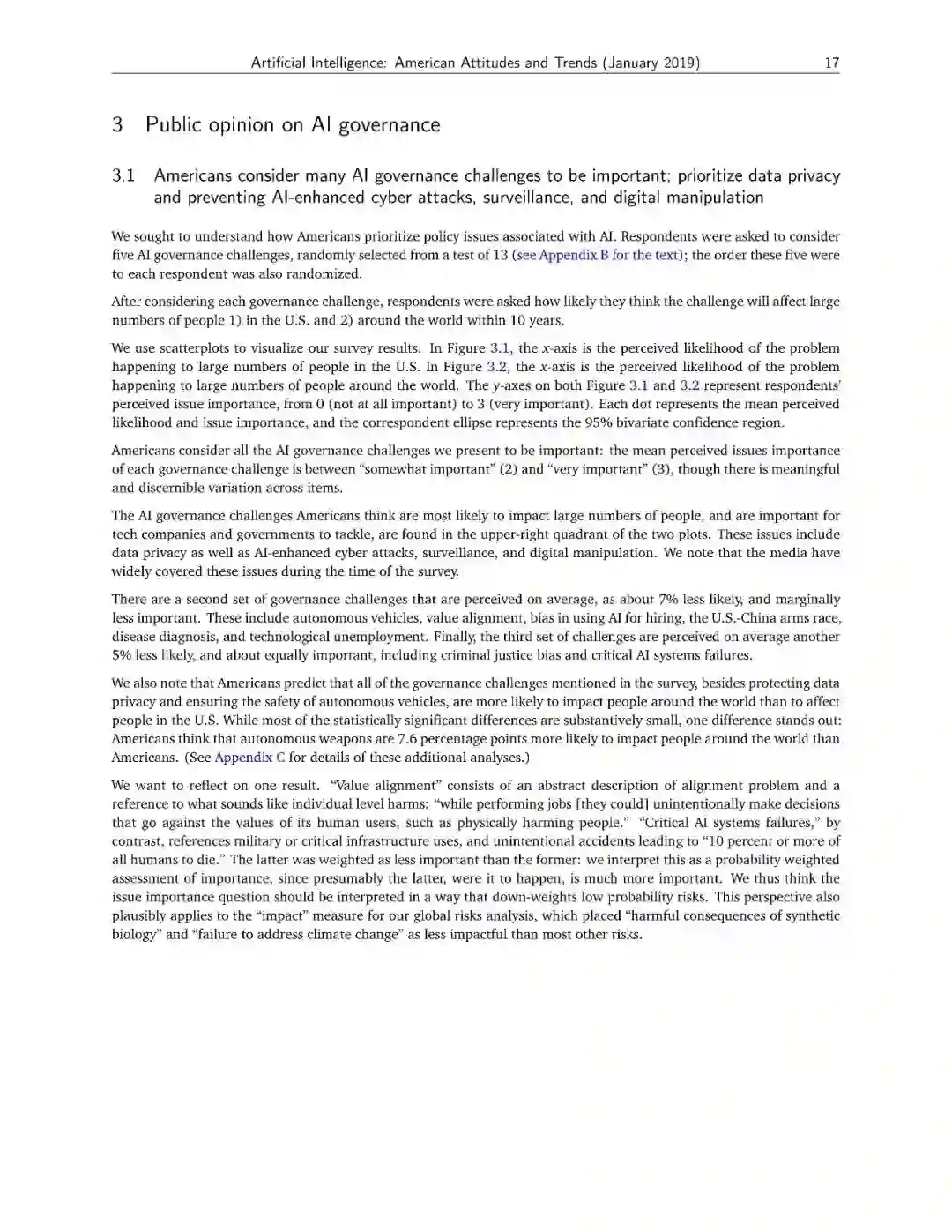

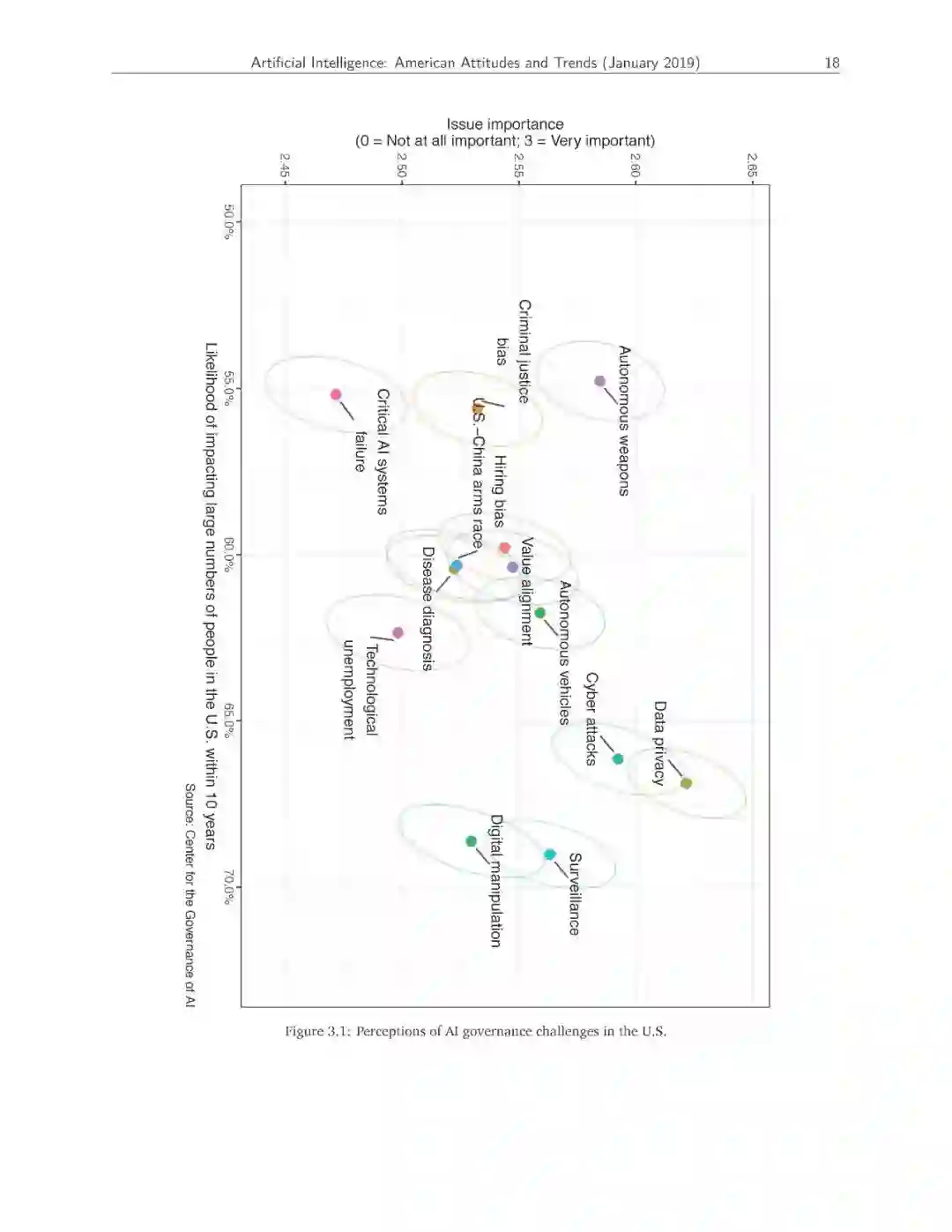

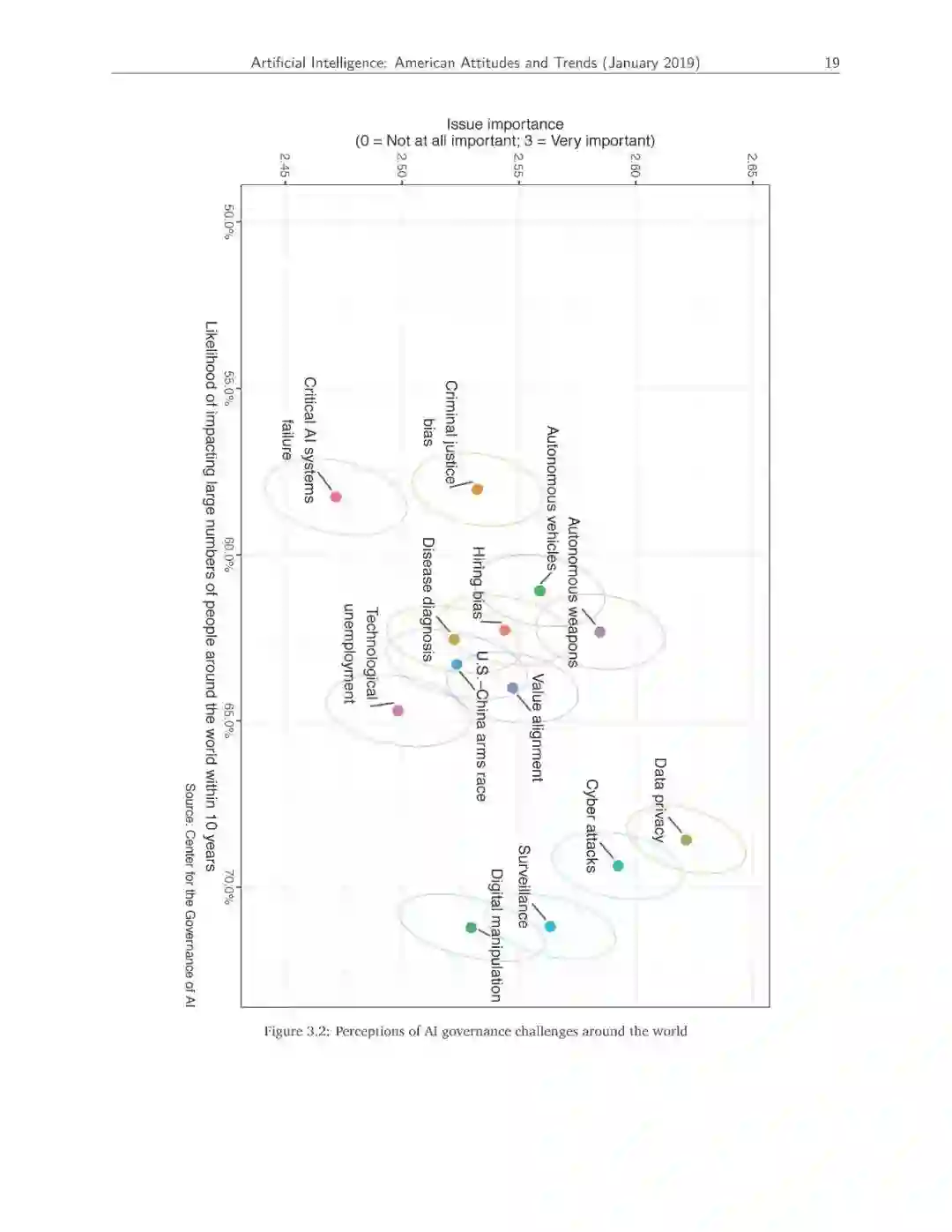

- 美国人认为,在调查中提出的13项人工智能治理挑战中,政府和科技公司都需要认真管理。被认为在未来10年内最有可能影响全世界人民并在问题重要性方面排名最高的治理挑战包括::

1.防止人工智能辅助监视侵犯隐私和公民自由

2.防止人工智能被用于在线传播虚假和有害内容

3.防止针对政府,公司,组织和个人的人工智能网络攻击

4.保护数据隐私

- 我们也提出了上述问题,但重点关注的是治理挑战可能仅影响美国人(而不是世界各地的人)。美国人认为,除了保护数据隐私和确保自动驾驶汽车的安全之外,所有这些治理挑战在未来10年内对世界各地人民产生影响的可能性略高于对美国人产生影响的可能性。

- 美国人对为公众的最大利益开发和管理人工智能的各种组织有着明显不同程度的信任。从广义上讲,公众对大学研究人员最为信任(50%的人表示“相当大的信心”或“很大的信心”)和美国军方(49%);其次是科学组织,人工智能合作伙伴关系,技术公司(不包括Facebook)和情报组织;再其次是美国联邦或州政府以及联合国;最后是Facebook。

- 对于美国加大对人工智能军事能力的投资,以及与中国合作避免人工智能军备竞赛的危险,美国人的支持褒贬不一。向受访者提供有关中美AI军备竞赛风险的信息,略微降低了对美国在人工智能军事能力方面投入更多资金的支持。提供亲民主义信息或关于人工智能对人类的威胁的信息未能影响美国人的政策偏好。

- 一些受访者预测,到2028年,高级机器智能开发的几率为54%。我们将高级机器智能定义为,当机器能够执行几乎所有与经济相关的任务时,它们在每项任务上的表现都优于(当今的)人类平均水平。有关详细定义,请参阅附录B.

- 美国人对发展高水平机器智能的支持力度较弱:31%的美国人支持,27%的人反对。

- 人口特征在支持开发高级机器智能方面存在很大差异。报告中家庭收入较多的人,例如每年收入超过10万美元(47%)的人比收入低于30,000美元(24%)的人表现出更多地支持;具有计算机科学或编程经验的人(45%)比没有计算机科学或编程经验的人(23%)更支持;男性(39%)比女性(25%)更支持。这些差异不容易用其他特征来解释(它们对我们的多元回归是健壮的)。

- 更多的美国人认为高水平的机器智能是有害的,而不是对人类有益的。22%的人认为这项技术“总的来说很糟糕”,12%的人认为它“非常糟糕”,可能导致人类灭绝。尽管如此,仍有21%的人认为“总的来说是好的”,5%的人认为“非常好”。

目录

-END-

专 · 知

专知《深度学习: 算法到实战》课程正在开讲! 中科院博士为你讲授!

请加专知小助手微信(扫一扫如下二维码添加),咨询《深度学习:算法到实战》参团限时优惠报名~

欢迎微信扫一扫加入专知人工智能知识星球群,获取专业知识教程视频资料和与专家交流咨询!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程