京东薄列峰:安全的纵向联邦学习框架 | CCF-GAIR 2020

编辑 | 陈彩娴

1

联邦学习的背景

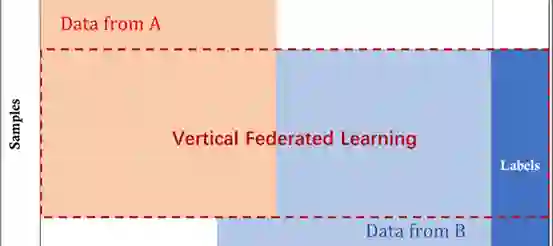

2

纵向联邦学习

3

快速学习的联邦学习框架

4

区块链联邦学习

登录查看更多

相关内容

Arxiv

11+阅读 · 2020年2月18日