【泡泡一分钟】RNFNet: 用于室内语义分割的RGB-D多层级残差特征融合(ICCV2017-523)

每天一分钟,带你读遍机器人顶级会议文章

标题:RNFNet: RBG-D Multi-level Residual Feature Fusion for Indoor Semantic Segmentation

作者:Seong-Jin Park, Ki-Sang Hong, Seungyong Lee

来源:ICCV 2017 ( IEEE International Conference on Computer Vision)

编译:杨雨生

审核:颜青松 陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

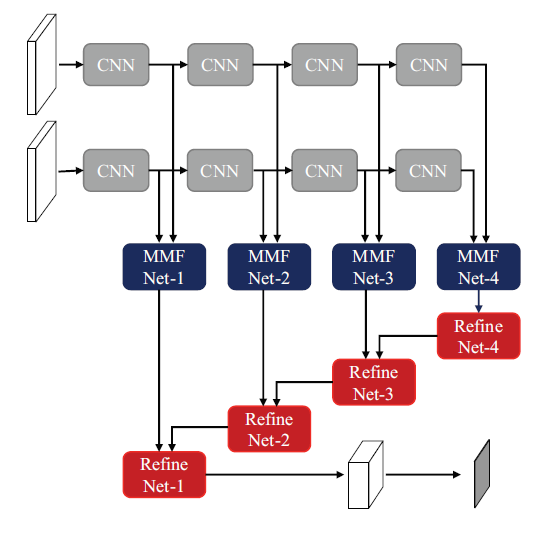

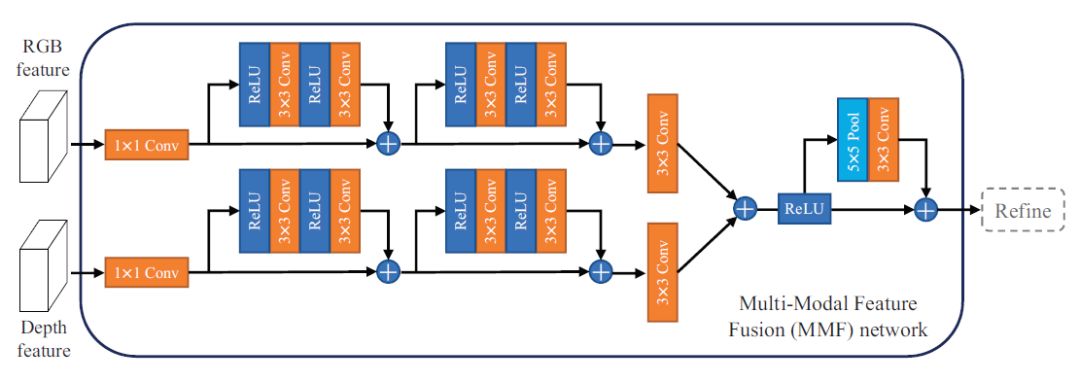

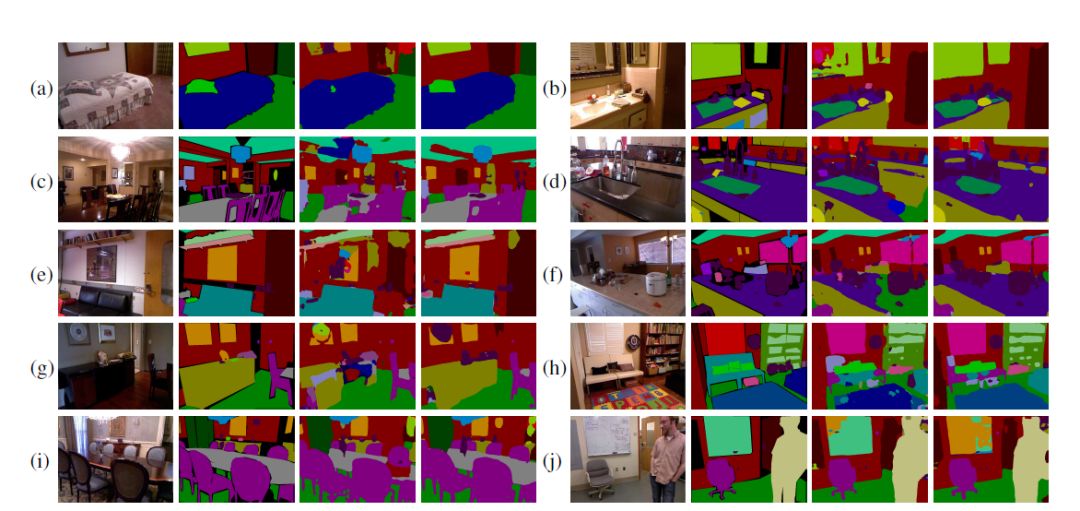

在使用RGB-D数据的多类别室内语义分割中,已经表明将深度特征结合到RGB特征中有助于提高分割的精度。然而,之前的研究没有充分利用多模态特征融合的潜力,比如他们只是简单地将RGB特征和深度特征连接起来,或者平均RGB和深度得分图。为了找到多模态特征的最优融合,作者提出了一种新的网络,将残差学习的核心思想拓展到RGB-D语义分割领域。作者的神经网络通过包含多模态特征融合block和多层级特征细化block,能过有效地提取RGB-D CNN特征。特征融合block通过学习RGB残差和深度特征及其之间的组合,来充分利用RGB数据和深度数据之间的互补特性。特征细化block通过学习来自多个层级的融合特征的组合,来实现高分辨率的预测。作者的神经网络通过充分利用skip-connections,可以从端对端的每种模态中有效的训练出有辨别力的多层级特征。作者的综合实验表明,其所提出的架构在两个具有挑战性的数据集中可以实现很好的精度,这两个数据集是NYUDv2和SUN RGB-D数据集。

图1. 上图是作者提出的网络RDFNet的架构

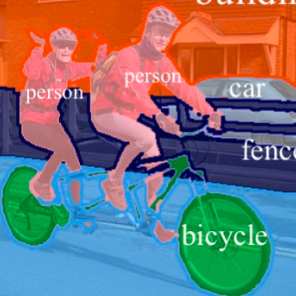

图2. 上图是作者在数据集上的实验结果,最右侧的是作者的结果.

Abstract

In multi-class indoor semantic segmentation using RGB-D data, it has been shown that incorporating depth feature into RGB feature is helpful to improve segmentation accuracy. However, previous studies have not fully exploited the potentials of multi-modal feature fusion, e.g., simply concatenating RGB and depth features or averaging RGB and depth score maps. To learn the optimal fusion of multimodal features, this paper presents a novel network that extends the core idea of residual learning to RGB-D semantic segmentation. Our network effectively captures multilevel RGB-D CNN features by including multi-modal feature fusion blocks and multi-level feature refinement blocks. Feature fusion blocks learn residual RGB and depth features and their combinations to fully exploit the complementary characteristics of RGB and depth data. Feature refinement blocks learn the combination of fused features from multiple levels to enable high-resolution prediction. Our network can efficiently train discriminative multi-level features from each modality end-to-end by taking full advantage of skip-connections. Our comprehensive experiments demonstrate that the proposed architecture achieves the state-of-the-art accuracy on two challenging RGB-D indoor datasets, NYUDv2 and SUN RGB-D.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com