【泡泡一分钟】基于注意力机制的深度网络HydraPlus-Net(ICCV2017-34)

每天一分钟,带你读遍机器人顶级会议文章

标题:HydraPlus-Net:Attentive Deep Features for Pedestrian Analysis

作者:Xihui Liu, Haiyu Zhao,Jing Shao等

来源:International Conference on Computer Vision (ICCV 2017)

播音员:阿晨

编译:陈世浪 周平(37)

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

行人分析在智能视频监控中扮演着重要角色,是以安全为中心的计算机视觉系统的关键组成部分。尽管卷积神经网络在识别图像的鉴别特征方面非常出色,但对行人进行细粒度任务的综合特征的学习仍然是亟待解决的问题。

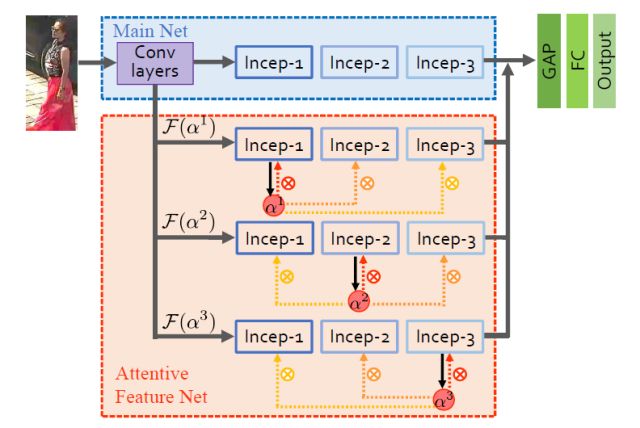

在本研究中,作者提出了一种新的基于注意力的深度神经网络,它被命名为HydraPlus-Net (HPnet),这种网络将不同层级的注意力映射到不同的特征层。作者提出的HP-net中得到的细心的深层特征带来了独特的优势;(1)该模型能够从低层次到语义层次捕获多个关注;(2)探索了关注特性的多尺度选择性,丰富了行人图像的最终特征表示。

作者证明了HP-net有效性和普遍性,在行人属性识别和人重新鉴定两项任务中进行了行人分析。同时提供了强大的实验结果来证明HP-net在各种数据集上的性能优于现有的方法。

图1 网络结构示意图

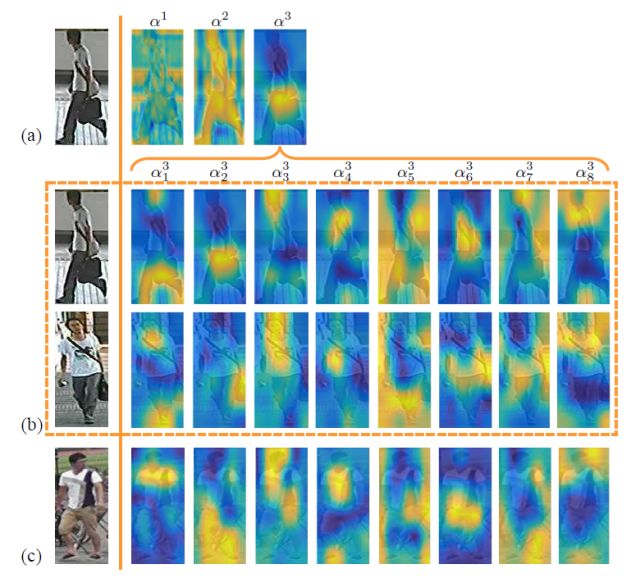

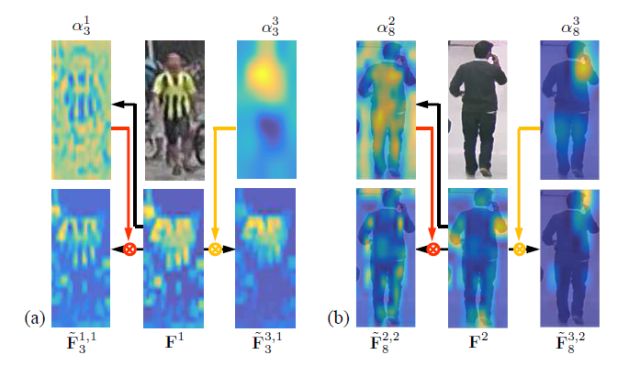

图2 行人不同位置显示的语义图

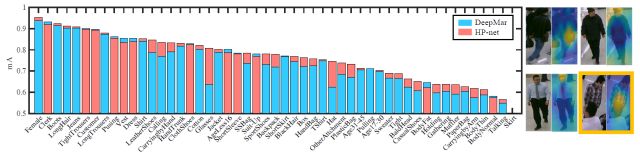

图3 行人不同的特征的语义识别率对比图

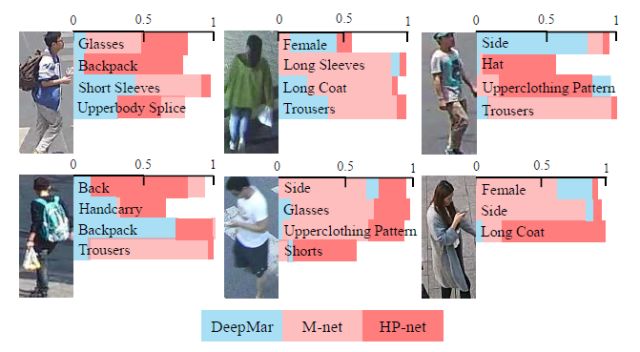

图4 行人属性实验结果

图5 高层特征与底层特征提取信息的区别

Abstract

Pedestrian analysis plays a vital role in intelligent video surveillance and is a key component for security-centric computer vision systems. Despite that the convolutional neural networks are remarkable in learning discriminative features from images, the learning of comprehensive features of pedestrians for fine-grained tasks remains an open problem. In this study, we propose a new attentionbased deep neural network, named as HydraPlus-Net (HPnet), that multi-directionally feeds the multi-level attention maps to different feature layers. The attentive deep features learned from the proposed HP-net bring unique advantages: (1) the model is capable of capturing multiple attentions from low-level to semantic-level, and (2) it explores the multi-scale selectiveness of attentive features to enrich the final feature representations for a pedestrian image. We demonstrate the effectiveness and generality of the proposed HP-net for pedestrian analysis on two tasks, i.e. pedestrian attribute recognition and person reidentification. Intensive experimental results have been provided to prove that the HP-net outperforms the state-of-the-art methods on various datasets.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com