本文对中科院宗成庆、张家俊团队完成、被 AAAI-20 录用的口头报告论文《Synchronous Speech Recognition and Speech-to-Text Translation with Interactive Decoding》进行解读。

![]()

论文:https://arxiv.org/abs/1912.07240

语音翻译技术是指利用计算机实现从一种语言的语音到另外一种语言的语音或文本的自动翻译过程。该技术可以广泛应用于会议演讲、商业会谈、跨境客服、出国旅游等各个领域和场景,具有重要的研究价值和广阔的应用前景。

近年来,随着人工智能技术在语音、翻译等相关领域的蓬勃发展,语音翻译技术逐渐成为学术界和企业界竞相研究的热点。当前的语音翻译系统通常由语音识别、机器翻译和语音合成等多个模块串联组成,方法简单,但面临着噪声容错、断句标点、时间延迟等一系列技术难题。

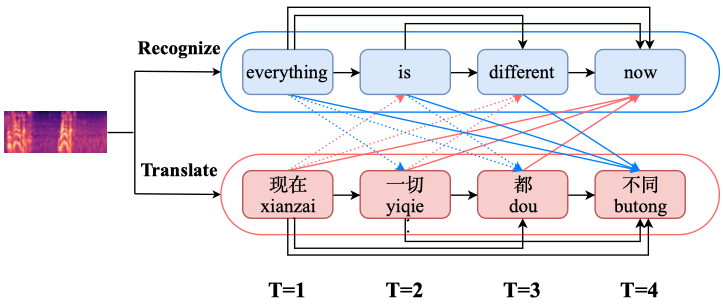

端到端的语音翻译模型在理论上可以缓解级联系统的缺陷,它通过直接建立源语言语音到目标语言文本的映射关系,一步实现跨模态跨语言的翻译,一旦技术成熟,理论上可以让语音翻译更准更快,极大地提升模型的性能。我们发现语音识别和语音翻译两个任务是相辅相成的。

![]()

相比于直接将原始语音作为输入,如果能够动态获取到识别出的文本信息,语音翻译将变得更加容易;而翻译出的结果也有助于同音词识别的消歧,使识别结果更加准确。因此,我们希望设计一种交互式的模型,让语音识别与语音翻译两个任务可以动态交互学习,实现知识的共享和传递。

方 法

针对上述问题,中科院自动化所自然语言处理组博士生刘宇宸、张家俊研究员、宗成庆研究员

和百度公司合作提出了一种基于交互式解码的同步语音识别与语音翻译模型

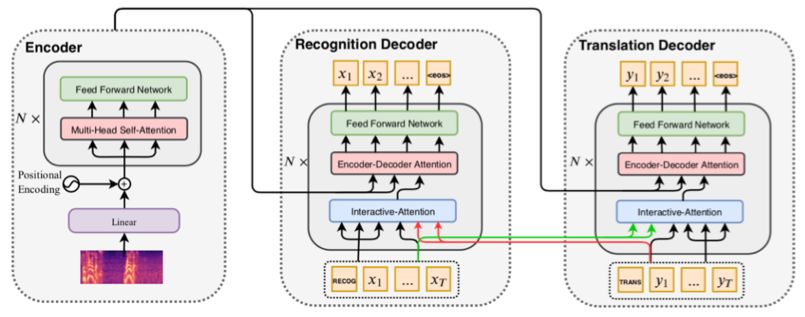

。如图2所示,

![]()

我们使用基于自注意力机制的Transformer模型作为主框架,语音识别任务和语音翻译解码任务共享同一个编码器,在解码器中加入一个交互注意力机制层

,实现两个任务的知识交互和传递。如图3所示,

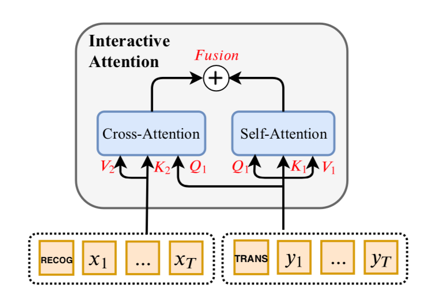

![]()

交互注意力机制层

包含一个自注意力模块和一个跨任务注意力模块。其中前者用于提取当前任务输出端的特征表示,后者用于提取另一个任务输出端的特征表示,两者通过一个线性插值函数融合得到包含两个任务信息的特征表示。

在训练阶段,两个任务同时优化;在解码阶段,两个任务同步进行。如此,在预测下一个词的过程中既可以用到当前任务的已生成的词语,也可以利用到另一个任务上已生成的词语。为了进一步提升语音翻译的性能,我们采用了一种wait-k的方法

,使得语音翻译任务相比语音识别任务延迟k个词语进行,以获得更多更可靠的文本信息作为辅助。

实验结果

目前语音翻译数据十分匮乏且质量不高,为此我们构建了一个新的语音翻译数据集。我们从TED网站上爬取了视频和字幕文件,从中提取出音频、英文字幕和多语言翻译字幕,得到了语音、识别文本、翻译文本的对齐语料。这里使用了英德、英法、英中、英日四种语言,前两种属于较为相似的语言对,后两种是不相似的语言对。

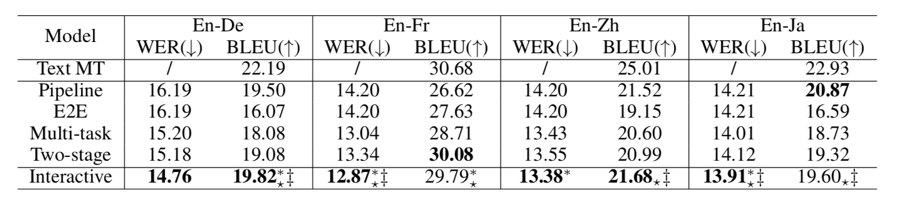

语音识别和语音翻译的结果分别使用词错误率(WER)和BLEU进行衡量。我们与多个强基线模型进行了对比,包括由语音识别和机器翻译模型串联组成的级联系统(Pipeline),在语音识别语料上进行预训练的端到端语音翻译模型(E2E),语音识别和语音翻译共享编码器的多任务模型(Multi-task),以及一个两阶段模型(Two-stage)(第一阶段解码器用于获取识别文本的中间表示,第二阶段解码器基于编码器的表示和第一阶段解码器的中间表示生成对应的翻译)。

![]()

表1给出了不同模型在英德、英法、英中、英日不同语言对上的识别和翻译效果。可以看出在大多数情况下,基于交互式解码的同步语言识别与语音翻译模型的性能表现不管在语音识别任务还是语音翻译任务上都要显著高于预训练的端到端模型、多任务模型和两阶段模型。

在相似的语言对上基于交互式解码的模型可以超越级联系统,在不相似的语言对上也与级联系统可比。值得注意的是之前端到端的语音翻译模型几乎都很难达到级联系统的性能。

![]()

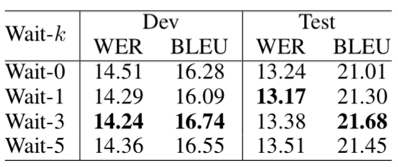

为了进一步提升语音翻译的性能,我们让

语音翻译任务

相比语音识别任务延迟k个词语进行,以获得更多的文本信息作为辅助。表2给出了在开发集和测试集上不同的延迟词语数对于模型性能的影响。可以看出,虽然延迟词语会轻微影响识别任务的表现,但是语音翻译任务的性能可以得到提升。

![]()

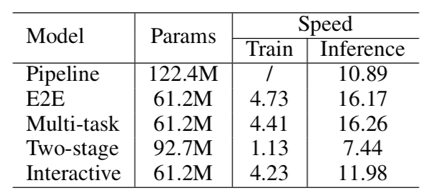

我们也对比了不同模型的参数量、训练和解码速率。表3给出了模型的参数量大小、每秒的训练步数和每秒的解码句子数。可以看出,我们的模型较好的平衡了参数量和解码速率,相比级联系统,参数量获得的大幅降低;训练和解码速率显著低于两阶段模型;虽然解码速率略低于预训练端到端模型和多任务模型,但是我们的方法可以实现两个任务的同步解码。

相关细节可参考发表于人工智能顶级学术会议AAAI2020的论文:

Yuchen Liu, Jiajun Zhang,Hao Xiong, Long Zhou, Zhongjun He, Hua Wu, Haifeng Wang, and Chengqing Zong.Synchronous Speech Recognition and Speech-to-Text Translation with InteractiveDecoding. AAAI-2020. (available on https://arxiv.org/abs/1912.07240)

Youtube上也有学者介绍我们的工作:

https://www.youtube.com/watch?v=ZgbUBmVFcBc

AAAI 2020 论文集:

AAAI 2020 | 这 10 篇论文值得你了解(附PPT下载)

01. 时间可以是二维的吗?基于二维时间图的视频内容片段检测

02. 全新视角,探究「目标检测」与「实例分割」的互惠关系

03. 新角度看双线性池化,冗余、突发性问题本质源于哪里?

04. 复旦大学黄萱菁团队:利用场景图针对图像序列进行故事生成

05. 2100场王者荣耀,1v1胜率99.8%,腾讯绝悟 AI 技术解读

06. 多任务学习,如何设计一个更好的参数共享机制?

07. 话到嘴边却忘了?这个模型能帮你 | 多通道反向词典模型

08. DualVD:一种视觉对话新框架

![]()

![]()

AI 科技评论希望能够招聘 科技编辑/记者 一名

办公地点:北京

职务:以参与学术顶会报道、人物专访为主

工作内容:

1、参加各种人工智能学术会议,并做会议内容报道;

2、采访人工智能领域学者或研发人员;

3、关注学术领域热点事件,并及时跟踪报道。

要求:

1、热爱人工智能学术研究内容,擅长与学者或企业工程人员打交道;

2、有一定的理工科背景,对人工智能技术有所了解者更佳;

3、英语能力强(工作内容涉及大量英文资料);

4、学习能力强,对人工智能前沿技术有一定的了解,并能够逐渐形成自己的观点。

感兴趣者,可将简历发送到邮箱:jiawei@leiphone.com

![]()

招 聘

AI 科技评论希望能够招聘 科技编辑/记者 一名

办公地点:北京

职务:以参与学术顶会报道、人物专访为主

工作内容:

1、参加各种人工智能学术会议,并做会议内容报道;

2、采访人工智能领域学者或研发人员;

3、关注学术领域热点事件,并及时跟踪报道。

要求:

1、热爱人工智能学术研究内容,擅长与学者或企业工程人员打交道;

2、有一定的理工科背景,对人工智能技术有所了解者更佳;

3、英语能力强(工作内容涉及大量英文资料);

4、学习能力强,对人工智能前沿技术有一定的了解,并能够逐渐形成自己的观点。

感兴趣者,可将简历发送到邮箱:jiawei@leiphone.com

![]()

![]() 点击“阅读原文” 加入 观看 AAAI 预讲直播视频

点击“阅读原文” 加入 观看 AAAI 预讲直播视频