春节充电系列:李宏毅2017机器学习课程学习笔记25之结构化学习-序列标注 Sequence Labeling(part 1)

【导读】我们在上一节的内容中已经为大家介绍了台大李宏毅老师的机器学习课程的Structured learning-Structured SVM,这一节将主要针对讨论Structured learning-sequence labeling。本文内容主要针对机器学习中Structured learning- sequence labeling的POS tagging,Hidden Markov Model以及Conditional Random Field分别详细介绍。话不多说,让我们一起学习这些内容吧

春节充电系列:李宏毅2017机器学习课程学习笔记02之Regression

春节充电系列:李宏毅2017机器学习课程学习笔记03之梯度下降

春节充电系列:李宏毅2017机器学习课程学习笔记04分类(Classification)

春节充电系列:李宏毅2017机器学习课程学习笔记05之Logistic 回归

春节充电系列:李宏毅2017机器学习课程学习笔记06之深度学习入门

春节充电系列:李宏毅2017机器学习课程学习笔记07之反向传播(Back Propagation)

春节充电系列:李宏毅2017机器学习课程学习笔记08之“Hello World” of Deep Learning

春节充电系列:李宏毅2017机器学习课程学习笔记09之Tip for training DNN

春节充电系列:李宏毅2017机器学习课程学习笔记10之卷积神经网络

春节充电系列:李宏毅2017机器学习课程学习笔记11之Why Deep Learning?

春节充电系列:李宏毅2017机器学习课程学习笔记12之半监督学习(Semi-supervised Learning)

春节充电系列:李宏毅2017机器学习课程学习笔记13之无监督学习:主成分分析(PCA)

春节充电系列:李宏毅2017机器学习课程学习笔记14之无监督学习:词嵌入表示(Word Embedding)

春节充电系列:李宏毅2017机器学习课程学习笔记15之无监督学习:Neighbor Embedding

春节充电系列:李宏毅2017机器学习课程学习笔记16之无监督学习:自编码器(autoencoder)

春节充电系列:李宏毅2017机器学习课程学习笔记17之深度生成模型:deep generative model part 1

春节充电系列:李宏毅2017机器学习课程学习笔记18之深度生成模型:deep generative model part 2

春节充电系列:李宏毅2017机器学习课程学习笔记19之迁移学习(Transfer Learning)

春节充电系列:李宏毅2017机器学习课程学习笔记20之支持向量机(support vector machine)

春节充电系列:李宏毅2017机器学习课程学习笔记21之结构化学习(Structured learning)介绍篇

春节充电系列:李宏毅2017机器学习课程学习笔记22之结构化学习(Structured learning)线性模型

春节充电系列:李宏毅2017机器学习课程学习笔记23之结构化学习-Structured SVM(part 1)

春节充电系列:李宏毅2017机器学习课程学习笔记24之结构化学习-Structured SVM(part 2)

课件网址:

http://speech.ee.ntu.edu.tw/~tlkagk/courses_ML17_2.html

http://speech.ee.ntu.edu.tw/~tlkagk/courses_ML17.html

视频网址:

https://www.bilibili.com/video/av15889450/index_1.html

李宏毅机器学习笔记24 Structured learning-Sequence Labeling(part 1)

今天讲述Structured learning的序列标注问题

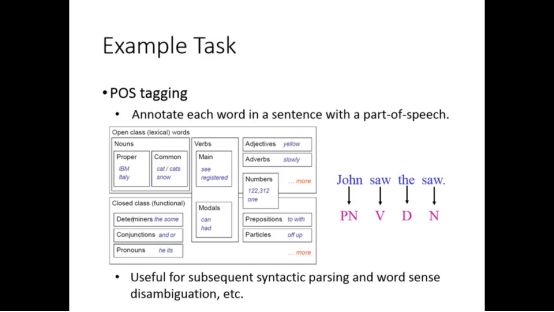

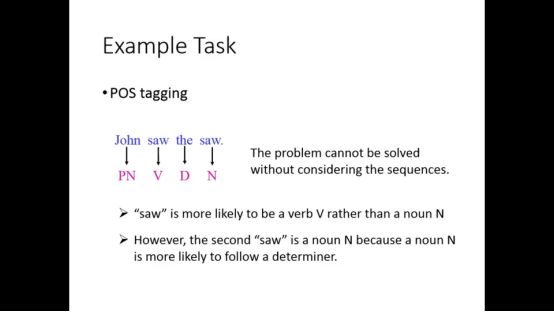

1.POS tagging

我们以词性标注作为例子

所谓词性标注,指的找出一个句子中每个词语的词汇类型

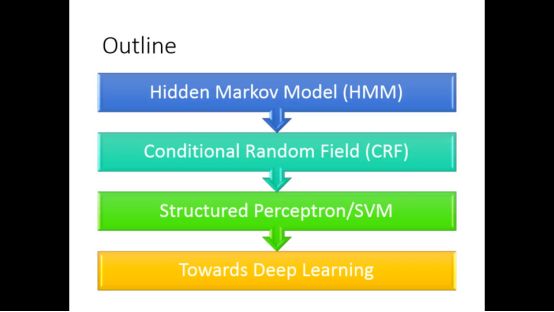

总体会介绍四个部分的内容

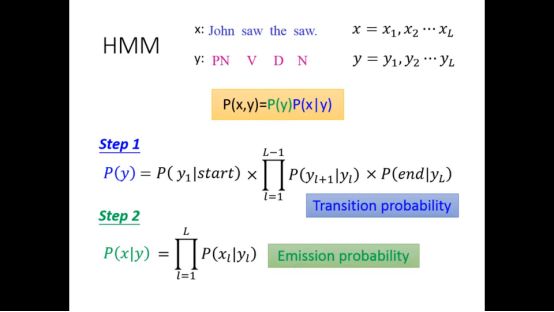

2.Hidden Markov Model

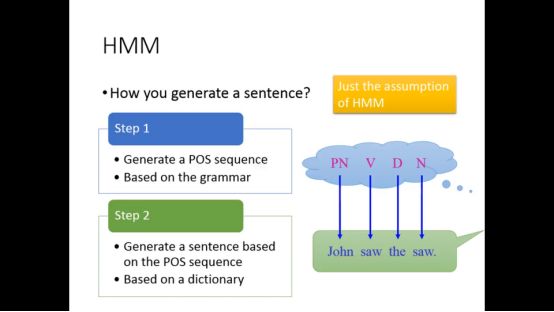

人产生句子的过程第一步是在脑中产生POS sequence,是对于grammar的理解,然后根据pos sequence产生对应的句子。

所以HMM也类似,先根据文法产生POS sequence

然后根据词汇类型找出对应的词汇。

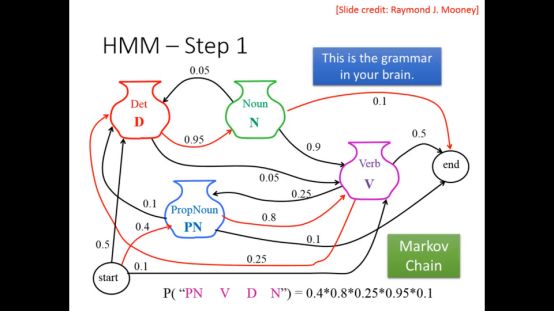

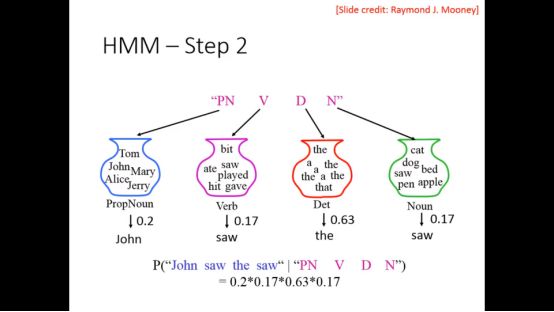

于是产生一个句子“John saw the saw”的概率为

公式一般化为如下所示

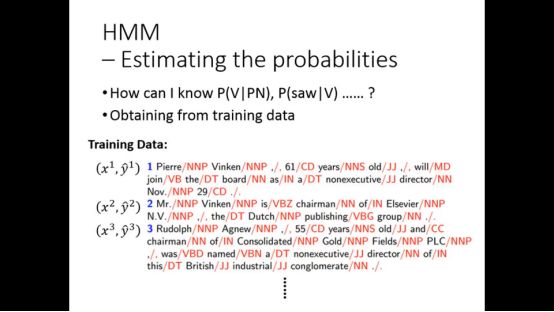

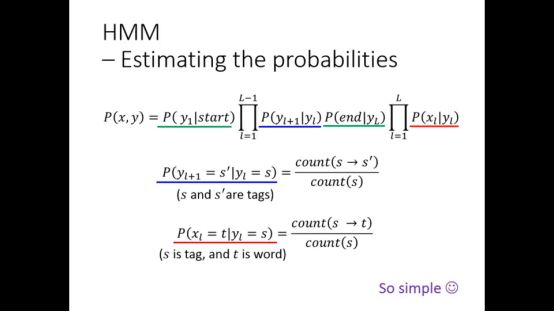

P(V|PN)类似的条件概率从数据集中获得

P(yl+1|yl)的概率也可以统计得到

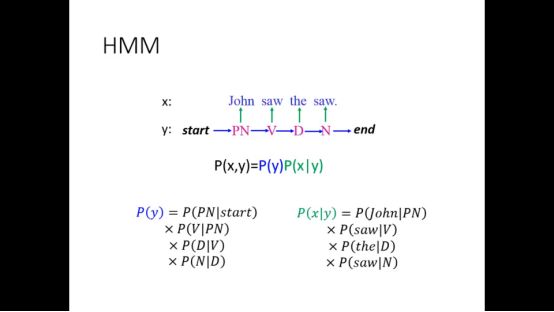

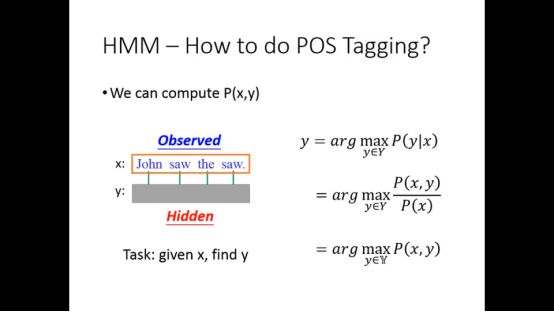

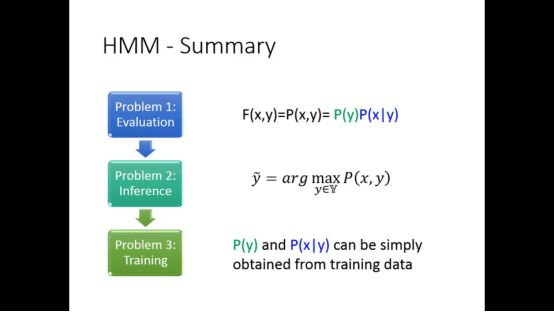

我们要求的就是已知x得到y的概率,实际上我们可通过计算P(x,y)来得到最终结果

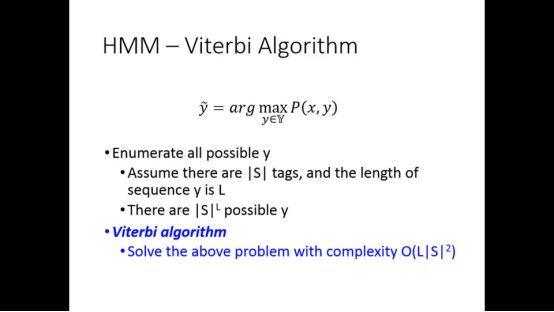

所以要做的就是穷举所有y,看哪个y使得P(x,y)几率最大,但这听起来不太靠谱。Viterbi algorithm可以做到这件事情。

以下是HMM的总结

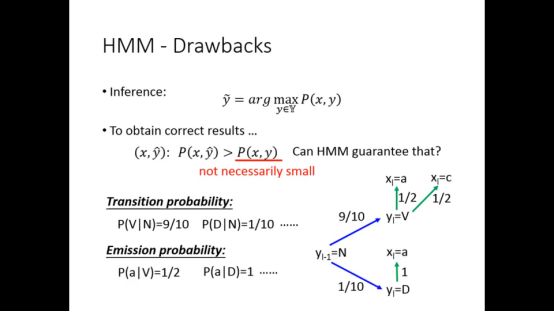

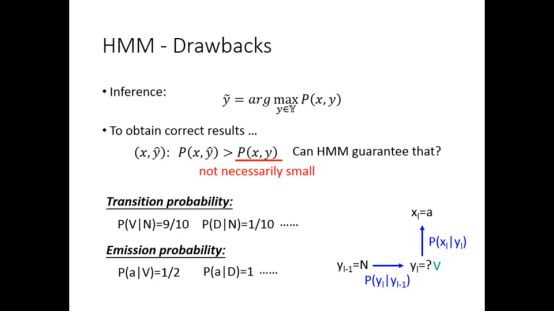

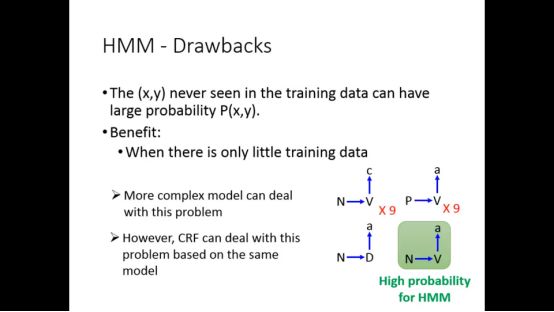

但HMM也是有缺点的

当training data中只有一笔data:N->D->a,在test data遇到这种情况,填D是比较合理的。然而HMM会选N->V->a,这就矛盾了。

所以HMM会脑补它没有看到的东西

3. Conditional Random Field

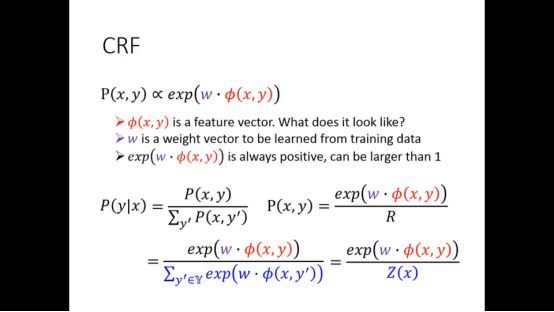

CRF可以解决这个问题

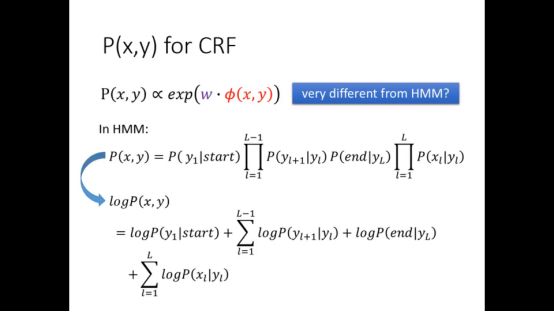

CRF是将P(x,y)的形式改变了

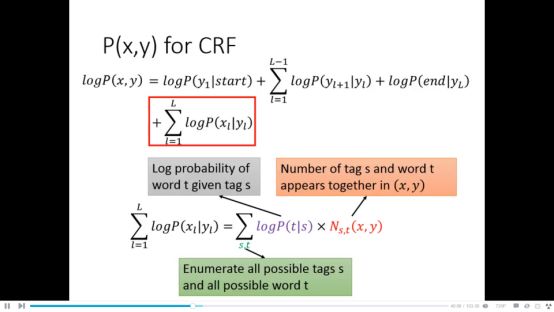

将logP(x,y)继续化简可以得到

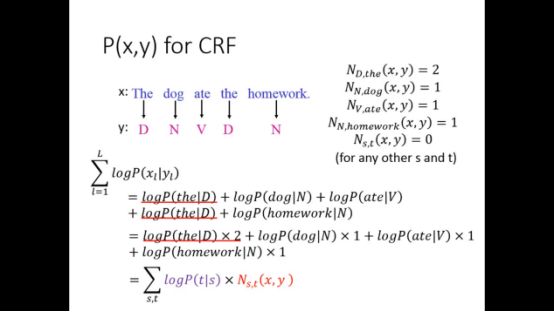

下面是一个具体的例子来解释logP(xl|yl)

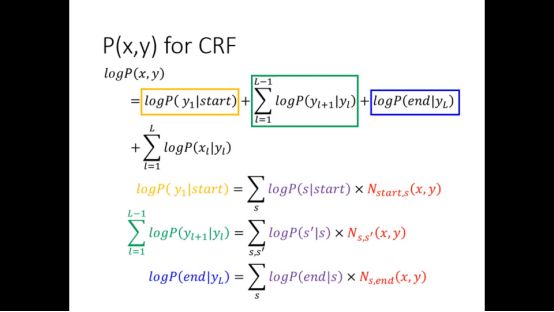

其余的式子也可以表示为类似的形式

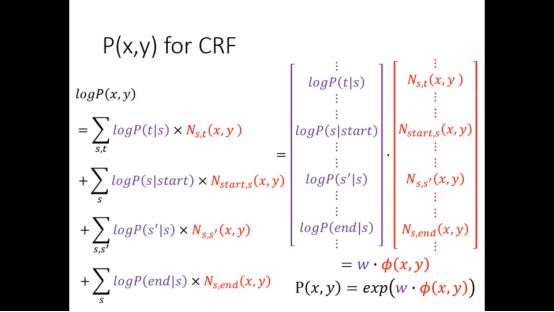

然后将上面所有的式子向量化我们会得到CRF的最终结果

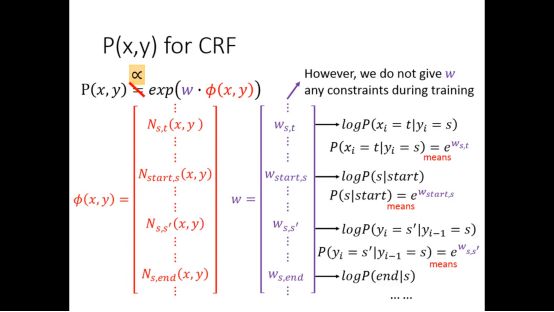

因为无法保证训练时候w一定在某个范围内,所以不能直接等于,相当于成正比

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“LHY2017” 就可以获取 2017年李宏毅中文机器学习课程下载链接~

-END-

专 · 知

人工智能领域主题知识资料查看获取:【专知荟萃】人工智能领域26个主题知识资料全集(入门/进阶/论文/综述/视频/专家等)

同时欢迎各位用户进行专知投稿,详情请点击:

【诚邀】专知诚挚邀请各位专业者加入AI创作者计划!了解使用专知!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请扫一扫如下二维码关注我们的公众号,获取人工智能的专业知识!

请加专知小助手微信(Rancho_Fang),加入专知主题人工智能群交流!

点击“阅读原文”,使用专知!