【前沿】隐式自编码器(Implicit Autoencoders),自编码器新方法

【导读】本期我们将为大家介绍来自多伦多大学Alireza Makhzani博士在Google Brain的最新演讲,隐式自编码器(IAE,Implicit Autoencoders)。

作者介绍:

Alireza Makhzani博士目前是多伦多大学机器学习研究组的正式成员,于2017年在本校完成了电子与计算机工程博士学位,目前的研究工作主要集中在图像生成模型与半监督学习应用,以及深度强化学习算法。在博士期间,曾参加Google Brain团队实习,在那里完成了对抗自编码器的研发工作,并于2016年于Google DeepMind团队合作,为星际争霸2游戏研发深度强化学习算法。

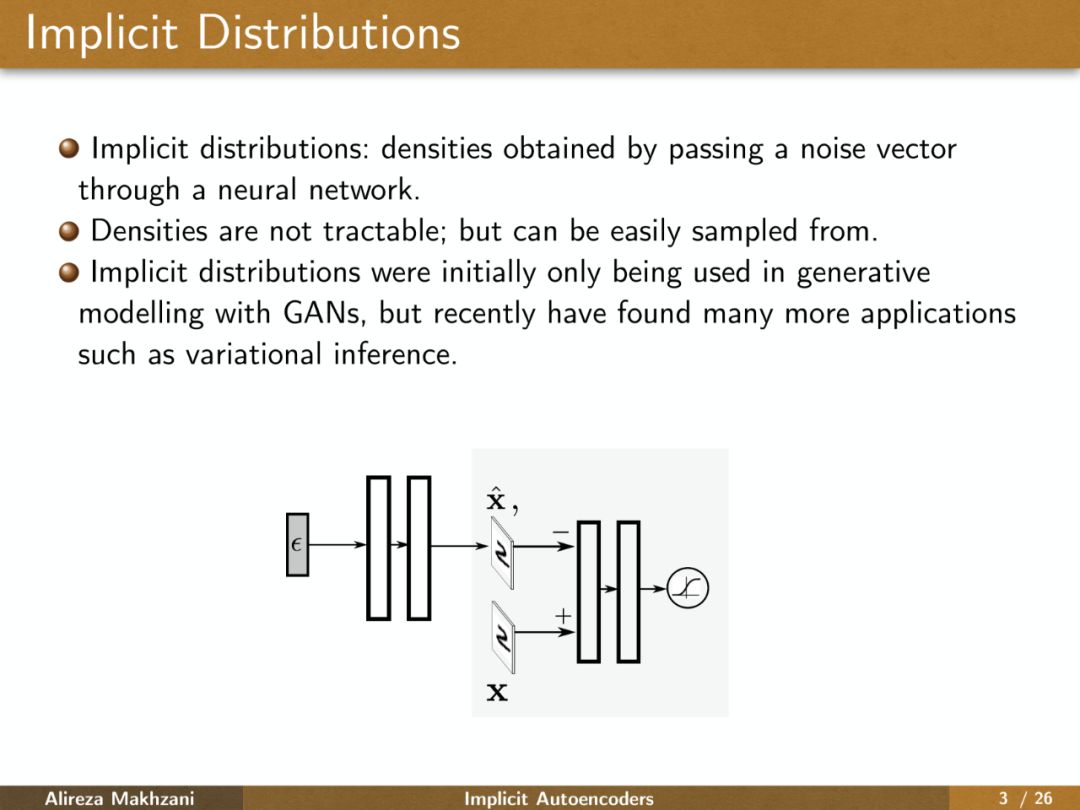

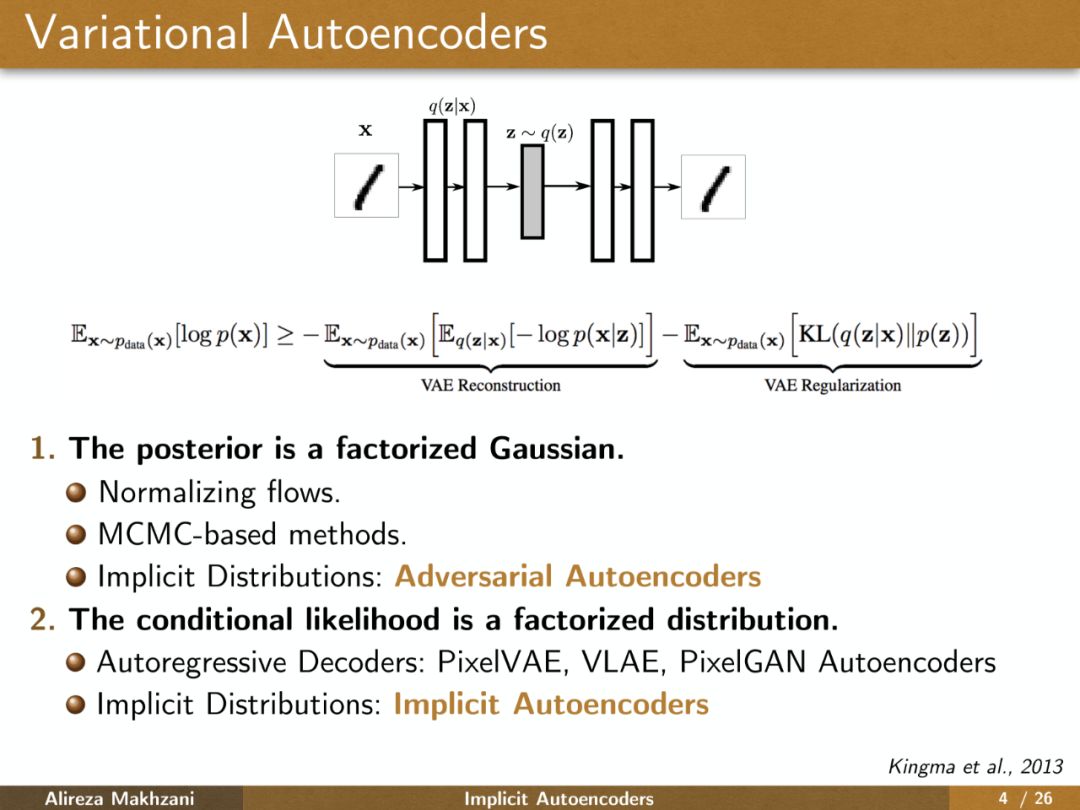

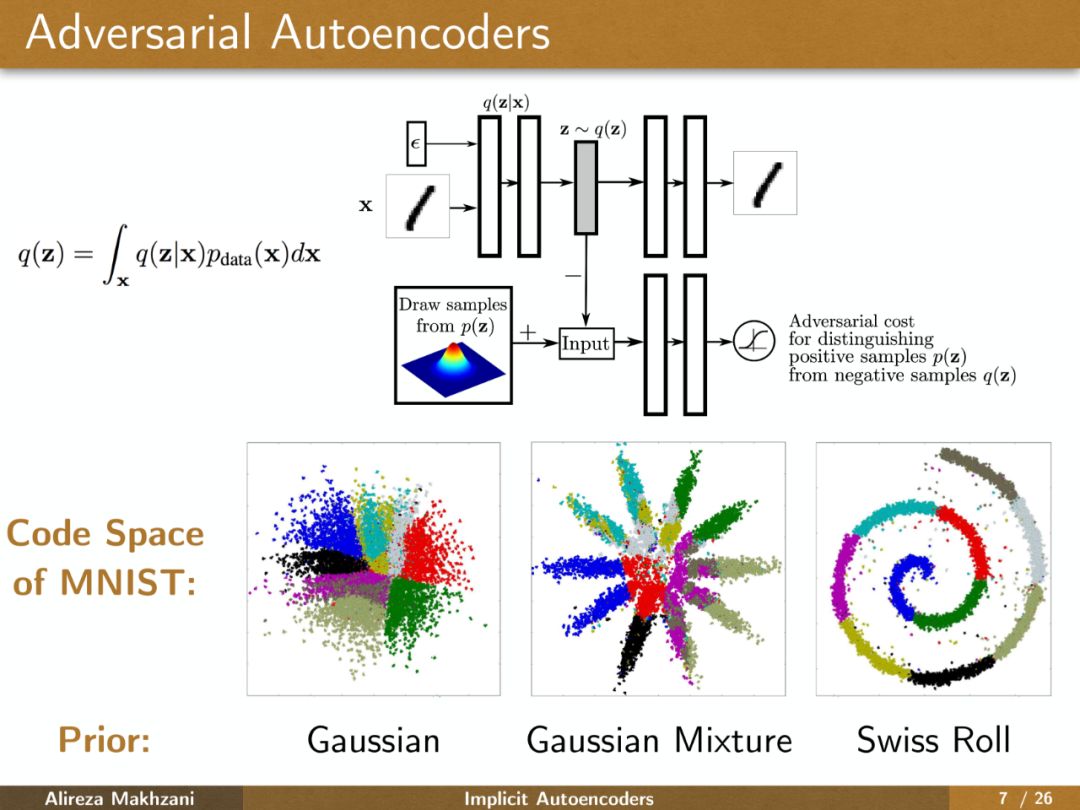

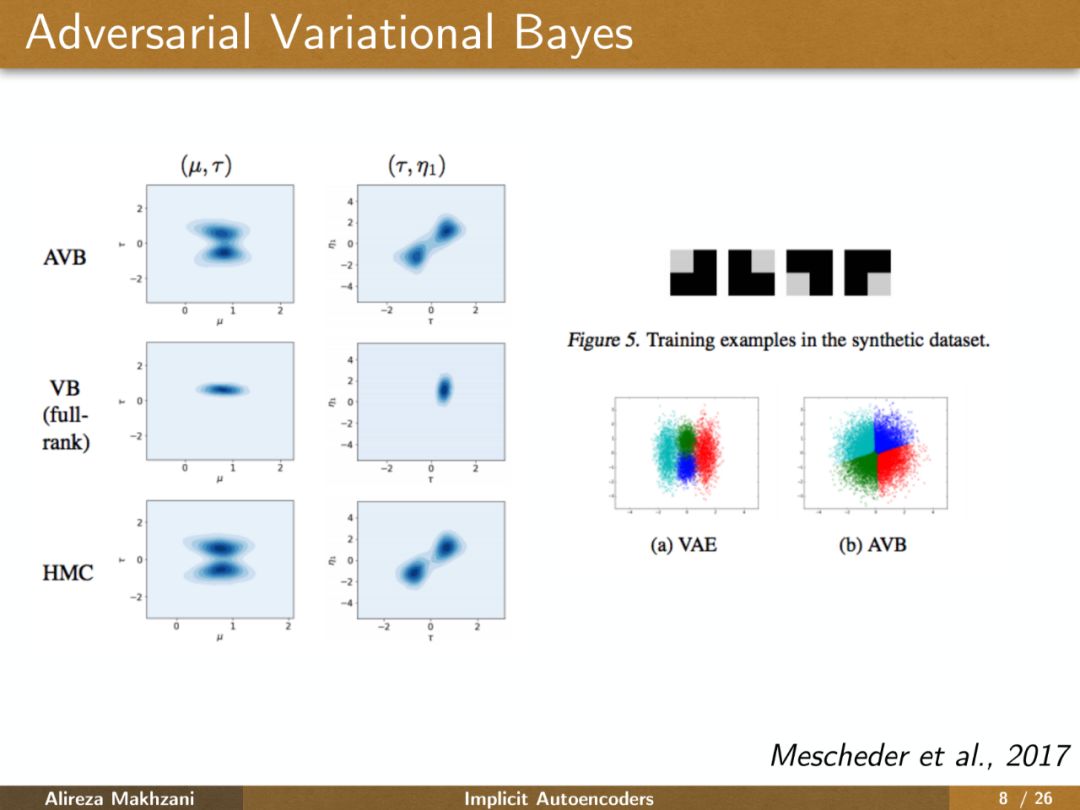

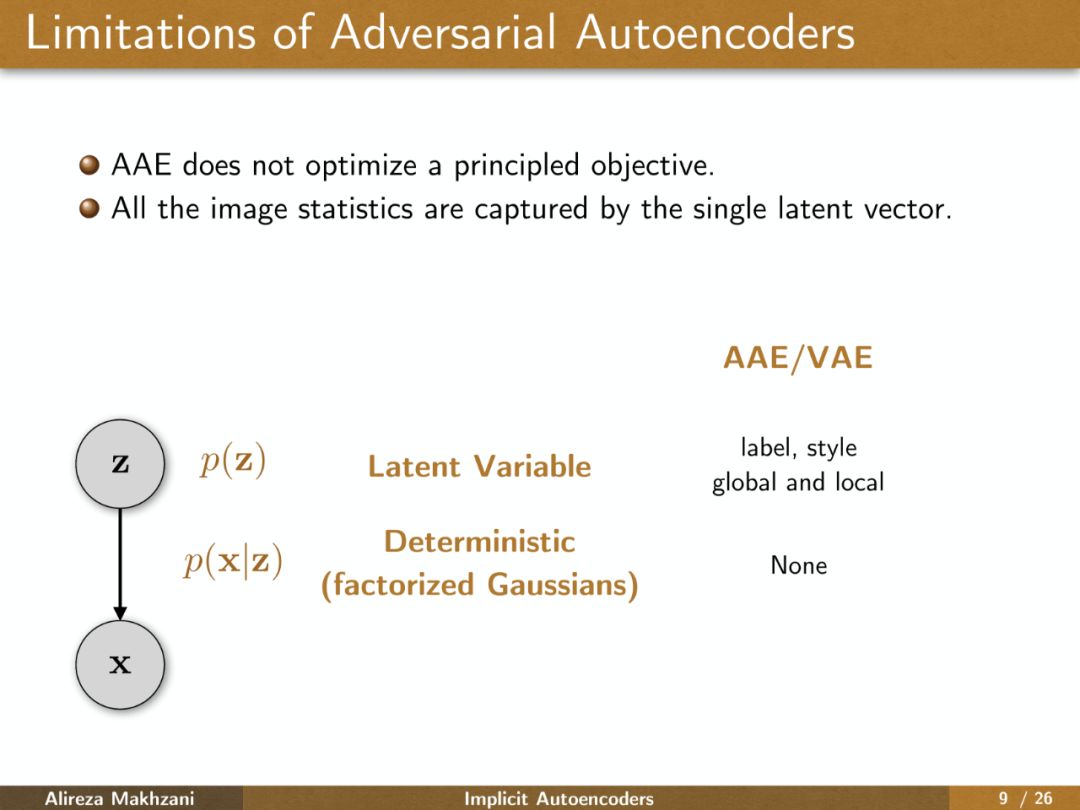

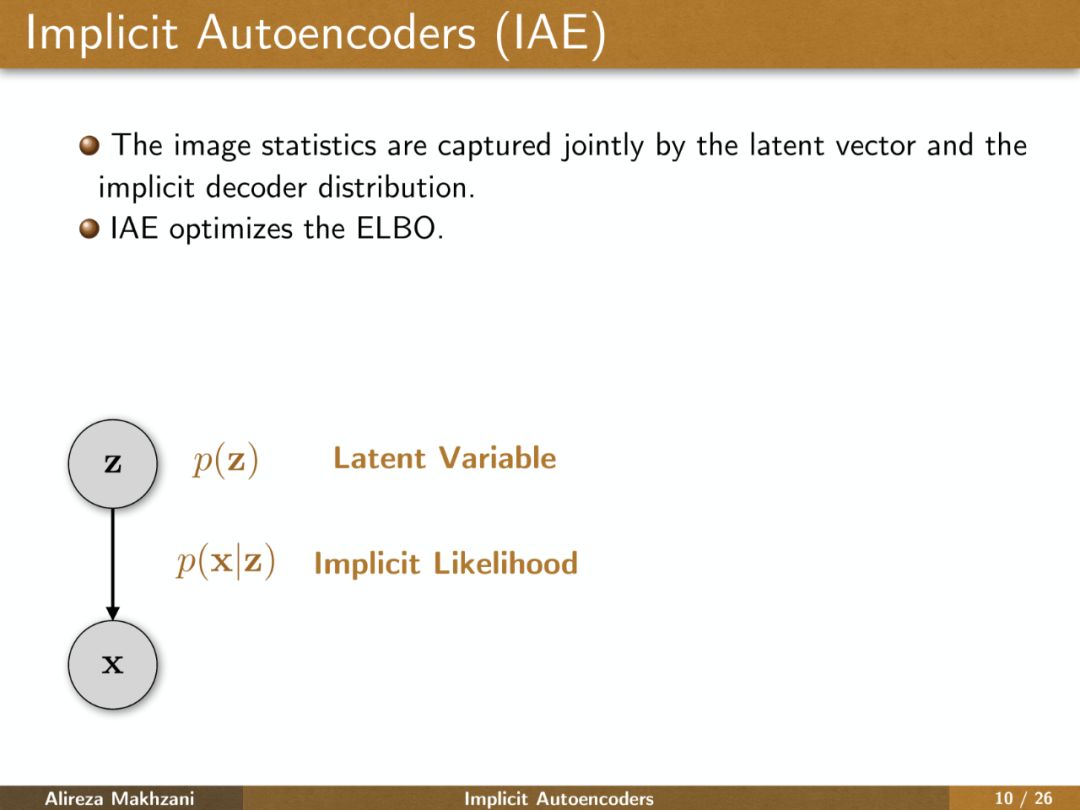

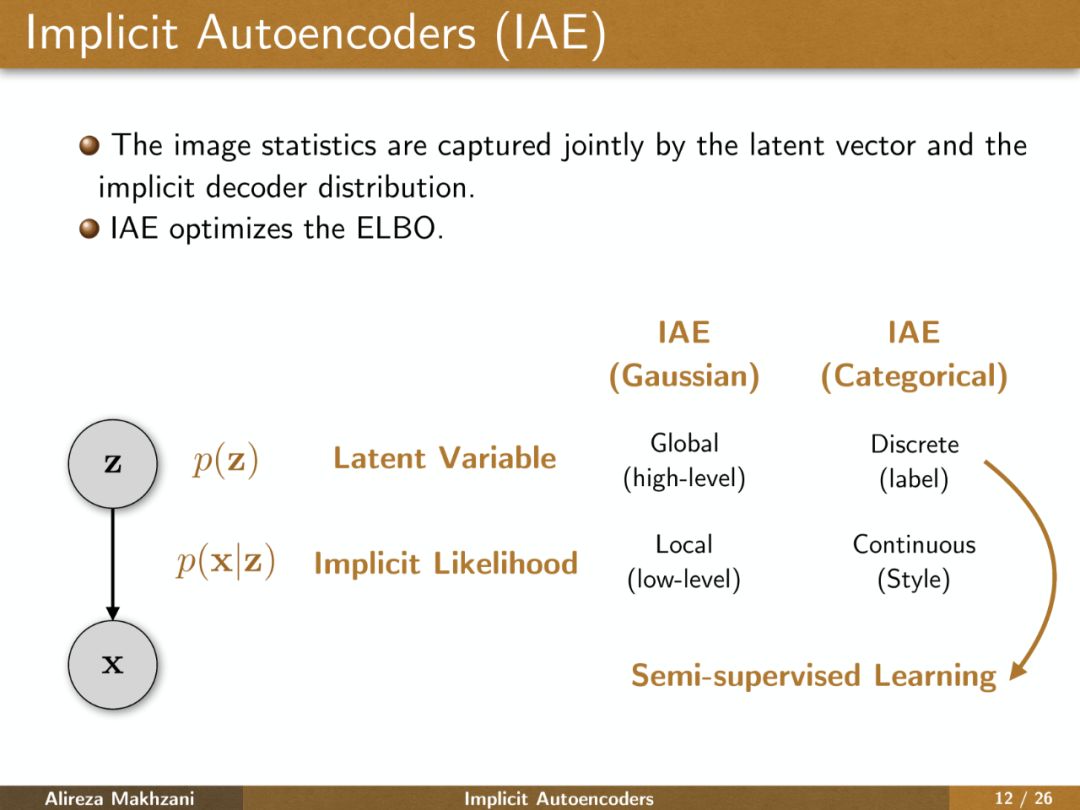

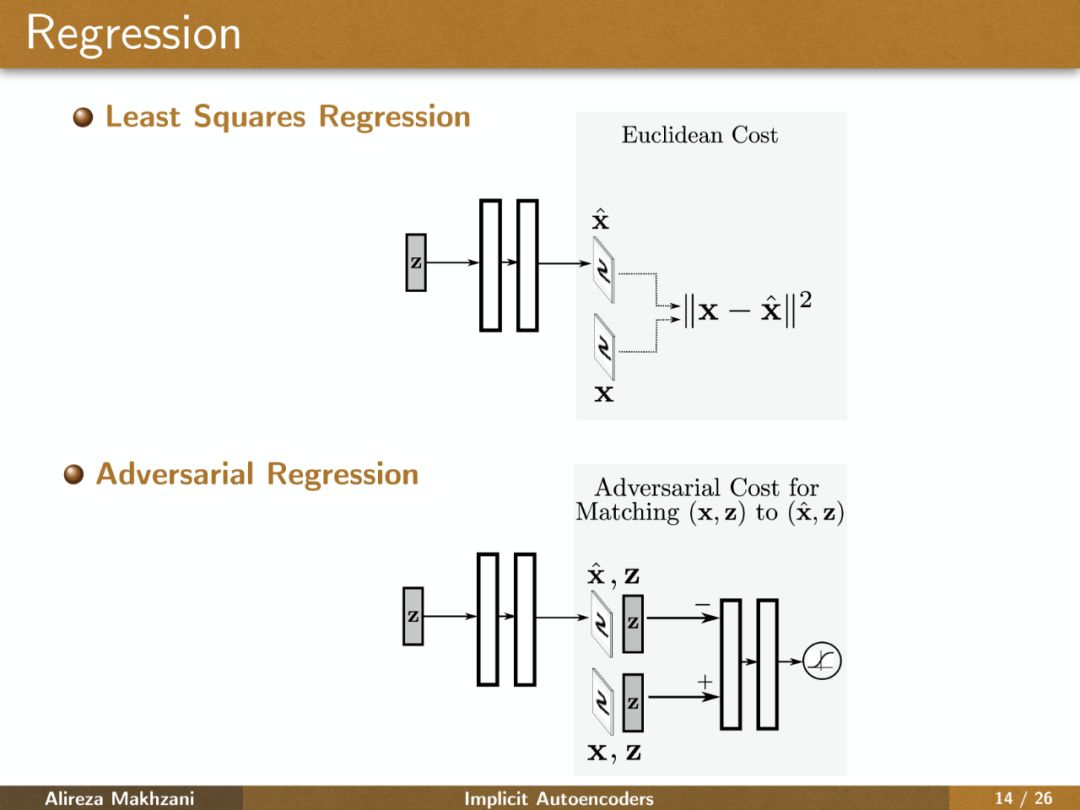

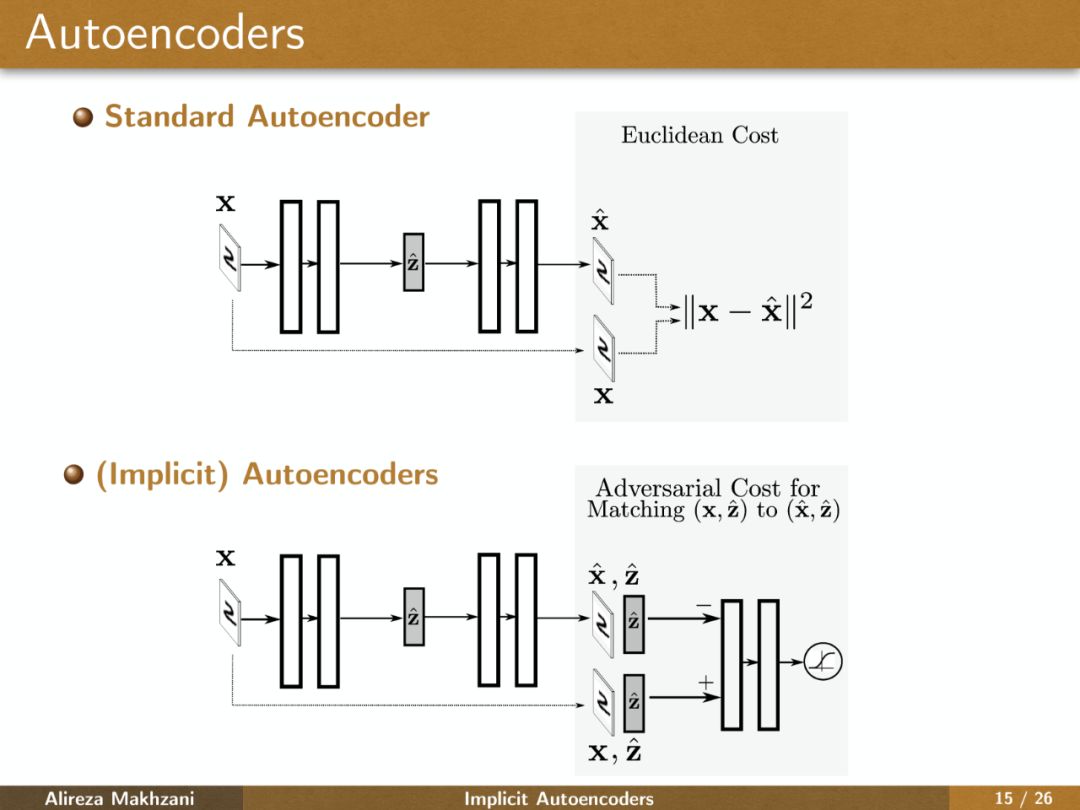

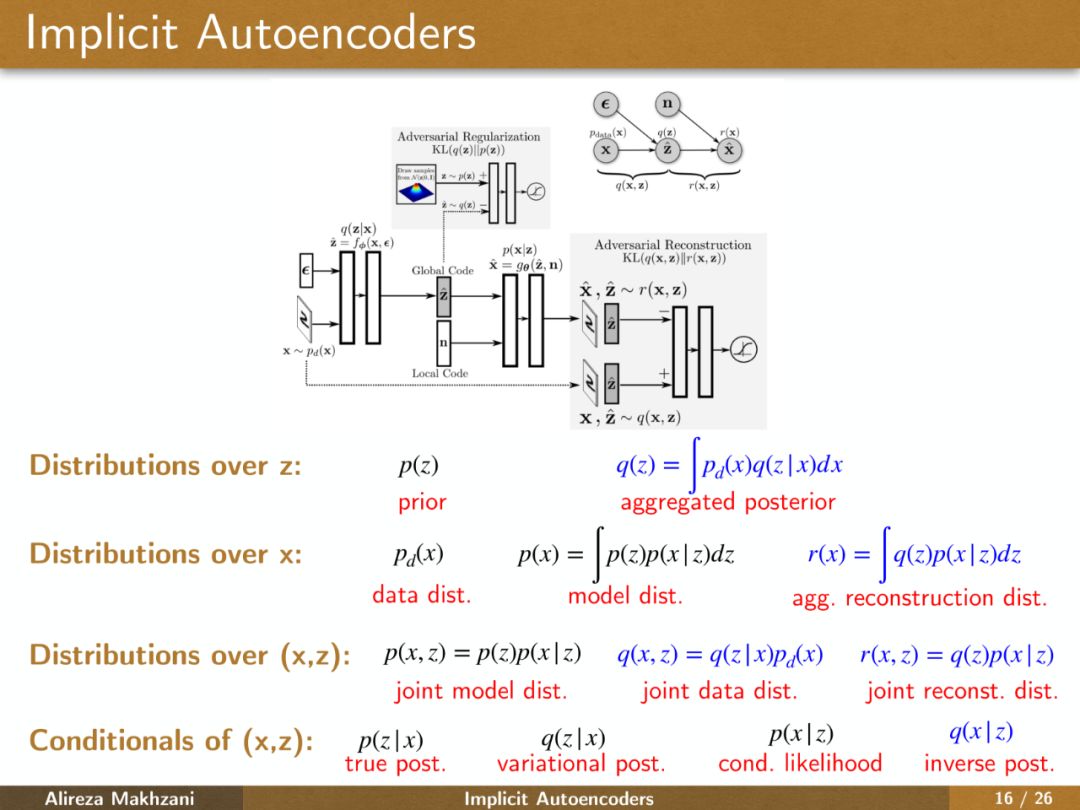

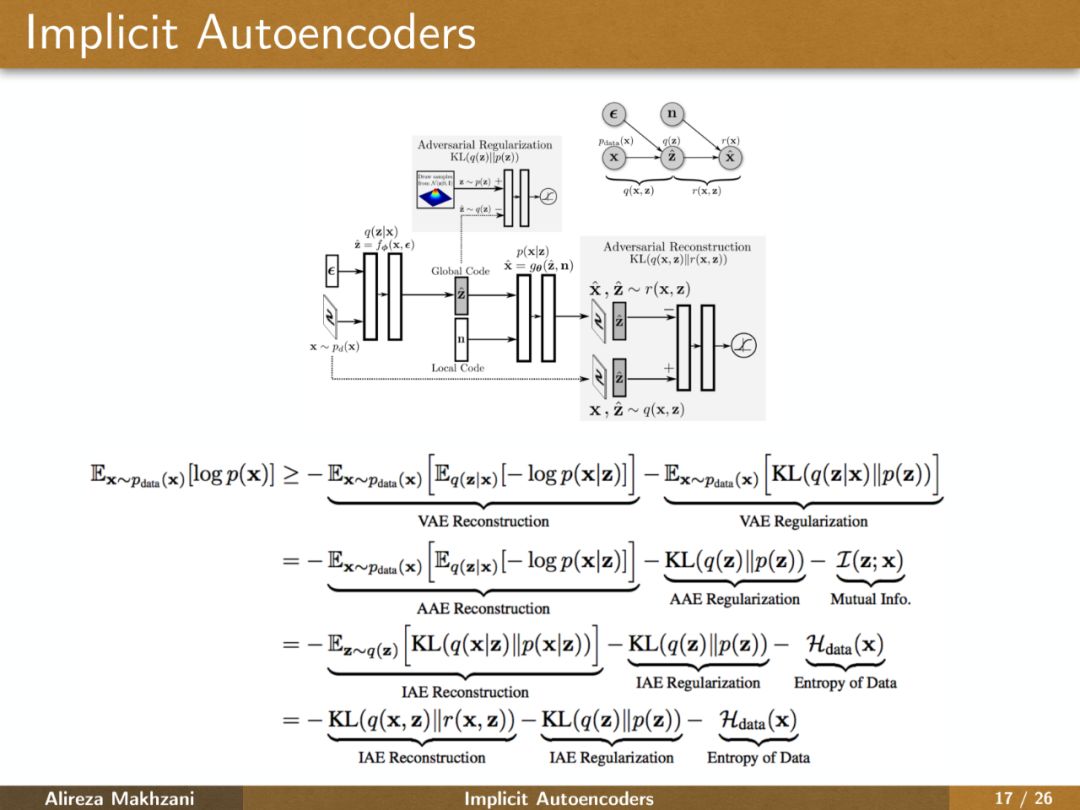

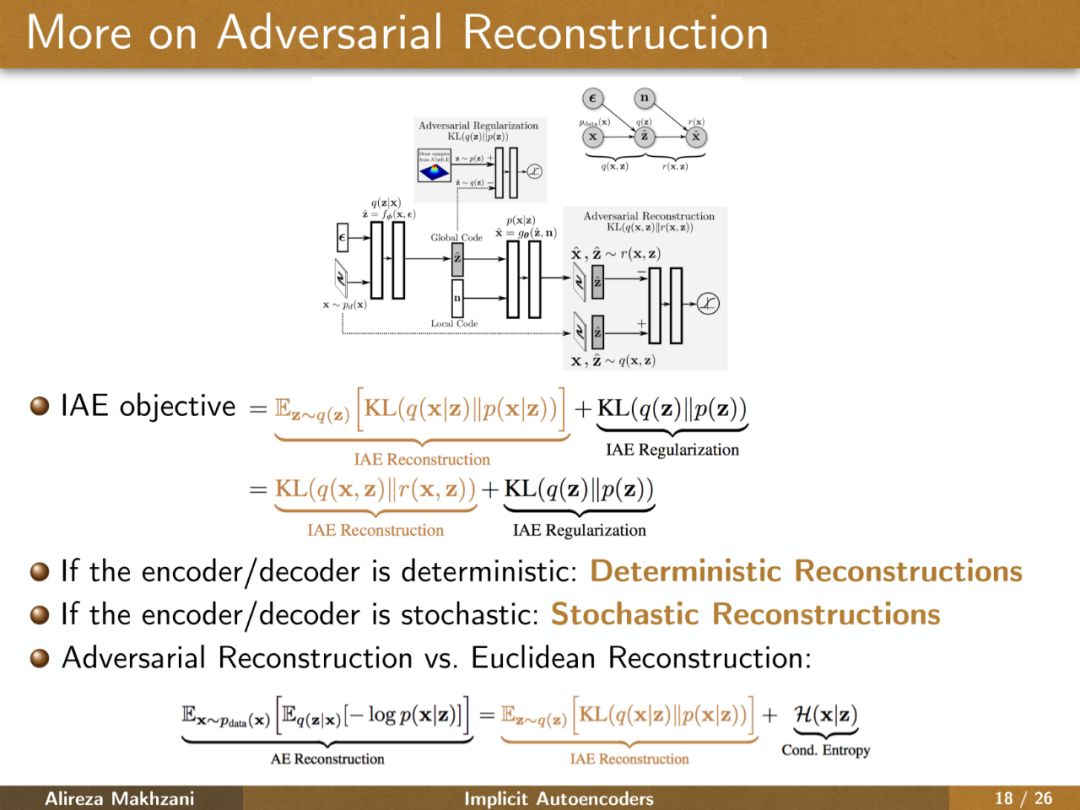

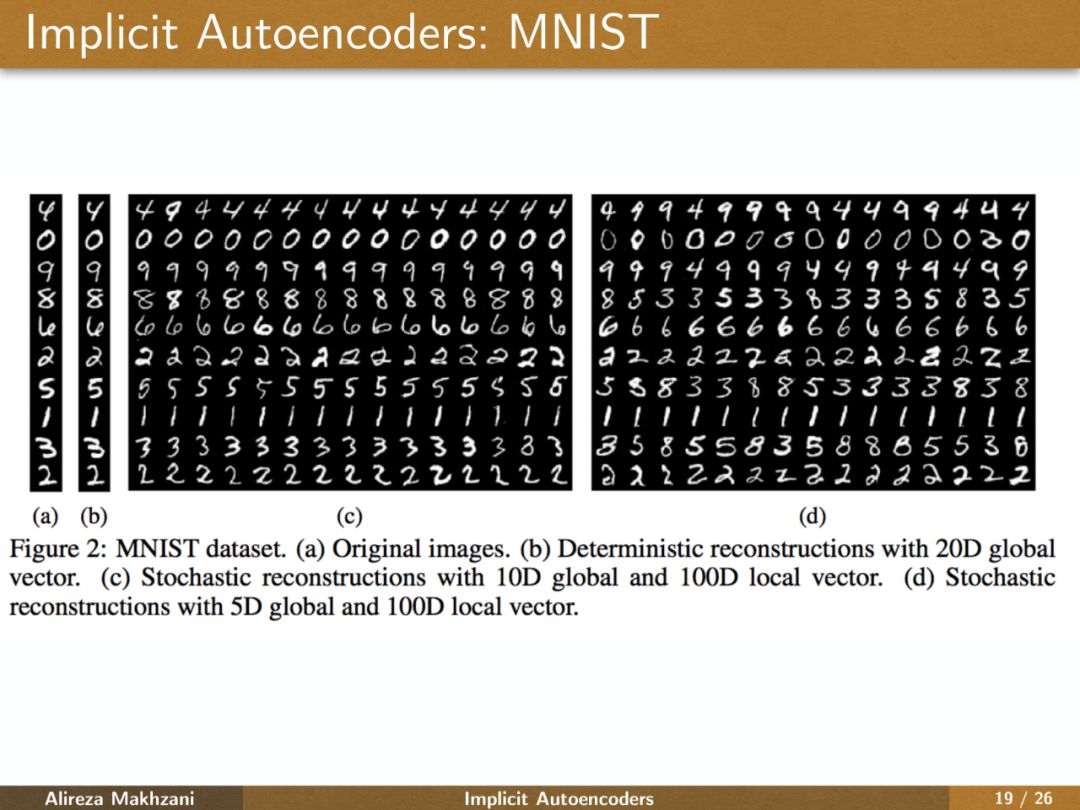

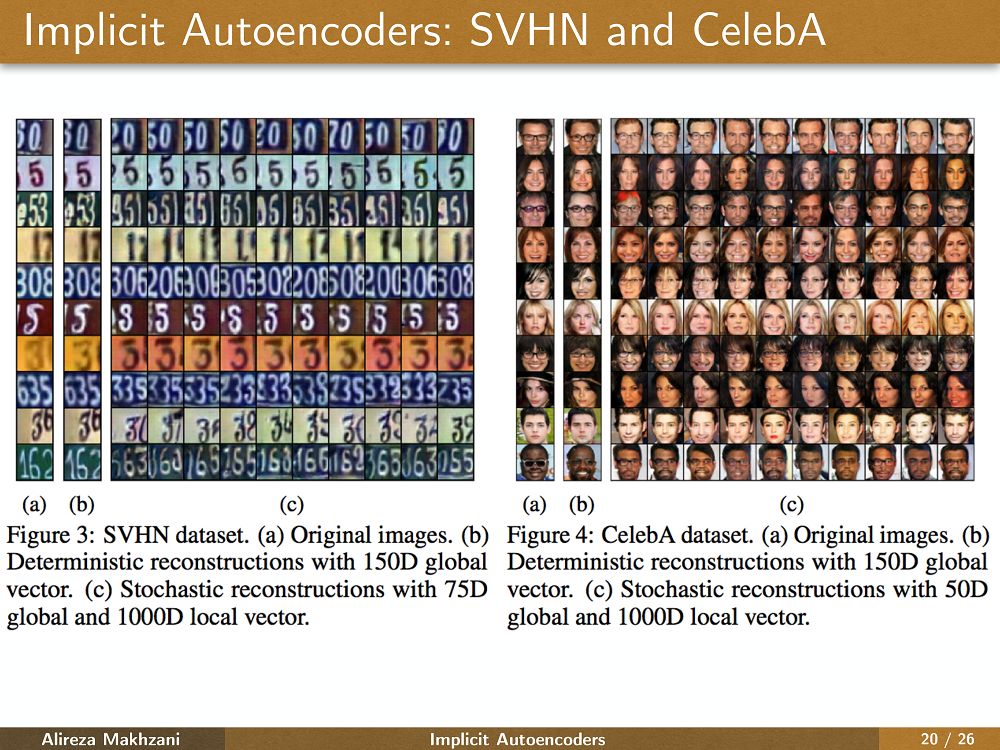

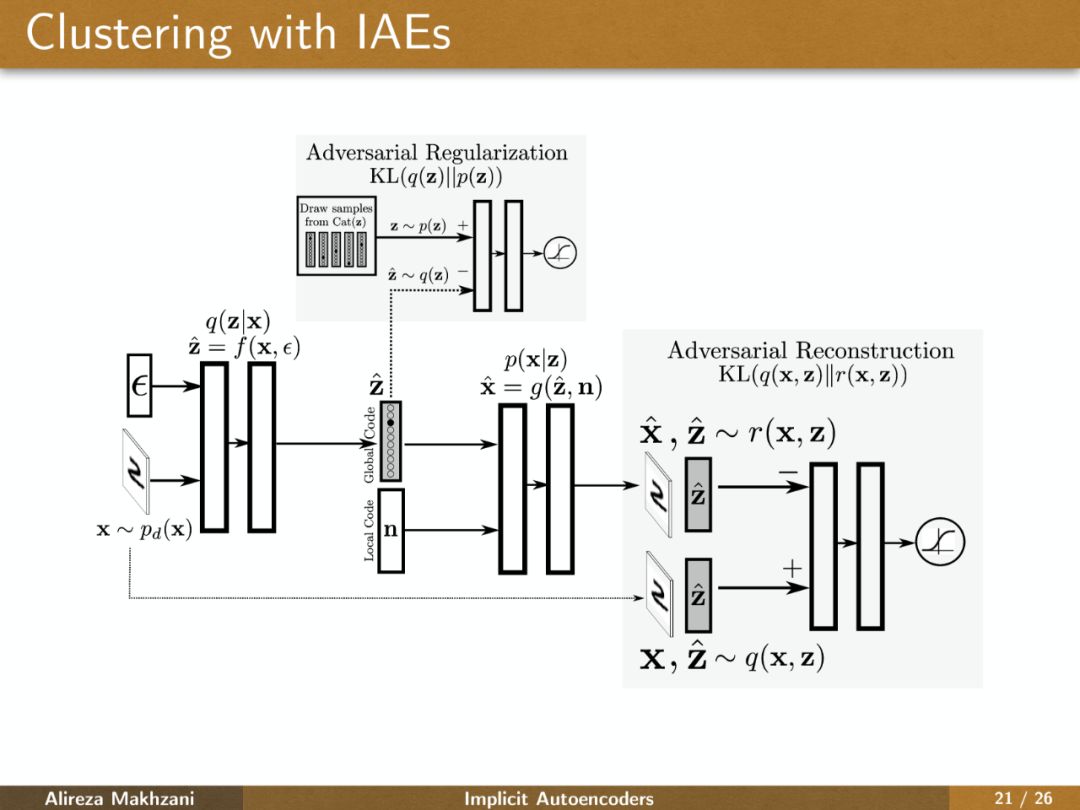

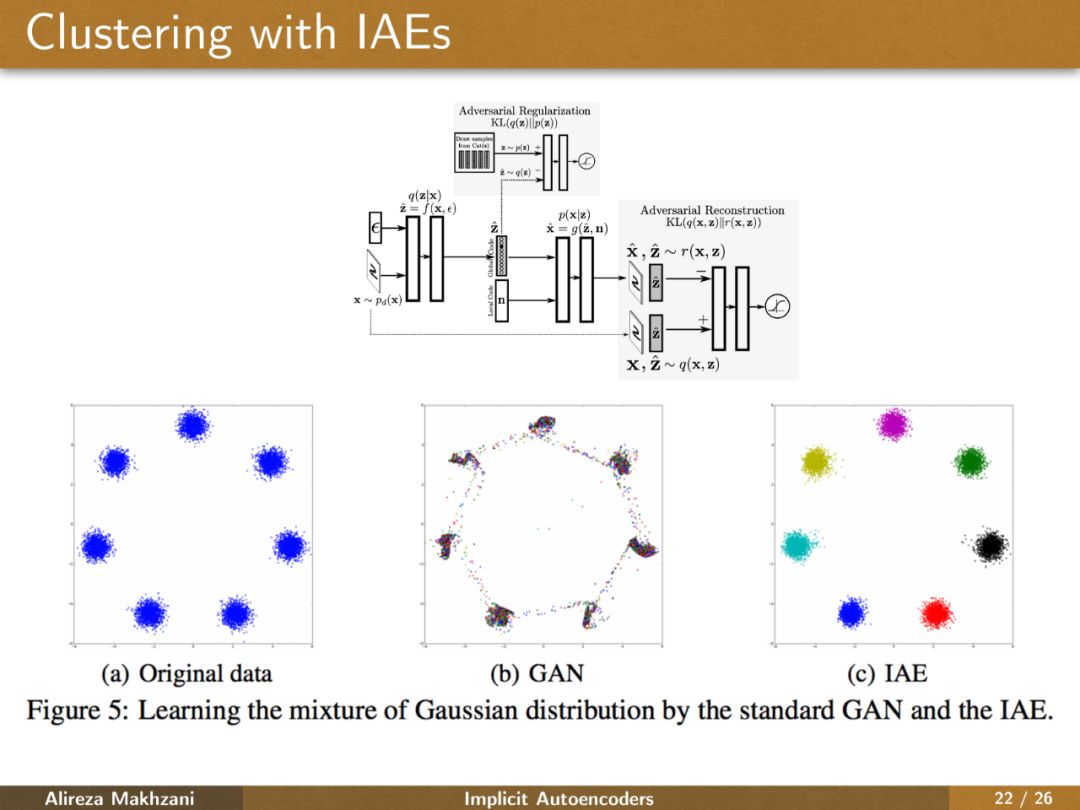

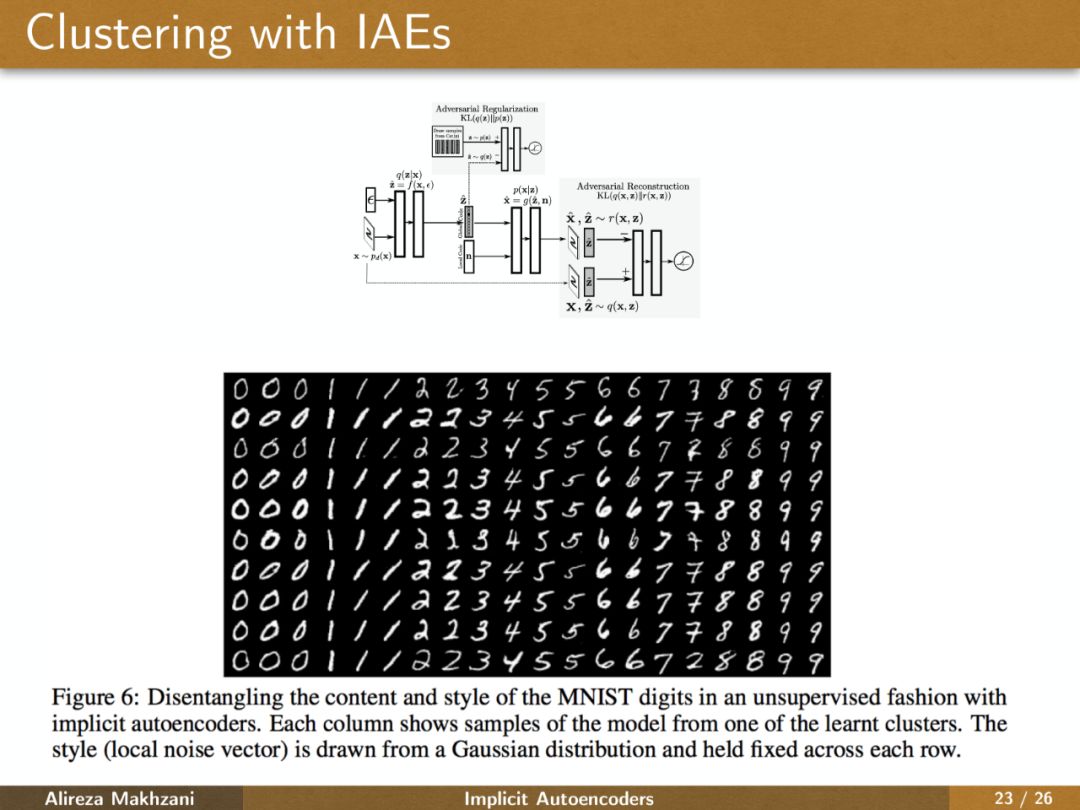

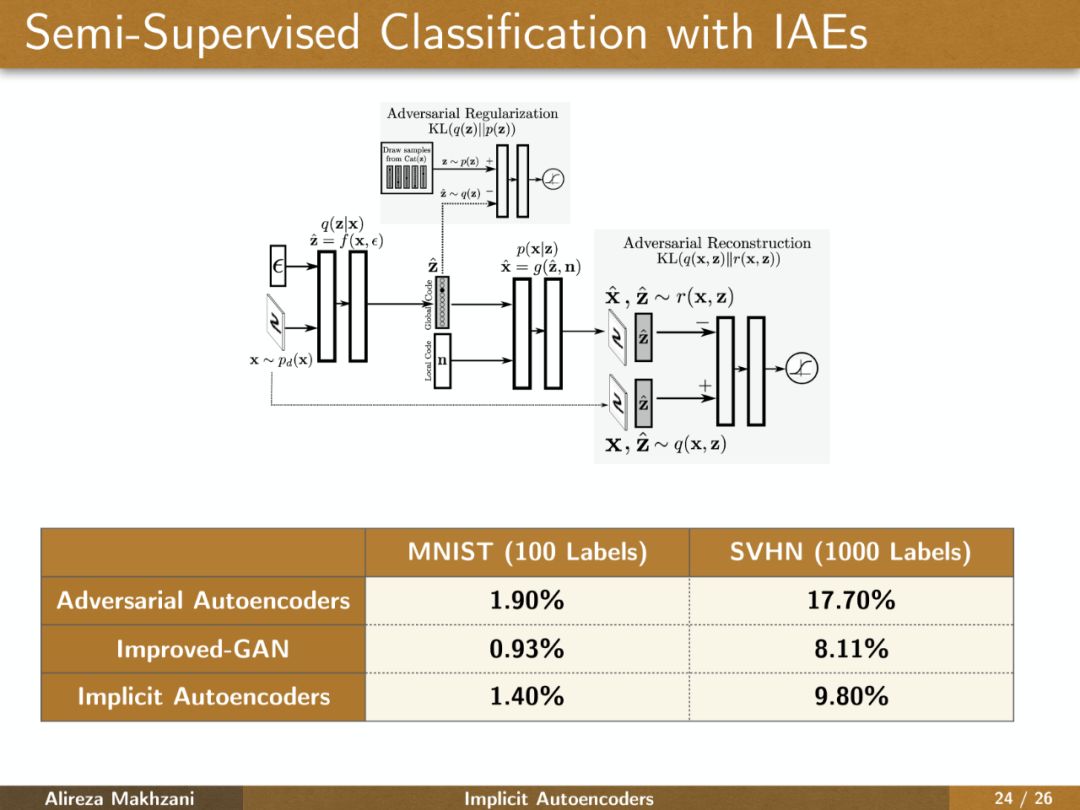

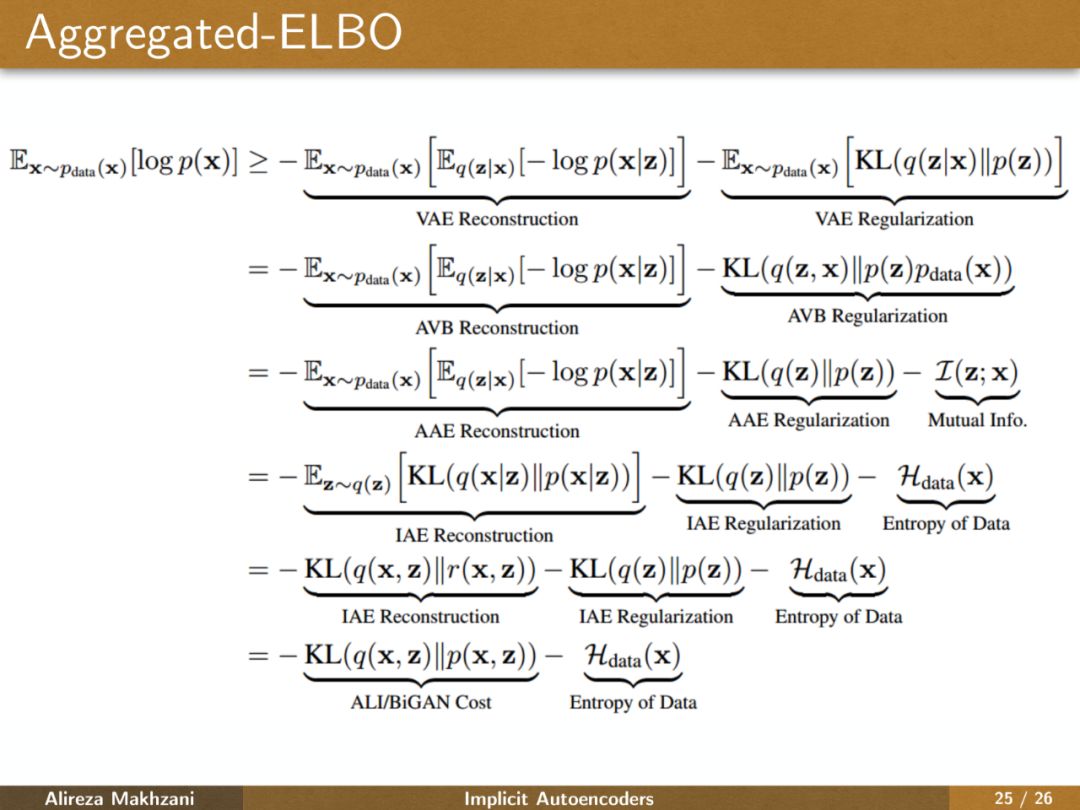

本文中,我们将介绍隐式自编码器(IAE),这是一种生成式自动编码器,其中的生成路径于识别路径都通过隐式表示完成了参数化。该方法使用两个生成对抗网络来定义隐式自编码器的损失函数,并基于最大似然学习推导出学习规则。使用隐式分布将允许该模型学习到更加具有表现力的后验和条件似然分布。学习条件似然分布将使得模型能捕获到数据的高级抽象信息。进而,作者证明了隐式自编码其可以解开全局和局部信息,并可以完成图像的确定性或随机重建工作。同时进一步表明了,隐式自编码器可以以无监督的方式从连续因子中得出离散的潜在变异因子,并进行聚类和半监督学习。

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“IA2018” 就可以获取Implicit Autoencoders pdf下载~

参考链接:

https://arxiv.org/abs/1805.09804

附PPT全文:

-END-

专 · 知

人工智能领域主题知识资料查看与加入专知人工智能服务群:

专知AI知识技术服务会员群加入与人工智能领域26个主题知识资料全集获取。欢迎微信扫一扫加入专知人工智能知识星球群,获取专业知识教程视频资料和与专家交流咨询!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请加专知小助手微信(扫一扫如下二维码添加),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

AI 项目技术 & 商务合作:bd@zhuanzhi.ai, 或扫描上面二维码联系!

请关注专知公众号,获取人工智能的专业知识!

点击“阅读原文”,使用专知