【ICCV2019】中科院自动化所:AlignGAN-夜间行人重识别:通过联合像素和特征对齐解决跨模态行人重识别

关键词

01

摘要

02

背景

03

简介

04

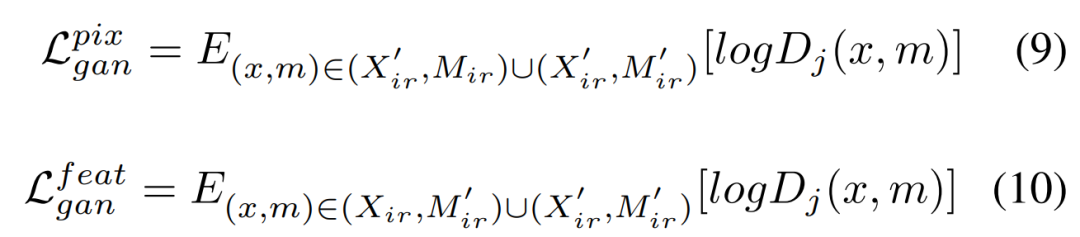

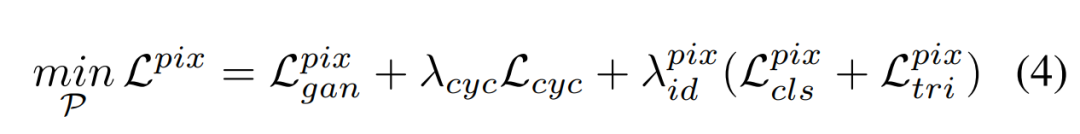

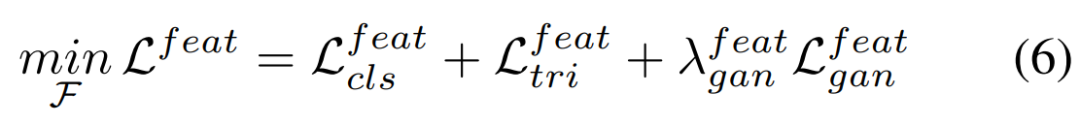

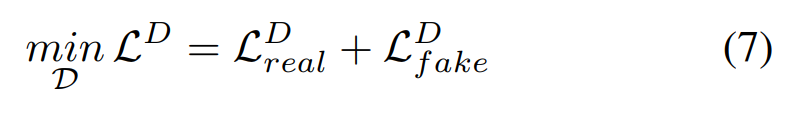

模型介绍

05

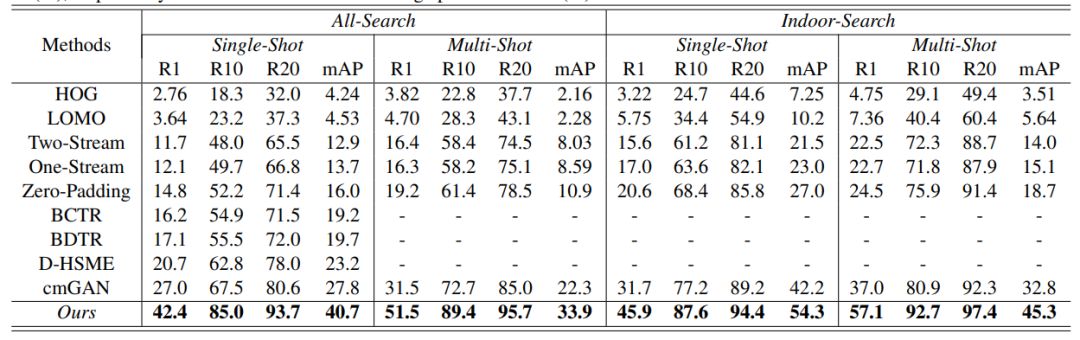

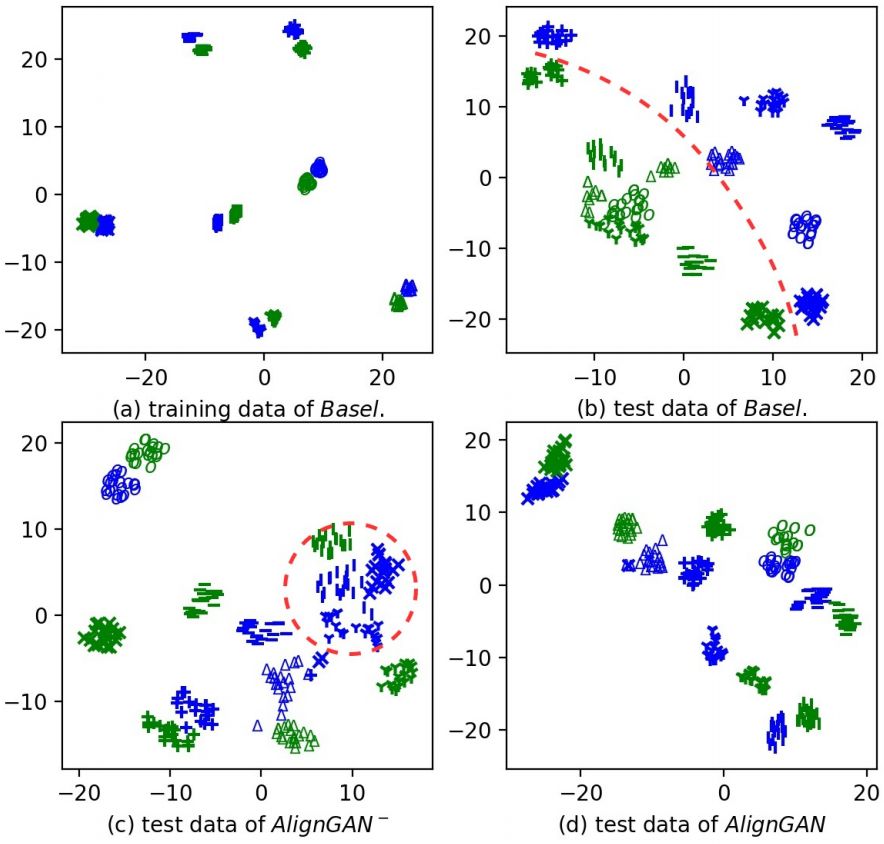

实验

06

结论

07

参考文献

展开全文

关键词

01

摘要

02

背景

03

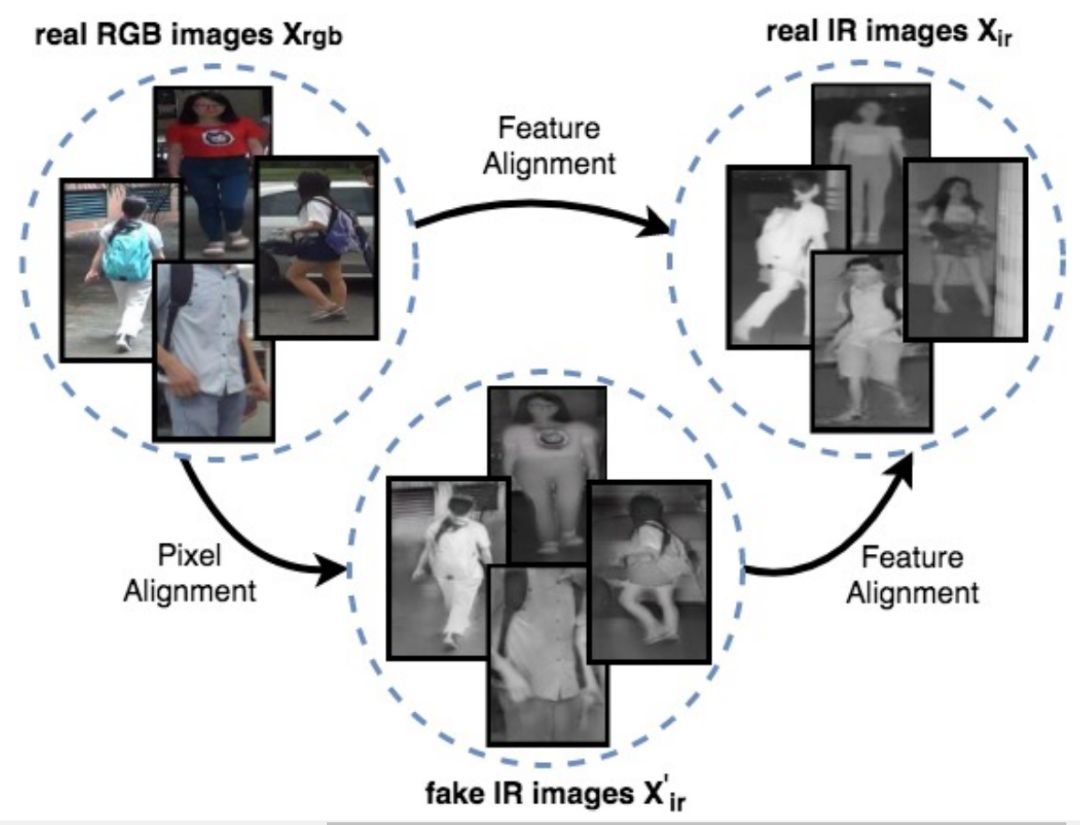

简介

04

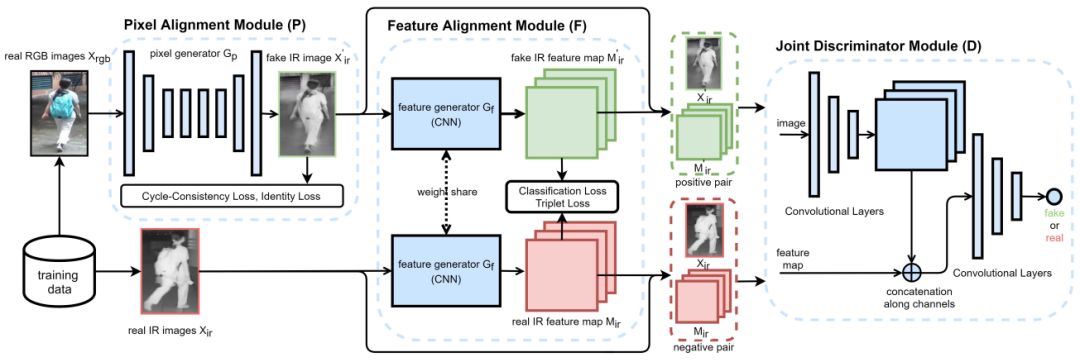

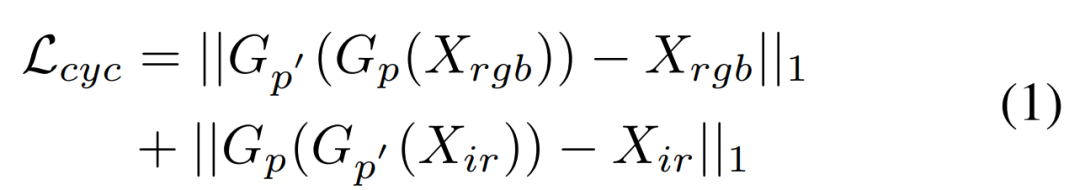

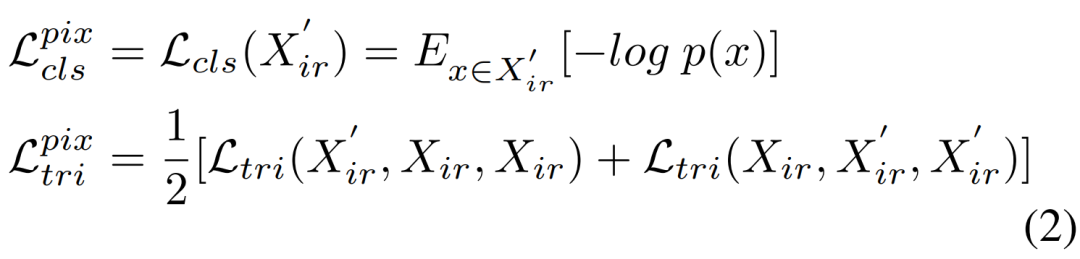

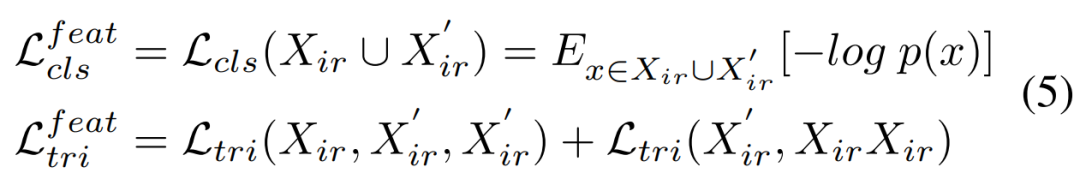

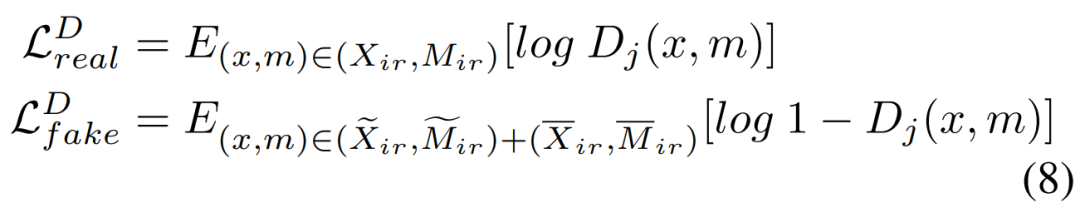

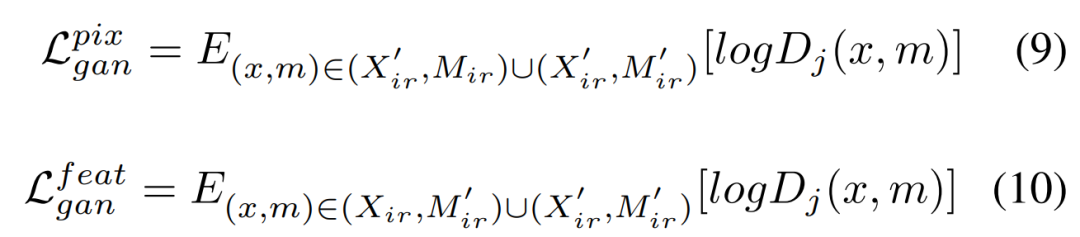

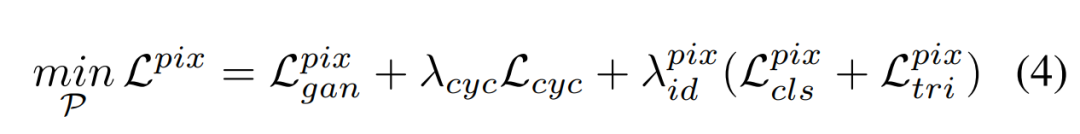

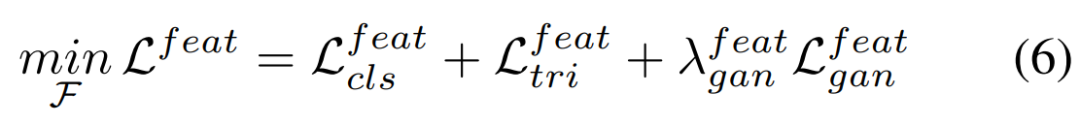

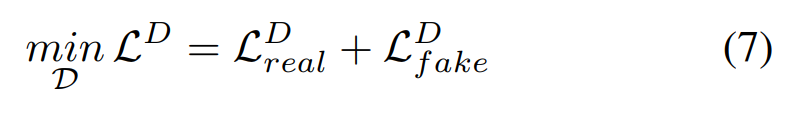

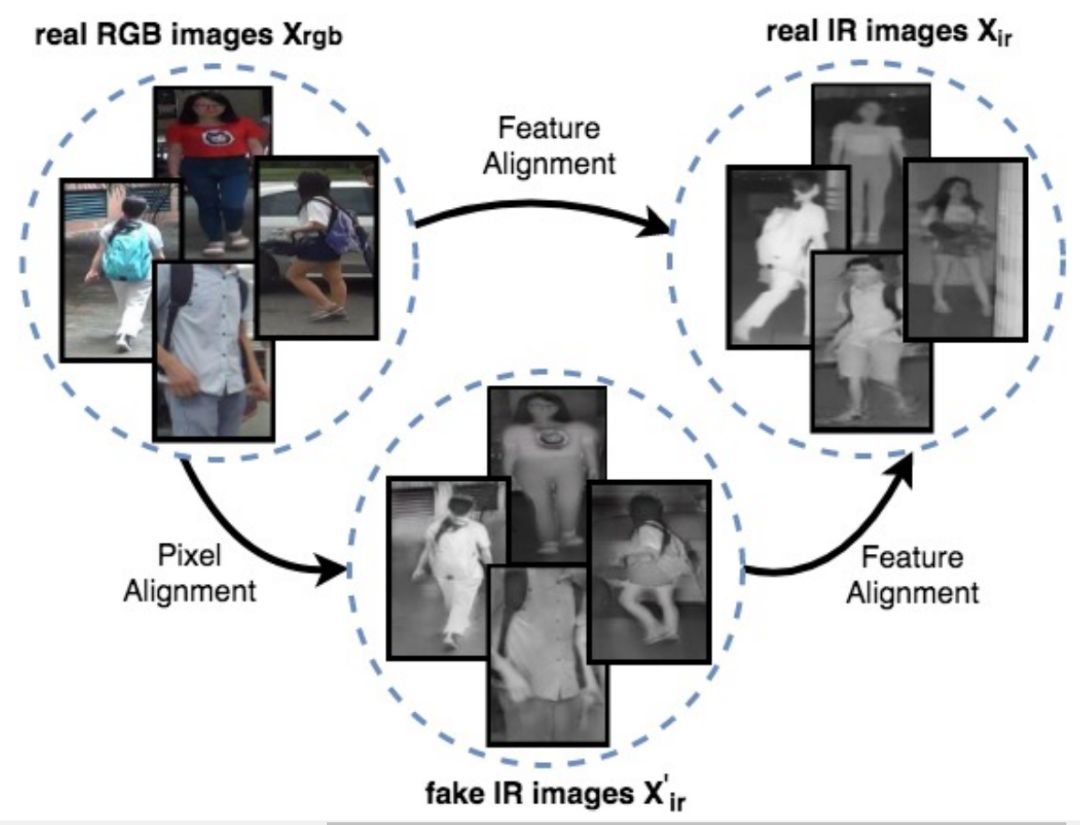

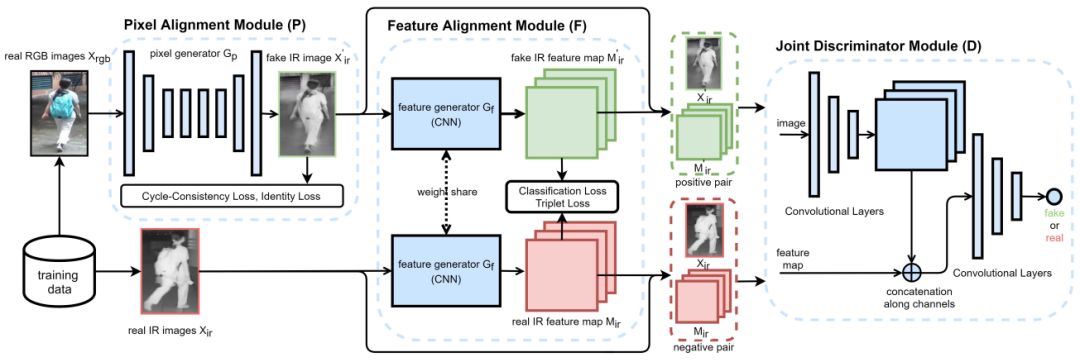

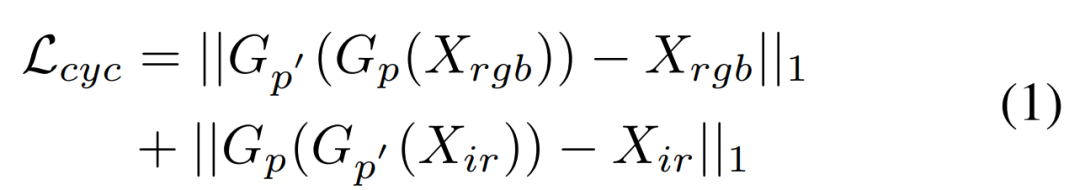

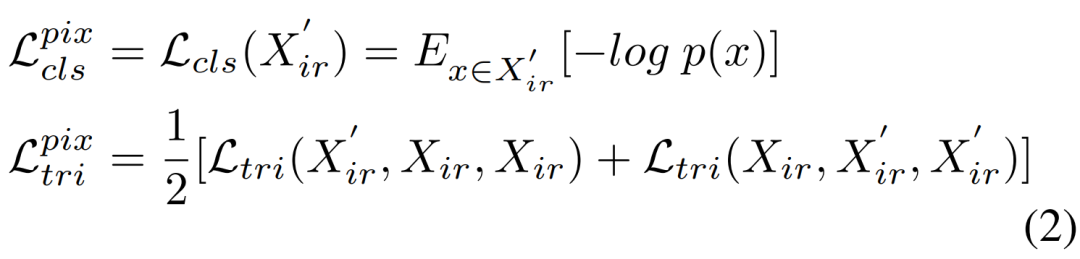

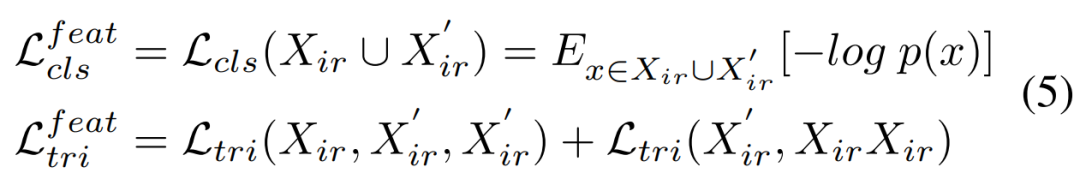

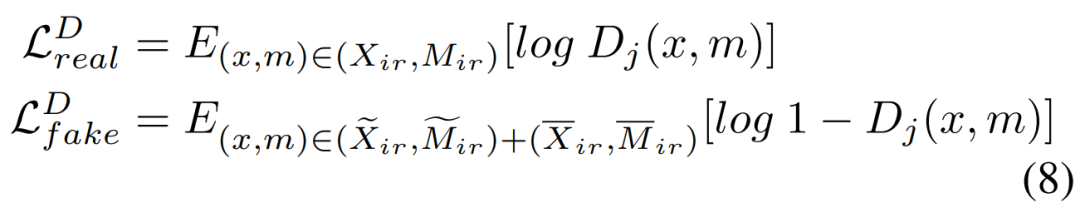

模型介绍

05

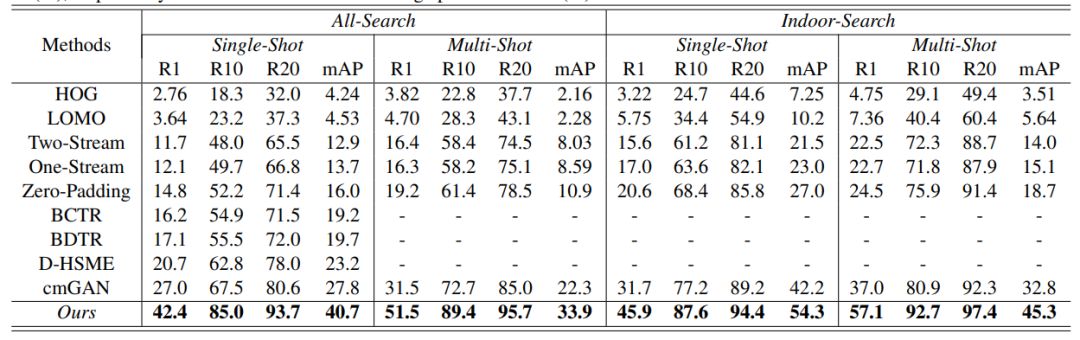

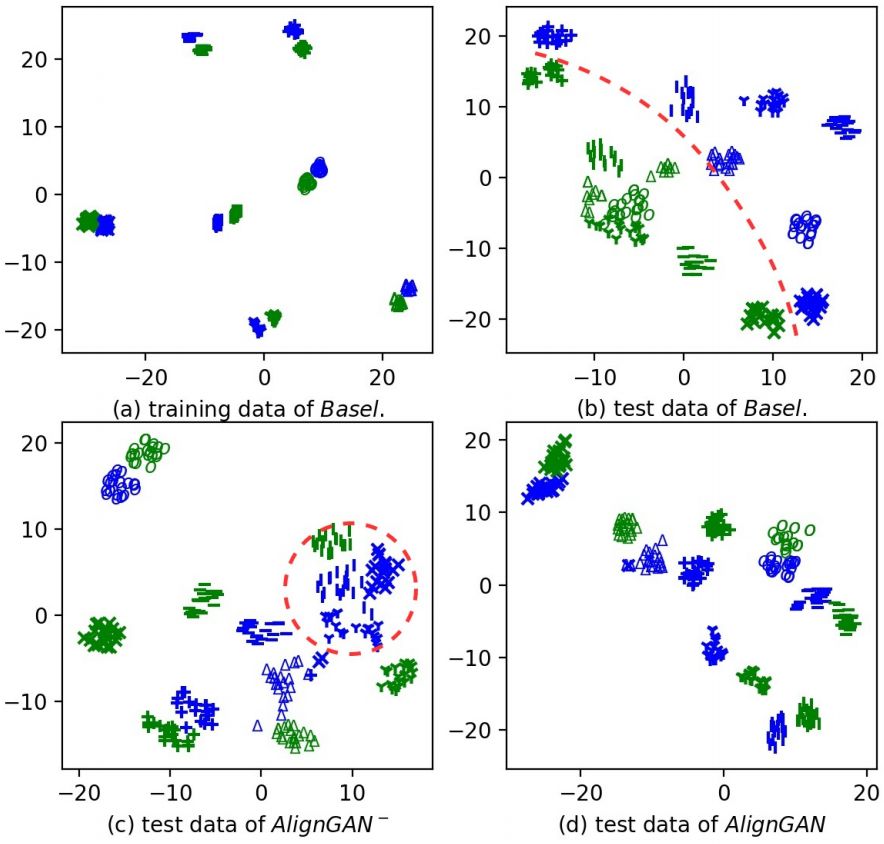

实验

06

结论

07

参考文献