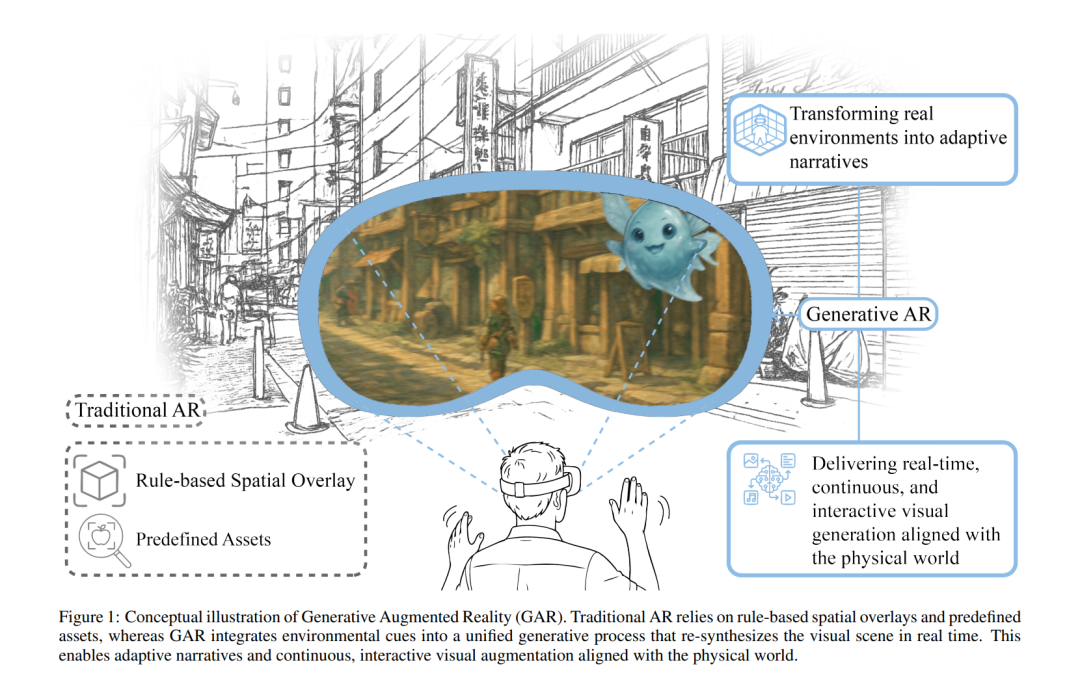

本文提出了**生成式增强现实(Generative Augmented Reality, GAR)这一下一代范式,将“增强”从传统 AR 引擎的世界组合(world composition)重新定位为一种世界再合成(world resynthesis)过程。GAR 以一个统一的生成式主干(unified generative backbone)取代传统 AR 引擎的多阶段模块,使环境感知、虚拟内容与交互信号能够作为条件输入,被联合编码(jointly encoded)**到连续视频生成过程中。 我们形式化地讨论了 AR 与 GAR 之间的计算对应关系,回顾了使实时生成式增强成为可能的技术基础,并概述了利用其统一推理模型的潜在应用前景。我们将 GAR 视为未来的 AR 范式,能够在真实感、交互性与沉浸感方面提供高保真体验,同时也带来了关于技术、内容生态系统,以及伦理与社会影响等方面的新研究挑战。 增强现实(Augmented Reality, AR)的出现源于长期以来人们希望将数字内容与基于用户真实世界感知与行动的物理环境相融合的目标。早期的相关形式包括 Thomas 和 David(1992)在飞机装配任务中叠加数字指令的研究,以及 Milgram 和 Kishino(1994)提出的“现实—虚拟(Reality–Virtuality)连续统”概念,这些工作将 AR 置于虚拟现实与物理现实之间的一种中间融合形态。随着感知、空间追踪以及实时渲染技术的进步 [Azuma, 1997a],能够使数字内容与真实物理场景对齐成为可能,AR 逐渐演化为一种技术框架,使用户能够将虚拟元素作为其周围环境的一部分进行感知和交互,并广泛应用于工业指导、教育、导航与交互媒体等领域。 然而,随着技术进步不断提升 AR 对内容保真度、交互精确性及自然响应性的要求,传统 AR 架构背后的组合式范式暴露出固有局限。现有系统通常依赖显式建模的资产(assets)、预定义的交互规则以及确定性的图形管线。这种结构使得合成高保真交互变得困难,例如流体材料行为、复杂机械动力学,甚至生物体的响应性。此外,扩展到更广阔、更具表现力的内容空间往往会增加内容创作负担并降低系统稳定性:生成高保真 3D 资产需要大量人工投入,但即便是精心制作的资产,其行为表现力仍然有限,使得真正响应式或逼真的交互难以实现。 与此同时,生成式模型的快速发展,尤其是基于扩散模型的视频生成模型 [Ho et al., 2022; Kong et al., 2024],引入了一种构建视觉体验的全新方式。这类模型能够在高层条件(如文本意图 [Luo et al., 2023]、运动提示 [Bai et al., 2025]、参考帧 [Hu, 2024] 或行为信号 [Guo et al., 2025])的驱动下,生成时间连贯、语义扎实的视频内容,覆盖并超越物理世界与想象世界的场景。与其将场景视为增强的固定背景,生成式视频模型将“现实”表示为一种可学习、可扩展的过程,其中物理一致性与时间演化在统一的潜空间中表达。随着此类模型逐步迈向实时推理 [Yin et al., 2025] 与可控流式生成 [Lin et al., 2025b],它们将计算重点从“叠加内容”转移至“在交互驱动下生成世界的演化”。 本文从概念与技术两方面,对生成式增强现实(Generative Augmented Reality, GAR)作为下一代空间计算(spatial computing)的计算框架,进行前瞻性综述。我们的主要贡献包括: • 形式化传统 AR 组合式管线向生成式世界再合成的计算转变,并从感知基础、控制流、资产管理与渲染机制等方面给出对比性表述。 • 综述支撑 GAR 的关键技术,包括流式视频生成模型、计算效率与质量优化、多模态控制机制以及资产管理方法。 • 分析 GAR 的未来应用图景,以及其在空间体验、具身创造、动态故事生成、协作式世界构建与混合现实生态系统方面的潜在变革能力。