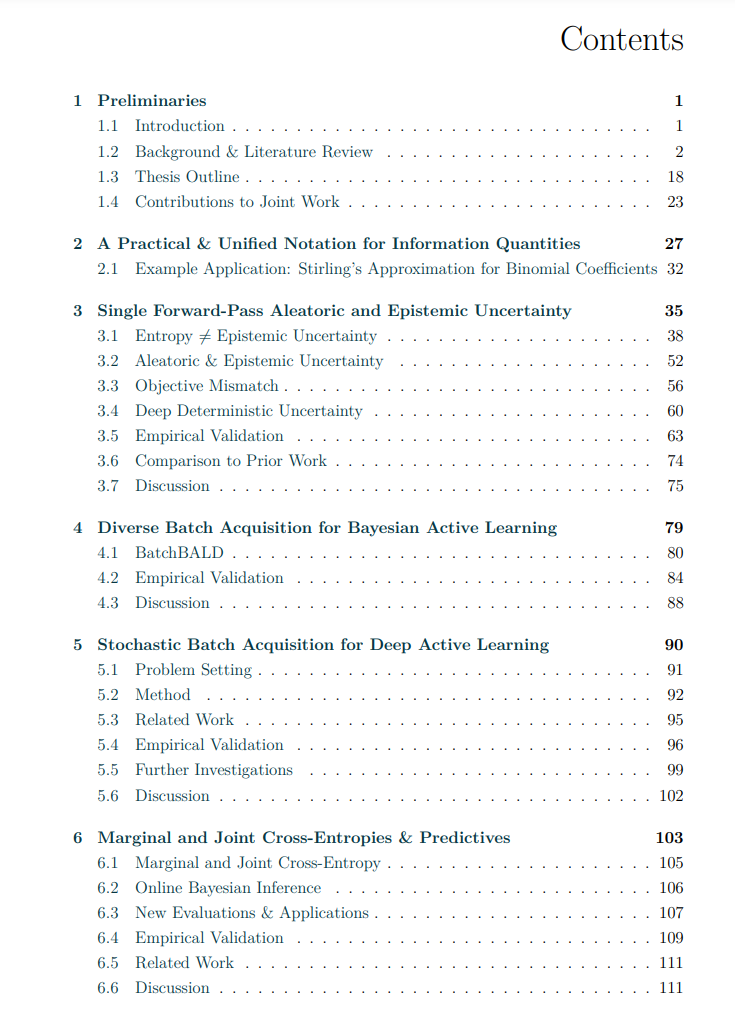

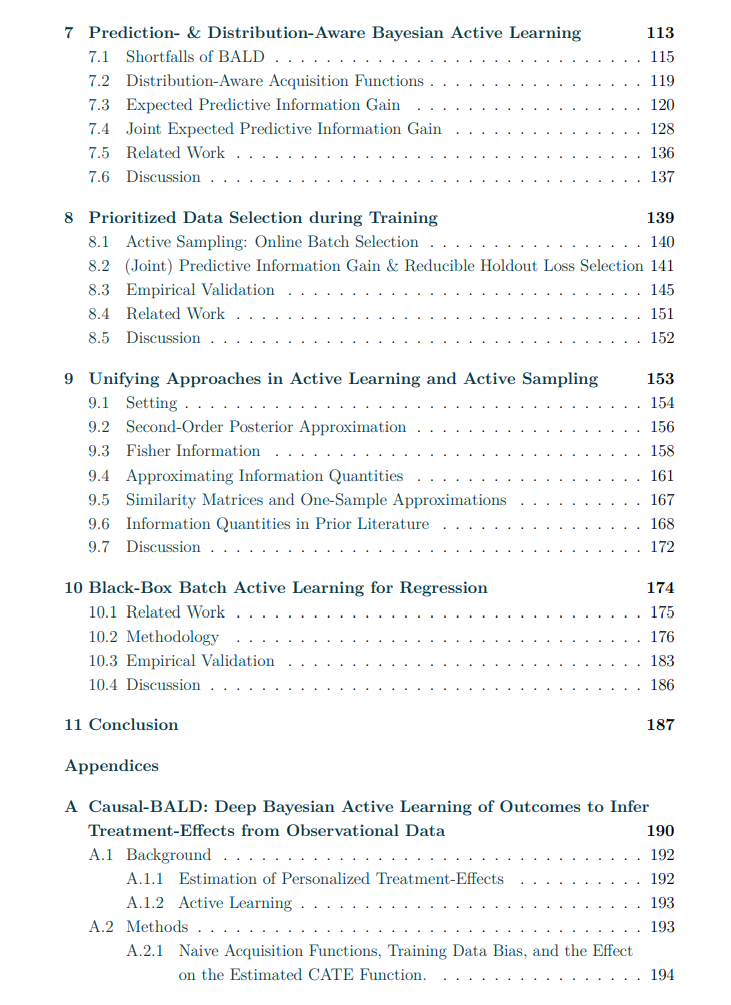

本论文的核心目标是通过提高深度学习模型的标签和训练效率来增强深度学习的实用性。为此,我们研究了基于信息论原理的数据子集选择技术,特别是主动学习和主动采样。主动学习提高了标签效率,而主动采样提高了训练效率。监督式深度学习模型通常需要大量的带标签数据进行训练。标签获取可能既昂贵又耗时,且训练大型模型资源密集型,这限制了其在学术研究和“大科技”公司之外的应用。深度学习中现有的数据子集选择方法通常依赖于启发式方法或缺乏一个原理化的信息论基础。相比之下,本论文检查了数据子集选择的几种目标及其在深度学习中的应用,力求采用一种由信息论启发的更原理化的方法。

我们首先在单次前向传播的深度神经网络中区分了认知不确定性和随机不确定性,这提供了有用的直觉和洞见,关于不同形式的不确定性及其对数据子集选择的相关性。然后,我们提出并研究了在(贝叶斯)深度学习中进行主动学习和数据子集选择的各种方法。最后,我们将各种现有和提出的方法与在权重或预测空间中信息量的近似联系起来。

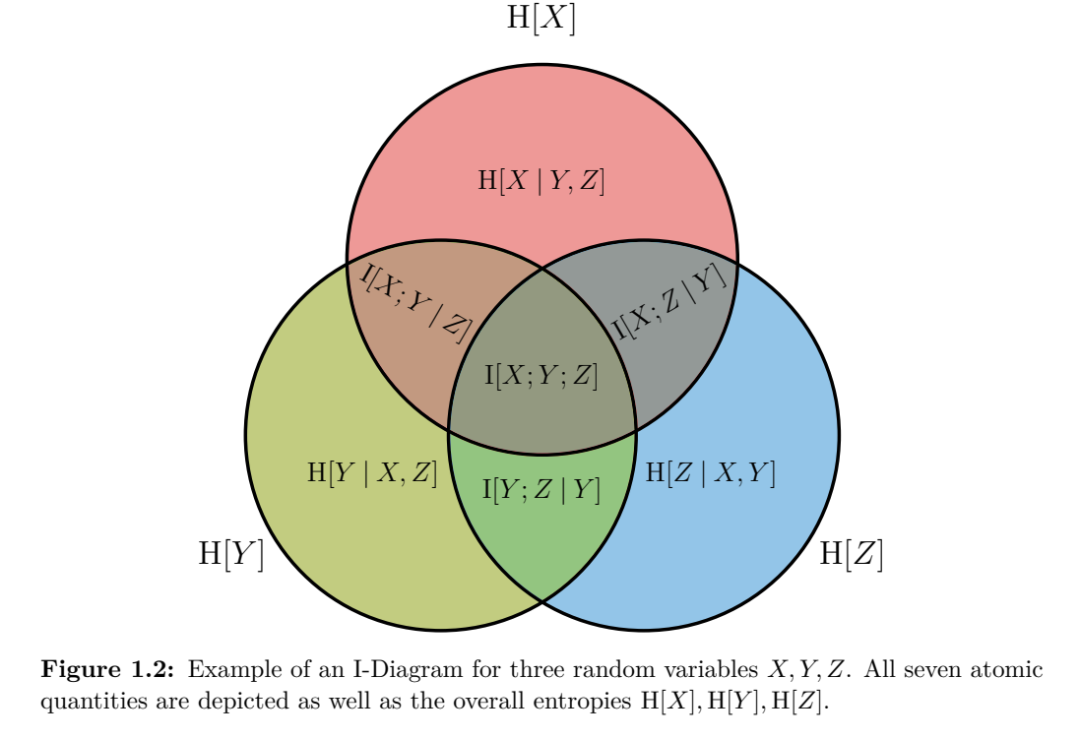

支撑这项工作的是一个原理化且实用的信息论量符号,包括随机变量和观察到的结果。这篇论文展示了从统一视角出发工作的好处,并强调了我们的贡献对深度学习实际应用潜在影响的可能性。

成为VIP会员查看完整内容

相关内容

Arxiv

86+阅读 · 2023年4月4日