导 读

本文是国际计算机视觉领域顶级会议 CVPR 2023入选论文 GFPose: Learning 3D Human Pose Prior with Gradient Fields 的解读。

该论文由北京通用人工智能研究院与北京大学王亦洲课题组、董豪课题组合作完成。该工作提出了一种基于分数扩散模型(score-based diffusion model)的三维人体姿态先验学习框架 GFPose,可在简洁统一的流程中完成多种生成式和判别式任务。实验结果表明,GFPose 在三维人体姿态估计、补全、生成和去噪等多种任务中展示出了优异的性能。代码已开源,具体地址见下方。 项目主页:

https://sites.google.com/view/gfpose/home 论文地址:

https://arxiv.org/abs/2212.08641 代码地址:

https://github.com/Embracing/GFPose

01

引 言

建模合理的三维人体姿态在虚拟现实和人机交互等应用中发挥着重要作用。考虑到肢体长度、关节灵活度等身体结构限制,人无法摆出任意的姿态,自然合理的人体姿态位于物理空间中的低维流形上。学习人体姿态的先验分布不仅有助于在姿态估计任务中区分不合理的人体姿态,而且还可用于采样生成丰富多样的人体姿态,在多种应用场景中具有广泛的用例。

现有的姿态先验学习方法可大致划分为两大类,一类方法使用 GMM[1]、VAE[2]、GAN[3]或者 neural implicit functions[4]学习姿态分布 ,然后通过设计特定的任务目标函数、引入额外的优化步骤将学到的先验知识引入具体的应用任务 中。另一类方法[5]则直接学习在特定任务条件下的条件先验 ,这类方法的好处是在应用到下游任务时不需要引入繁琐的优化步骤,可在学习的过程中更好地适应下游任务的要求。但现有的此类方法在学习时仅考虑了单一下游任务,应用灵活度有限。

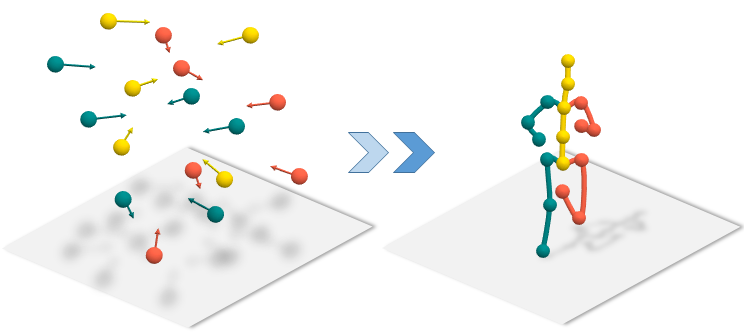

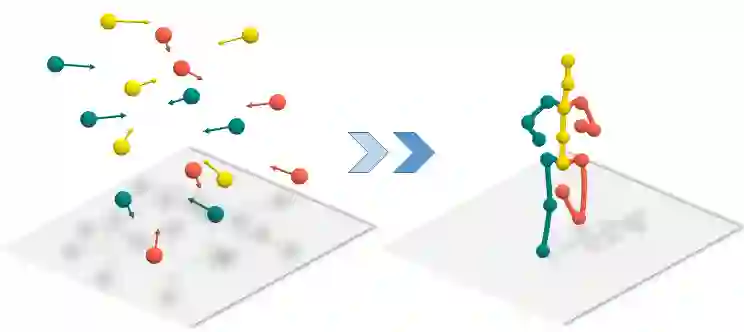

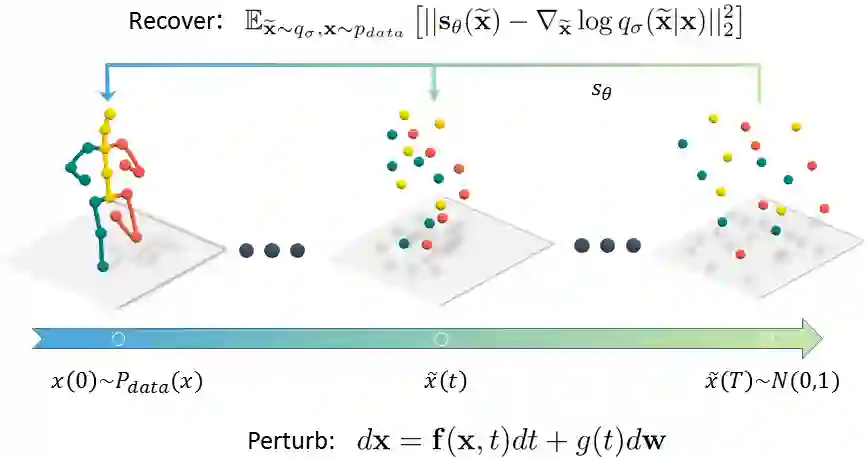

该工作采用了全新的视角来学习通用的三维人体姿态先验模型。具体来说,GFPose 基于分数扩散模型建模了任务条件分布的分数(对数似然的导数) ,它可以直观地看作定义在人体关节上的梯度场,梯度的方向指向了使姿态更加合理的方向。为了增强通用性和灵活性,GFPose 引入了掩码训练机制(masked training),通过随机掩码的方式训练时在多种下游任务 间自由切换。

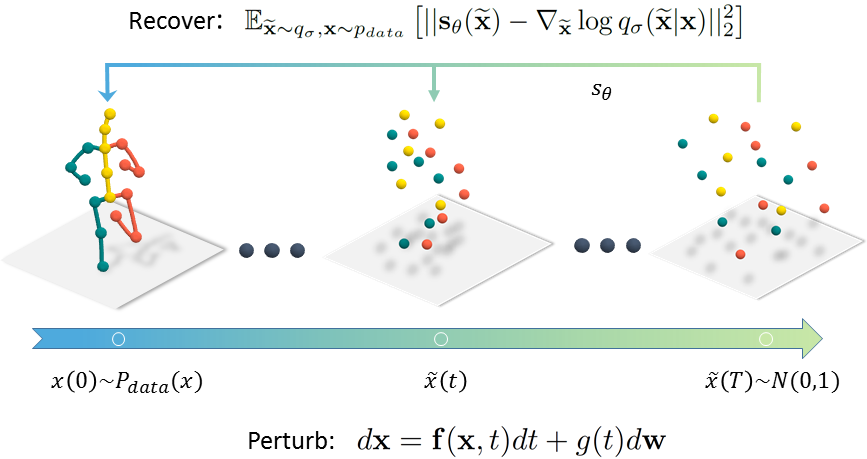

GFPose 训练过程

02

方 法

GFPose的训练采用了去噪分数匹配法(denoising score matching)[6],如上图所示。首先,它通过预定义的随机微分方程扰动人体姿态: 之后利用分数匹配 loss 训练分数估计网络 : 理想的分数估计网络 满足: GFPose 将任务条件 表示为关节点三维空间位置 ,训练时在其上引入随机分层条件掩码,包含人体、肢体、关节三种掩码层级以及2D、3D 两种掩码模式,统一姿态估计、遮挡场景下的姿态恢复和补全以及姿态生成等多种应用。

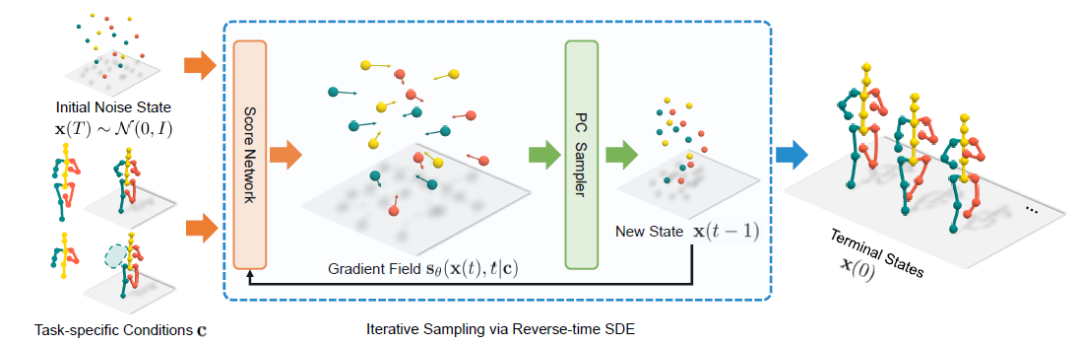

在推理时,GFPose 通过模拟逆向 SDE 将加噪扰动过程翻转,即可从随机采样的高斯噪声中获得合理的人体姿态:

GFPose 采样过程

03

结 果

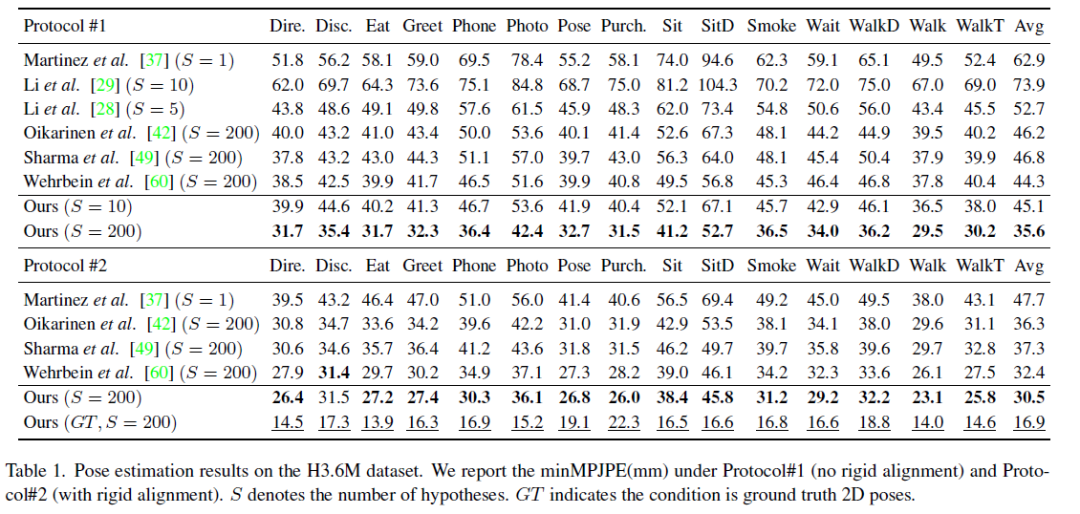

实验数据表明,GFPose 在多假设三维人体姿态估计、遮挡场景下的三维人体姿态估计、三维人体姿态补全、生成和去噪等任务中均表现优异。

多假设三维人体姿态估计

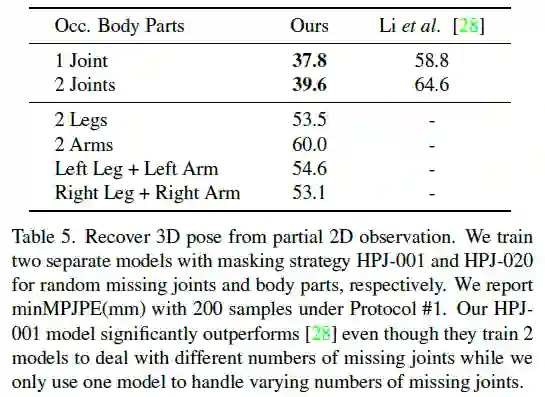

遮挡场景下的三维人体姿态估计

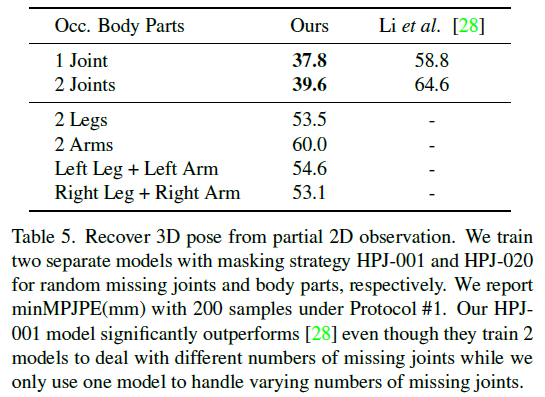

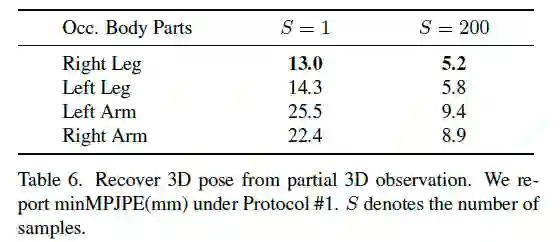

残缺三维人体姿态补全

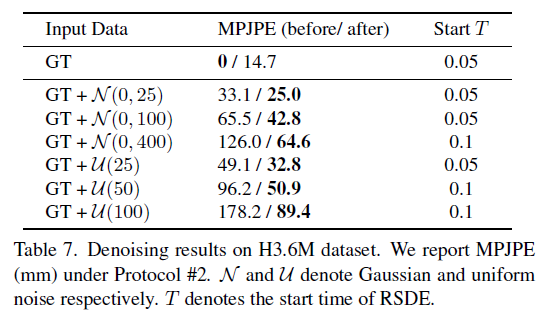

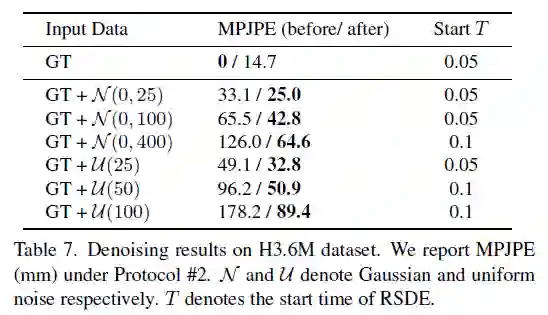

三维人体姿态去噪

三维人体姿态生成

可视化工具

本项目额外提供了交互式可视化工具,用于可视化扩散过程和生成结果。详情请见项目地址。

04

结 论

本文介绍了一种通用的三维人体姿态先验学习框架 GFPose,通过分数扩散模型对合理的三维人体姿态进行建模,并进一步提出了一种条件掩码策略来增强该框架的通用性,使其可无缝应用于多种下游任务。实验展示了 GFPose 广阔的应用前景。

参考文献

[1] Federica Bogo, Angjoo Kanazawa, Christoph Lassner, Peter Gehler, Javier Romero, and Michael J Black. Keep it smpl: Automatic estimation of 3d human pose and shape from a single image. In ECCV 2016. [2] Georgios Pavlakos, Vasileios Choutas, Nima Ghorbani, Timo Bolkart, Ahmed AA Osman, Dimitrios Tzionas, and Michael J Black. Expressive body capture: 3d hands, face, and body from a single image. In CVPR 2019. [3] Andrey Davydov, Anastasia Remizova, Victor Constantin, Sina Honari, Mathieu Salzmann, and Pascal Fua. Adversarial parametric pose prior. In CVPR 2022. [4] Garvita Tiwari, Dimitrije Anti ́c, Jan Eric Lenssen, Nikolaos Sarafianos, Tony Tung, and Gerard Pons-Moll. Pose-ndf: Modeling human pose manifolds with neural distance fields. In ECCV 2022. [5] Davis Rempe, Tolga Birdal, Aaron Hertzmann, Jimei Yang, Srinath Sridhar, and Leonidas J Guibas. Humor: 3d human motion model for robust pose estimation. In ICCV 2021. [6] Yang Song, Jascha Sohl-Dickstein, Diederik P Kingma, Abhishek Kumar, Stefano Ermon, and Ben Poole. Score-based generative modeling through stochastic differential equations. arXiv preprint arXiv:2011.13456, 2020.

图文 | 兹海 Computer Vision and Digital Art (CVDA)