实现真实世界中的机器人安全不仅仅意味着规避风险,更在于有效地识别、管理并应对风险。

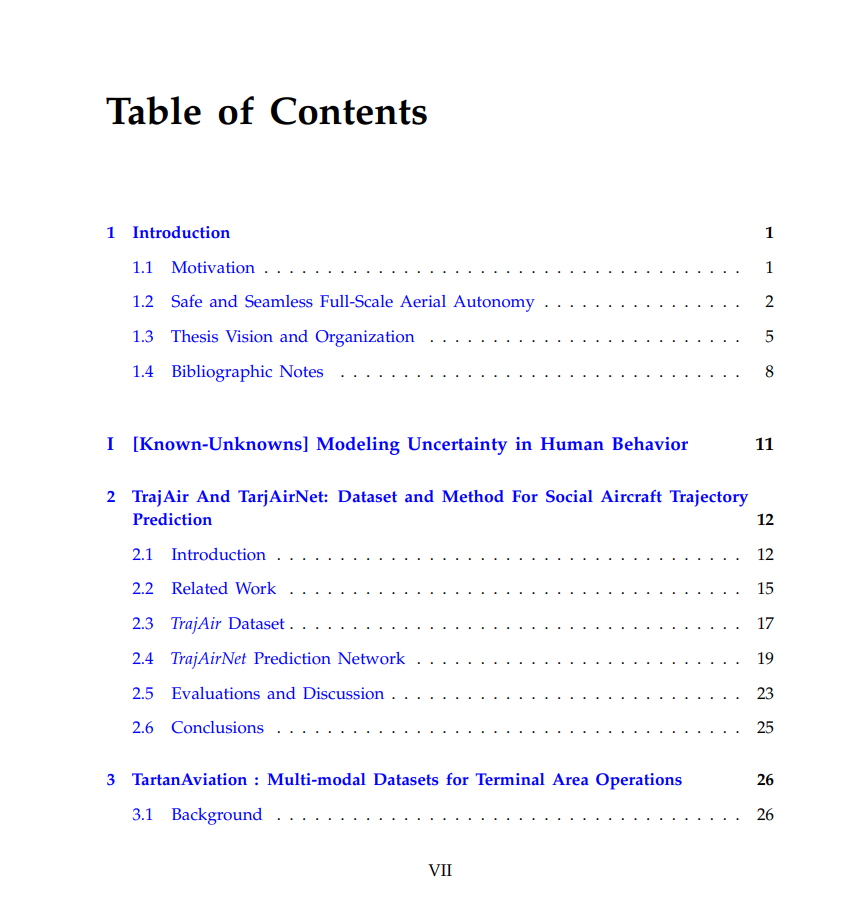

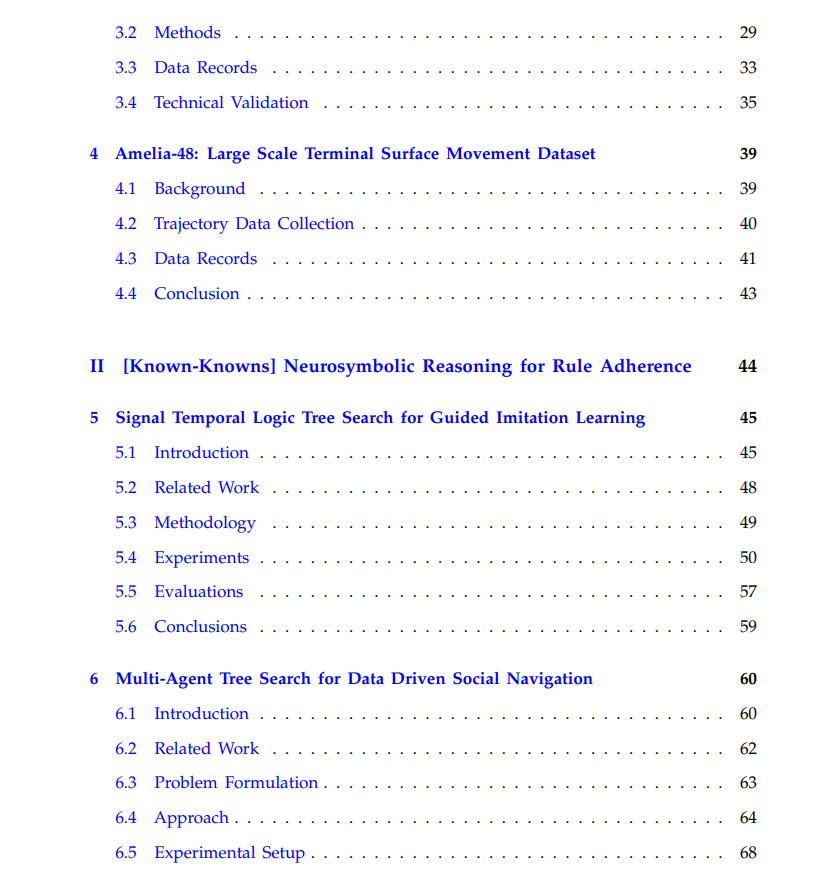

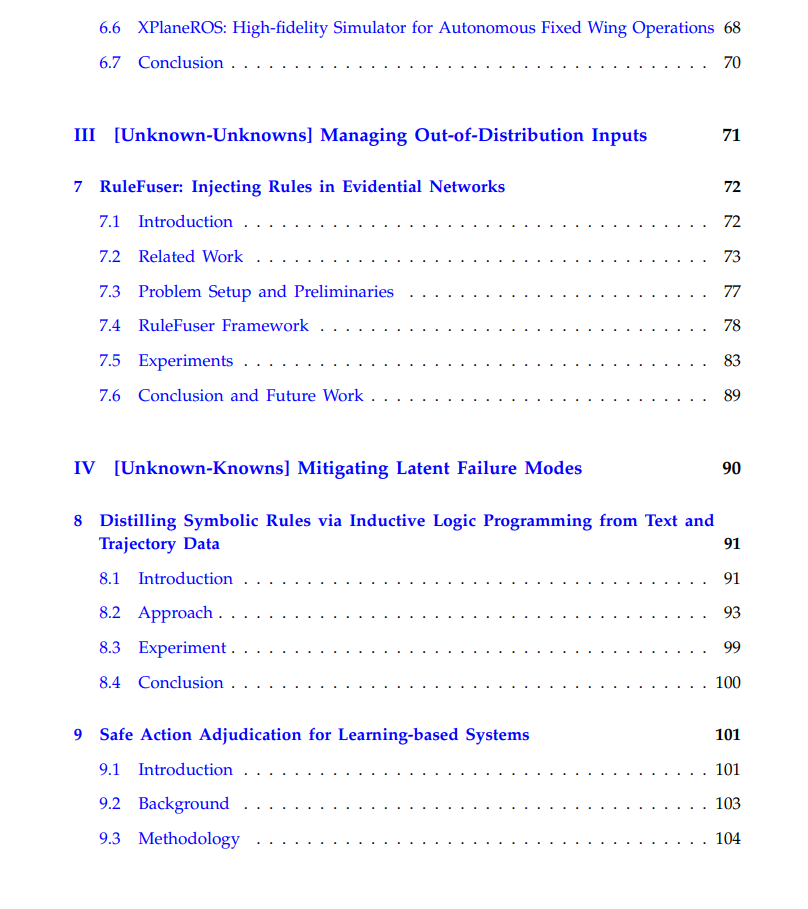

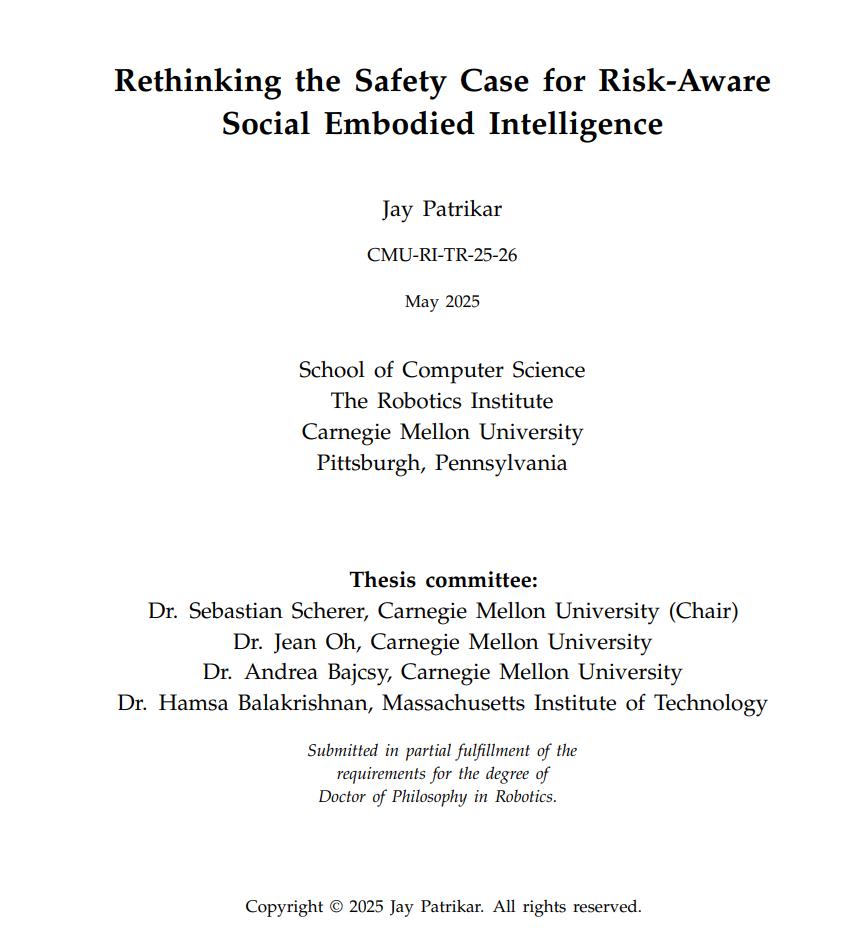

本论文提出了一种面向风险感知决策与行为建模的安全保障体系(Safety Case),适用于复杂的多智能体环境,例如航空和自动驾驶等应用场景。我们认为,真正的安全性源自智能体以下能力:预测不确定性、推理他者意图,并在由先验知识、行为规范、社会语境及历史经验所界定的操作边界内行动。 为了实现安全且可解释的决策过程,本研究将**蒙特卡洛树搜索(MCTS)与逻辑规范(logic specification)相结合,整合进学习策略中,以提升单智能体和多智能体场景下的规则遵循能力。我们提出了一种基于归纳逻辑编程(Inductive Logic Programming, ILP)**的符号规则挖掘方法,可从轨迹数据与事故报告中提取可解释的行为约束。

针对分布外风险(out-of-distribution risk),我们设计了一个融合框架,将**神经模仿学习(neural imitation learning)与符号规则系统(symbolic rule-based systems)结合,提升泛化与安全性。此外,为缓解模型偏差带来的风险,我们探讨了结合检索增强生成(Retrieval-Augmented Generation, RAG)**与事故报告的方式,以实现复杂环境下基于真实数据的行动裁决(action arbitration)。 在航空领域的真实行为学习方面,我们构建并发布了三个关键数据集: * TrajAir:一个面向社交空中导航的轨迹数据集; * TartanAviation:一个用于意图推理的时间同步多模态数据集; * Amelia-48:覆盖美国多个机场的大规模地面滑行数据集,用于空中交通管理中的预测分析任务。

综上所述,本论文提出的理论框架、方法工具及数据集资源,支持自主系统在不确定性环境中推理、多元先验整合与复杂真实世界中的稳健运行。