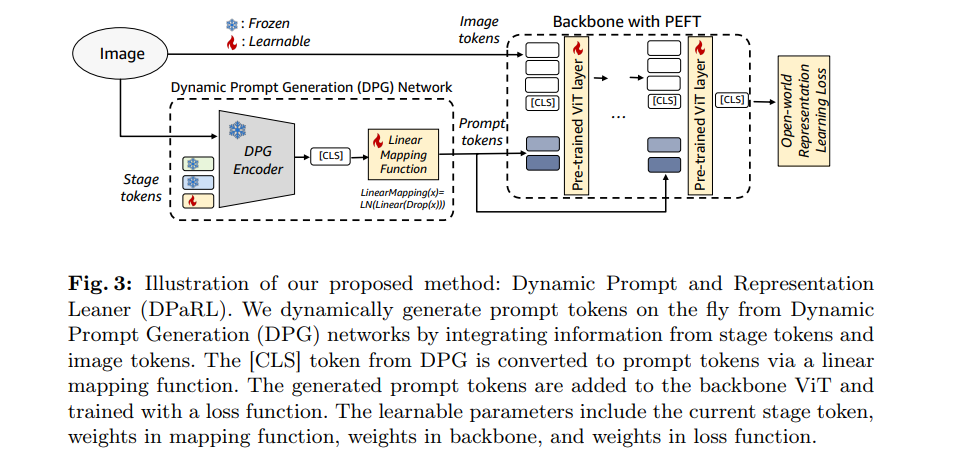

开放世界本质上是动态的,其特征是不断演变的概念和分布。在这种动态开放世界环境中,持续学习 (CL) 面临着如何有效泛化到未见测试类别的重大挑战。为应对这一挑战,我们引入了一种新的实际 CL 设置,专为开放世界的视觉表征学习设计。在该设置中,后续数据流系统地引入了与先前训练阶段中所见类别不相交的全新类别,同时这些类别也与未见测试类别保持区别。对此,我们提出了动态提示与表征学习器 (DPaRL),这是一种简单但有效的基于提示的持续学习 (PCL) 方法。我们的 DPaRL 学会为推理生成动态提示,而不是依赖于以往 PCL 方法中的静态提示池。此外,DPaRL 在每个训练阶段共同学习动态提示生成和判别性表征,而以往的 PCL 方法仅在整个过程中细化提示学习。实验结果表明,我们的方法优于现有的最先进方法,在公认的开放世界图像检索基准上平均提高了 4.7% 的 Recall@1 性能。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

224+阅读 · 2023年4月7日