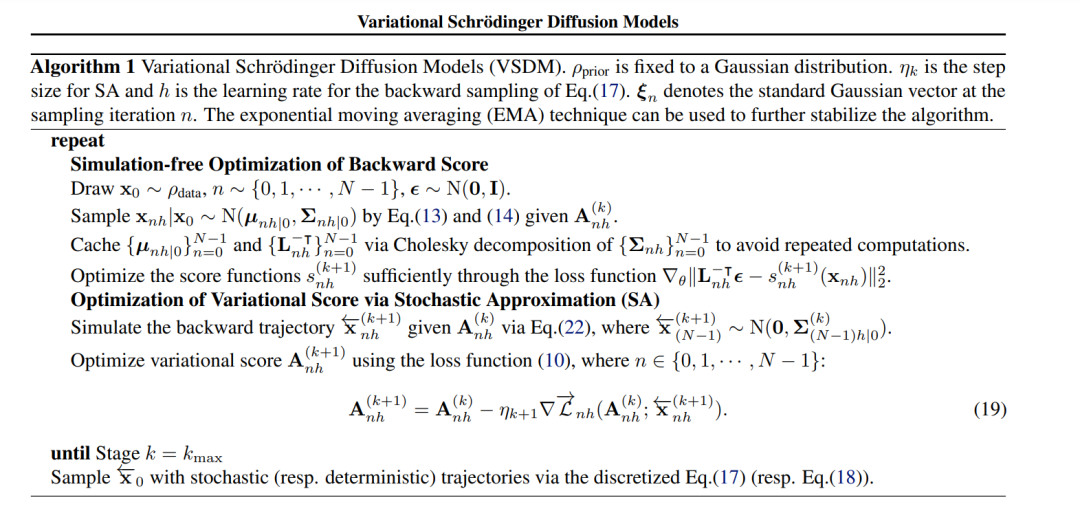

薛定谔桥(SB)已成为扩散模型中优化运输计划的首选方法。然而,SB需要估计难以处理的正向得分函数,不可避免地导致基于模拟轨迹的昂贵隐式训练损失。为了提高可扩展性同时保持有效的运输计划,我们利用变分推断来线性化SB的正向得分函数(变分得分),并在训练反向得分时恢复无模拟的属性。我们提出了变分薛定谔扩散模型(VSDM),其中前向过程是多变量扩散,变分得分被适应性优化以实现高效运输。从理论上讲,我们使用随机逼近法证明了变分得分的收敛性,并展示了基于最优变分得分生成的适应性样本的收敛性。从经验上讲,我们在模拟示例中测试了该算法,并观察到VSDM在生成各向异性形状方面的效率,并与单变量扩散相比产生了更直的样本轨迹。我们还验证了该算法在实际数据中的可扩展性,并在CIFAR10的无条件生成性能和时间序列建模的条件生成中取得了竞争性表现。值得注意的是,VSDM不再依赖于热身初始化,并已成为在大规模实验训练中调优友好。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日