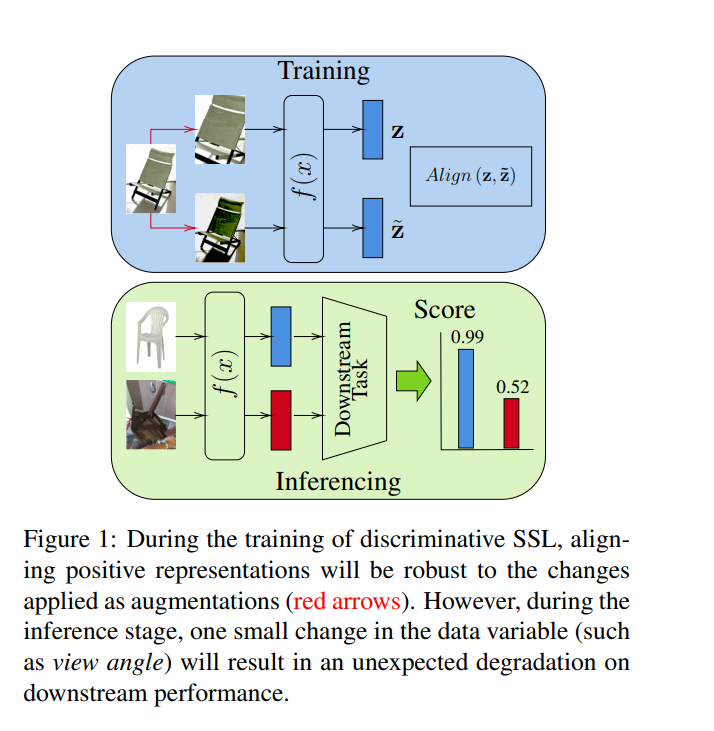

近年来,判别性自监督方法在推进各种视觉任务方面取得了显著进展。学习对数据失真/增强鲁棒的数据编码器的核心思想虽然简单,但非常有效。尽管许多研究已经证明了各种学习方法的实证成功,但所学到的表示可能表现出不稳定性,从而妨碍了下游性能。在本研究中,我们从因果关系的角度分析判别性自监督方法,以解释这些不稳定的行为,并提出解决方案。我们的方法受到先前工作的启发,这些工作实证地证明了判别性自监督方法在一定程度上解混真实因果源的能力。与之前关于因果性强化表示学习的工作不同,我们并不在训练过程中应用我们的解决方案,而是在推理过程中应用,以提高时间效率。通过在受控的图像数据集和真实的图像数据集上的实验,我们展示了我们提出的解决方案,即使用受控的合成数据对线性变换进行调整,可以有效地解决这些问题。

https://www.zhuanzhi.ai/paper/a12a83a223e43673f6a8d0368b20e490

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日