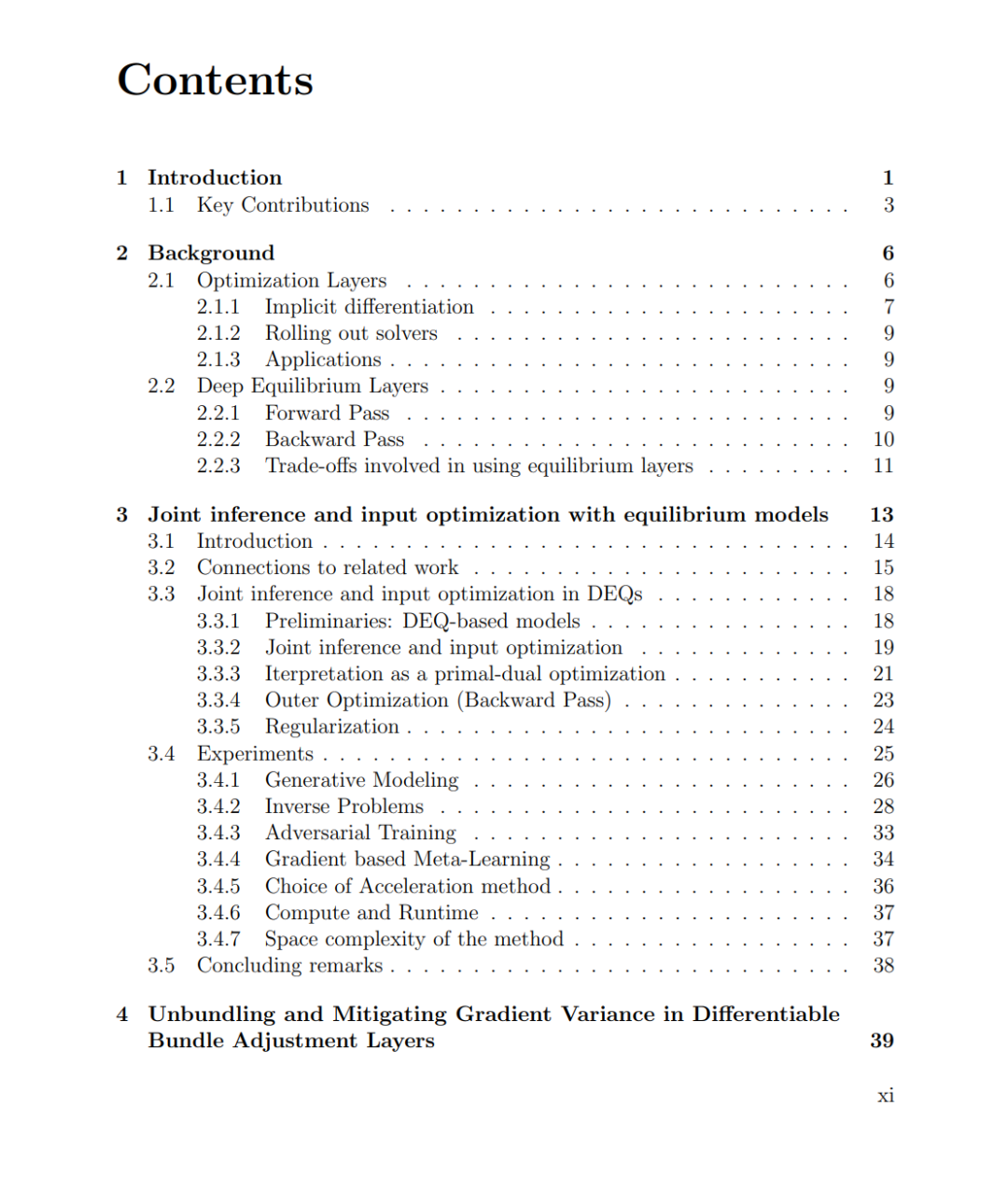

从机器人控制到资源管理,许多现实世界问题都可以被有效地表述为优化问题。近年来的研究重点逐渐转向将这些优化问题作为层(optimization layers)嵌入深度学习管线,从而能够显式地引入辅助约束或代价函数。这一机制对于需要强制满足物理定律、确保安全约束或优化复杂目标的应用至关重要。然而,这类优化层也带来了诸多挑战,包括推理效率低下、训练动态不稳定、建模不精确以及表示效率不足等问题,必须加以解决,才能充分发挥其潜力。 我们系统地研究了这些挑战,并提出了一系列新的数值方法与体系结构解决方案,以提升优化层在深度学习管线中的效率与效果。我们的贡献包括: * 计算效率提升方法:利用优化问题的迭代特性来加速求解过程; * 梯度偏差与方差控制:在高维问题中通过并行化与网络学习到的系统先验(network-learnt priors)来缓解梯度不稳定; * 强化学习中的样本效率提升:利用近似仿真器改进策略学习效率; * 复杂约束优化层的表征改进:在优化器状态与网络输出之间建立紧密的反馈回路,从而增强模型的可表达性与稳定性。

我们在多个应用场景中验证了这些贡献,包括输入优化问题、三维姿态估计与重建、可微模型预测控制(differentiable model predictive control)以及强化学习任务。此外,我们还提出了一种用于纳卫星(nanosatellite)视觉惯性导航的新方法,展示了在复杂现实环境中集成优化层的实际优势。 总体而言,这些研究成果深化了我们对在深度学习模型中集成优化层所面临的复杂性与潜在机遇的理解,提出了新的框架与洞见,从而在多种复杂任务中显著提升了模型的效率、稳定性与泛化能力。

成为VIP会员查看完整内容

相关内容

Arxiv

219+阅读 · 2023年4月7日