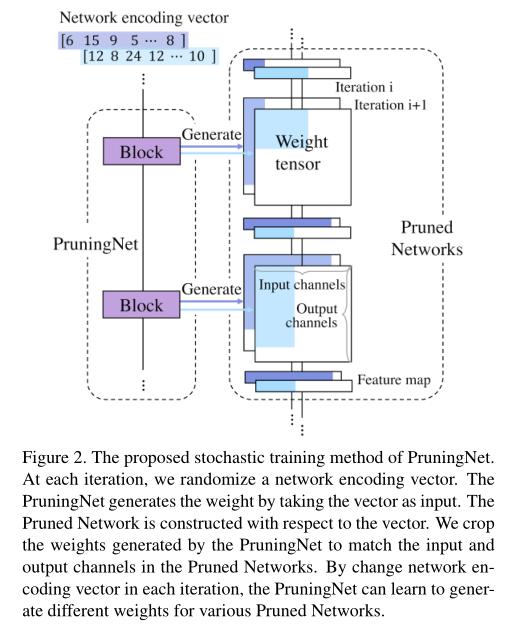

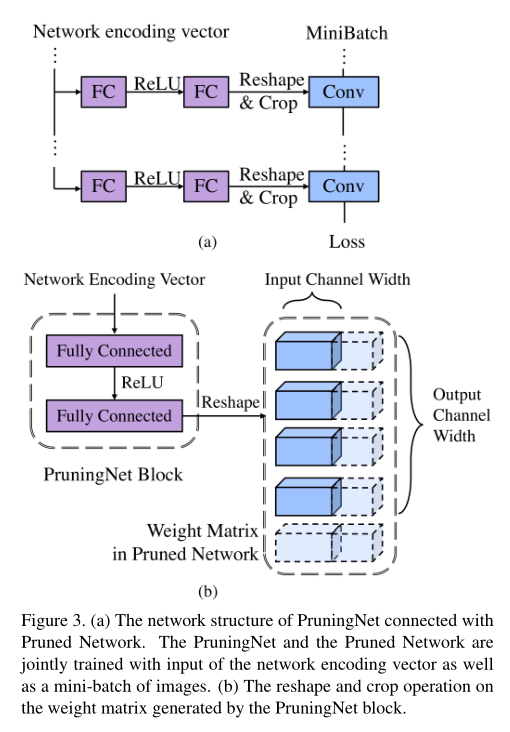

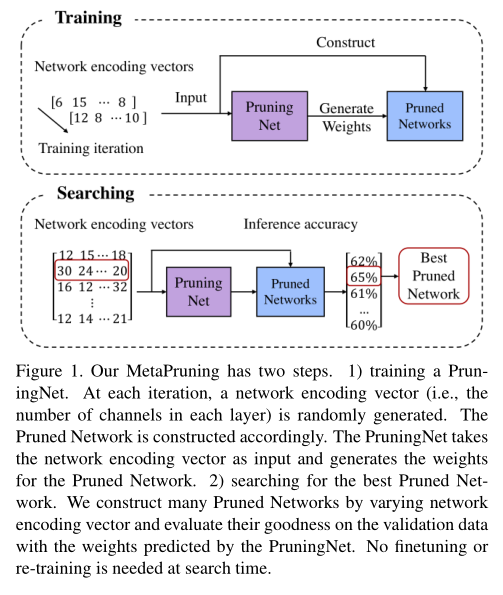

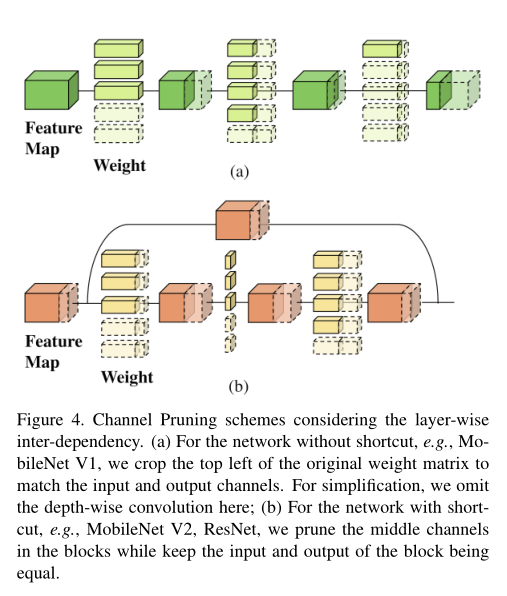

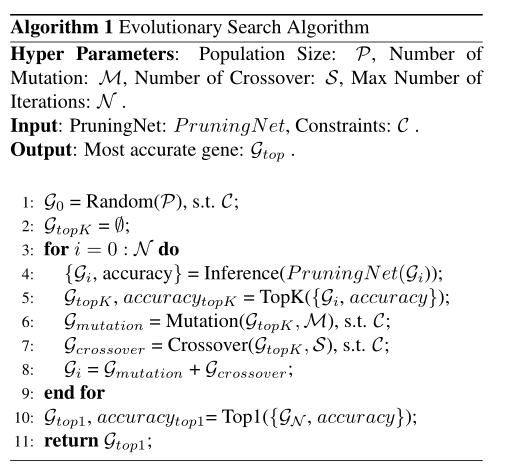

摘要: 在这篇论文中,我们提出了一种新的元学习方法来自动修剪非常深的神经网络的通道。我们首先训练一个剪枝网络,这是一种元网络,它能够为给定目标网络的任何剪枝结构生成权重参数。我们使用一种简单的随机结构抽样方法来训练剪枝网络。然后,我们应用进化过程来搜索性能良好的修剪网络。由于权值是由经过训练的剪枝网络直接生成的,因此在搜索时不需要进行任何调整,因此搜索效率很高。通过对目标网络的单一剪枝网络进行训练,我们可以在不需要人工参与的情况下搜索不同约束条件下的各种剪枝网络。与最先进的修剪方法相比,我们在MobileNet V1/V2和ResNet上表现出了优异的性能。

成为VIP会员查看完整内容

相关内容

北京旷视科技有限公司由印奇、唐文斌、杨沐三人2011年创办于北京市海淀区中关村, 致力于打造服务于各商业领域的AIoT操作系统,以及构建具备连接物联网设备能力的生态系统。 在北京、上海、深圳、成都、南京、杭州、武汉、宁波、青岛、徐州、美国西雅图等地设有研发中心和运营机构。

官方网站:https://www.megvii.com/

专知会员服务

23+阅读 · 2020年7月1日