今日 Paper | 医学图像中的深度学习;元强化学习;深度神经网络的无损压缩等

目录

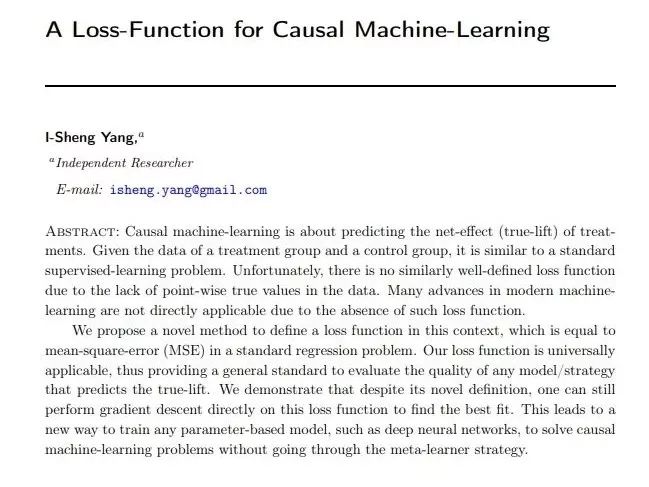

A Loss-Function for Causal Machine-Learnin

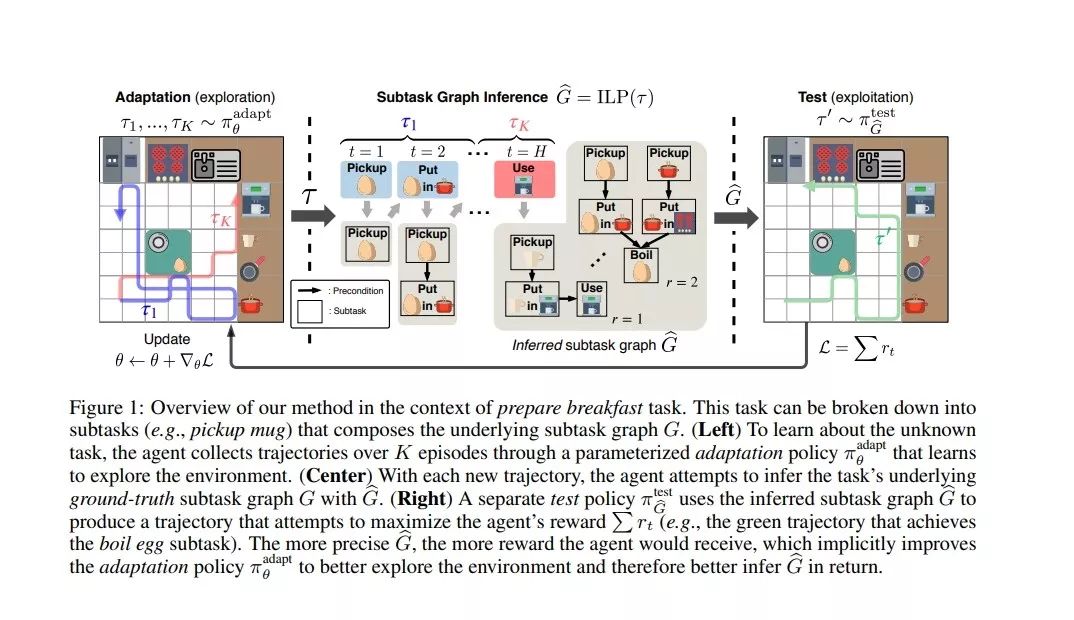

Meta Reinforcement Learning with Autonomous Inference of Subtask Dependencie

Wide Neural Networks with Bottlenecks are Deep Gaussian Processe

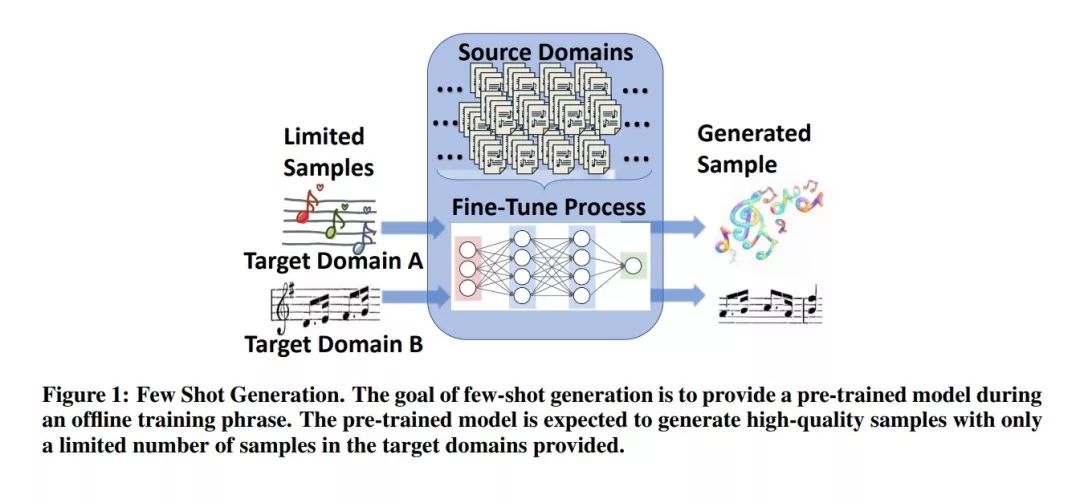

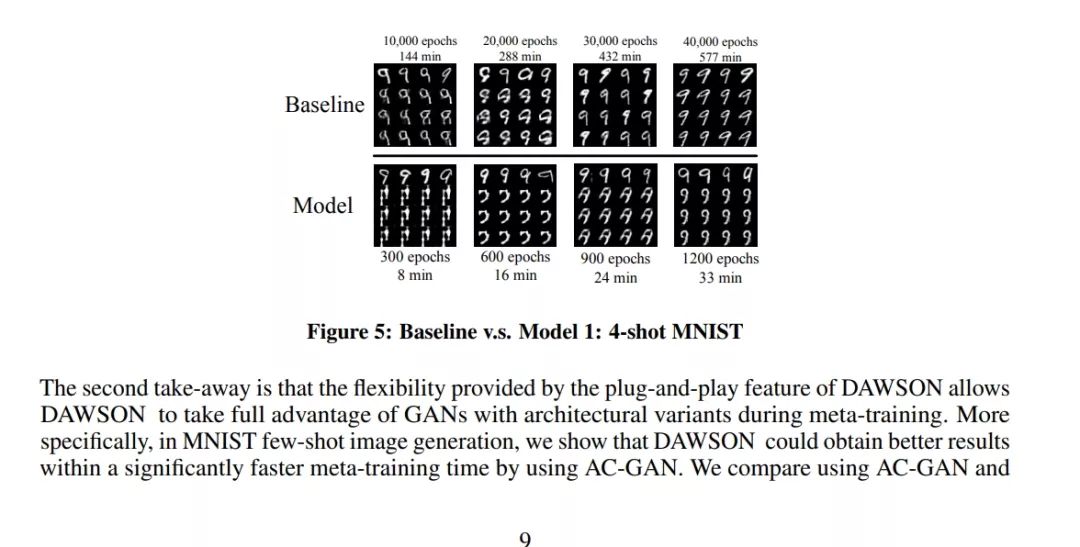

DAWSON: A Domain Adaptive Few Shot Generation Framewor

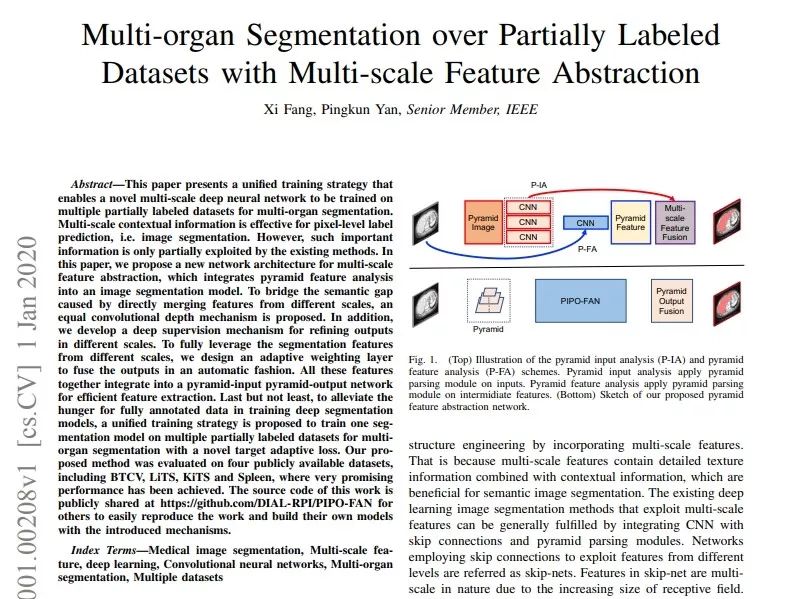

Multi-organ Segmentation over Partially Labeled Datasets with Multi-scale Feature Abstractio

Deep Learning in Medical Image Registration: A Revie

Fast and deep neuromorphic learning with time-to-first-spike codin

End-to-end Named Entity Recognition and Relation Extraction using Pre-trained Language Model

Localized Debiased Machine Learning: Efficient Estimation of Quantile Treatment Effects, Conditional Value at Risk, and Beyond

因果机器学习的损失函数

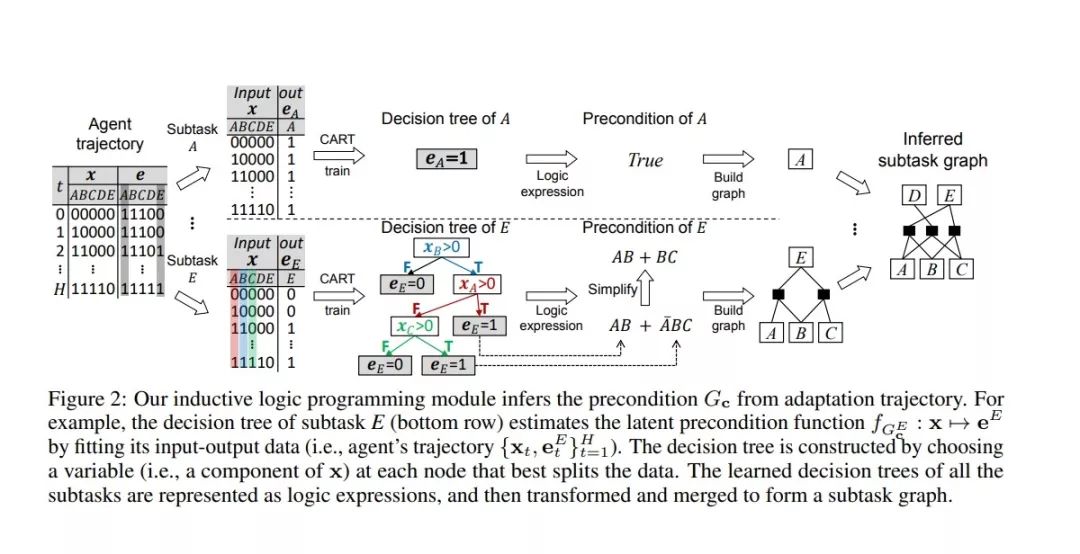

具有子任务依赖项的自主推断的元强化学习

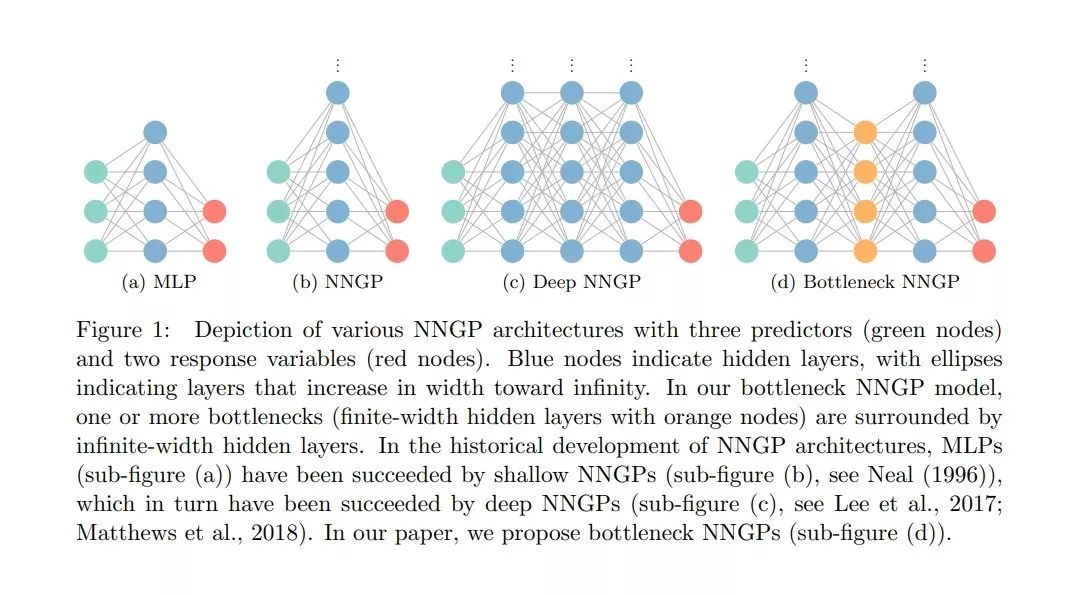

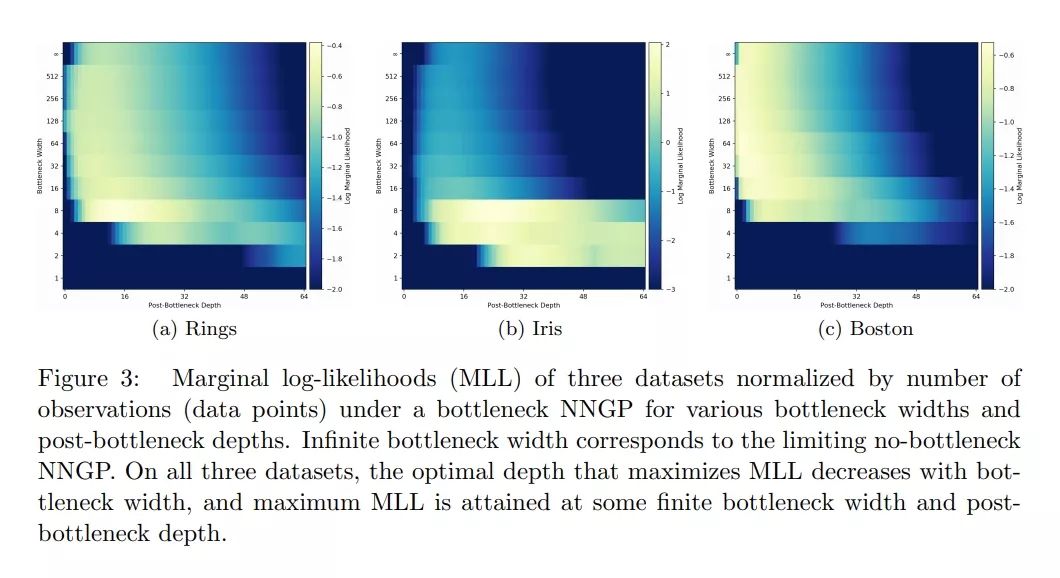

具有瓶颈的宽泛神经网络是高斯过程

DAWSON:域自适应少量镜头生成框架

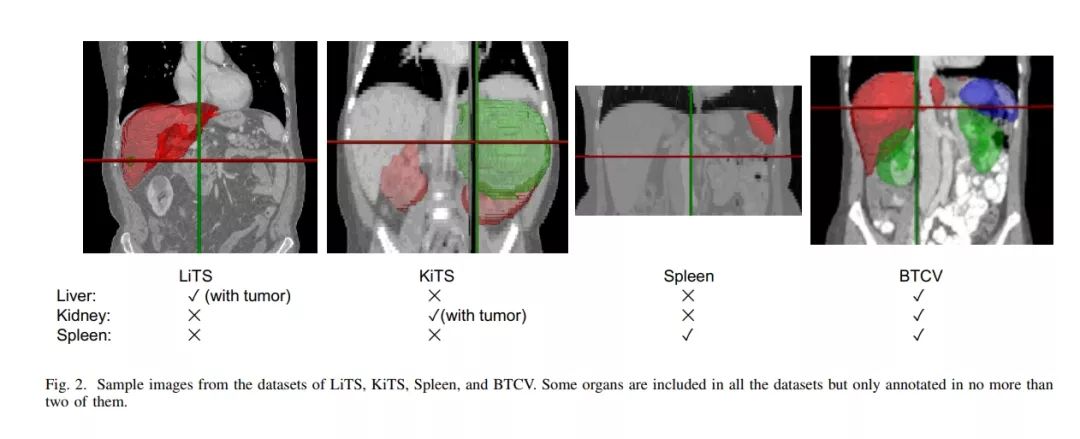

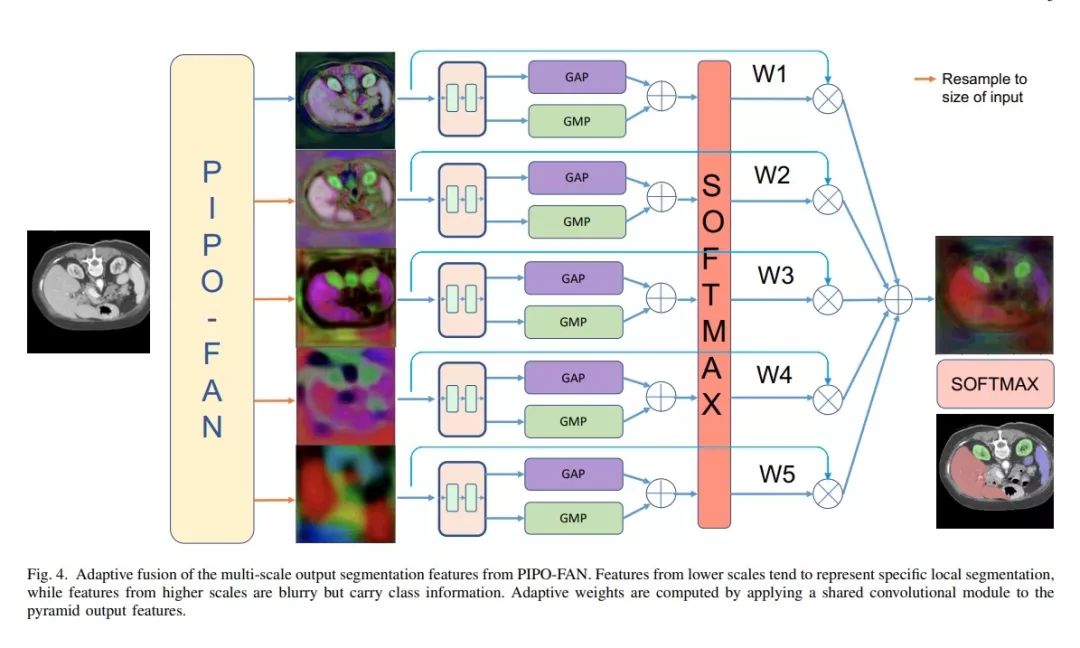

具有多尺度特征抽象的部分标记数据集的多器官分割

拓展阅读

医学图像配准中的深度学习:一份综述

论文名称:Deep Learning in Medical Image Registration: A Review

快速和深度神经形态学习,采用首次尖峰时间编码

论文名称:Fast and deep neuromorphic learning with time-to-first-spike coding

使用预先训练的语言模型进行端到端命名实体识别和关系提取

论文名称:End-to-end Named Entity Recognition and Relation Extraction using Pre-trained Language Models

本地化的无偏差机器学习:有效评估分位数治疗效果,处于风险中的条件值以及其他

论文名称:Localized Debiased Machine Learning: Efficient Estimation of Quantile Treatment Effects, Conditional Value at Risk, and Beyond

深度神经网络的无损压缩

论文名称:Lossless Compression of Deep Neural Networks