【泡泡图灵智库】直接法视觉SLAM的光照变化鲁棒性(ICRA-33)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Illumination Change Robustness in Direct Visual SLAM

作者:Seonwook Park, Thomas Sch¨ops, Mrc Pollefeys

来源:ICRA2017

编译:黄文超

审核:刘小亮

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——直接法视觉SLAM的光照变化鲁棒性,该文章发表于ICRA2017 。

直接视觉里程计和同时定位和建图(SLAM)方法通过直接对齐图像来确定相机姿态,基于Lucas-Kanade方法优化光度误差。这方面许多最近的工作在误差公式中使用了亮度恒定性假设,因此无法处理显著的光照变化。这种光照变化在SLAM中的闭环部分特别容易发生。目前已经有一些尝试更鲁棒地匹配图像的替代方法存在。在本文中,作者对一些具有实时能力的方法进行了系统评估,评估其分别在里程计和闭环的应用场景下的准确性和鲁棒性,使用的数据集包括真实图像以及具有模拟光照变化的合成图像。由此得出的结论是,对于真实图像,基于Census的方法优于其他方法。数据集在网上可以下载。

主要贡献

1、对快速的、光照变化鲁棒的直接位姿追踪算法进行了详尽的评估。

2、扩展了ICL-NUIM数据集,提供由Kinect采集的RGB-D序列,该序列可以对全局和局部的光照变化鲁棒性进行评估。

评估结果

1、算法选择

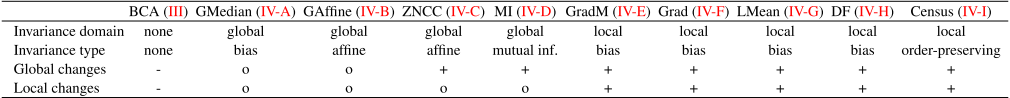

基本的直接法使用了光照一致性假设(BCA),在此基础上作者选择了几种变体,对适用于直接法SLAM的具有实时性能的算法进行评估。包括使用全局光照变化模型、图像梯度表示局部光照变化和基于块的方法。表1列出了各方法理论上的光照不变性。

使用全局光照变化模型的有:全局均值偏置归一化(GMedian),该方法是在优化前使用残差的均值进行全局亮度偏置的归一化;全局仿射模型(GAffine),该方法将待对齐的两幅图像之一的亮度用仿射变化函数转化为全局的光照变化;零均值归一化的互相关(ZNCC),该方法是对仿射亮度变化具有不变性的相关性度量;互信息(MI),互信息是两个随机变量依赖性的度量。

基于图像梯度的方法有:梯度幅值(GradM),与对齐原始图像亮度不同的是,这种方法对齐图像梯度的幅值,因此对局部的光照变化具有不变性;梯度(Grad),该方法是直接将梯度以向量形式进行匹配;局部均值偏置归一化(LMean),该方法通过减去某一像素周围一小块的均值来归一化该像素的强度。

基于块的方法有:描述符域(DF),描述符定义为图像的一系列卷积操作;Census变换(Census),Census变换在立体深度估计中很流行,它能够对所有的亮度变换保持不变性,并且保持亮度顺序,但是相对可能会损失些精度。

表1 待评估的方法的光照不变性

+, o, -表示高、中和低

2、数据集

视觉里程计的测试数据集有三个:TUM RGB-D、基于ICL-NUIM的合成序列以及1代Kinect采集的真实数据。其中TUM RGB-D数据集可以将作者的结果和那些先前发布的工作的结果进行比较,但是该数据集只包含微小的光照变化,因此第二个合成数据集就专门用来测试算法对光照变化的鲁棒性。闭环的测试数据是通过渲染 Google Tango设备产生的3D重建得到的320x240图像对。

2.参数设置

参数的调节是在训练序列中完成的。作者使用参考文献[46]提供的工具来评估准确率,逐帧的比较来估计轨迹,并且对相对位姿变化计算RMSE误差。

对于多分辨率的优化,作者计算图像金字塔直到40x30的像素分辨率。Levenberg-Marquardt算法在金字塔的每一层都运行,直到平均像素位置更新小于10^(-2)或者达到最大20次迭代。GradM使用的是Sobel滤波器。

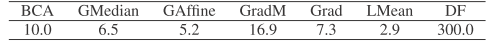

Huber函数的参数 k 是用TUM RGB-D数据集上的最小化平均平移漂移来调节的,结果见表2。ZNCC, MI, 和Census中没有用到Huber函数。

表2 Huber参数

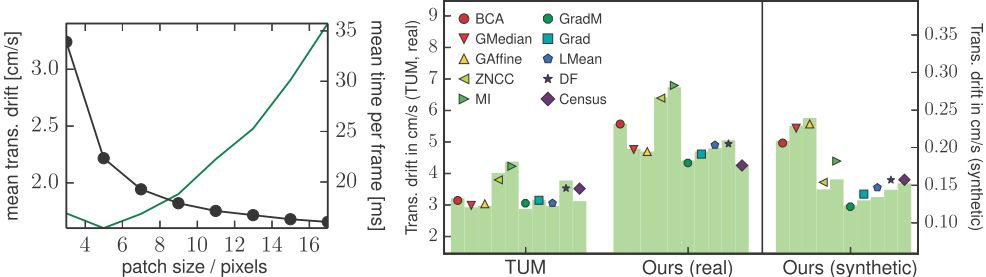

为了给LMean算法选择块的大小,作者在合成数据集上进行参数扫描,结果见图3左图,最后选择了11x11作为算法运行速度快慢和漂移大小的权衡。

图3 左:LMean算法的平移漂移(黑线)和运行时间(绿线)随块大小的变化。

右:视觉里程计在3组序列的平均平移漂移。

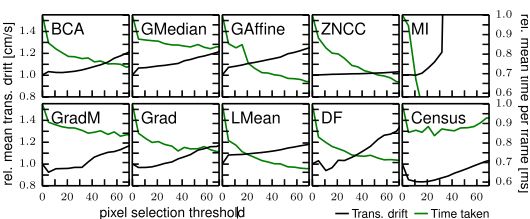

对于深度图,作者设定一个灰度梯度阈值,低于该值的像素会被丢弃。该阈值的选择以最小化漂移为准。平移漂移的相对变化和每帧的处理时间见图4。

图4 平移漂移(黑线)和每帧运行时间(绿线)

随深度图像的稠密程度的变化

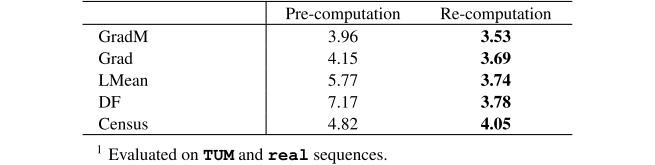

基于描述符的算法可以预先计算或是在优化中的每回迭代中进行重新计算,对这两种方法的评估见表3。可以看出重新计算总是比预先计算的漂移小,对基于梯度的方法也是如此。

表3 基于描述符的方法的平移漂移(cm/s)

3.视觉里程计

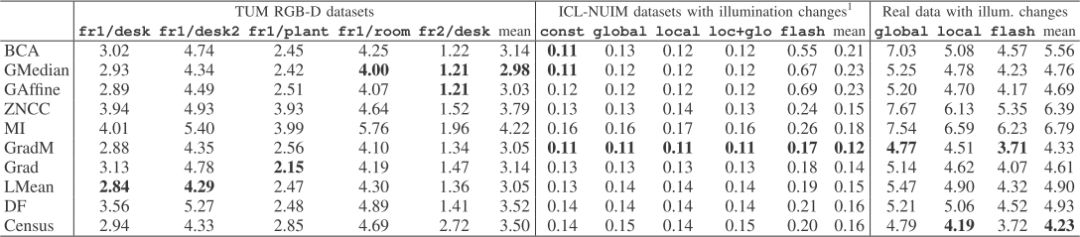

针对视觉里程计的评估结果见表4,平均值见图3右图。在TUM数据集上,基本的BCA算法表现良好,GMedian方法性能最好。GradM方法在合成数据集上的结果最好。但是在真实的数据中,Census表现地最好。

总体来看,GradM方法在各个数据集中都表现出色,仅在真实数据中略逊于Census,这表示梯度要对真实世界里的物体表面变化提供不变性还是有些难度。

表4 视觉里程计评估结果(平移漂移,单位cm/s)

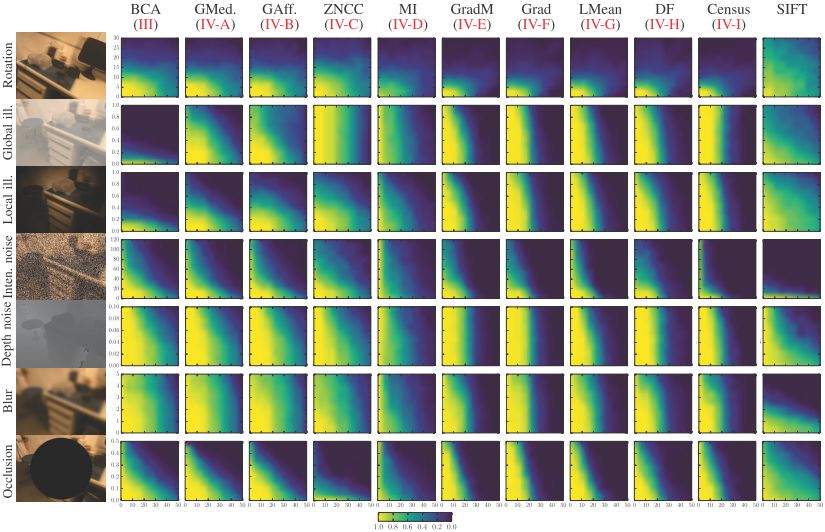

4.劣质化图像的对齐

在该评估中,作者生成许多图像对并将其劣质化(平移、旋转、全局和局部的光照变化、亮度和深度噪声、模糊和遮挡),以评估上述算法的收敛概率。结果见图5,将收敛概率映射为了颜色。该实验中最重要的一点是:BCA在小的、瞬间的光照变化下都失败了。GAffine只展现了一部分对全局变化的鲁棒性,MI表现不佳,所有基于梯度的方法都类似。

图5 不同图像劣质化后的收敛性评估

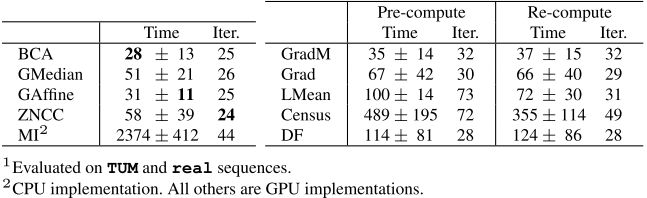

5.运行效率

表5展示了所有方法的运行时间和平均迭代次数。

表5 平均时间和每帧迭代次数

结论

本文评估了具有实时性的直接图像对齐方法,评估其在具有挑战性的光照变化下的准确率和鲁棒性。GradM方法在视觉里程计的准确率评估中表现良好,速度也很快。但是对于光照变化剧烈的真实世界数据集,Census方法给出最准确的结果。对于闭环,SIFT描述子匹配相对于直接法能够有更大的位姿变换,但是后者有更高的准确度。这意味着需要先用特征匹配随后使用直接法进行精调。

Abstract

Direct visual odometry and Simultaneous Localization and Mapping (SLAM) methods determine camera poses by means of direct image alignment. This optimizes a photometric cost term based on the Lucas-Kanade method. Many recent works use the brightness constancy assumption in the alignment cost formulation and therefore cannot cope with significant illumination changes. Such changes are especially likely to occur for loop closures in SLAM. Alternatives exist which attempt to match images more robustly. In our paper, we perform a systematic evaluation of real-time capable methods. We determine their accuracy and robustness in the context of odometry and of loop closures, both on real images as well as synthetic datasets with simulated lighting changes. We find that for real images, a Census-based method outperforms the others. We make our new datasets available online.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com