强势入驻Kaggle,却什么奖牌都没拿到怎么办?Notebooks Grandmaster第一名:我也很苦恼

参与 Kaggle 竞赛却没有拿到奖牌,我应该怎么办?

We offer free GPU servers to the winners of grants at large competition venues for their use in further competitions, for training or for personal projects related to data science.

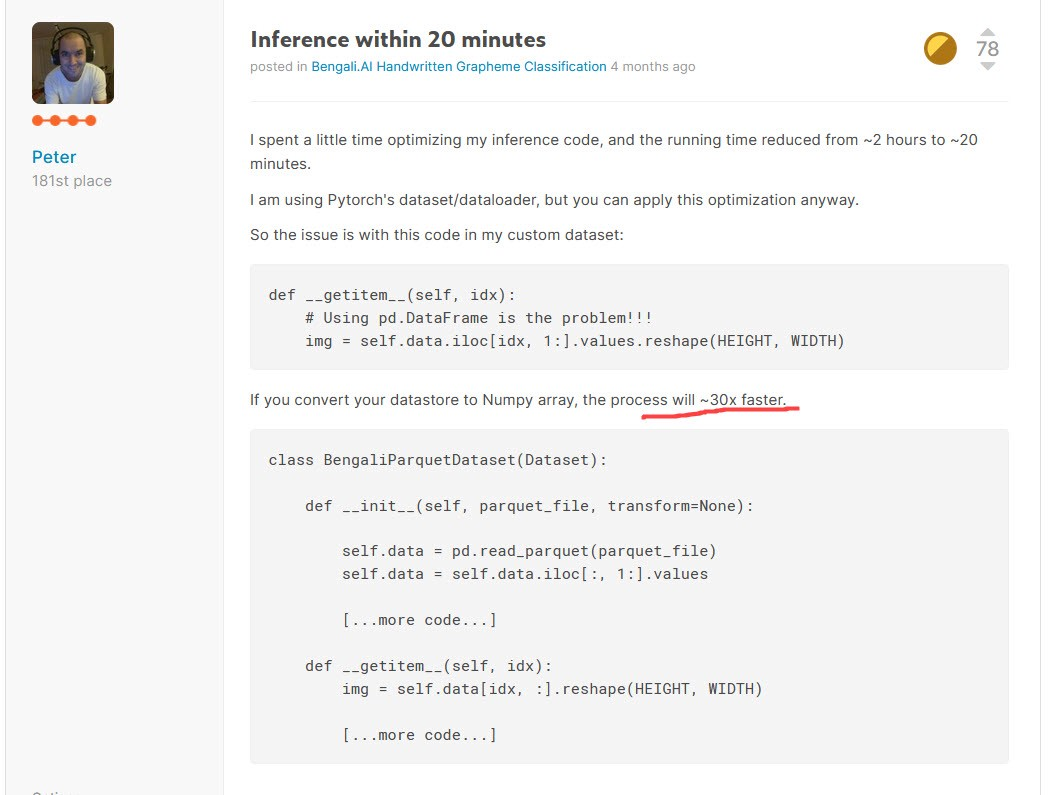

一些 notebook 中的代码和代码实践存在错误,还有验证问题、想法的错误实现等问题;

论坛中的一些想法存在误导性。这并不代表提出想法的人带有恶意,而是因为很多想法本身并不 work,只有和别的想法结合才能取得效果,有些需要性能足够好的模型等等。

登录查看更多