【ICLR2022】UniFormer:无缝集成 Transformer,更高效的时空表征学习框架

来源:“上海人工智能实验室”

对图像和视频上的表征学习而言,有两大痛点:局部冗余——视觉数据在局部空间、时间、时空邻域具有相似性,这种局部性质容易引入大量低效的计算;全局依赖——要实现准确的识别,需要动态地将不同区域中的目标关联,建模长时依赖。而现在的两大主流模型 CNN 和 ViT,往往只能解决部分问题。CNN 通过卷积有效降低了局部冗余,但受限的感受野难以建模全局依赖;而 ViT 凭借自注意力可捕获长距离依赖,但在浅层编码局部特征十分低效,导致过高冗余。

为能同时解决上述两大痛点,上海人工智能实验室联合商汤科技共同提出一种新的 UniFormer(Unified Transformer)框架, 它能够将卷积与自注意力的优点通过 Transformer 进行无缝集成。与经典的 Transformer 模块不同,UniFormer 模块的相关性聚合在浅层与深层分别配备了局部全局token,能够同时解决冗余与依赖问题,实现了高效的特征学习。包括 ICLR2022 接受的 video backbone,以及为下游密集预测任务设计的拓展版本,UniFormer 整套框架在各种任务上都能表现出比现有 SOTA 模型更好的性能。

论文标题:

UniFormer: Unified Transformer for Efficient Spatiotemporal Representation Learning

论文链接:

https://arxiv.org/abs/2201.04676

扩展版本:

https://www.zhuanzhi.ai/paper/8ee119122de9ee20679ec23ce65b230b

https://github.com/Sense-X/UniFormer

*UniFormer 性能提升

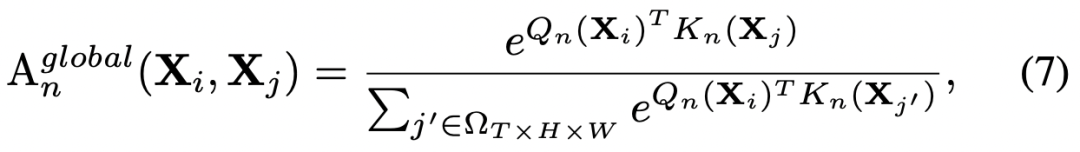

1、图像分类:在 Token Labeling 的加持下,仅靠 ImageNet-1K 训练,39GFLOPs 的 UniFormer-L-384 在 ImageNet 上实现了 86.3% 的 top-1 精度。

2、视频分类:仅用 ImageNet-1K 预训练,UniFormer-B 在 Kinetics-400 和 Kinetics-600 上分别取得了 82.9% 和 84.8% 的 top-1 精度(比使用 JFT-300M 预训练,相近性能的 ViViT 的 GFLOPs 少 16 倍)。在 Something-Something V1 和 V2 上分别取得 60.9%和 71.2% 的 top-1 精度,为同期模型的 SOTA。

3、密集预测:仅用 ImageNet-1K 预训练,COCO 目标检测任务上取得了 53.8 的 box AP 与 46.4 的 mask AP;ADE20K 语义分割任务上取得了 50.8 的 mIoU;COCO 姿态估计任务上取得了 77.4 的 AP。后文将会介绍为下游任务设计的训练和测试时模型适配。

图1:

图像分类与视频分类任务性能比较(上方为 ImageNet 上 224x224 与 384x384 分辨率输入)

图1:

图像分类与视频分类任务性能比较(上方为 ImageNet 上 224x224 与 384x384 分辨率输入)

设计灵感

• Local Redundancy: 视觉数据在局部空间/时间/时空邻域具有相似性,这种局部性质容易引入大量低效的计算。

• Global Dependency: 要实现准确的识别,需要动态地将不同区域中的目标关联,建模长时依赖。

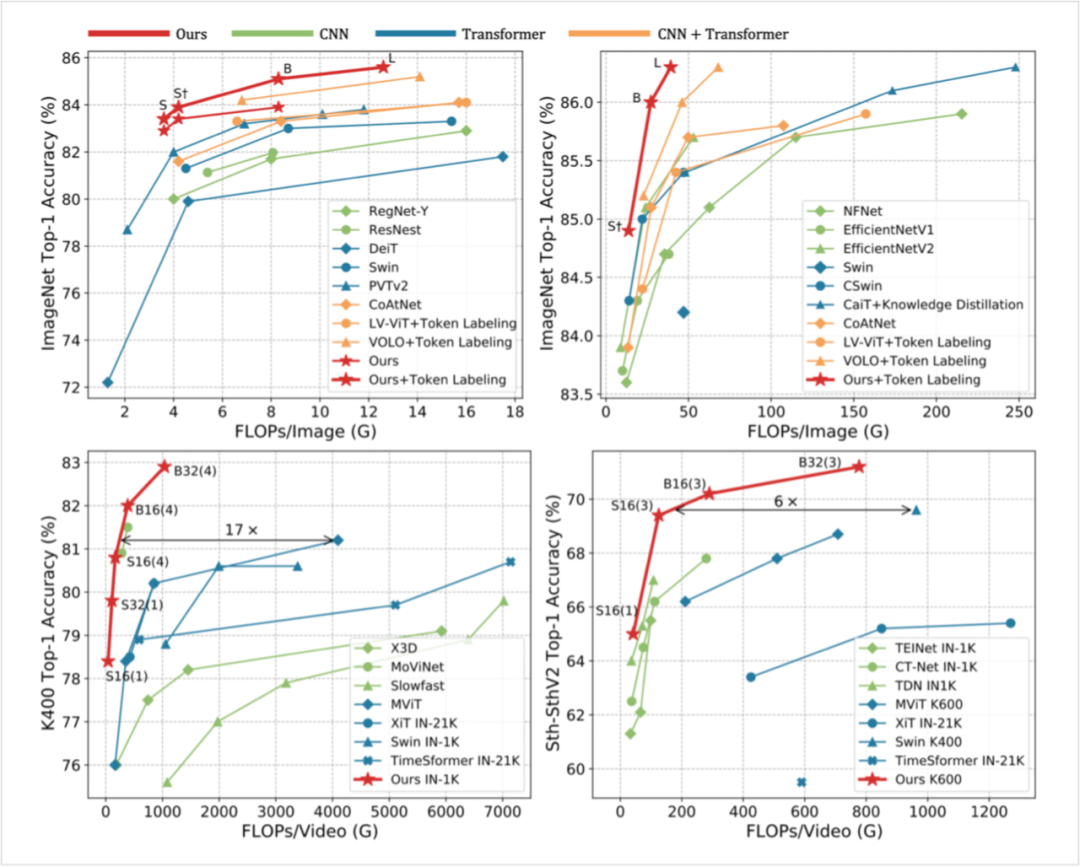

图2:

DeiT 可视化后,可以发现即便经过三层 self-attention,输出特征仍保留了较多的局部细节。

任选一个 token 作为 query,可视化 attention 矩阵可以发现,被关注的 token 集中在 3x3 邻域中(红色越深表示关注越多)

图2:

DeiT 可视化后,可以发现即便经过三层 self-attention,输出特征仍保留了较多的局部细节。

任选一个 token 作为 query,可视化 attention 矩阵可以发现,被关注的 token 集中在 3x3 邻域中(红色越深表示关注越多)

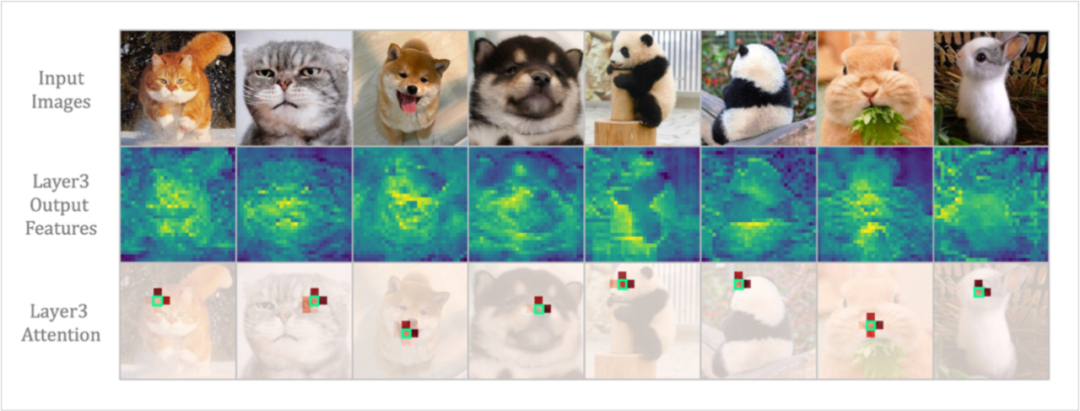

图3:

TimeSformer 可视化后,同样可以发现即便是经过三层 self-attention,输出的每一帧特征仍保留了较多的局部细节。

任选一个 token 作为 query,可视化 spatial attention 和 temporal attention 矩阵都可以发现,被关注的 token 都只在局部邻域中(红色越深表示关注越多)。

图3:

TimeSformer 可视化后,同样可以发现即便是经过三层 self-attention,输出的每一帧特征仍保留了较多的局部细节。

任选一个 token 作为 query,可视化 spatial attention 和 temporal attention 矩阵都可以发现,被关注的 token 都只在局部邻域中(红色越深表示关注越多)。

本论文中提出的UniFormer (Unified transFormer),旨在以 Transformer 的风格,有机地统一 convolution 和 self-attention,发挥二者的优势,同时解决 local redundancy 和 global dependency 两大问题,从而实现高效的特征学习。

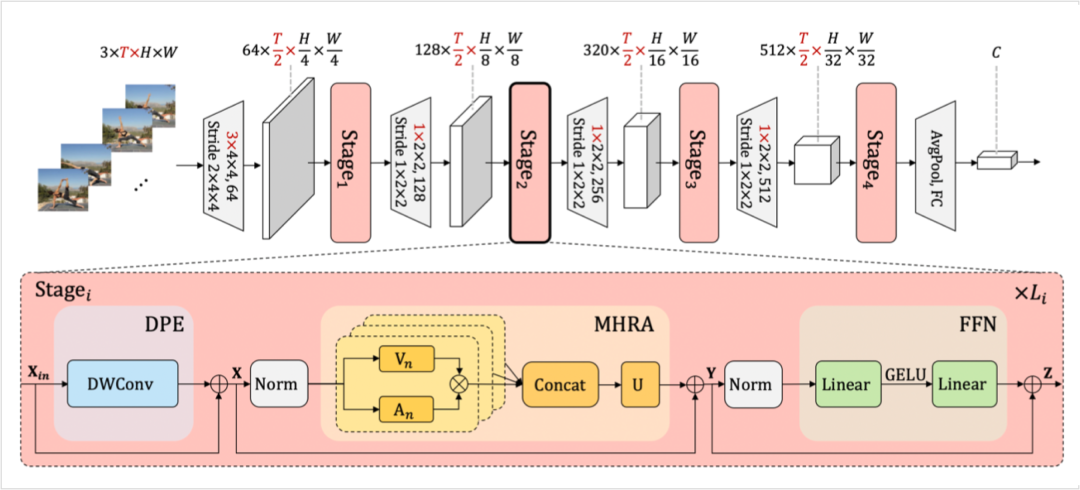

模型架构

模型整体框架如上图所示,借鉴了 CNN 的层次化设计,每层包含多个 Transformer 风格的 UniFormer block。

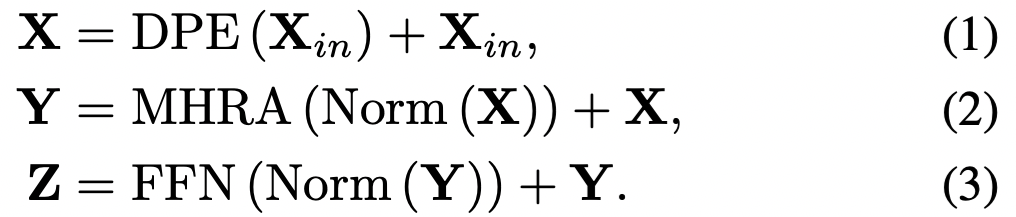

1、UniFormer block

每个 UniFormer block 主要由三部分组成,动态位置编码 DPE、多头关系聚合器 MHRA 及 Transformer 必备的前馈层 FFN,其中最关键的为多头关系聚合器:

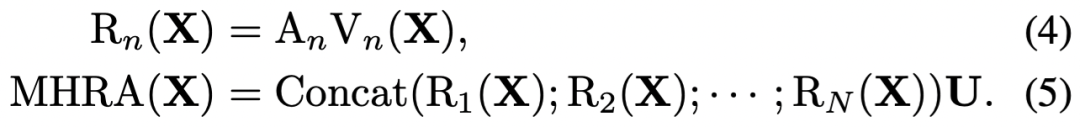

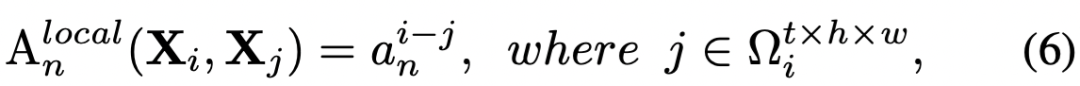

2、MHRA

与多头注意力相似,将关系聚合器设计为多头风格,每个头单独处理一组 channel 的信息。每组的 channel 先通过线性变换生成上下文 token

基于前面的可视化观察,可以认为在网络的浅层,token affinity 应该仅关注局部邻域上下文,这与 convolution 的设计不谋而合。因此,将局部关系聚合

3、local MHRA

其中

在网络的深层,需要对整个特征空间建立长时关系,这与 self-attention 的思想一致,因此,通过比较全局上下文相似度建立 token affinity:

4、global MHRA

其中

流行的 ViT 往往采用绝对或者相对位置编码 ,但绝对位置编码在面对更大分辨率的输入时,需要进行线性插值以及额外的参数微调,而相对位置编码对 self-attention 的形式进行了修改。为了适配不同分辨率输入的需要,采用了最近流行的卷积位置编码设计动态位置编码:

参考链接:https://mp.weixin.qq.com/s/2Pq93IgHmsGs9iE_PdE_Xg

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“UFME” 就可以获取《【ICLR2022】UniFormer:无缝集成 Transformer,更高效的时空表征学习框架》专知下载链接