7 Papers & Radios | Hinton组新型无监督方法引热议;迄今最大规模新冠临床研究

参与:杜伟,楚航,罗若天

本周的重要论文包括 AAAI 2020 最佳论文、最佳学生论文以及Hinton组提出的新型无监督方法SimCLR。

A Simple Framework for Contrastive Learning of Visual Representations

WinoGrande: An Adversarial Winograd Schema Challenge at Scale

Fair Division of Mixed Divisible and Indivisible Goods

Efficient Neural Architecture Search via Proximal Iterations

Epidemiological and clinical features of the 2019 novel coronavirus outbreak in China

Ready Policy One: World Building Through Active Learning

Is BERT Really Robust? A Strong Baseline for Natural Language Attack on Text Classification and Entailment

ArXiv Weekly Radiostation:NLP、CV、ML更多精选论文(附音频)。

论文 1:A Simple Framework for Contrastive Learning of Visual Representations

作者:Ting Chen、Simon Kornblith、Mohammad Norouzi、Geoffrey Hinton

论文链接:https://arxiv.org/pdf/2002.05709.pdf

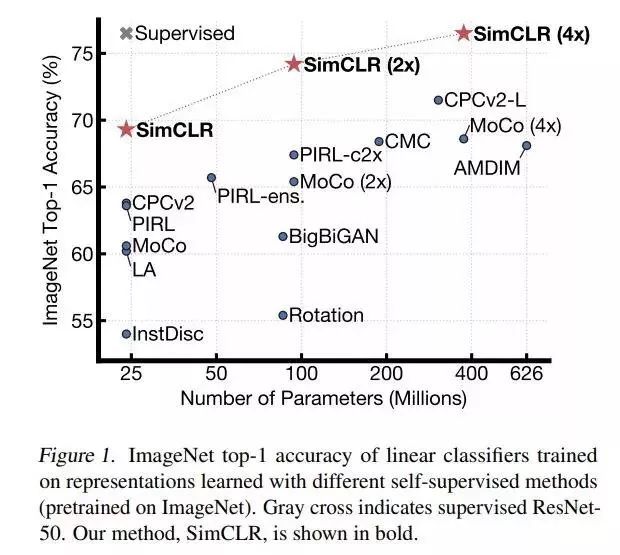

摘要:如今,在 ImageNet 上的图像识别准确率的性能提升每次通常只有零点几个百分点,而来自图灵奖获得者 Geoffrey Hinton 等谷歌研究者的最新研究一次就把无监督学习的指标提升了 7-10%,甚至可以媲美有监督学习的效果。SimCLR 是一种简单而清晰的方法,无需类标签即可让 AI 学会视觉表示,而且可以达到有监督学习的准确度。论文作者表示,经过 ImageNet 上 1% 图片标签的微调,SimCLR 即可达到 85.8%的 Top-5 精度——在只用 AlexNet 1% 的标签的情况下性能超越后者。

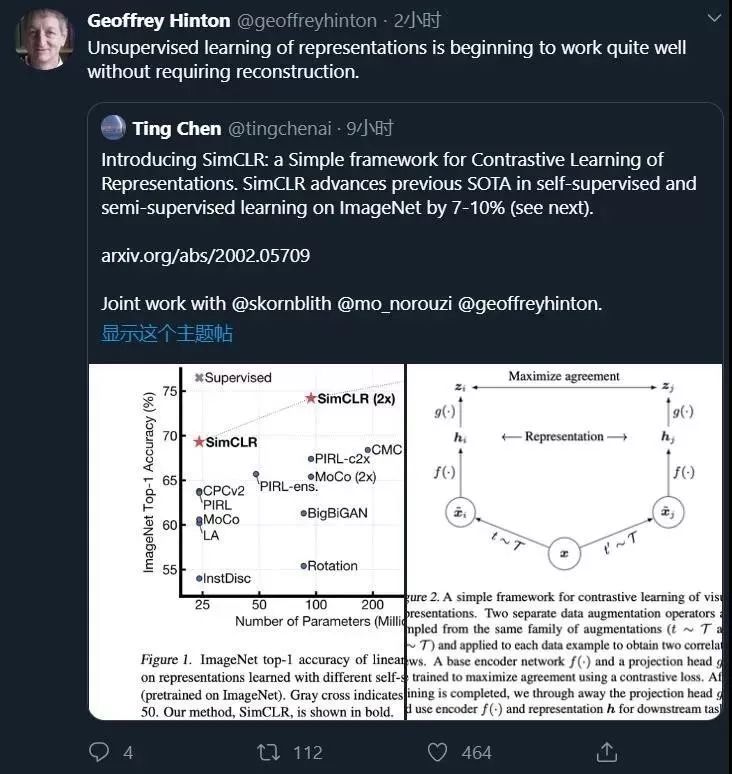

Hinton 发推推荐其领导小组推出的 SimCLR 无监督方法。

SimCLR 与此前各类自监督方法在 ImageNet 上的 Top-1 准确率对比(以 ImageNet 进行预训练),以及 ResNet-50 的有监督学习效果(灰色×)。

推荐:Hinton 组推出的这种新型无监督学习方法在推特引起热议,也得到了机器学习社区的广泛关注。

论文 2:WinoGrande: An Adversarial Winograd Schema Challenge at Scale

作者:Keisuke Sakaguchi、Ronan Le Bras、Chandra Bhagavatula、Yejin Choi

论文链接:https://mp.weixin.qq.com/s/QpT-oiocE1n2ZwD4-r-3oQ

摘要:维诺格拉德模式挑战赛(Winograd Schema Challenge:WSC)是一个用于常识推理的基准测试,该测试有 273 个专家编写的问题,专门应对依赖选择偏好和词语联想的统计学模型。但是近来,许多模型在该基准测试的性能已达到 90%。因此,研究者希望了解,这些模型是否真正获得了鲁棒的常识能力。

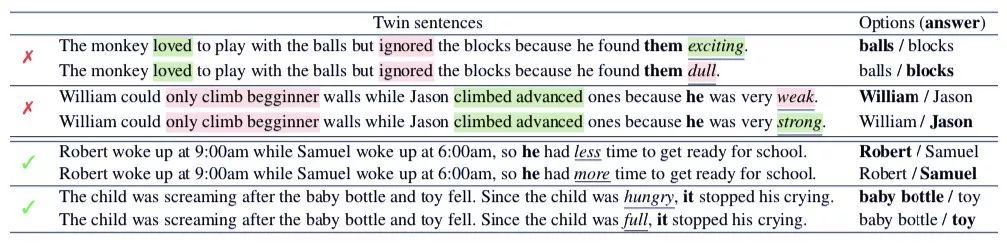

因此,研究者提出了 WINOGRANDE,一个有着 44k 个问题的大规模数据集。该数据集在规模和难度上较之前的数据集更大。该数据集的构建包括两个步骤:首先使用众包的方式设计问题,然后使用一个新的 AFLITE 算法缩减系统偏见(systematic bias),使得人类可以察觉到的词汇联想转换成机器可以检测到的嵌入联想(embedding association)。现在最好的 SOTA 模型可以达到的性能是 59.4 – 79.1%,比人脸性能水平(94%)低 15-35%(绝对值)。这种性能波动取决于训练数据量(2% 到 100%)。

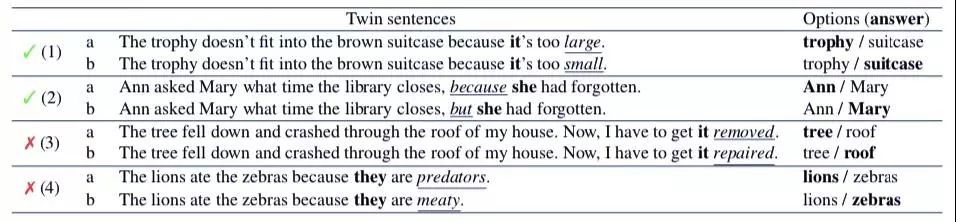

WSC 的问题通过问题对(pairs)的方式构建。其中,这两个问题基本上是类似的,并有着两个答案项。问题中包含一个触发词(trigger word),用来标明哪个选项是正确的。

使用 AFLITE 算法检测出的数据集偏见,使用 X 标记。

推荐:本论文荣获了 AAAI 2020 最佳论文奖,文中提出的 WINOGRANDE 是一个很好的迁移学习资源;但同时也说明我们现在高估了模型的常识推理的能力。研究者希望通过这项研究能够让学界重视减少算法的偏见。

论文 3:Fair Division of Mixed Divisible and Indivisible Goods

作者:Xiaohui Bei, Zihao Li, Jinyan Liu, Shengxin Liu, Xinhang Lu

论文链接:https://arxiv.org/pdf/1911.07048.pdf

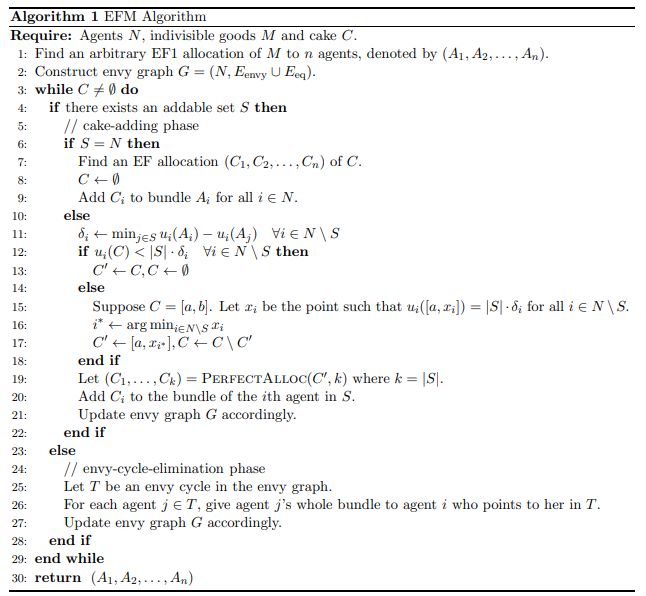

摘要:本文研究了当资源包含可分割商品及不可分割商品时的公平分配问题。比如,无嫉妒性(envy-freeness,EF)及无嫉妒性最多可用于单一商品(envy-freeness up to one good, EF1)这种经典公平问题概念,是无法直接应用于混合商品的分配问题中。而在此次研究中提出了一个新的公平概率-混合商品的无嫉妒性(envy-freeness for mixed goods, EFM),而它是 EF 和 EF1 针对混合商品集合的直接通用化结果。

研究者证明了对于任意数量的代理(agents)而言,EFM 的分配始终存在。他们还提出了一个有效算法去计算两个代理和 n 个代理的 EFM 分配问题,并且对可分割商品进行分段化的线性评估。最后,研究者放松了对无嫉妒性的要求,改为针对混合商品的ǫ-无嫉妒性(ǫ-EFM),以及提出了一种算法,使其在一定的代理数量、一定的不可分割商品数量和的 1 /ǫ的情况下,找到时间多项式的ǫ-EFM 分配。

算法 1:EFM 算法。

推荐:本论文荣获了 AAAI 2020 最佳学生论文奖,论文作者来自南洋理工大学、清华大学和香港大学。

论文 4:Efficient Neural Architecture Search via Proximal Iterations

作者:Quanming Yao,Ju Xu,Wei-Wei Tu,Zhanxing Zhu

论文链接:https://arxiv.org/abs/1905.13577

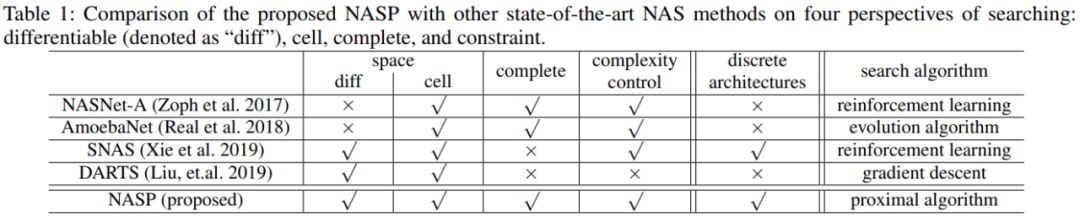

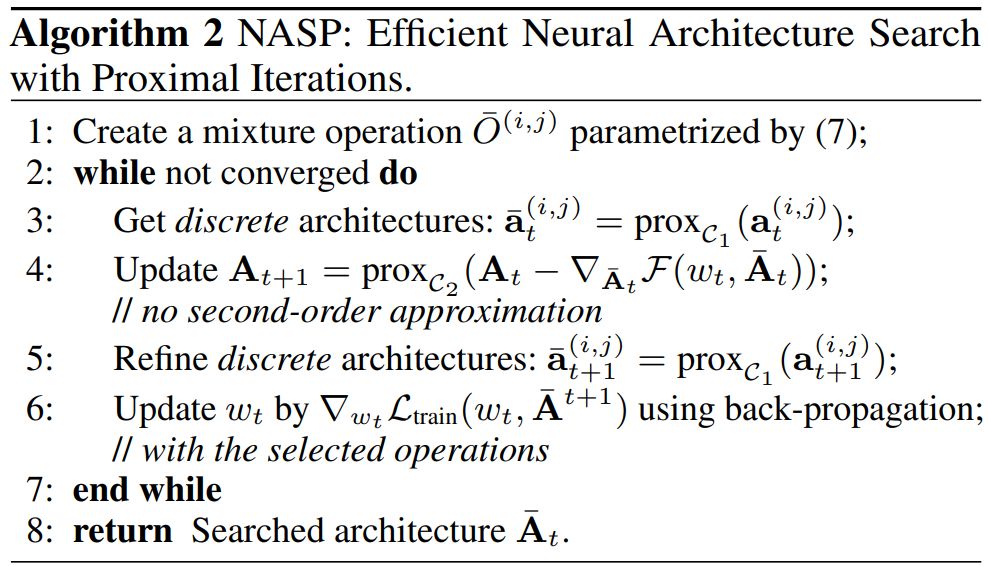

摘要:神经架构搜索(NAS)因其比手工构建的架构更能识别出更好的架构而备受关注。近年来,可微分的搜索方法因可以在数天内获得高性能的 NAS 而成为研究热点。然而,由于超级网的建设,其仍然面临着巨大的计算成本和性能低下的问题。

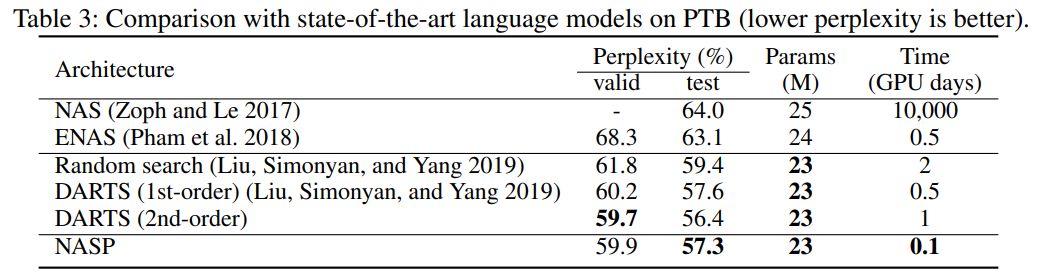

在本文中,我们提出了一种基于近端迭代(NASP)的高效 NAS 方法。与以往的工作不同,NASP 将搜索过程重新定义为具有离散约束的优化问题和模型复杂度的正则化器。由于新的目标是难以解决的,我们进一步提出了一种高效的算法,由近端启发法进行优化。通过这种方式,NASP 不仅比现有的可微分的搜索方法速度快,而且还可以找到更好的体系结构并平衡模型复杂度。最终,通过不同任务的大量实验表明,NASP 在测试精度和计算效率上均能获得更好的性能,在发现更好的模型结构的同时,速度比 DARTS 等现有技术快 10 倍以上。此外,NASP 消除了操作之间的关联性。

在所有这些工作中,最为出色的是 DARTS [1],因为它结合了可微分以及小搜索空间两者的优点,实现了单元内的快速梯度下降。然而,其搜索效率和识别体系结构的性能仍然不够令人满意。

在第三步中,研究者利用临近迭代算子产生离散结构;再在第四步中更新连续的结构参数(单步梯度下降,无二阶近似);最后,在离散的网络结构下,更新网络权重。

实验结果显示,DARTS 的二阶比一阶慢得多,NASP 不仅比 DARTS 快得多,而且可以达到与其他最先进的方法相当的测试性能。

推荐:在本周结束的 AAAI 2020 中,第四范式提出了一种基于临近迭代(Proximal Iterations)的 NAS 方法,其速度比 DARTS 快了 10 倍以上。

论文 5:Epidemiological and clinical features of the 2019 novel coronavirus outbreak in China

作者:Yang Yang、Qingbin Lu、Mingjin Liu、Yixing Wang 等

论文链接:https://www.medrxiv.org/content/10.1101/2020.02.10.20021675v1

摘要:近日,一篇名为《中国 2019 新型冠状病毒爆发流行病学和临床特征》的论文在医学预印本平台 medRxiv 上线,对 8866 名新冠肺炎患者的临床学和流行病学特征进行了总结,是迄今为止样本量最大的新冠病毒肺炎临床研究。这篇论文采用了来自 30 个省级行政单位 8866 名患者的数据,其中包括确诊患者 4021 名(占比 45.35%),其余为疑似患者。数据截止到 2020 年 1 月 26 日 [注],这是当前样本规模最大的新冠疫情临床回顾性研究。

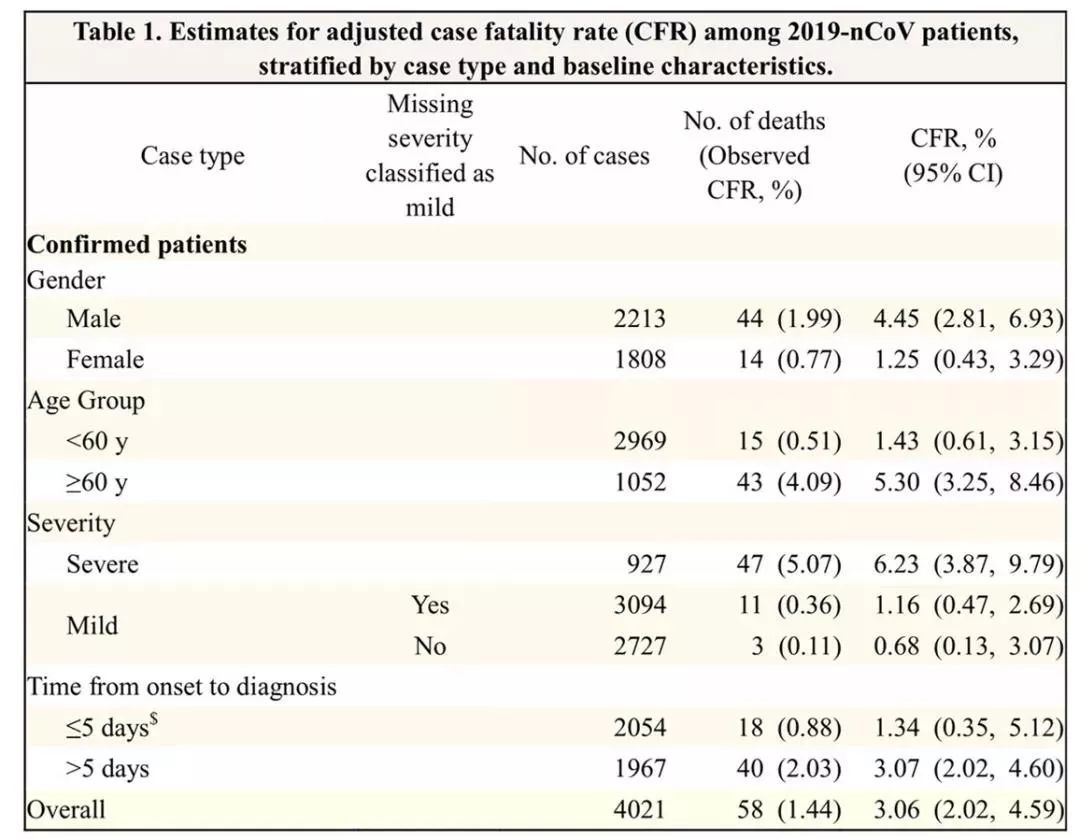

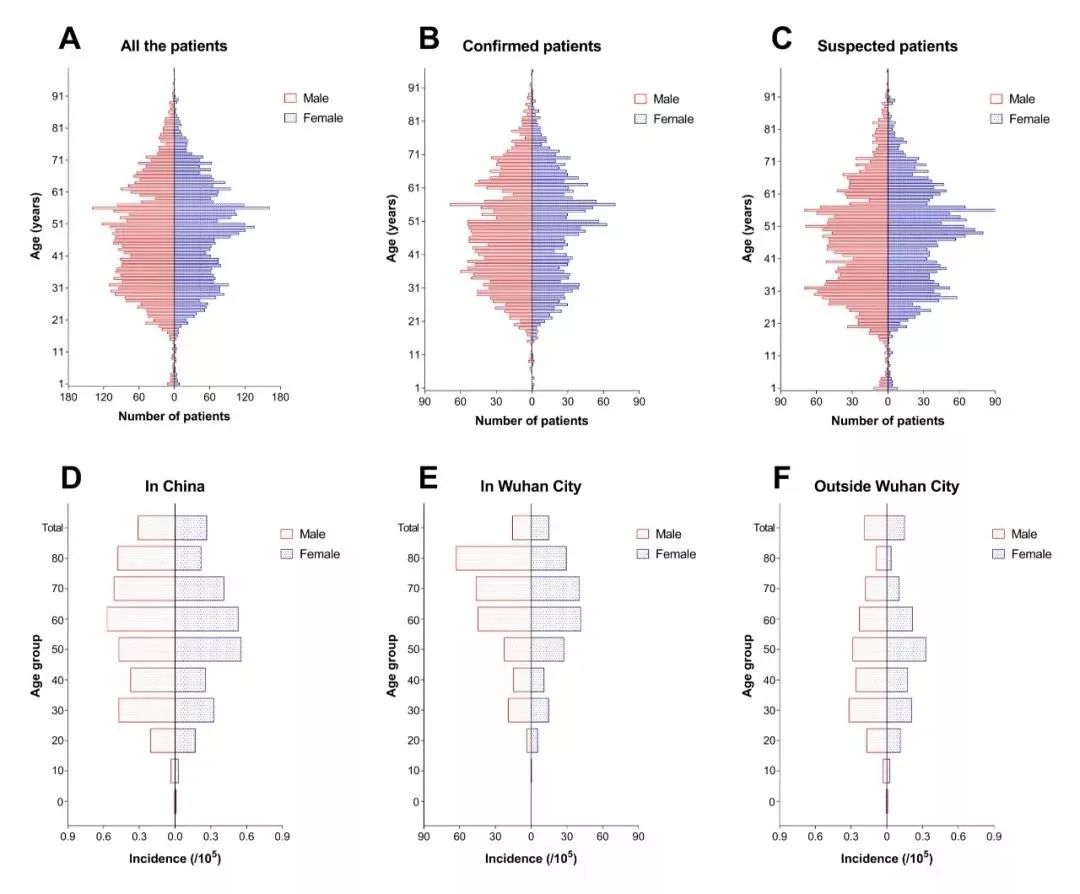

这篇论文得出以下主要结论:近半数(47.7%)患者的年龄在 50 岁及以上;每 10 万人的发病率存在着明显的性别差异,男性为 0.31,女性为 0.27(P<0.001);新型冠状病毒肺炎对年纪较大的男性影响大于其他群体,确诊率和病死率都是最高的;重症、轻症的患者比例分别为 25.5% 和 69.9%,剩下 4.5% 的受调查者无肺炎症状;潜伏期中位数为 4.75 天,四分位距为 3.0-7.2 天;总体 CFR(病死率)估计为 3.06% 左右(95% 置信区间 2.02-4.59%),低于 SARS-CoV (9.2%) 和 MERS-CoV (34.4%),年龄大于等于 60、性别为男性、初诊时已经发展为严重肺炎(满足其中一个或多个条件)的患者群体病死率更高。R0 值(基本再生数)估计为 3.77(95% 置信区间 3.51-4.05),根据潜伏期和感染期的不同,R0 的敏感性分析取值范围在 2.23 和 4.82 之间。

病死率的预估情况。以上都是 2020 年 1 月 26 日前,症状出现时间小于 14 天的病例。该组统计的过程中,d 可能为 5 到 8 天不等。

年龄、性别因素对于新冠病毒感染的影响。A:所有病人根据年龄和性别的分布情况;B:确诊病例;C:疑似病例。D:根据性别进行的统计,限于中国大陆的确诊病例;E:武汉报告的确诊病例;F:非武汉报告的确诊病例。

推荐:根据发现结果,研究者认为,新冠病毒与 SARS-CoV 有着类似的传染性,但病死率更低。在症状转为严重之前,应尽早发现年纪较大的患者并及时治疗,尤其是男性患者。但需注意的是,这篇论文还处于同行评审阶段,其结果有待评估,不能用来指导临床实践。

论文 6:Ready Policy One: World Building Through Active Learning

作者:Philip Ball、Jack Parker-Holder、Aldo Pacchiano、Stephen Roberts 等

论文链接:https://arxiv.org/pdf/2002.02693.pdf

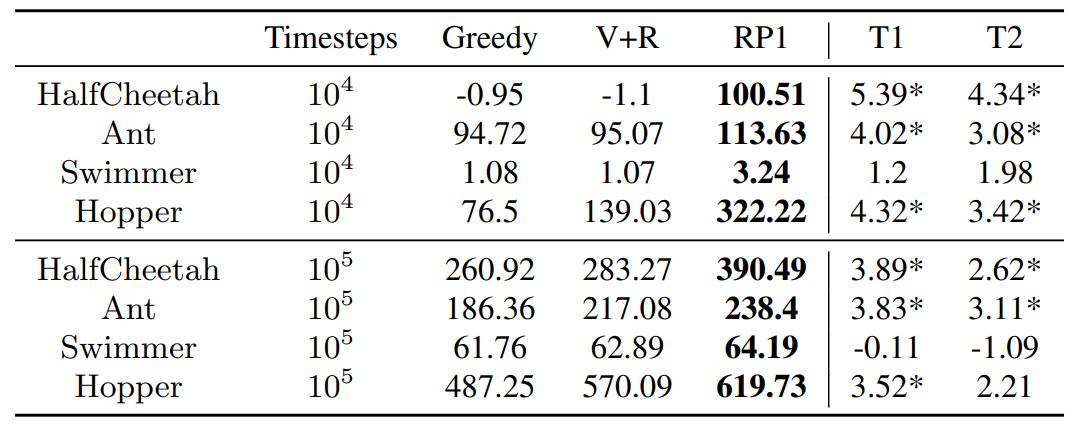

摘要:基于模型的强化学习(Model-Based Reinforcement Learning,MBRL)为样本高效学习提供了一个有前途的方向,通常可以实现连续控制任务(continuous control task)的 SOTA 结果。然而,许多现有的 MBRL 方法依赖于贪婪策略(greedy policy)与探索启发法的结合,甚至那些利用原则试探索奖金(exploration bonus)的方法也能够以特定方式构建双重目标。

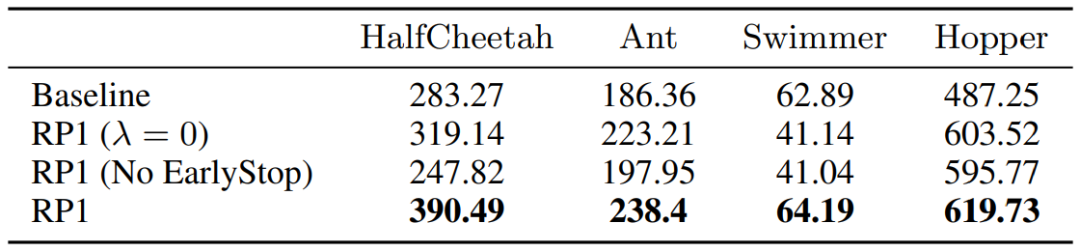

在本文中,研究者介绍了 Ready Policy One(RP1),这是一种将 MBRL 视为主动学习问题的框架。研究者的目标是在尽可能少样本中改进世界模型(world model)。RP1 通过利用混合目标函数来实现这一目标,该函数在优化过程中的适应性调整至关重要,从而使算法可以权衡不同学习阶段的奖励与探索。此外,一旦拥有足够丰富的轨迹批(trajectory batch)来改进模型,研究者会引入一种原则式机制(principled mechanism)来终止样本收集。

给定时间步为 10 的四次方时的最佳性能中位数对比。

RP1 关键组件的控制变量研究。

推荐:在实验阶段,研究者在各类连续控制任务上对他们的方法进行了严格的评估,结果证明与现有方法相比具有统计学上的显著优势。

论文 7:Is BERT Really Robust? A Strong Baseline for Natural Language Attack on Text Classification and Entailment

作者:Di Jin、Zhijing Jin、Joey Tianyi Zhou、Peter Szolovits

论文链接:https://arxiv.org/pdf/1907.11932.pdf

摘要:众所周知,CV 领域的 adversarial attack 被非常广泛的研究,但是在 NLP 领域的对抗攻击却因为文本的离散的特性而难以推进。对于 NLP 的模型来说,那些在人们眼里几乎没变的文本却会被模型非常不同地对待,甚至错判。这些是特别致命的、且急需研究的方向。这是一篇与 MIT 合作的 AAAI 2020 Oral 文章,自然语言对抗样本生成,我们将详细解读如何简单高效地生成自然语言对抗样本,并且高度 attack 文本分类和文本推测的 7 个数据集。

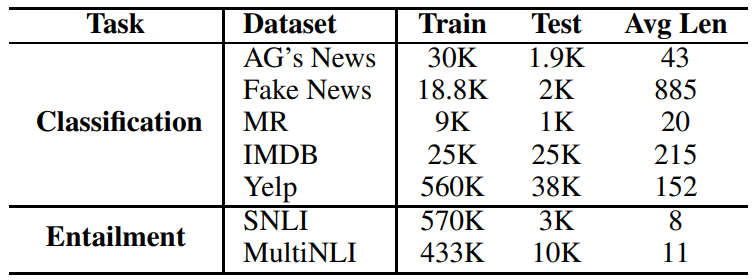

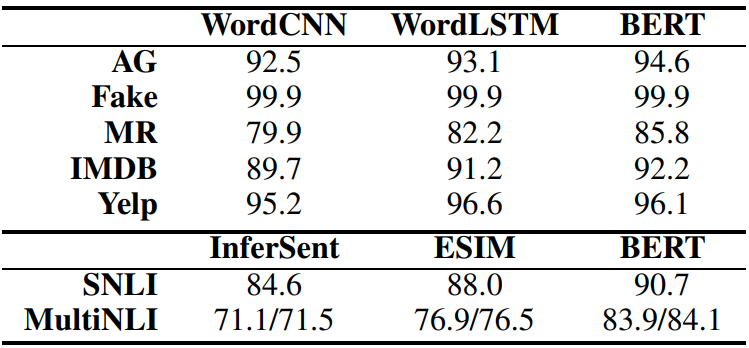

研究者探究了对抗攻击在文本分类和文本蕴涵两项重要 NLP 任务上的有效性,并采用了不同的数据集。

对于每个数据集,研究者在训练集上训练了三个 SOTA 模型,并得到了与原始实现相近的测试集准确率分数。

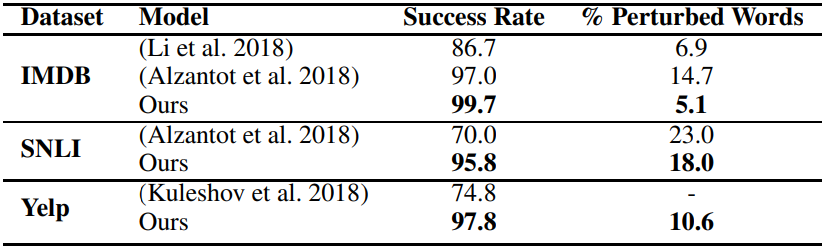

本文攻击系统与其他已发表系统的比较。

推荐:本文二作金致静,香港大学毕业,目前在亚马逊上海人工智能实验室做实习研究。

ArXiv Weekly Radiostation

机器之心联合由楚航、罗若天发起的ArXiv Weekly Radiostation,在 7 Papers 的基础上,精选本周更多重要论文,包括NLP、CV、ML领域各10篇精选,并提供音频形式的论文摘要简介,详情如下:

8. PointHop++: A Lightweight Learning Model on Point Sets for 3D Classification. (from Min Zhang, Yifan Wang, Pranav Kadam, Shan Liu, C.-C. Jay Kuo)

9. Finding novelty with uncertainty. (from Jacob C. Reinhold, Yufan He, Shizhong Han, Yunqiang Chen, Dashan Gao, Junghoon Lee, Jerry L. Prince, Aaron Carass)

10. Validating uncertainty in medical image translation.(from Jacob C. Reinhold, Yufan He, Shizhong Han, Yunqiang Chen, Dashan Gao, Junghoon Lee, Jerry L. Prince, Aaron Carass)

本周 10 篇 ML 精选论文是:

1. Adaptivity of Stochastic Gradient Methods for Nonconvex Optimization. (from Samuel Horváth, Lihua Lei, Peter Richtárik, Michael I. Jordan)

2. Weakly-Supervised Disentanglement Without Compromises. (from Francesco Locatello, Ben Poole, Gunnar Rätsch, Bernhard Schölkopf, Olivier Bachem, Michael Tschannen)

3. Capsules with Inverted Dot-Product Attention Routing. (from Yao-Hung Hubert Tsai, Nitish Srivastava, Hanlin Goh, Ruslan Salakhutdinov)

4. Cyclic Boosting -- an explainable supervised machine learning algorithm. (from Felix Wick, Ulrich Kerzel, Michael Feindt)

5. DynamicPPL: Stan-like Speed for Dynamic Probabilistic Models. (from Mohamed Tarek, Kai Xu, Martin Trapp, Hong Ge, Zoubin Ghahramani)

6. Explore, Discover and Learn: Unsupervised Discovery of State-Covering Skills. (from Víctor Campos, Alexander Trott, Caiming Xiong, Richard Socher, Xavier Giro-i-Nieto, Jordi Torres)

7. Towards Mixture Proportion Estimation without Irreducibility. (from Yu Yao, Tongliang Liu, Bo Han, Mingming Gong, Gang Niu, Masashi Sugiyama, Dacheng Tao)

8. On the Effectiveness of Richardson Extrapolation in Machine Learning. (from Francis Bach, SIERRA)

9. Learning State Abstractions for Transfer in Continuous Control. (from Kavosh Asadi, David Abel, Michael L. Littman)

10. Consistency of a Recurrent Language Model With Respect to Incomplete Decoding. (from Sean Welleck, Ilia Kulikov, Jaedeok Kim, Richard Yuanzhe Pang, Kyunghyun Cho)

点击阅读原文,查看 ArXiv Weekly Radiostation 全部图文内容。