在大语言模型(LLMs)的快速发展推动下,基于LLM的智能体已经成为强大的智能系统,具备类人的认知、推理与交互能力。这类智能体正日益广泛应用于多种现实场景,包括学生教育、科学研究与金融分析等。然而,尽管其潜力巨大,基于LLM的智能体仍易受到幻觉问题的影响,导致任务执行错误,进而削弱整体系统设计的可靠性。

应对这一关键挑战,需要对近年来关于基于LLM的智能体的研究进展进行深入理解与系统整合。为此,我们提出首个关于智能体幻觉的全面综述。通过仔细分析智能体的完整工作流程,我们提出了一种新的分类体系,用以识别在不同阶段可能出现的不同类型幻觉。此外,我们还深入探讨了十八类导致智能体幻觉产生的触发因素。

在对大量现有研究的详细回顾基础上,我们总结了幻觉的缓解与检测方法,并强调了未来研究中值得探索的方向。我们希望本综述能够激发更多学术界与工业界在解决智能体幻觉问题上的努力,最终推动更加稳健、可靠的智能体系统的发展。

1 引言

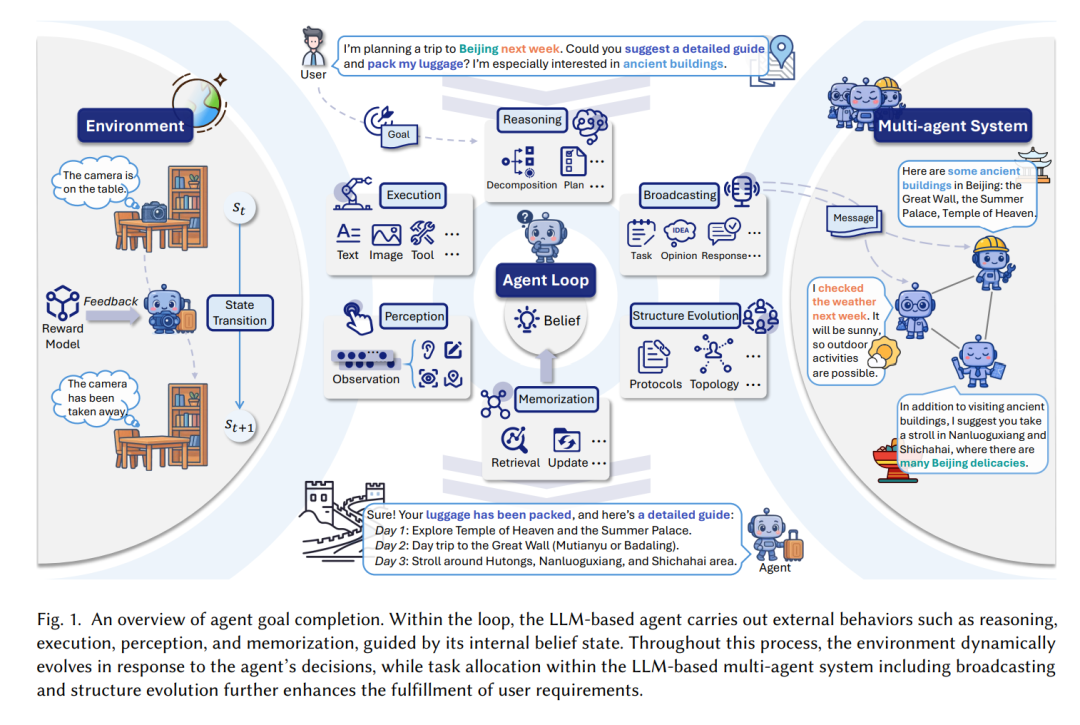

大语言模型(LLMs)[3, 96, 100, 261, 262, 373] 近年来在广泛的任务中展现出了卓越的能力,包括语言生成 [69, 273]、意图理解 [32, 88] 和知识推理 [120, 197]。这些能力主要得益于大规模训练数据 [345]、模型架构创新 [267] 以及在指令微调 [189] 和上下文学习 [70] 过程中涌现出的新兴能力 [296]。在这些突破的基础上,基于LLM的智能体 [45, 241, 282, 306, 332, 384] 在跨领域的任务自动化中表现得日益熟练,标志着迈向通用人工智能(AGI)[91] 之路上的关键里程碑。此外,这些智能体可以被编排为基于LLM的多智能体系统(MAS)[29, 102, 113, 153, 192, 215],其中不同专长的智能体通过协作与交互,共同解决任何单一智能体都无法独立完成的复杂现实问题,例如知识共享 [9, 107] 与协同协调 [354, 381]。 尽管基于LLM的智能体在性能上取得了令人瞩目的成就,其快速发展也带来了新的安全挑战 [260, 348, 369]。在这些挑战中,智能体幻觉(Agent Hallucinations) 问题构成了尤为严重的威胁 [66, 174, 363]。先前关于幻觉的研究主要集中在自然语言生成(NLG)[70, 86, 230] 领域,在该领域中,幻觉通常指NLG模型生成不真实或无意义的文本。Ji 等人 [131] 对不同NLG任务中解决幻觉问题的最新进展进行了综述;Huang 等人 [123] 则专门探讨了LLM幻觉的成因。在这一背景下,LLM幻觉可分为事实性幻觉和忠实性幻觉。前者强调生成内容与可验证的真实世界事实之间的不一致 [204];后者则指输出偏离用户原始输入 [76]。此外,相关研究还讨论了若干有效的幻觉检测与缓解技术 [179]。 与上述场景不同,基于LLM的智能体是一类更加复杂的智能系统,具备目标导向的推理与行动能力。此类智能体通常包含三个核心模块:大脑(brain)、感知(perception)和行动(action) [66, 307]。其中,大脑模块主要负责存储记忆和知识,支持任务执行所需的推理与决策;感知模块拓展了智能体的感知空间,使其能够处理多模态环境输入;行动模块则扩展了智能体的行动空间,使其不仅能够生成文本输出,还能调用工具以完成更复杂的任务。因此,在基于LLM的智能体中,幻觉并非单纯的“语言错误”,而是可能在智能体流水线任意阶段出现的广义的虚构或误判的“类人行为”。由此可见,智能体幻觉的表现形式与成因要复杂得多,具体体现在以下三方面: 1. 类型更加多样化:智能体幻觉并非单模型的简单响应错误,而是由多个模块相互作用引发的复合行为,导致幻觉类型更广泛、更复杂。 1. 传播链条更长:传统幻觉多为局部的、单步的错误,而智能体幻觉往往跨越多个步骤,涉及多状态的转变。这类幻觉不仅可能出现在最终输出,还可能在感知与推理等中间环节产生,并随着时间推移不断传播与累积。 1. 后果更为严重:智能体幻觉涉及“具身后果”的错误,即错误的具身行动可能直接影响任务执行、系统设备以及现实中的用户体验。因此,智能体幻觉的代价和风险显著更高。

然而,现有关于基于LLM智能体的综述主要关注架构设计与实际应用,对于智能体幻觉的重要性与紧迫性则远远缺乏重视。 为此,我们对智能体幻觉进行了系统性的综述,以填补这一重要空白并推动智能体研究的进一步发展。本文将LLM智能体的交互动态建模为部分可观测马尔可夫决策过程(POMDP),其中智能体与学习环境交互、做出决策、接收反馈并在多个时间步中更新其状态。在此通用POMDP设定下,我们的主要贡献总结如下: * 首个综述:据我们所知,这是首个专门回顾基于LLM智能体幻觉问题的综述。我们涵盖了关于幻觉缓解与检测的最新研究,提供了一个全面的视角。 * 创新分类体系:我们提出了一种新的智能体组件分解方式,将其划分为 内部状态(Internal State) 与 外部行为(External Behaviors)。前者由智能体维持的信念状态表征,作为智能体认知策略的最基本单元;后者则是由信念状态驱动的一系列主动行为。基于这种内外部的区分,我们对智能体幻觉进行了分类,涵盖了 五类智能体幻觉。 * 全面回顾:针对每一类智能体幻觉,我们给出了形式化定义、示例说明,并深入讨论了代表性研究。在此基础上,我们识别了 十八类触发因素,并总结了 十类通用的幻觉缓解方法,同时结合相应的检测手段,为读者提供清晰、前沿的研究全景。 * 未来展望:通过回顾与总结现有解决方案及其局限性,我们提出了若干未来值得探索的研究方向,这对于推动学术研究与现实部署都具有重要意义。 * 开放资源:我们整理并公开了超过 300 篇相关文献 的资源集合,并在 GitHub 上开放,以促进学术社区的交流与合作。

论文组织结构:本文余下部分安排如下:第2节介绍基于LLM智能体的形式化定义;第3节提出新的智能体幻觉分类体系;第4节回顾现有解决方案,重点关注幻觉缓解方法;第5节讨论未来研究方向;第6节对全文进行总结。