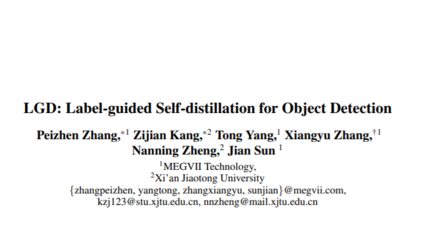

论文题目:LGD: Label-guided Self-distillation for Object Detection 中文题目:LGD:用于物体检测的标签引导自蒸馏 论文链接:

https://www.zhuanzhi.ai/paper/4649789799b6a71809c04f330333e194

以往的检测蒸馏均依赖强预训练教师网络的知识。然而现实应用中未必能屡屡获得这样的教师。

由此我们提出了首个用于通用目标检测的自蒸馏框架,它通过跨物体(1)标签嵌入和(2) 学生网络特征的异构模态交互,来获取指导性知识,只需常规监督训练标签。

因此被称为标签引导自蒸馏 (Label-Guided Self-distillation, LGD)。LGD 在多种检测器/数据集下均取得明显提升,相比经典预训练教师蒸馏模型 FGFI 节省 51%的相对时间(除学生网络固有训练时间), 和 34%的绝对时间,且效果更佳。

成为VIP会员查看完整内容