量子启示的机器学习(QiML)是一个迅速发展的领域,由于其有潜力在经典计算框架内利用量子力学的原理,因此受到了全球研究者的关注。然而,当前的综述文献经常只是对QiML进行浅层次的探讨,而更多地关注更为广泛的量子机器学习(QML)领域。为了填补这一空白,这项综述为QiML提供了一个整合的、全面的调研,探讨了QiML的多种研究领域,包括张量网络模拟、去量子化算法等,并展示了近期的进展、实际应用以及可能的未来研究方向。进一步地,通过分析该术语的各种先前解释及其固有的模糊性,为QiML建立了一个具体的定义。随着QiML的不断发展,我们预期未来将从量子力学、量子计算和经典机器学习中汲取大量新的发展,进一步丰富该领域。这项调查旨在为研究者和实践者提供指导,为他们提供对QiML当前状况和未来方向的全面了解。

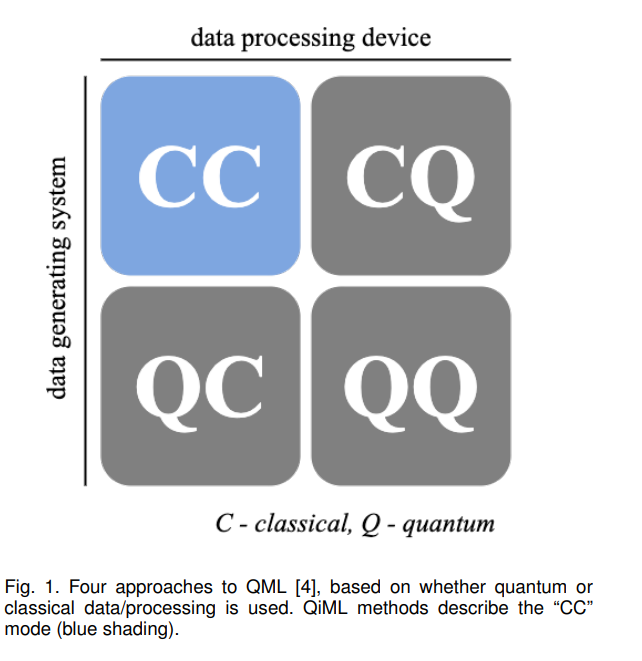

量子启示的机器学习(QiML)领域已经取得了大量的增长,吸引了全球研究者的关注。作为量子机器学习(QML)的一个特定子集,QiML专注于在经典计算框架内开发受量子力学原理启发的经典机器学习算法,这通常被称为QML分类中的“经典-经典”象限,如图1所示。QiML代表了一个多面的研究领域,其综述旨在超越传统的经典最先进的结果,或探索量子形式所提供的表现力。

为了在QML的背景下定位QiML,我们简要地说明了后者。更广泛地说,QML位于量子计算和机器学习的吸引人的交汇点。主导的研究领域关注“经典-量子”域,并探讨使用量子硬件加速和增强机器学习策略。在此,经典机器学习中存在的两大挑战得到了回应。首先,很多领域中数据集的不断增大和复杂化产生了计算挑战,这些挑战经典机器学习难以高效管理。其次,量子计算提供了解决目前用经典计算方法难以实现的复杂问题的潜力[1]。但是,目前在实际的量子硬件上评估QML算法受到一些因素的限制,例如量子位数有限、量子门中的高误差率、维持量子状态(失去相干性)的困难,以及与量子错误纠正相关的挑战[2]。因此,QML的景观主要受到理论考虑的影响,而噪声中间规模量子(NISQ)设备的最近进展为全规模量子计算的潜力提供了一个初步的、经验性的预览[3]。因此,QML对机器学习领域的真正影响和范围仍然是一个持续的研究话题。

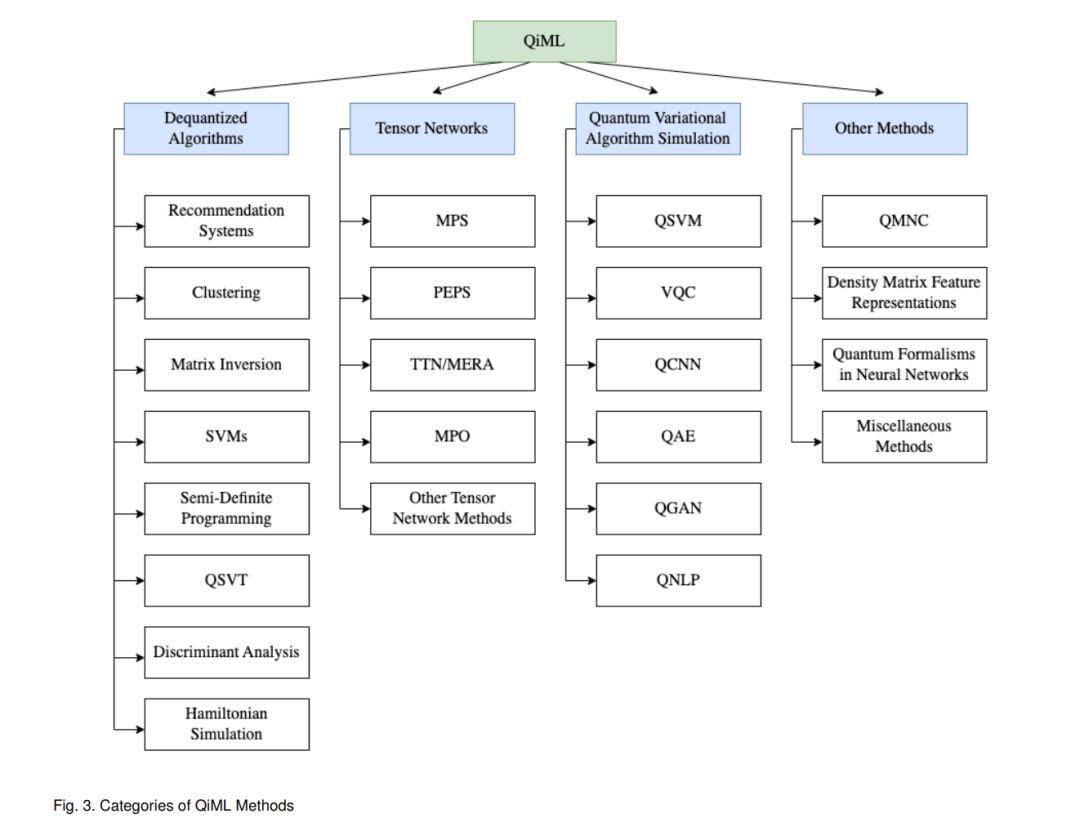

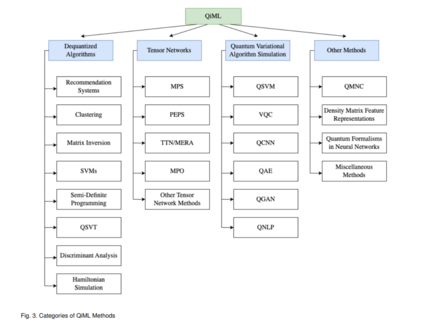

QiML与QML研究并肩发展。经常被引用的研究领域包括张量网络量子模拟和去量子化算法[4],[5]。然而,与QML相比,QiML中的发现通常都有数字证据支持,这得益于没有量子硬件的要求,因此相对于其他QML子集,更容易进行定量评估。虽然QiML研究正在蓬勃发展,但当前的综述文献往往忽略了这一领域,更多的关注是放在整个QML上。通常,QiML只是被简要提及或被浅层次地处理[5],[6],[7],[8],[9],[10]。QiML的实际应用案例、其应用以及与标准经典基准的比较分析通常都没有被探索。这指出了对QiML作为一个独立领域进行深入审查的迫切需求。为了回应这一文献空白,我们的调查旨在为QiML的各个方面提供一个全面、综合的讨论。

我们的目标是提供一个关于QiML在实践中如何被使用的可访问和全面的概述,详细描述其最近的进展,并使读者了解该领域的进展。读者应该注意,从量子力学的视角探索QiML方法,并基于启示来源对方法进行分类将是有趣的,但这次调查是从应用的角度来看待这个领域的。这次调查的贡献是提供了近年来QiML及其研究方向的进展概述,并确定了QiML研究的未来方向。具体来说,它们是:突出并分类现有的QiML方法; • 为QiML建立一个具体的定义,考虑到其多方向的研究趋势; • 讨论这些方法的实际应用,特别是确定当前已经应用QiML技术的任务; • 讨论QiML在实践中的限制因素,以及; • 探索和讨论QiML研究的潜在未来方向。