兵棋推演是多层面、多参与者的冲突模拟,其中参与者的决策会影响未来事件发展。兵棋推演常被用于探索决策的战略影响。然而,它也涵盖面向娱乐的模拟,从国际象棋到《龙与地下城》(D&D)等桌面角色扮演游戏。在兵棋推演谱系中更为开放的一端,玩家使用自然语言传达其行动,由裁决员判定结果。语言模型(LM)正日益被考虑用于为现实世界的关键决策提供洞察。我们对精选的100篇近期关于兵棋推演中人工智能的文献进行了范围界定审查,据此构建了一个基于玩家或裁决员所获创造力的兵棋推演本体论。聚焦于为玩家和裁决员提供最大开放度的兵棋推演空间,我们提炼出一套关于何时及如何在不同应用领域使用语言模型的考量因素。我们还提出了一套安全考量、在开放式兵棋推演中部署语言模型的最佳实践,并以一系列高影响力的开放性研究挑战作为总结。

数千年来,启动群体间暴力冲突的决定始终是严格由人类掌控的事务。尽管常言道“战争从未改变”,但若没有后半句“唯有武器是新的”,这句话就不完整。现实是,人工智能(AI)正在彻底改变人类关于战争的决策方式。AI在高风险场景中的使用意味着,机器错误将以人类生命的损失来衡量,而非损失函数或基准分数。

在过去五年中,AI作为现实世界决策流程一部分的采用速度加快,这主要得益于语言模型(LM)在研究和工程上的进步(Kwa等人,2025年)。由语言模型驱动的AI系统正日益用于帮助分析和规划困难任务。AI提供通用人类水平智能的隐含承诺,意味着这些系统现在受到各国政府、军事安全组织和跨国公司的极大关注,将其作为实现运营自动化、以期达到更高效能或降低失败率的一种手段。然而,兵棋推演并不仅限于战争。该术语泛指任何多层面描绘冲突、且参与者决策会影响事件未来结果的游戏。因此,“兵棋推演”被用于辅助商业、外交、法律、医疗保健、网络安全和军事领域的战略决策。这些领域的主题专家(SME)寻求在以语言为中心、因而具有开放性的兵棋推演中利用AI,从而赋予玩家高度创造性的构思能力(Hogan和Brennen,2024年)。历史上,这类推演只能作为纯人工演练进行,资源密集且难以大规模分析(Mood,1954年;Perla,1987年;Davis,2017年)。

这与分析性兵棋推演形成对比,后者具有受限的行动空间和有限的可能结果,这与我们所处混乱不确定的世界形成鲜明对比。因此,分析性兵棋推演在适用于依赖叙事理解或社会人为因素的场景方面存在局限性(Geist等人,2022年)。那些具有界限分明行动空间和明确定义评估标准的游戏,适合作为计算模拟来实现,并且可以有效地应用搜索、蒙特卡洛树搜索(MCTS)和强化学习(RL)等AI系统。

语言模型为基于语言的开放式游戏的各方面自动化开辟了众多新的可能性。与此同时,这些机会由于此类游戏的开放性本质所赋予的更大自由度而带来了严重的部署风险(Rivera等人,2024年)。早期的语言模型实验使用现成的模型来玩脚本化事件的分析性兵棋推演,结果发现其导致脆弱的推理、幻觉和不遵守规则(Lamparth等人,2024年)。

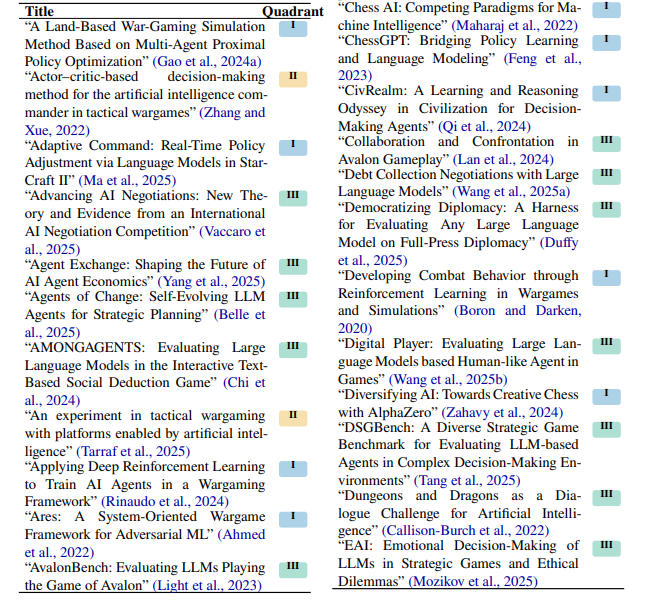

本文呢提出了一份全面的范围界定文献综述,为在复杂兵棋推演场景中部署AI确立了关键的、以讨论为导向的需求。本文通过为研究人员提供深入领域分析和高影响力研究方向战略路线图,填补了文献中的重大空白。本文的关键贡献包括: ● 一个关于开放式兵棋推演的精选参考目录,用以指导AI研究人员。 ● 一种新颖的分类法,帮助研究人员识别兵棋推演的关键特征。 ● 语言模型在兵棋推演中应用的特定领域需求,概述关键设计原则与挑战。 ● 一套供从业者使用的降低风险并确保语言模型在兵棋推演应用中可靠性的最佳实践框架。 ● 对在兵棋推演中使用语言模型的安全考量进行的审视。 ● 一组开放性研究问题及未来工作的明确方向。

兵棋推演中的人工智能

当前关于兵棋推演中人工智能的研究主要针对分析性游戏,这类游戏的世界状态及其通过行动改变的方式由严格的规则和一个离散的(尽管有时组合数量巨大)游戏状态空间所定义。常见的例子包括国际象棋、围棋和《星际争霸》(Silver等人,2017年;Vinyals等人,2019年;Goodman等人,2020年;Ma等人,2025年)。这些游戏没有提供融入模糊性、创造性或多方互动的机会,而这些正是开放式游戏的核心。以范围严格的动能或后勤模拟形式提供的计算支持要可行得多,通常能提供真实无误的游戏状态和转换。因此,分析性游戏适合使用状态空间搜索、MCTS和RL(Wan等人,2023年;Black和Darken,2024年)等技术的人工智能游戏代理。这些AI技术可以成为强大的求解器,但代价是难以推广到新场景(Balloch等人,2022年)。

兵棋推演相关文献