主题: GANs in computer vision: Introduction to generative learning

主要内容: 在这个综述系列文章中,我们将重点讨论计算机视觉应用程序的大量GANs。具体地说,我们将慢慢地建立在导致产生性对抗网络(GAN)进化的思想和原则之上。我们将遇到不同的任务,如条件图像生成,3D对象生成,视频合成。

目录:

- 对抗学习

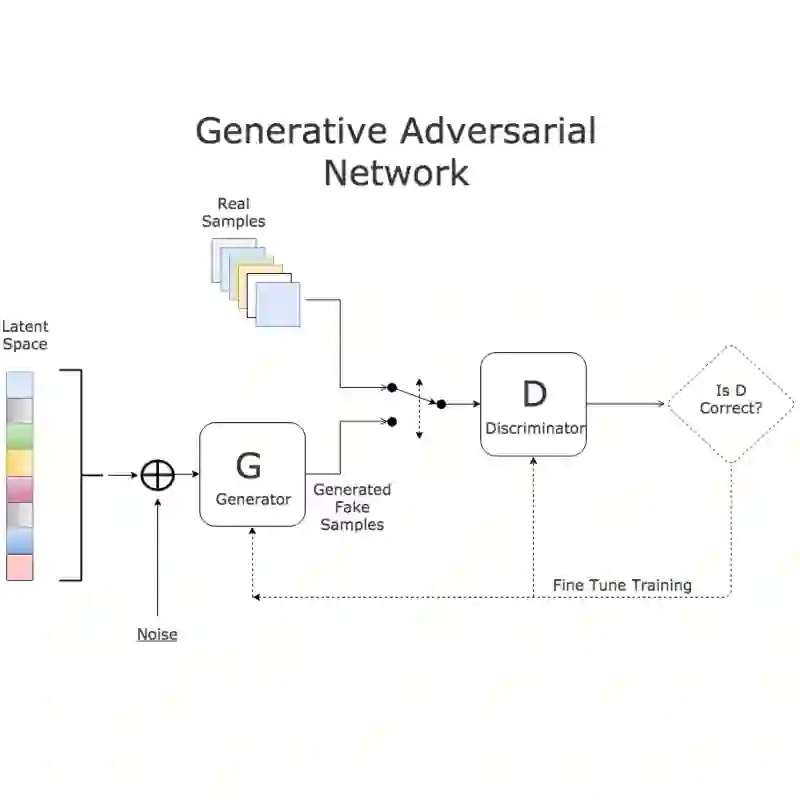

- GAN(生成对抗网络)

- 条件生成对抗网

- 基于深度卷积

- 生成对抗网络的无监督表示学习

- Info GAN: Info最大化生成对抗网的表征学习

一般来说,数据生成方法存在于各种各样的现代深度学习应用中,从计算机视觉到自然语言处理。在这一点上,我们可以用肉眼生成几乎无法区分的生成数据。生成性学习大致可分为两大类:a)变分自编码器(VAE)和b)生成性对抗网络(GAN)。

成为VIP会员查看完整内容

相关内容

专知会员服务

56+阅读 · 2019年11月28日