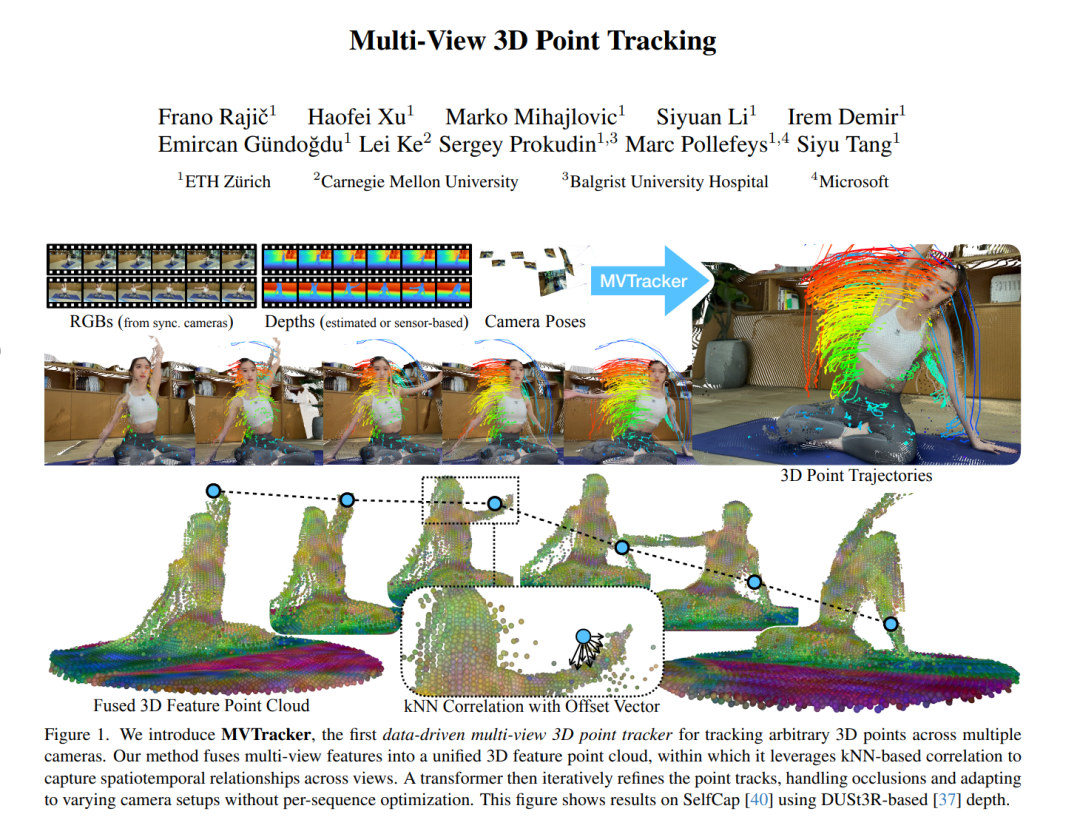

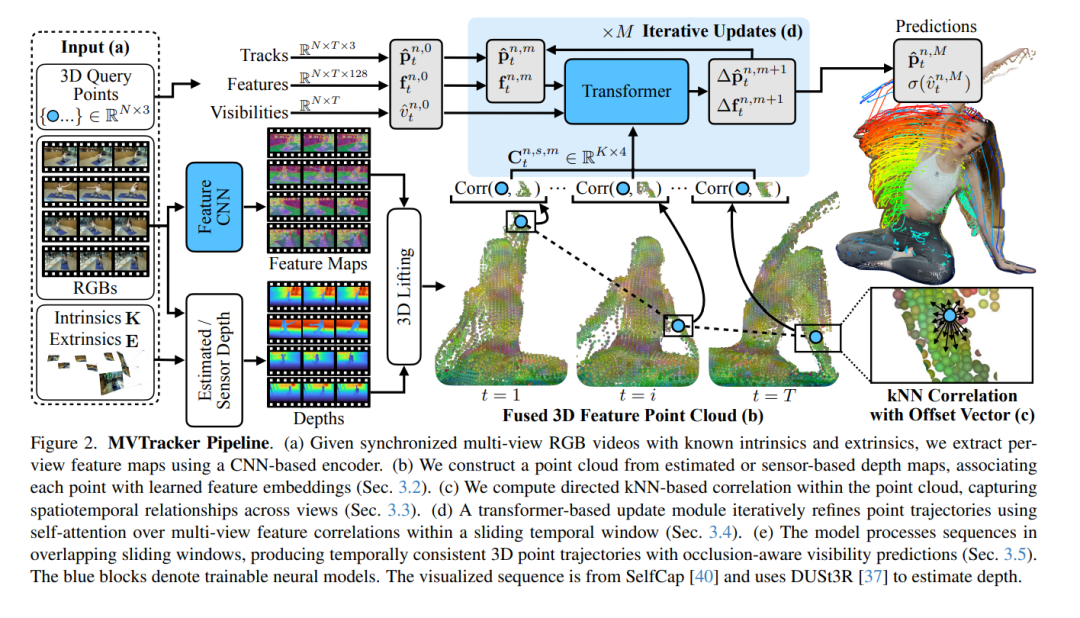

我们提出了首个数据驱动的多视角三维点跟踪器,旨在利用多个相机视角跟踪动态场景中的任意点。与现有的单目跟踪器相比,后者在深度歧义和遮挡情况下表现不佳,或与以往需要超过 20 个相机且每个序列都需要繁琐优化的多摄像头方法不同,我们的前馈模型使用实际数量的相机(例如,四个相机)直接预测三维对应点,从而实现了鲁棒且精准的在线跟踪。给定已知的相机姿态和传感器基于或估算的多视角深度,我们的跟踪器将多视角特征融合成统一的点云,并通过 k 最近邻相关性与基于变换器的更新相结合,可靠地估算长距离三维对应点,即使在遮挡情况下也能保持稳定。我们在 5000 个合成的多视角 Kubric 序列上进行了训练,并在两个真实世界基准上进行了评估——Panoptic Studio 和 DexYCB,分别达到了 3.1 厘米和 2.0 厘米的中位轨迹误差。我们的方法能很好地推广到 1 至 8 个视角的多种相机设置,具有不同的视角和 24 到 150 帧不等的视频长度。通过发布我们的跟踪器以及训练和评估数据集,我们旨在为多视角三维跟踪研究设立新的标准,并为实际应用提供一种实用工具。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

217+阅读 · 2023年4月7日

Arxiv

147+阅读 · 2023年3月29日