主题: Meet AdaMod: a new deep learning optimizer with memory

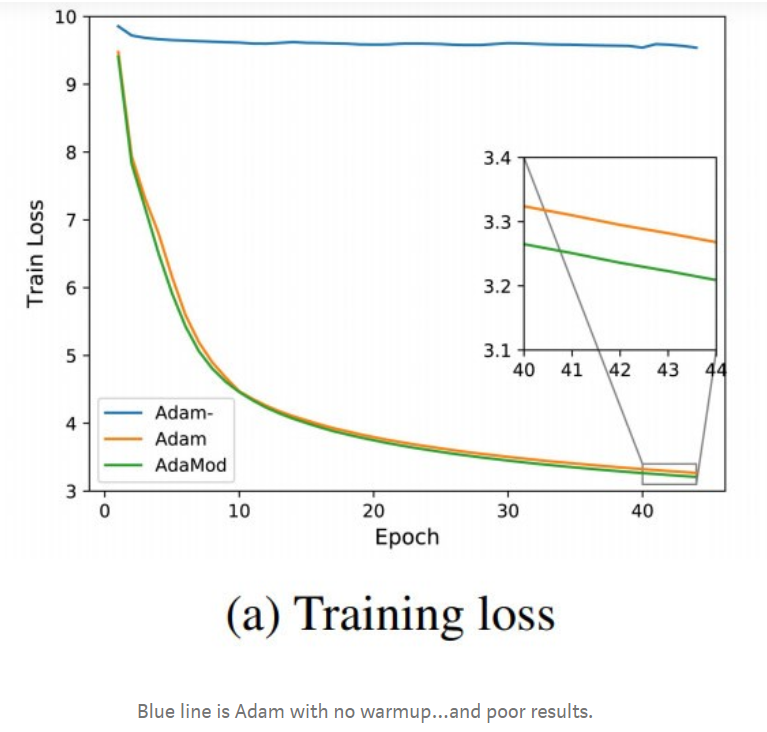

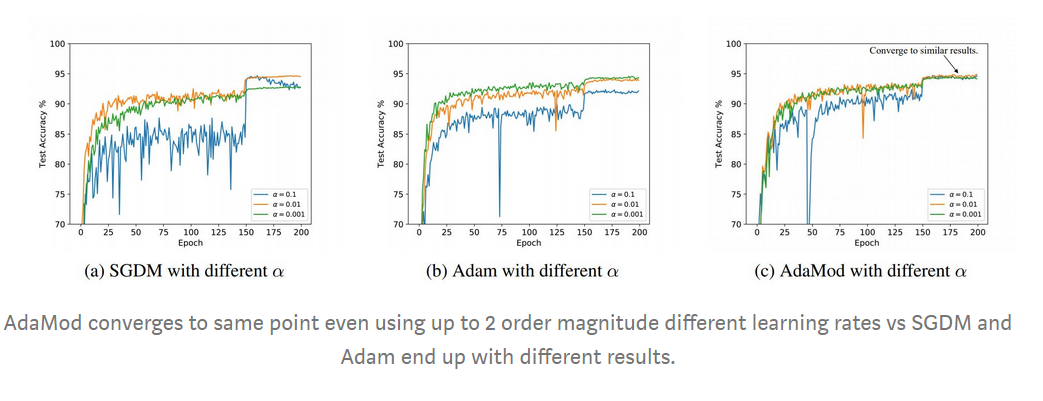

简介: AdaMod是一个新的深度学习优化器,它建立在Adam的基础上,但提供了一个自动预热启发式和长期学习率缓冲。从最初的测试来看,AdaMod是一个前5名的优化器,它很容易击败或超过vanilla Adam,同时对学习率超参数不太敏感,训练曲线更平滑,不需要热身模式。

成为VIP会员查看完整内容

相关内容

人工智能(Artificial Intelligence, AI )是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。 人工智能是计算机科学的一个分支。