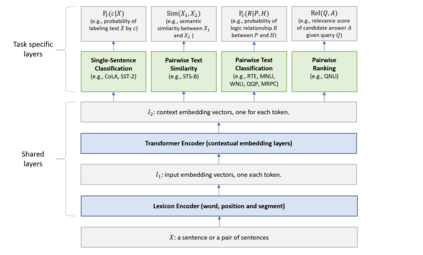

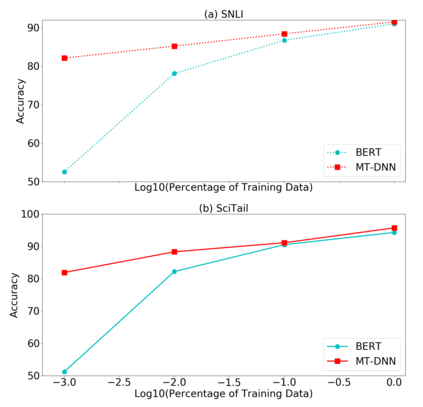

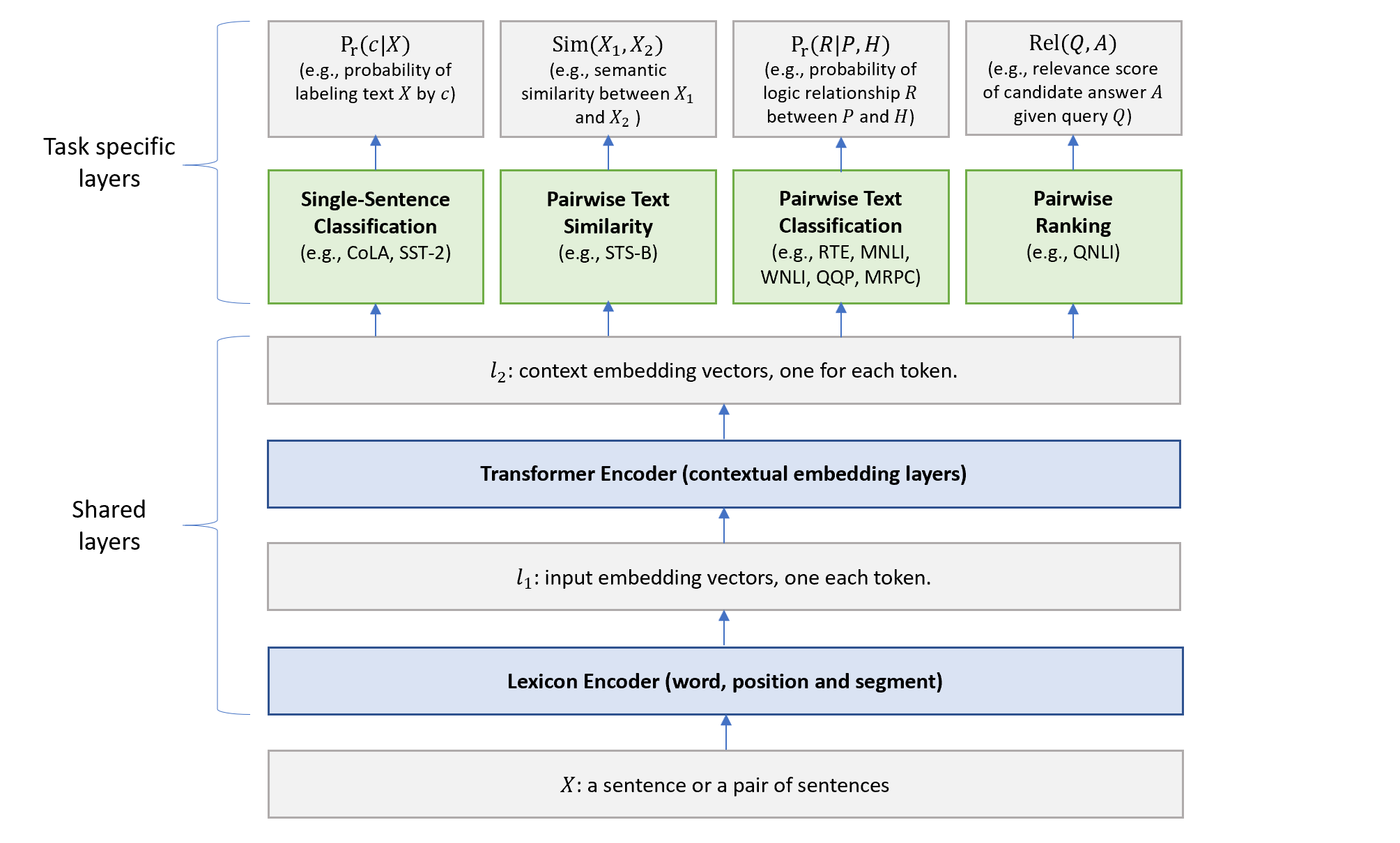

In this paper, we present a Multi-Task Deep Neural Network (MT-DNN) for learning representations across multiple natural language understanding (NLU) tasks. MT-DNN not only leverages large amounts of cross-task data, but also benefits from a regularization effect that leads to more general representations in order to adapt to new tasks and domains. MT-DNN extends the model proposed in Liu et al. (2015) by incorporating a pre-trained bidirectional transformer language model, known as BERT (Devlin et al., 2018). MT-DNN obtains new state-of-the-art results on ten NLU tasks, including SNLI, SciTail, and eight out of nine GLUE tasks, pushing the GLUE benchmark to 82.7% (2.2% absolute improvement). We also demonstrate using the SNLI and SciTail datasets that the representations learned by MT-DNN allow domain adaptation with substantially fewer in-domain labels than the pre-trained BERT representations. The code and pre-trained models are publicly available at https://github.com/namisan/mt-dnn.

翻译:在本文中,我们提出了一个多语言深心神经网络(MT-DNNN),用于在多种自然语言理解(NLU)任务中进行学习。MT-DNNN不仅利用大量跨任务数据,而且还受益于正规化效应,这种效应导致更普遍的代表性,以便适应新的任务和领域。MT-DNNN通过纳入一个称为BERT(Devlin等人,2018年)的预先培训双向变压器语言模型,扩展了刘等人(2015年)中提议的模型。MT-DNNN获得10项NLU任务的最新结果,包括SNLI、SciTail和9项GLUE任务中的8项,将GLUE基准推至82.7%(2.2%绝对改进)。我们还演示使用SNLI和SciTail数据集,即M-DNN所学的表示允许域内调用比事先培训的BERT代表机构少得多的域内标签。在https://github.comn/samn/samn.comm/preged模型上公开提供。