【MIT-Kenji博士论文】深度学习中的优化与可扩展性,260页pdf

深度神经网络在计算机视觉、机器学习和人工智能等许多领域都取得了显著的经验成功。随着经验上的成功,深度学习在理论上已被证明在表达能力方面具有吸引力。即具有一个隐层的神经网络可以近似任意连续函数,而具有更深层次的神经网络可以近似具有较少参数的特定类函数。表达理论指出,在一定规模的神经网络中,存在近似目标函数的最优参数向量。然而,在神经网络优化过程中,表达理论并不能保证能够有效地找到这样的最优向量。优化是深度学习的关键步骤之一,因为对数据的学习是通过优化来实现的,即对深度神经网络的参数进行优化,使网络与数据保持一致的过程。这个过程通常需要非凸优化,这对于一般的高维问题来说是不可扩展的。事实上,一般来说,神经网络的优化是不可扩展的,除非对其架构做额外的假设。

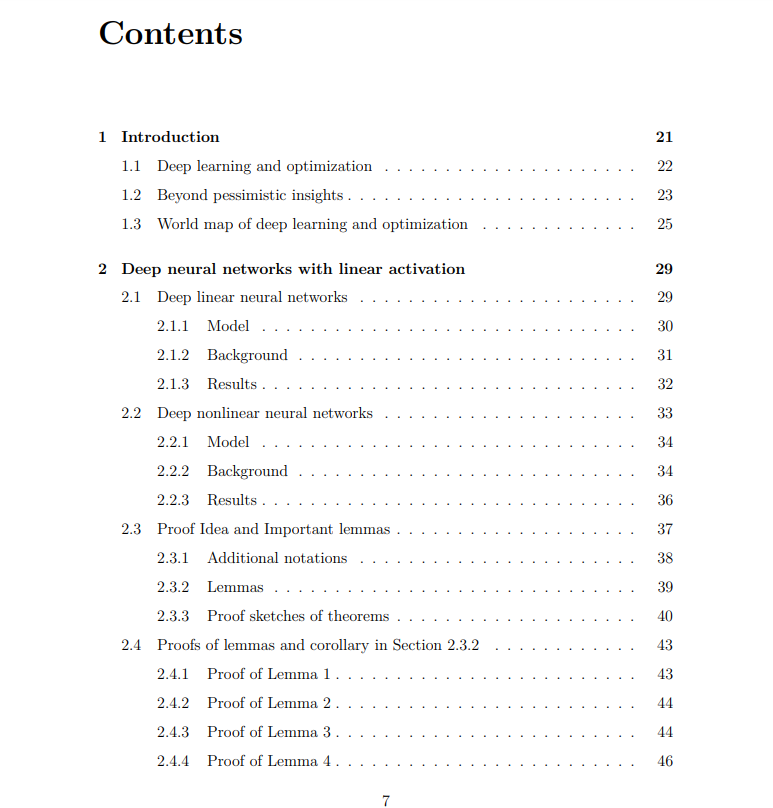

本文通过研究可扩展性中的一些基本瓶颈,如次最优局部极小值和鞍点,研究了各种深度神经网络体系结构的非凸优化问题。特别地,对于深度神经网络,我们给出了局部极小值和临界点的各种保证,以及梯度下降找到的点。证明了在深度神经网络非凸优化中,对实际度进行适度的过参数化可以保证梯度下降找到全局最小值。此外,即使没有过度参数化,我们表明,无论是理论还是经验,增加参数的数量,改善临界点和局部极小值的值向全局最小值。我们还证明了残差神经网络局部极小值的理论保证。此外,本文提出了一个统一的理论来分析这些特定架构之外的各种深度神经网络的临界点和局部极小值。这些结果表明,尽管在理论的最坏情况和最坏的架构中存在可伸缩性问题,但我们可以避免这个问题,并在实践中对各种有用架构的大型问题进行良好的可扩展性。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“OSDL” 就可以获取《【MIT-Kenji博士论文】深度学习中的优化与可扩展性,260页pdf》专知下载链接