Facebook田渊栋:NeurIPS 2020中了两篇,感觉还算不错

编辑 | 陈大鑫

做理论需要的基础知识多,困难,周期长,没有直接经济效益,还只能一两个人单打独斗且无法使用大量计算资源,每个因素都和现在的主流发展方向(强调团队合作,强调速度和新闻性,代码开源,大数据,大量计算资源)背道而驰。 而且,理论研究论文大多艰深、晦涩难懂,结论依赖不现实的假设,难免令人望而却步乃至失望。相比之下,实验研究效果立竿见影,传播快。

理论研究要让少数的、有情怀的人去做,远离市场噪杂和竞争,慢慢地钻研。“一万个硕士博士里有一个怀着这个理想,那迟早有一天会做出来的,大部分人不用费这个力气的。”

这篇一作文章的理论在deadline前四天才被发现,在理论被发现之前,对策略变化的得分计算一直用的是一个极其复杂的方案,考虑各种状态进入和离开信息集的情况,光代码本身就写了一周,修理各种corner case修到头都秃了。最后实验上的效果也确实是单调上升,但一直证明不出来其正确性。

直到某一天晚上意识到根本不需要这么复杂,推出了非常简单的公式之后不敢相信自己的眼睛,立即重写代码,从晚上 十点半写到十点四十分 ,跑出来的结果是一样的,速度还快。

数学的美,可能正是美在这里。 另一篇最后一作的中稿文章基本上我 从头到尾都重写过一遍 ,包括abstract,introduction,方法还有实验部分。反观第三篇没中的,其实整体思路及实验效果都非常好,但因为写作只把关了abstract和intro,导致方法论的描述部分出现了低级失误,给reviewers造成了巨大的误解,可惜了。 做研究,文章其实贵精不贵多,现在铺天盖地的AI论文,每天看arXiv都看不完,但留下印象的,给领域提供实质性贡献的,其实并不多。

我每次向别人介绍FAIR内部的评价体系,都会说“ 我们不看论文数量”,每半年打绩效,只问有没有Top-3的工作 ,在每篇工作里的具体贡献是什么: 思路是谁提出的?代码是谁写的?实验是谁跑的?效果是谁调上去的?定理是谁证的?文章是谁写的? 其它的各种挂名文列上去就行,也没人会在意。这样算下来, 花大力气发一篇好工作是正分,发一百篇毫无关联的水文是零分甚至是负的印象分 ,这样也可以鼓励大家多出成果少搭便车。

我也在向这方面一直继续努力。 曾经挺羡慕那些文章列表上百的朋友们,但后来才明白什么才是自己想要走的道路。

之后的ICLR还会延续同样的模式,除开被拒转投的文章,还会有两篇新的文章出来,还是老样子,一篇一作,一篇最后一作。两篇文章都非常不错,而教师-学生的神经网络理论分析也将回归,用在一个大家想不到却正是极其适合的地方,得到极其有趣的结果,敬请期待。

接下来田渊栋博士对两篇中奖论文的介绍。

论文一

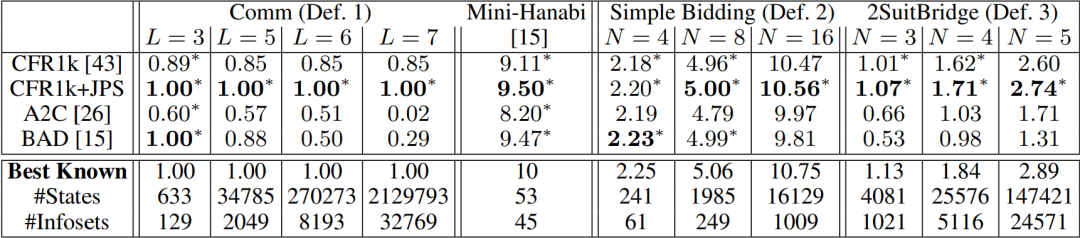

种协议,这6种协议是完全对称的,采用任何一种玩家2都可以猜中得1分。但如果规则稍微改一下,比如说发送黑桃A有0.1的附加分,那若玩家1和玩家2采用“抽红桃A发红桃A, 抽黑桃A发方块A”的协议,就赚不到这个附加分,是局部极小策略。但玩家1和玩家2单方面都不想改变自己的策略,因为单方面改变的结果是对方不理解自己策略的改变,导致得分的下降。

种协议,这6种协议是完全对称的,采用任何一种玩家2都可以猜中得1分。但如果规则稍微改一下,比如说发送黑桃A有0.1的附加分,那若玩家1和玩家2采用“抽红桃A发红桃A, 抽黑桃A发方块A”的协议,就赚不到这个附加分,是局部极小策略。但玩家1和玩家2单方面都不想改变自己的策略,因为单方面改变的结果是对方不理解自己策略的改变,导致得分的下降。

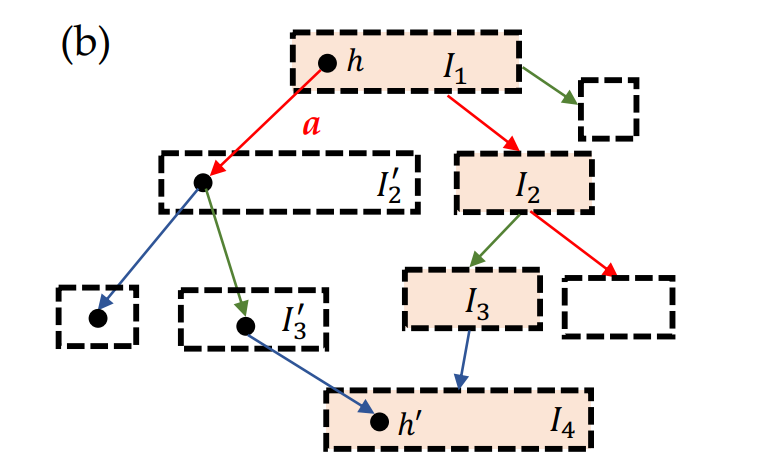

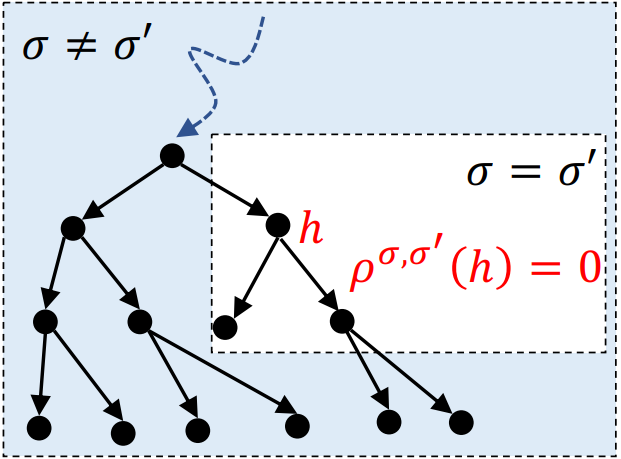

假设带阴影的这些信息集(Information Set)上的策略需要优化,但问题在于如果改变了上游的策略,则下游信息集内各状态的可到达概率就会发生各种变化,从而隐含地改变下游的期望得分;而下游策略的改变,又会改变上游的期望得分。

假设带阴影的这些信息集(Information Set)上的策略需要优化,但问题在于如果改变了上游的策略,则下游信息集内各状态的可到达概率就会发生各种变化,从而隐含地改变下游的期望得分;而下游策略的改变,又会改变上游的期望得分。

如果一个状态的当前策略没有变化,那么策略变化密度(policy-density change) 正好等于零。这个和周围的策略有没有变化无关。

如果一个状态的当前策略没有变化,那么策略变化密度(policy-density change) 正好等于零。这个和周围的策略有没有变化无关。

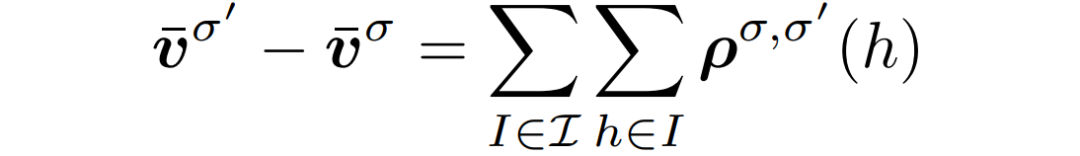

联合策略搜索在四个不同的小游戏上都改进了游戏得分。

联合策略搜索在四个不同的小游戏上都改进了游戏得分。

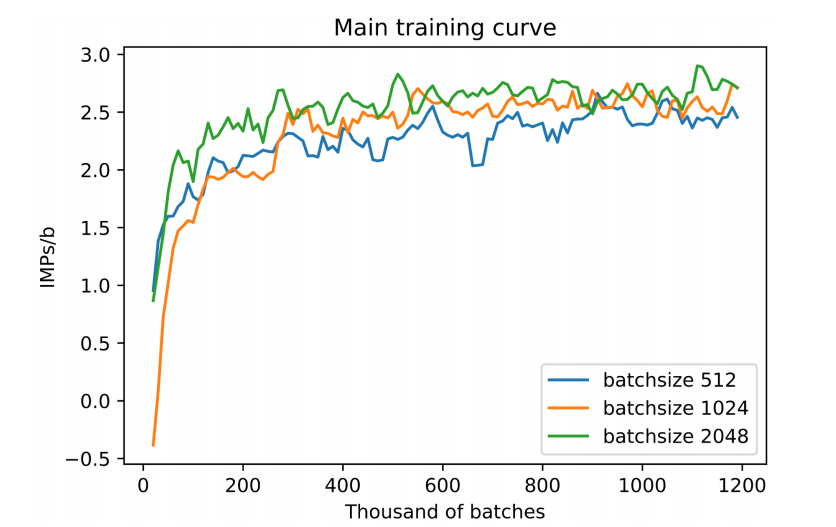

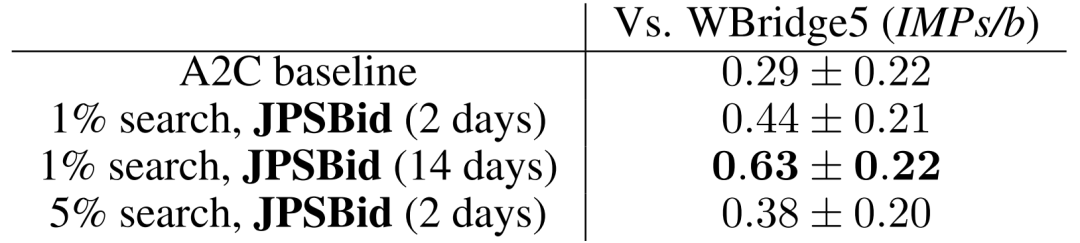

IMPs/b (平均每桌的国际比赛分)这个应该算是目前最好的结果了(State-of-the-Art)。

IMPs/b (平均每桌的国际比赛分)这个应该算是目前最好的结果了(State-of-the-Art)。

论文二

,

描述如果选择行动

,

描述如果选择行动

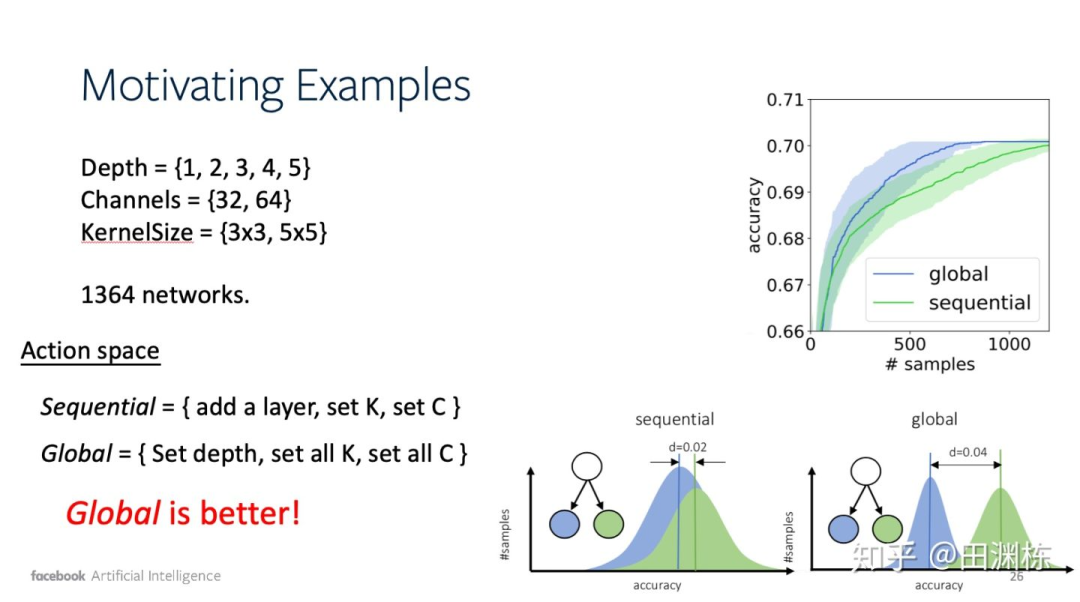

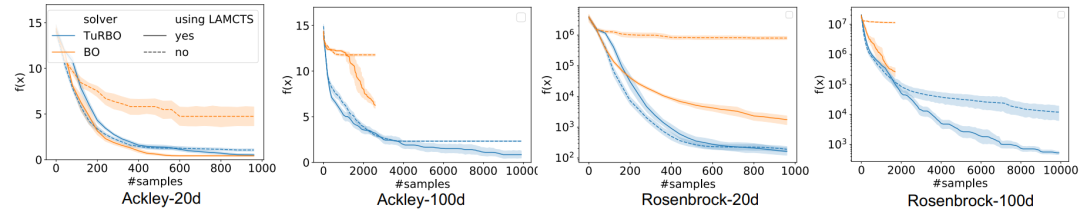

神经网络架构搜索(NAS)上的简单例子,先按层数切分搜索空间(蓝线),搜索效率得到了提高。

神经网络架构搜索(NAS)上的简单例子,先按层数切分搜索空间(蓝线),搜索效率得到了提高。

登录查看更多

相关内容

Arxiv

0+阅读 · 2020年12月3日

Arxiv

0+阅读 · 2020年11月30日