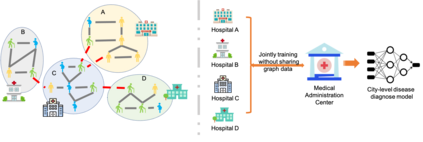

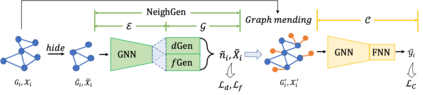

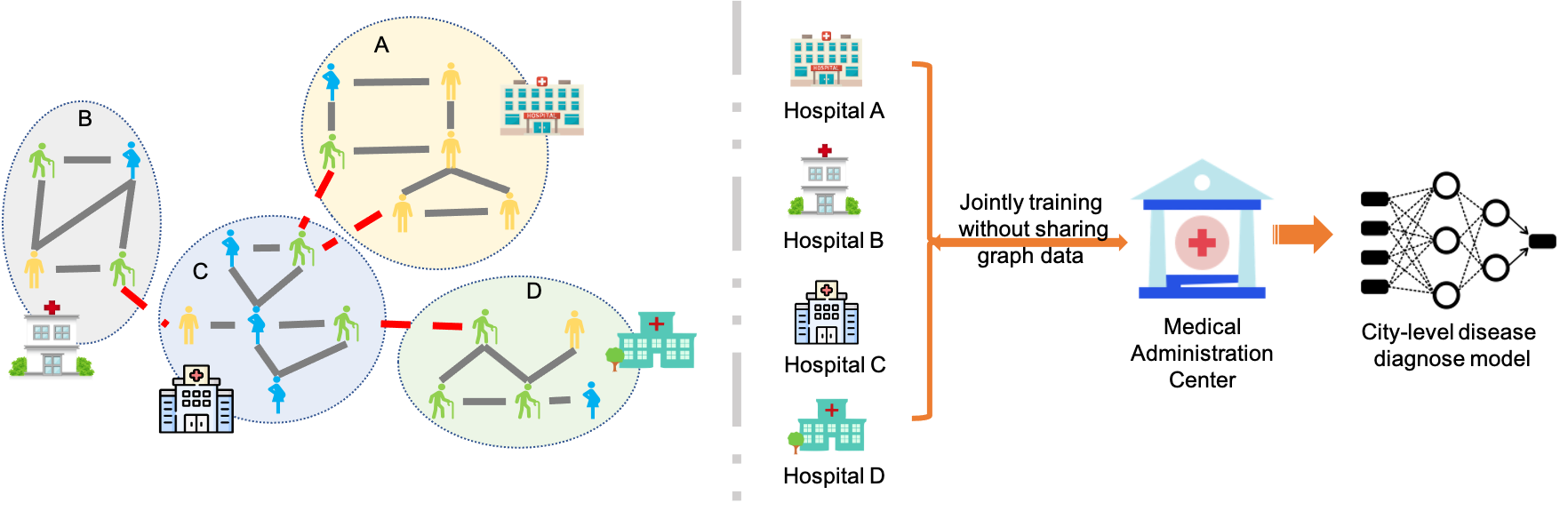

Graphs have been widely used in data mining and machine learning due to their unique representation of real-world objects and their interactions. As graphs are getting bigger and bigger nowadays, it is common to see their subgraphs separately collected and stored in multiple local systems. Therefore, it is natural to consider the subgraph federated learning setting, where each local system holding a small subgraph that may be biased from the distribution of the whole graph. Hence, the subgraph federated learning aims to collaboratively train a powerful and generalizable graph mining model without directly sharing their graph data. In this work, towards the novel yet realistic setting of subgraph federated learning, we propose two major techniques: (1) FedSage, which trains a GraphSage model based on FedAvg to integrate node features, link structures, and task labels on multiple local subgraphs; (2) FedSage+, which trains a missing neighbor generator along FedSage to deal with missing links across local subgraphs. Empirical results on four real-world graph datasets with synthesized subgraph federated learning settings demonstrate the effectiveness and efficiency of our proposed techniques. At the same time, consistent theoretical implications are made towards their generalization ability on the global graphs.

翻译:数据挖掘和机器学习中广泛使用图表,原因是它们独特地代表了现实世界的物体及其相互作用。由于图表现在正在变得越来越大,因此看到它们的子集单独收集并存储在多个本地系统中是常见的。因此,自然会考虑子集联学习设置,每个地方系统持有一个可能与整个图表分布有偏差的小型子集的子集。因此,子集成学习的目的是在不直接分享其图形数据的情况下,合作训练一个强大和可通用的图形采矿模型。在这项工作中,我们提出了两种主要技术:(1) FedSage,它根据FedAvg培训一个图形学模型,以整合节点特征、链接结构和多个本地子集图上的任务标签;(2) FedSage+,它与FedSage一起培训一个缺失的邻居发电机,以处理本地子集缺失的链接。在四个真实世界的图表数据集中,以合成的子集联成的子集化学习设置,我们提出了两种主要技术:(1) FedSage,它以FedSage为基础,用于全球通用的理论影响。