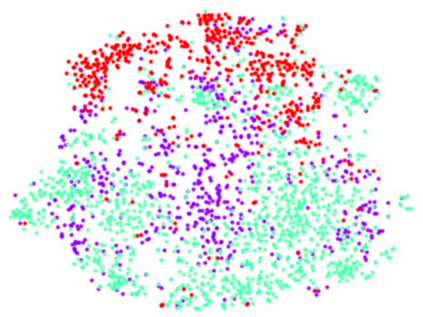

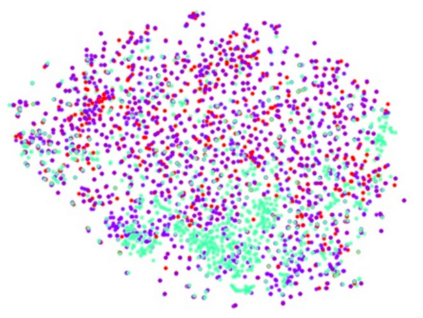

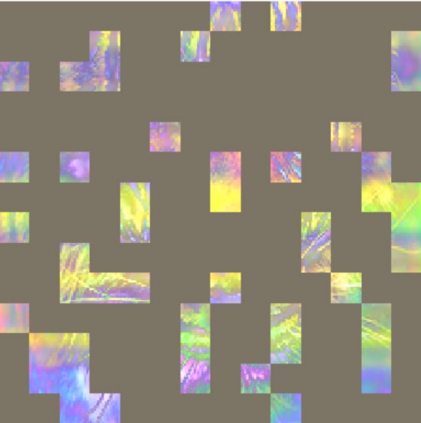

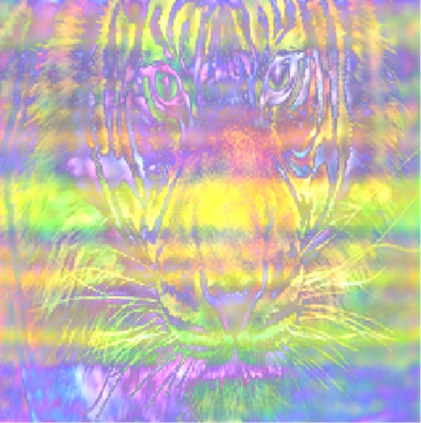

Generalizing learned representations across significantly different visual domains is a fundamental yet crucial ability of the human visual system. While recent self-supervised learning methods have achieved good performances with evaluation set on the same domain as the training set, they will have an undesirable performance decrease when tested on a different domain. Therefore, the self-supervised learning from multiple domains task is proposed to learn domain-invariant features that are not only suitable for evaluation on the same domain as the training set but also can be generalized to unseen domains. In this paper, we propose a Domain-invariant Masked AutoEncoder (DiMAE) for self-supervised learning from multi-domains, which designs a new pretext task, \emph{i.e.,} the cross-domain reconstruction task, to learn domain-invariant features. The core idea is to augment the input image with style noise from different domains and then reconstruct the image from the embedding of the augmented image, regularizing the encoder to learn domain-invariant features. To accomplish the idea, DiMAE contains two critical designs, 1) content-preserved style mix, which adds style information from other domains to input while persevering the content in a parameter-free manner, and 2) multiple domain-specific decoders, which recovers the corresponding domain style of input to the encoded domain-invariant features for reconstruction. Experiments on PACS and DomainNet illustrate that DiMAE achieves considerable gains compared with recent state-of-the-art methods.

翻译:在不同的视觉领域普及所学的表达方式是人类视觉系统的基本但关键的能力。 虽然最近的自我监督学习方法在与培训组相同的领域里取得了良好的业绩, 但当在不同的领域里测试时,它们的表现将会减少。 因此, 从多个领域里自我监督学习的任务是要学习不仅适合与培训组一样在同一个领域进行评价的域内差异性特征, 而且还可以推广到看不见的领域。 在本文中, 我们建议使用一个“ 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- ” 来完成这个概念, D 域- 域- 域- 域- 类- 域- 域- 类- 类- 类- 类- 域- 域- 类- 域- 域- 域- 域- 域- 类- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 域- 类- 域- 级- 类、 类- 域- 域- 域- 类- 域- 域- 级- 类- 类- 类 类- 类- 类- 类 类- 类- 级- 级- 、 级- 级- 级- 级- 级- 级- 级- 级- 级- 、 级- 级- 级- 级- 级- 、 、 、 、 、 、 、 、 、 、 级- 、 级- 、 、 级- 、 、 级- 、 级- 级- 级- 级- 级- 级- 、 级- 级- 级- 、 、 级- 、 、 级- 级- 、 、 级- 、 、 、 级- 、 、 级- 、 、 级-