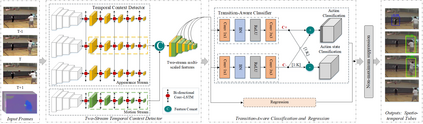

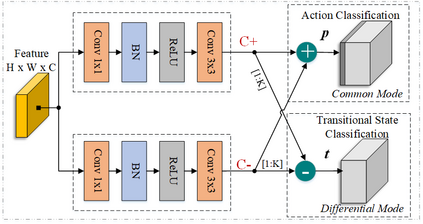

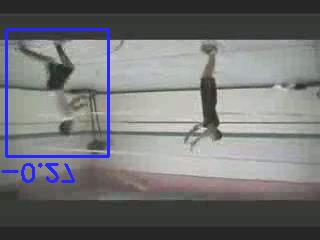

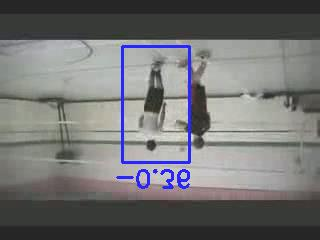

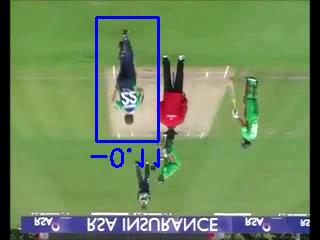

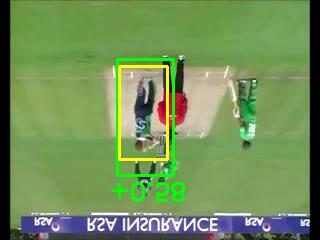

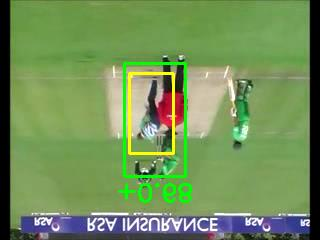

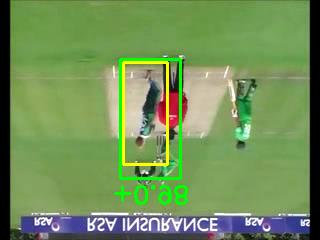

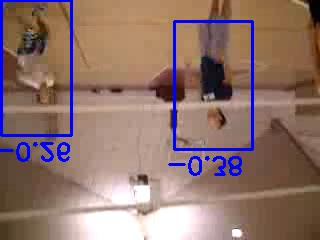

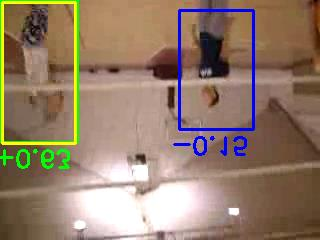

Current state-of-the-art approaches for spatio-temporal action detection have achieved impressive results but remain unsatisfactory for temporal extent detection. The main reason comes from that, there are some ambiguous states similar to the real actions which may be treated as target actions even by a well-trained network. In this paper, we define these ambiguous samples as "transitional states", and propose a Transition-Aware Context Network (TACNet) to distinguish transitional states. The proposed TACNet includes two main components, i.e., temporal context detector and transition-aware classifier. The temporal context detector can extract long-term context information with constant time complexity by constructing a recurrent network. The transition-aware classifier can further distinguish transitional states by classifying action and transitional states simultaneously. Therefore, the proposed TACNet can substantially improve the performance of spatio-temporal action detection. We extensively evaluate the proposed TACNet on UCF101-24 and J-HMDB datasets. The experimental results demonstrate that TACNet obtains competitive performance on JHMDB and significantly outperforms the state-of-the-art methods on the untrimmed UCF101-24 in terms of both frame-mAP and video-mAP.

翻译:目前最新的时空行动探测方法取得了令人印象深刻的成果,但对于时间范围的探测来说仍然不能令人满意。主要原因如下:有些模棱两可的状态与实际行动相似,即使受过良好训练的网络也可以把实际行动视为目标行动。在本文件中,我们将这些模棱两可的样本定义为“过渡状态”,并提议建立一个过渡――软件背景网络(TaCNet)以区分过渡期国家。拟议的TACNet包括两个主要组成部分,即时间背景检测器和过渡――认识分类器。时间背景检测器可以通过建立一个经常性网络来提取长期复杂的长期背景信息。过渡――aware分类器可以通过对行动和转型期国家同时进行分类来进一步区分过渡期国家。因此,拟议的TACNet可以大大改进空间――时空行动探测的性能。我们广泛评价了拟议的UCF101-24和J-HMDB数据集的TACNet。实验结果表明,TACNet在JHMDB上取得了竞争性的性能,并且通过建立一个经常性的网络,从而大大超越了SSM-24框架的UCMM-AP-M-M-MT-MT-M-M-A-MT-MAT-M-M-MAT-MAT-MAT-MAT-MAT-MAT-M-M-MAT-MAT-MAT-MAT-MAT-MAT-M-MAT-MAT-MAT-MAT-MAT-M-M-M-M-M-M-M-M-M-M-M-M-M-M-M-M-MAT-M-M-M-M-MAT-MAT-MAT-MAT-MAT-MAT-MAT-MAT-MAT-MAT-M-M-M-M-M-MAT-M-M-M-M-M-MA-M-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MAM-MAM-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA-MA