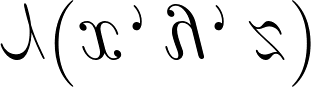

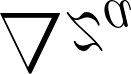

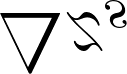

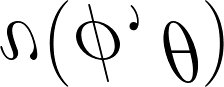

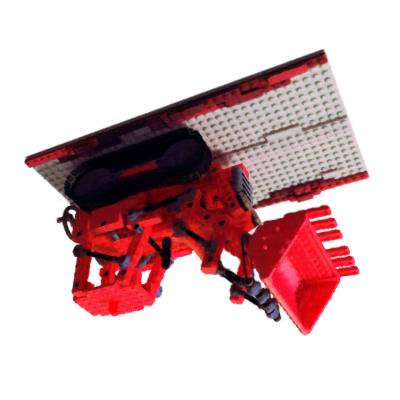

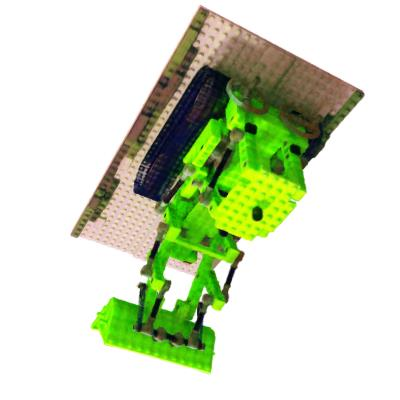

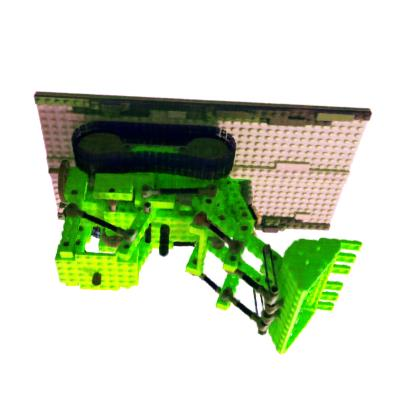

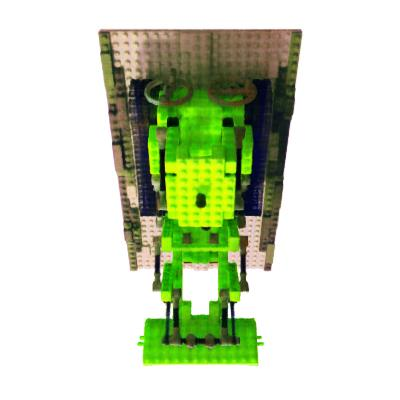

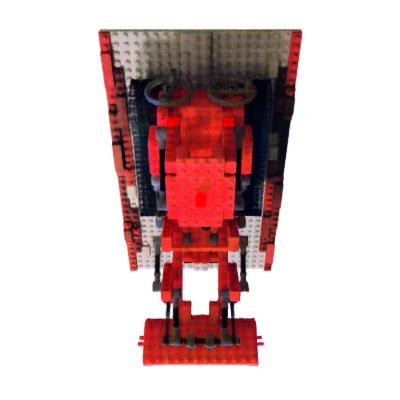

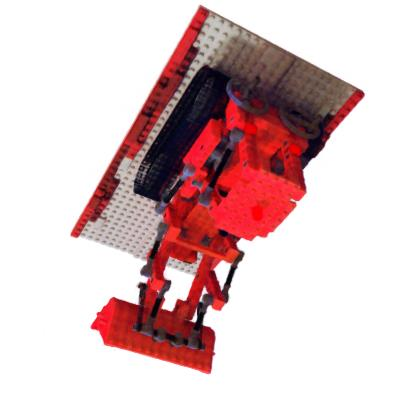

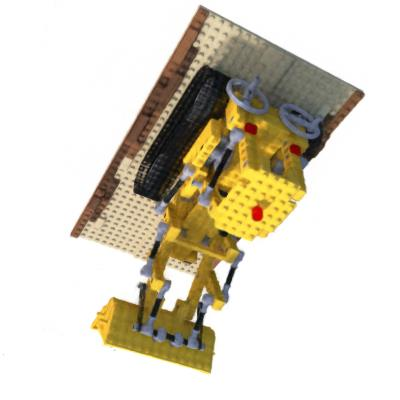

We present CLIP-NeRF, a multi-modal 3D object manipulation method for neural radiance fields (NeRF). By leveraging the joint language-image embedding space of the recent Contrastive Language-Image Pre-Training (CLIP) model, we propose a unified framework that allows manipulating NeRF in a user-friendly way, using either a short text prompt or an exemplar image. Specifically, to combine the novel view synthesis capability of NeRF and the controllable manipulation ability of latent representations from generative models, we introduce a disentangled conditional NeRF architecture that allows individual control over both shape and appearance. This is achieved by performing the shape conditioning via applying a learned deformation field to the positional encoding and deferring color conditioning to the volumetric rendering stage. To bridge this disentangled latent representation to the CLIP embedding, we design two code mappers that take a CLIP embedding as input and update the latent codes to reflect the targeted editing. The mappers are trained with a CLIP-based matching loss to ensure the manipulation accuracy. Furthermore, we propose an inverse optimization method that accurately projects an input image to the latent codes for manipulation to enable editing on real images. We evaluate our approach by extensive experiments on a variety of text prompts and exemplar images and also provide an intuitive interface for interactive editing. Our implementation is available at https://cassiepython.github.io/clipnerf/

翻译:我们提出了一个统一框架,允许使用简短的文本提示或实例图像,以方便用户的方式对 NeRF 进行操控,这是用于神经光亮场的多式 3D 物体操纵方法。我们通过利用最近的对比语言图像培训前(CLIP)模型的联合语言图像嵌入空间,提出一个统一框架,允许使用简短的文本提示或演示图像,对 NeRF 进行操控。具体地说,为了结合NeRF 的新视角合成能力和对基因化模型潜在显示的可控操纵能力,我们引入了一个不相干、有条件的 NERF 结构,允许对形状和外观进行个人控制。这是通过对定位编码应用学习的变形场进行形状调节和将颜色调节推迟到音量图像转换阶段来实现的。为了将这种分解的潜影代表与 CLIP 嵌入为输入,我们设计了两个代码映像器,用来反映已有的目标编辑。我们用CLIP 训练了一种基于 CLIP 的匹配损失来进行匹配,以确保校正/外观的校正校准准确度。此外,我们用一个精确的校正的校正的校正方法来进行我们的图像编辑。