知识荟萃

目标检测(物体检测, Object Detection) 专知荟萃

入门学习

- 图像目标检测(Object Detection)原理与实现 (1-6)

- [http://www.voidcn.com/article/p-xnjyqlkj-ua.html]

- [http://www.voidcn.com/article/p-ypylfzuk-ua.html]

- [http://www.voidcn.com/article/p-pfihszbt-ua.html]

- [http://www.voidcn.com/article/p-hcvjcaqy-ua.html]

- [http://www.voidcn.com/article/p-kjogyjfz-ua.html]

- [http://www.voidcn.com/article/p-zqfjjomb-u.html]

- 目标检测从入门到精通(1-3)

- 深度学习500问之目标检测

- 目标检测(Object Detection)入门

综述

-

地平线黄李超开讲:深度学习和物体检测!

-

对话CVPR2016:目标检测新进展:

-

基于深度学习的目标检测技术演进:R-CNN、Fast R-CNN、Faster R-CNN:

-

基于深度学习的目标检测研究进展

-

讲堂干货No.1|山世光-基于深度学习的目标检测技术进展与展望

-

基于特征共享的高效物体检测 Faster R-CNN和ResNet的作者任少卿 博士毕业论文 中文

-

R-CNN:论文笔记

-

Fast-RCNN:

- 深度学习物体检测(三)——FAST-RCNN:

- [https://www.cnblogs.com/yanshw/p/10767212.html]

- Fast-RCNN:[https://zhuanlan.zhihu.com/p/24780395]

-

Faster-RCNN:

-

FPN:

- Feature Pyramid Networks for Object Detection 论文笔记:

- [http://blog.csdn.net/jesse_mx/article/details/54588085]

- CVPR 2017论文解读:特征金字塔网络FPN:

- [http://www.sohu.com/a/159780794_465975]

- FPN(feature pyramid networks)算法讲解:

- [http://blog.csdn.net/u014380165/article/details/72890275]

-

R-FCN:

- 基于区域的全卷积网络来检测物体:

- [http://blog.csdn.net/shadow_guo/article/details/51767036]

- [译] 基于R-FCN的物体检测:

- [http://www.jianshu.com/p/db1b74770e52]

-

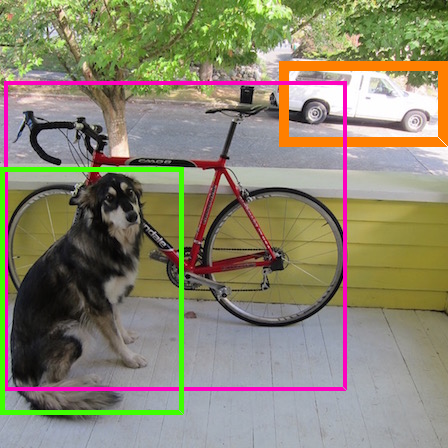

SSD:

- Single Shot MultiBox Detector论文阅读:

- [http://blog.csdn.net/u010167269/article/details/52563573]

- 【深度学习:目标检测】RCNN学习笔记(10):SSD:Single Shot MultiBox Detector:

- [http://blog.csdn.net/smf0504/article/details/52745070]

- 翻译SSD论文(Single Shot MultiBox Detector),仅作交流:

- [http://blog.csdn.net/Ai_Smith/article/details/52997456?locationNum=2&fps=1]

- CNN目标检测与分割(三):SSD详解:

- [https://blog.csdn.net/a8039974/article/details/77592395]

- SSD关键源码解析:

- [https://zhuanlan.zhihu.com/p/25100992]

-

YOLO:

- YOLO:实时快速目标检测:

- [https://zhuanlan.zhihu.com/p/25045711]

- YOLO详解: [https://zhuanlan.zhihu.com/p/25236464]

- YOLO升级版:YOLOv2和YOLO9000解析:

- [https://zhuanlan.zhihu.com/p/29816334]

- YOLO升级版:YOLOv2和YOLO9000解析:

- [https://zhuanlan.zhihu.com/p/29816334]

- YOLO v2之总结篇(linux+windows):

- [http://blog.csdn.net/qq_14845119/article/details/53589282]

- YOLOv2 论文笔记:

- [http://blog.csdn.net/jesse_mx/article/details/53925356]

- 目标检测网络之 YOLOv3

- [https://www.cnblogs.com/makefile/p/YOLOv3.html]

-

DenseBox:余凯特邀报告:基于密集预测图的物体检测技术造就全球领先的ADAS系统

-

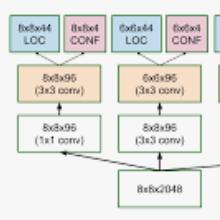

PVANET: Deep but Lightweight Neural Networks for Real-time Object Detection - [http://www.cnblogs.com/xueyuxiaolang/p/5959442.html]

-

深度学习论文笔记:DSSD - [https://jacobkong.github.io/blog/2938514597/]

-

DSOD

- 复旦大学Ph.D沈志强:用于目标检测的DSOD模型(ICCV 2017) | 分享总结:

- [http://www.sohu.com/a/198226907_114877]

- 目标检测--DSOD: Learning Deeply Supervised Object Detectors from Scratch:

- [http://blog.csdn.net/zhangjunhit/article/details/77247695]

-

Focal Loss:

- Focal Loss:

- [http://blog.csdn.net/u014380165/article/details/77019084]

- 读Focal Loss:

- [https://zhuanlan.zhihu.com/p/28873248]

-

Soft-NMS:

-

OHEM:

- 论文笔记 OHEM: Training Region-based Object Detectors with Online Hard Example Mining:

- [http://blog.csdn.net/u012905422/article/details/52760669]

-

Mask-RCNN 2017:

- Mask-RCNN 2017:

- [http://blog.csdn.net/inuchiyo_china/article/details/70860939]

- 目标检测分割--Mask R-CNN:

- [http://blog.csdn.net/zhangjunhit/article/details/64920075?locationNum=6&fps=1]

- 解读|Facebook 何凯明发大招:Mask R-CNN 狙击目标实例分割:

- [http://www.sohu.com/a/130676187_642762]

-

目标检测之比较

- 目标检测之RCNN,SPP-NET,Fast-RCNN,Faster-RCNN:

- [http://lanbing510.info/2017/08/24/RCNN-FastRCNN-FasterRCNN.html]

- RCNN, Fast-RCNN, Faster-RCNN的一些事:

- [http://closure11.com/rcnn-fast-rcnn-faster-rcnn%E7%9A%84%E4%B8%80%E4%BA%9B%E4%BA%8B/]

- 机器视觉目标检测补习贴之R-CNN系列 — R-CNN, Fast R-CNN, Faster R-CNN , 目标检测补习贴之YOLO实时检测, You only look once :

- [http://nooverfit.com/wp/]

- 目标检测算法:RCNN、YOLO vs DPM:

- [https://juejin.im/entry/59564e1f6fb9a06b9c7408f9]

- 如何评价rcnn、fast-rcnn和faster-rcnn这一系列方法?:

- [https://www.zhihu.com/question/35887527]

-

视觉目标检测和识别之过去,现在及可能

-

CVPR2019目标检测方法进展综述

-

基于深度学习的「目标检测」算法综述

-

目标检测综述

-

深度学习目标检测网络汇总对比

-

从锚点到关键点,最新的目标检测方法发展到哪了

-

从RCNN到SSD,这应该是最全的一份目标检测算法盘点

-

目标检测中的不平衡问题:综述

-

深度学习中用于对象检测的最新进展

-

基于深度学习的对象检测概述

-

目标检测20年:综述

- 深度卷积神经网络时代目标检测的最新进展

- 用于通用对象检测的深度学习:综述

进阶文章

-

Deep Neural Networks for Object Detection (基于DNN的对象检测)NIPS2013:

-

R-CNN Rich feature hierarchies for accurate object detection and semantic segmentation:

-

Fast R-CNN :

-

Faster R-CNN Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks:

-

Mask R-CNN

-

Light-Head R-CNN

-

Cascade R-CNN

-

Scalable Object Detection using Deep Neural Networks

-

Scalable, High-Quality Object Detection

-

SPP-Net Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition

-

DeepID-Net DeepID-Net: Deformable Deep Convolutional Neural Networks for Object Detection

-

Object Detectors Emerge in Deep Scene CNNs

-

segDeepM: Exploiting Segmentation and Context in Deep Neural Networks for Object Detection

-

Object Detection Networks on Convolutional Feature Maps

-

Improving Object Detection with Deep Convolutional Networks via Bayesian Optimization and Structured Prediction

-

DeepBox: Learning Objectness with Convolutional Networks

-

Object detection via a multi-region & semantic segmentation-aware CNN model

-

You Only Look Once: Unified, Real-Time Object Detection

-

YOLOv2 YOLO9000: Better, Faster, Stronger

-

YOLOv3

-

YOLT

-

AttentionNet: Aggregating Weak Directions for Accurate Object Detection

-

DenseBox: Unifying Landmark Localization with End to End Object Detection

-

SSD: Single Shot MultiBox Detector

-

DSSD : Deconvolutional Single Shot Detector

-

FSSD

-

ESSD

-

MDSSD

-

Pelee

-

Fire SSD

-

G-CNN: an Iterative Grid Based Object Detector

-

HyperNet: Towards Accurate Region Proposal Generation and Joint Object Detection

-

A MultiPath Network for Object Detection

-

R-FCN: Object Detection via Region-based Fully Convolutional Networks

-

A Unified Multi-scale Deep Convolutional Neural Network for Fast Object Detection

-

PVANET: Deep but Lightweight Neural Networks for Real-time Object Detection

-

Feature Pyramid Networks for Object Detection

-

Learning Chained Deep Features and Classifiers for Cascade in Object Detection

-

DSOD: Learning Deeply Supervised Object Detectors from Scratch

-

Focal Loss for Dense Object Detection ICCV 2017 Best student paper award. Facebook AI Research

-

MegDet

-

Mask-RCNN 2017 ICCV 2017 Best paper award. Facebook AI Research

-

RefineNet

-

DetNet

-

SSOD

-

CornerNet

-

M2Det

-

3D Object Detection

-

ZSD(Zero-Shot Object Detection)

-

OSD(One-Shot object Detection)

-

Weakly Supervised Object Detection

-

Softer-NMS

-

NAS-FPN,可实现比Mask-RCNN、FPN、SSD更快更好的目标检测

-

多方向目标检测:水平边界框上的滑动顶点

-

SM-NAS:结构到模块的神经体系结构搜索以进行目标检测

-

基于PSNet和边框回归的弱监督目标检测(WSOD)

-

带有可见IoU和Box Sign预测器的遮挡性行人检测

-

CSPNet:可以增强CNN学习能力的新型Backbone

-

ReBiF:残差双融合特征金字塔网络,用于较精确的Single-shot目标检测

-

目标检测的性能上界讨论

-

DIoU Loss:更快更好地学习边界框回归

-

CoAE:用于One-Shot目标检测的共同注意和共同激励

-

SAPD:Soft Anchor-Point目标检测

-

MMOD:基于混合模型的目标检测边界框密度估计

-

IENet:方向性航空目标检测的One Stage Anchor Free检测器

-

MnasFPN:用于移动设备上目标检测的延迟感知的金字塔体系结构

-

IPG-Net:用于目标检测的图像金字塔引导网络

-

MAL:用于目标检测的多Anchor学习

-

ATSS:缩小Anchor-free和Anchor-based的性能差距:通过自适应训练样本选择

-

Strong-Weak Distribution Alignment for Adaptive Object Detection

-

PartNet: A Recursive Part Decomposition Network for Fine-grained and Hierarchical Shape Segmentation

-

Deep HoughVoting for 3D Object Detection in Point Clouds

-

Simultaneous multi-view instance detection with learned geometric soft-constraints

-

Cap2Det: Learning to Amplify Weak Caption Supervision for Object Detection

-

Towards Adversarially Robust Object Detection

-

Multi-adversarial Faster-RCNN for Unrestricted Object Detection

-

Selectivity or Invariance: Boundary-aware Salient Object Detection

-

Joint Monocular 3D Detection and Tracking

-

GA-DAN: Geometry-Aware Domain Adaptation Network for Scene Text Detection and Recognition

-

ThunderNet: Towards Real-time Generic Object Detection

-

MemorizingNormality to Detect Anomaly: Memory-augmented Deep Autoencoder (MemAE) forUnsupervised Anomaly Detection

Tutorial

- CVPR'17 Tutorial Deep Learning for Objects and Scenes by Kaiming He Ross Girshick

- ICCV 2015 Tools for Efficient Object Detection

- Object Detection

- Image Recognition and Object Detection : Part 1

- R-CNN for Object Detection

- 史上最详尽的yolo教程

- Keras-RetinaNet训练自己的数据详细教程

视频教程

- cs231 第11讲 Detection and Segmentation

- Deep Learning for Instance-level Object Understanding by Ross Girshick.

- (全)深度学习之目标检测常用算法原理+实践精讲

- 最全的目标检测原理讲解

- 深度学习之分类与目标检测

- 2019最新基于深度学习的目标检测原理及实践教程

- Tensorflow Object Detection Tutorial

代码

-

R-CNN

-

Fast R-CNN:

- [https://github.com/rbgirshick/fast-rcnn]

- github("Fast R-CNN in MXNet"): https://github.com/precedenceguo/mx-rcnn

- github: https://github.com/mahyarnajibi/fast-rcnn-torch

- github: https://github.com/apple2373/chainer-simple-fast-rnn

- github: https://github.com/zplizzi/tensorflow-fast-rcnn

-

Faster R-CNN

- github(official, Matlab): https://github.com/ShaoqingRen/faster_rcnn

- github: https://github.com/rbgirshick/py-faster-rcnn

- github: https://github.com/mitmul/chainer-faster-rcnn

- github: https://github.com/andreaskoepf/faster-rcnn.torch

- github: https://github.com/ruotianluo/Faster-RCNN-Densecap-torch

- github: https://github.com/smallcorgi/Faster-RCNN_TF

- github: https://github.com/CharlesShang/TFFRCNN

- github(C++ demo): https://github.com/YihangLou/FasterRCNN-Encapsulation-Cplusplus

- github: https://github.com/yhenon/keras-frcnn

-

SPP-Net

-

YOLO

- github: https://github.com/gliese581gg/YOLO_tensorflow

- github: https://github.com/xingwangsfu/caffe-yolo

- github: https://github.com/frankzhangrui/Darknet-Yolo

- github: https://github.com/BriSkyHekun/py-darknet-yolo

- github: https://github.com/tommy-qichang/yolo.torch

- github: https://github.com/frischzenger/yolo-windows

- github: https://github.com/AlexeyAB/yolo-windows

- github: https://github.com/nilboy/tensorflow-yolo

-

YOLOv2

- github(Chainer): https://github.com/leetenki/YOLOv2

- github(Keras): https://github.com/allanzelener/YAD2K

- github(PyTorch): https://github.com/longcw/yolo2-pytorch

- github(Tensorflow): https://github.com/hizhangp/yolo_tensorflow

- github(Windows): https://github.com/AlexeyAB/darknet

- github: https://github.com/choasUp/caffe-yolo9000

- github: https://github.com/philipperemy/yolo-9000

-

YOLOv3

- https://github.com/qqwweee/keras-yolo3

- https://github.com/marvis/pytorch-yolo3

- https://github.com/experiencor/keras-yolo3

- https://github.com/ultralytics/yolov3

- https://github.com/eriklindernoren/PyTorch-YOLOv3

- https://github.com/YunYang1994/tensorflow-yolov3

- https://github.com/SpikeKing/keras-yolo3-detection

-

SSD

- github: https://github.com/zhreshold/mxnet-ssd

- github: https://github.com/zhreshold/mxnet-ssd.cpp

- github: https://github.com/rykov8/ssd_keras

- github: https://github.com/balancap/SSD-Tensorflow

- github: https://github.com/amdegroot/ssd.pytorch

- github(Caffe): https://github.com/chuanqi305/MobileNet-SSD

-

Recurrent Scale Approximation for Object Detection in CNN

-

Mask-RCNN 2017

-

Light-Head R-CNN

-

Cascade R-CNN

-

YOLT

-

DSSD

-

Pelee

-

R-FCN

-

FPN

-

DSOD

-

RetinaNet

-

MegDet

-

RefineNet

-

DetNet

-

CornerNet

-

M2Det

-

3D Object Detection

-

Softer-NMS

领域专家

- Ross Girshick (rbg 大神)

- [http://www.rossgirshick.info/]

- Ross Girshick是Facebook AI Research(FAIR)的研究科学家,致力于计算机视觉和机器学习。于2012年在Pedro Felzenszwalb的指导下获得了芝加哥大学的计算机科学博士学位。在加入FAIR之前,Ross是Redmond的Microsoft Research研究员和加利福尼亚大学伯克利分校的博士后。兴趣包括将自然语言处理与计算机视觉相结合的实例级对象理解和视觉推理挑战。获得2017年PAMI青年研究奖,并且以开发基于R-CNN(基于区域的卷积神经网络)方法进行物体检测而闻名。2017年,还获得了ICCV的马尔奖。

- Kaiming He, Facebook人工智能实验室科学家Kaiming He

- [http://kaiminghe.com/]

- Facebook AI Research(FAIR)的研究科学家。曾在Microsoft Research Asia(MSRA)工作,在获得博士学位后于2011年加入FAIR。研究兴趣是计算机视觉和深度学习。 获得2018年PAMI青年研究员奖,CVPR 2009最佳论文奖,CVPR 2016,ICCV 2017,ICCV 2017最佳学生论文奖以及ECCV 2018最佳论文荣誉奖的获得者。残差网络(ResNets)是Google Scholar Metrics 2019 中所有领域引用最多的论文.ResNets的应用还包括语言, 语音和AlphaGo。

- Shaoqing Ren

- [http://shaoqingren.com/]

- 2016年9月与他人共同创立了自动驾驶软件初创公司Momenta。目前,团队正在研究创新的计算机视觉解决方案,以使自动驾驶汽车成为现实。 获得中国科学技术大学和Microsoft Research Asia的联合博士学位的博士学位。我的上司是孙健博士。于2011年从同一部门获得了工学学士学位。

- Jian Sun

- [http://www.jiansun.org/]

- 首席科学家, MEGVII Technology研究部常务董事。 在Microsoft Research工作了十三年后,加入MEGVII Technology(也称为Face ++,于2016年7月)担任首席科学家和研究总经理。 生于中国西安,秦始皇兵马俑所在地。他获得了理学学士,硕士学位和博士学位。分别于1997年,2000年和2003年获得西安交通大学的博士学位。紧随其后,他加入了Microsoft Research Asia,一直从事计算机视觉和计算机图形学领域的工作,尤其对解决基础研究问题和构建实际的工作系统感兴趣。他的主要研究兴趣是计算摄影和基于图像的深度学习。

- Tsung-Yi Lin

- [https://vision.cornell.edu/se3/people/tsung-yi-lin/]

- 于2017年 在Serge Belongie的指导下在康奈尔纽约技术学院获得博士学位。研究兴趣是计算机视觉,尤其是学习用于交叉视图图像匹配和对象检测的视觉表示。目前是Google Brain的研究科学家。

- Ali Farhadi

- [https://homes.cs.washington.edu/~ali/]

- 华盛顿大学计算机科学与工程系的副教授。领导着艾伦人工智能研究所的PRIOR团队。主要对计算机视觉,机器学习,自然语言和视觉的交集,语义在视觉理解中的作用分析以及视觉推理感兴趣。

初步版本,水平有限,有错误或者不完善的地方,欢迎大家提建议和补充,会一直保持更新,本文为专知内容组原创内容,未经允许不得转载,如需转载请发送邮件至fangquanyi@gmail.com 或 联系微信专知小助手(Rancho_Fang)

敬请关注http://www.zhuanzhi.ai 和关注专知公众号,获取第一手AI相关知识

最近更新:2019-12-10