PyGDA代码库,快速入门图域自适应学习

[导读]新加坡国立大学和浙江大学的研究人员开源了一个简单易用的图域自适应学习代码库PyGDA,旨在降低研究门槛并提供统一、规范的实验环境。PyGDA集成了来自21种图域自适应学习主流算法、5类实验设置和26个数据集,支持5行代码即可完成实验搭建,同时提供个性化模型构建等便捷接口。 在图神经网络广泛应用于社交网络、推荐系统、生物信息等场景的今天,一个现实问题愈发突出—高质量标注数据的获取代价昂贵且耗时。特别是在某些特定领域或任务中,我们往往只能获得一个图(源域)中少量标注数据,而在另一个结构相似但无标签的图(目标域)中则一无所知。为了解决这一挑战,**图域自适应学习(Graph Domain Adaptation, GDA)应运而生。**它致力于从有标签的源域图中学习可迁移的知识,并将其有效应用于无标签或少标签的目标域图中,在不增加额外标注成本的前提下,实现目标域上的有效推理与泛化。该技术不仅能显著提升跨图任务的性能,还为大规模图数据应用提供了更加经济、高效的解决方案。 随着图域自适应学习(GDA)领域日益受到关注,实验对比的复杂性也随之上升。研究者往往需要在数十种方法之间进行系统评估,尽管这些方法大多开源,但由于代码风格、结构和实现规范各异,将它们适配到新的实验设置中仍需投入大量时间与精力。这不仅大大增加了复现和比较的成本,也使许多入门研究者难以专注于 GDA 本身的核心问题研究。 最近,新加坡国立大学和浙江大学的研究人员在GitHub上开源了一个可以快速入门的图域自适应学习代码库PyGDA。截至目前,PyGDA集成了来自21种图域自适应学习主流算法、5类实验设置和26个数据集,支持5行代码即可完成实验搭建,同时提供个性化模型构建等便捷接口。

论文链接:https://arxiv.org/pdf/2503.10284 代码链接:https://github.com/pygda-team/pygda 项目官网:https://pygda.readthedocs.io/en/stable/ 项目的开源旨在实现以下三个目标:

- 降低图域自适应学习入门门槛,帮助初学者更高效地理解与实践相关算法;

- 提供统一规范的实验环境,便于在多种应用场景下对各类算法进行全面、公正的评估;

- 搭建研究者之间的交流平台,促进经验共享与思维碰撞,激发更多创新性的研究思路。

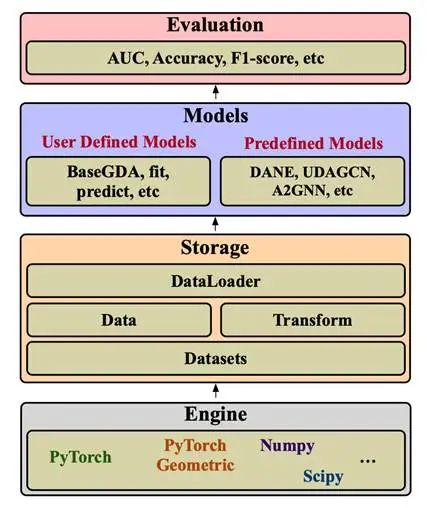

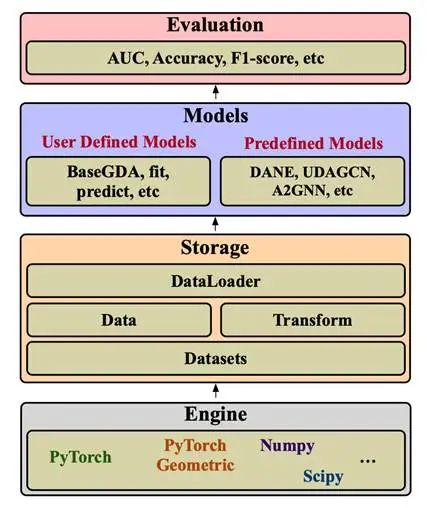

PyGDA简介 总的来说,PyGDA拥有一下几个特性: 1.覆盖图域自适应的完整流程:包括数据预处理、模型训练、评估等全流程操作,还支持在大图上的批量与采样式训练;

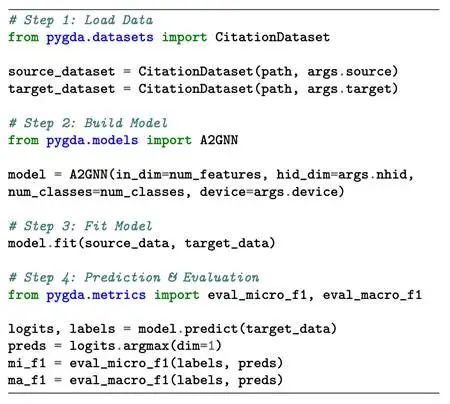

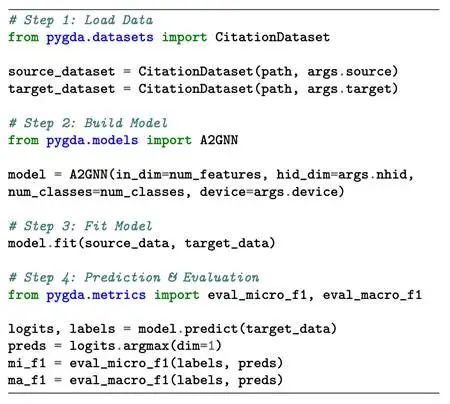

2.集成丰富的算法与实验资源:内置21 ****种主流 GDA **算法、5 ****类实验设置和26 个常用数据集,为算法评估与对比提供统一的实验环境; 3.结构清晰,易于上手:代码设计简洁,仅需 5 行代码即可快速完成实验搭建,同时支持个性化扩展与自定义模型构建。 4.便于扩展新算法:用户可通过继承 BaseGDA **类快速构建自定义模型,复用 PyGDA 核心功能,并按需灵活扩展。模型训练通过 fit() 方法完成,支持自定义或默认超参配置。

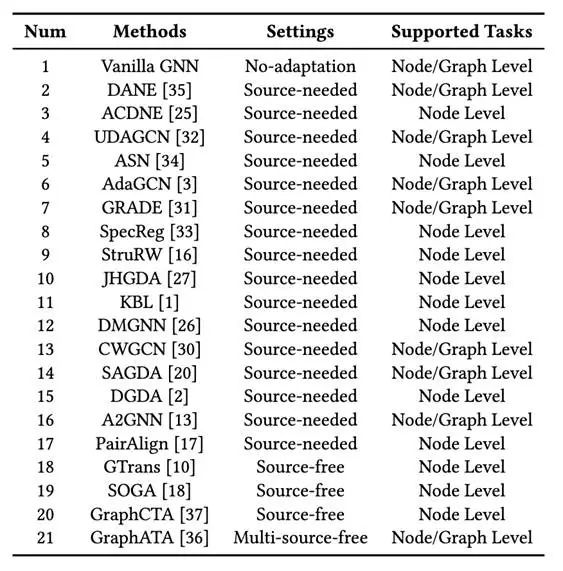

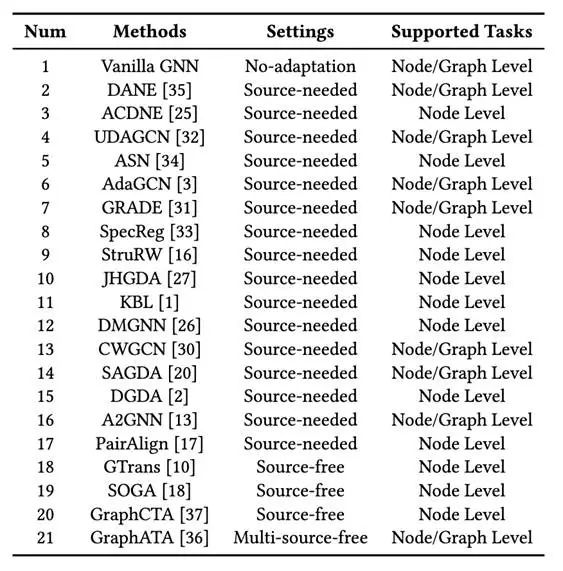

21个图域自适应算法 研究人员根据图域自适应任务的设置与特点,对 21 种主流算法进行了分类,具体如下表所示:

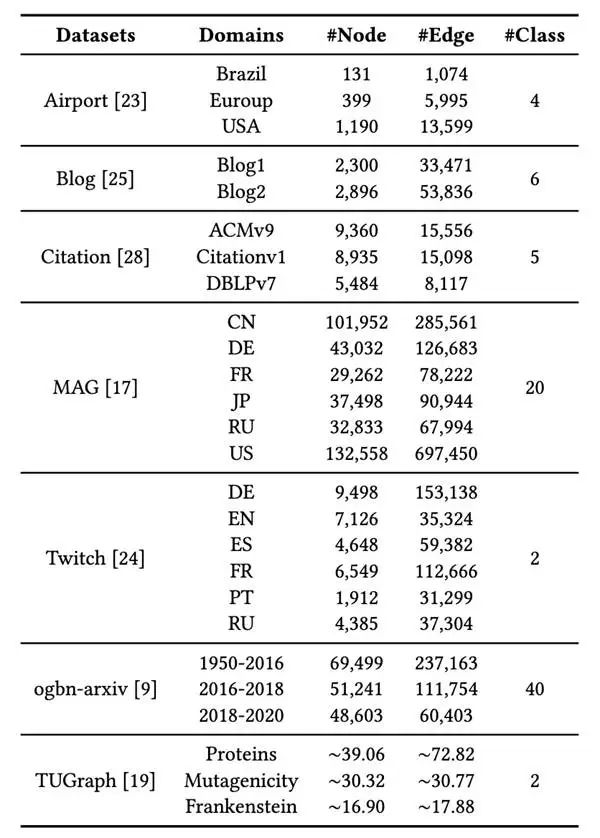

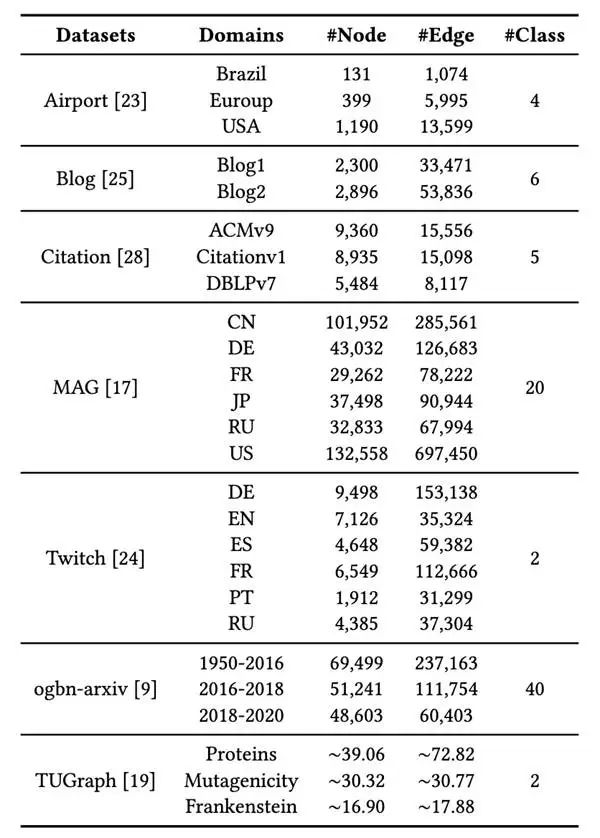

此外,仓库也持续更新,已集成如 A2GNN(AAAI 2024)、GraphATA(WWW 2025)等由社区贡献的最新图域自适应算法。 5类实验设置和26个数据集 PyGDA 支持多种实验场景,并配备多个类型丰富的数据集。通用代码被组织在 datasets/ 和 utils/ 目录中,便于后续扩展与自定义。 **1. **数据集涵盖多种图类型,包括社交网络、引文网络、蛋白质网络、交通网络等;

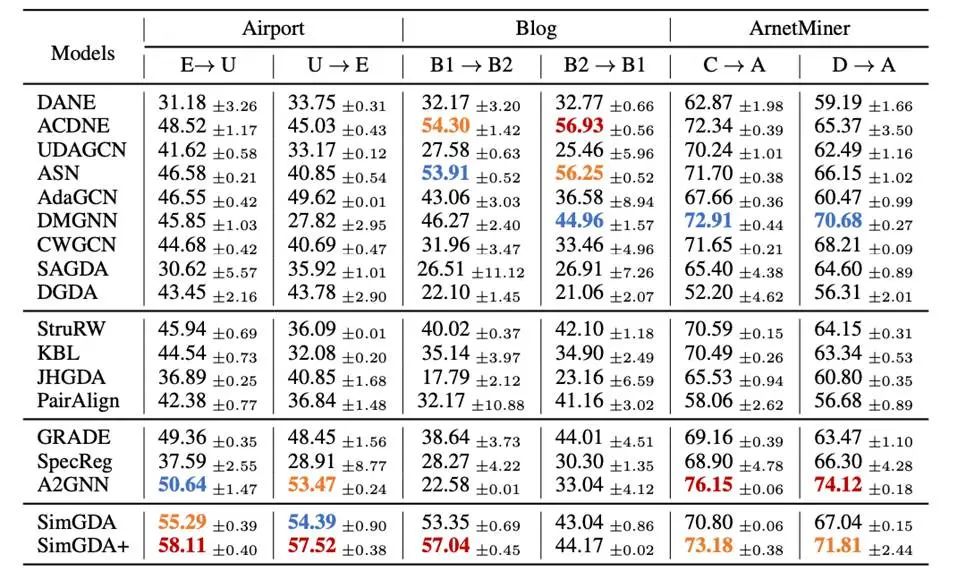

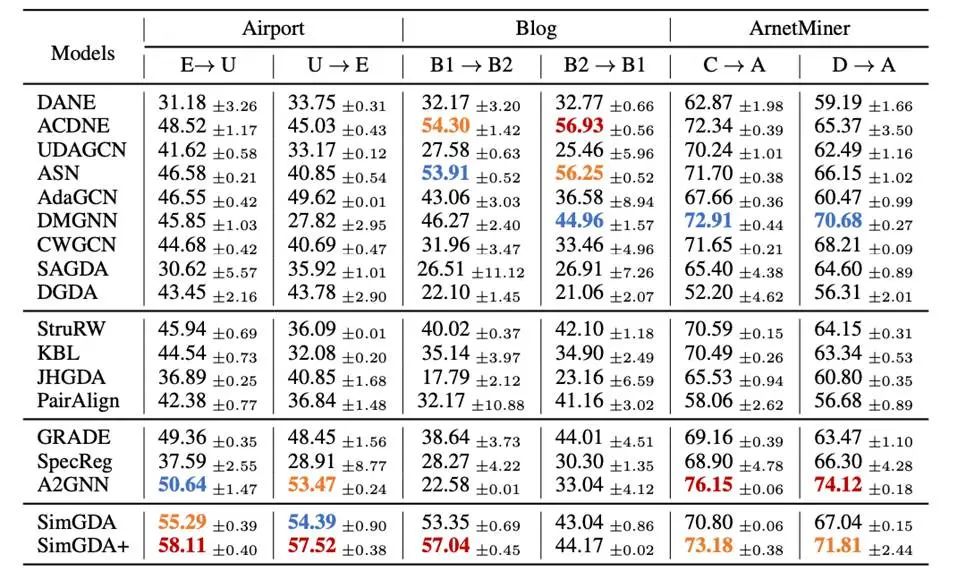

**2. **图分类与节点分类任务灵活切换:仅需通过参数设置 mode,其中 graph 表示图分类,node 表示节点分类(默认模式为 node); ‘’‘ model = A2GNN(in_dim=num_features, hid_dim=args.nhid, num_classes=num_classes, mode='graph', device=args.device) ’‘’ **3.**多源图自适应学习:只需将多个源域图作为输入传入 fit() 函数即可实现,使用便捷高效。 ‘’‘ model = GraphATA(in_dim=num_features, hid_dim=args.nhid, num_classes=num_classes, num_src_domains=n, device=args.device) model.fit([source_data, source_data2, ...], target_data) ‘‘’ 部分实验结果 为验证 PyGDA 实验平台的可用性,研究人员基于默认实验设置,展示了部分算法在典型场景下的表现,详见下表:

参考文献: [1] Liu M, Zhang Z, Tang J, et al. Revisiting, benchmarking and understanding unsupervised graph domain adaptation[J]. Advances in Neural Information Processing Systems, 2024, 37: 89408-89436. [2] Zhang Z, He B. Aggregate to Adapt: Node-Centric Aggregation for Multi-Source-Free Graph Domain Adaptation[C]//Proceedings of the ACM on Web Conference 2025. 2025: 4420-4431. [3] Zhang Z, Liu M, He B. PyGDA: A Python Library for Graph Domain Adaptation[J]. arXiv preprint arXiv:2503.10284, 2025.