注意力机制

·

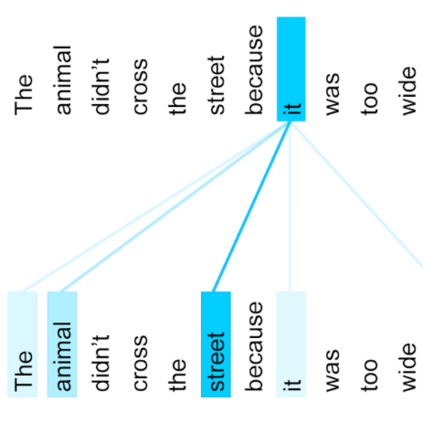

注意力是一种在广泛的神经结构中使用的越来越流行的机制。由于这一领域的快速发展,仍然缺乏对注意力的系统概述。在本文中,我们定义了用于自然语言处理的注意力体系结构的统一模型,重点介绍了用于文本数据的向量表示的体系结构。我们讨论了以往工作的不同方面,注意力机制的可能用途,并描述了该领域的主要研究工作和公开挑战。

https://web.eecs.umich.edu/~justincj/slides/eecs498/FA2020/598_FA2020_lecture13.pdf

成为VIP会员查看完整内容

相关内容

Arxiv

7+阅读 · 2018年11月4日