本研究报告介绍了联合情报组织 (JIO) 和英国政府通信总部 (GCHQ) 委托开展的一个项目的研究成果,该项目以人工智能 (AI) 和战略决策为主题。报告评估了应如何向政府战略决策者传达人工智能情报,以确保情报报告和评估的分析严谨性、透明度和可靠性等原则得到坚持。研究结果是在对英国评估机构、情报机构和其他政府部门进行广泛的初步研究基础上得出的。情报评估职能部门在识别、处理和分析呈指数增长的信息来源和数量方面面临着巨大挑战。研究发现,人工智能是所有来源情报分析师的重要分析工具,如果不采用人工智能工具,可能会损害所有来源情报评估的权威性和对政府的价值。然而,人工智能的使用既可能加剧情报工作中已知的风险,如偏差和不确定性,也可能使分析人员难以评估和交流人工智能丰富情报的局限性。评估界面临的一个主要挑战将是最大限度地利用人工智能的机遇和优势,同时降低任何风险。为了在向决策者传达富含人工智能的情报时采用最佳做法,报告建议为传达与人工智能有关的不确定性开发标准化术语;为情报分析师和战略决策者提供新的培训;以及为情报分析和评估中使用的人工智能系统制定认证计划。

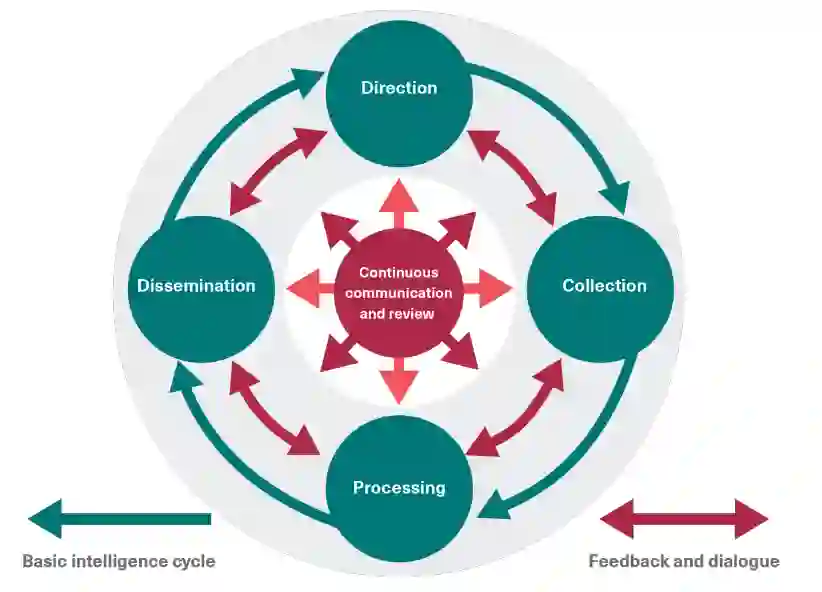

图 1:联合条令出版物 2-00《对联合行动的情报、反情报和安全支持》,国防部,2023 年

本报告介绍了由联合情报组织(JIO)和英国皇家通信总部(GCHQ)委托开展的CETaS研究项目的结果,该项目以人工智能(AI)和战略决策为主题。报告评估了应如何向政府战略决策者传达人工智能情报,以确保情报报告和评估的分析严谨性、透明度和可靠性等原则得到坚持。研究结果基于对英国评估机构、情报机构和其他政府部门进行的广泛的初级研究,在整个2023-24年期间进行了为期7个月的研究。

这里的 "人工智能丰富情报 "是指部分或全部通过使用机器学习分析或生成式人工智能系统(如大型语言模型)而得出的情报见解。

研究考虑了

- 国家安全决策者是否有足够的能力来评估人工智能丰富情报所提供的评估中固有的局限性和不确定性。

- 应在何时以及如何向国家安全决策者传达人工智能强化情报的局限性,以确保在可及性与技术细节之间取得平衡。

- 是否需要进一步的治理、指导方针或技能提升,以使国家安全决策者能够基于人工智能丰富的洞察力做出重大决策。

主要研究结果如下

1.人工智能是所有来源情报分析师的重要分析工具。人工智能系统处理大量数据的能力远远超出人类分析人员的能力,可以识别可能被忽视的趋势和异常现象。因此,选择不将人工智能用于情报目的,有可能违反《情报评估专业负责人共同分析标准》中规定的情报评估全面覆盖原则。此外,如果遗漏了关键的模式和联系,不采用人工智能工具可能会损害所有来源情报评估对政府的权威和价值。

2.然而,人工智能的使用加剧了情报评估和决策过程中固有的不确定性。人工智能系统的输出是概率计算(而非确定性),目前在数据不完整或有偏差的情况下很容易出现误差。许多人工智能系统的不透明性也使得人们难以理解人工智能是如何得出结论的。

3.对情报分析和评估中使用的人工智能系统,亟需精心设计、持续监测和定期调整,以减少扩大偏差和错误的风险。

4.制作评估产品的情报部门仍对评估用于情报分析和评估的人工智能方法的相关技术指标(如准确率和错误率)负有最终责任,所有来源的情报分析员在作出结论和判断时必须考虑到任何局限性和不确定性。

5.国家安全决策者目前需要人工智能系统性能和安全方面的高度保证,才能根据人工智能丰富的情报做出决策。

6.在人工智能系统缺乏强有力的保证程序的情况下,国家安全决策者普遍对人工智能识别事件和发生的能力比对人工智能确定因果关系的能力表现出更大的信心。决策者更愿意相信人工智能丰富的情报见解,如果这些见解得到非人工智能、可解释的情报来源的证实。

7.决策者对人工智能系统的技术知识差异很大。研究参与者一再表示,决策者必须对人工智能的基本原理、当前能力以及相应的保证流程有一个基本的了解,才能根据人工智能丰富的情报做出有分量的决策。

本报告建议采取以下行动,在向战略决策者传达富含人工智能的情报时采用最佳做法。

1.情报评估专业负责人(PHIA)应制定在所有来源评估中传达人工智能强化情报不确定性的指南。该指南应概述在向决策者阐明人工智能相关限制和注意事项时应使用的标准化术语。此外,还应就评估应向决策者说明使用人工智能强化情报的阈值提供指导。

2.在向战略决策者介绍技术信息时,评估界应采取分层方法。在提交给决策者的最终情报产品中,评估应始终能够为非技术受众所解读。然而,应根据要求向那些具有更多技术专长的人提供有关系统性能和局限性的补充信息。

3.英国情报评估学院应代表所有来源评估界完成培训需求分析,以确定新老 分析人员的培训需求。该学院应与所有情报来源评估组织合作,根据分析结果开发适当的培训。

4.应向国家安全决策者(及其工作人员)提供培训,以建立他们对人工智能情报评估的信任。应向决策者介绍人工智能的基本原理和相应的保证程序。

5.在高风险的国家安全决策会议之前,应立即举行简短、可选的专家简报会,因为在这些会议上,人工智能强化情报是承重决策的基础。这些会议应向决策者简要介绍关键的技术细节和局限性,并确保他们有机会提前考虑置信度评级。这些简报会应由联合信息办公室和国家安全秘书处共同协调,并应利用首席科学顾问网络和相关科学咨询委员会的跨政府专业知识。应制定关于何时提供简报的指南,并应持续评估简报的必要性;随着决策者对消费人工智能情报变得更加得心应手,所需的保证程度可能会降低,简报最终可能变得没有必要。

6.应为情报分析和评估中使用的人工智能系统制定一个正式的认证方案,以确保模型在稳健性、安全性、透明度以及固有偏见和缓解记录方面满足最低政策要求。将系统应用于特定问题的技术保证应下放给相关组织,每个组织的保证过程都应得到认证。这一计划将需要专门的资源,将对情报评估标准和程序的理解与技术专长结合起来。PHIA 应协助制定原则和要求,而认证和测试方面的技术专长则应从情报界和政府各部门的技术主管部门抽调。